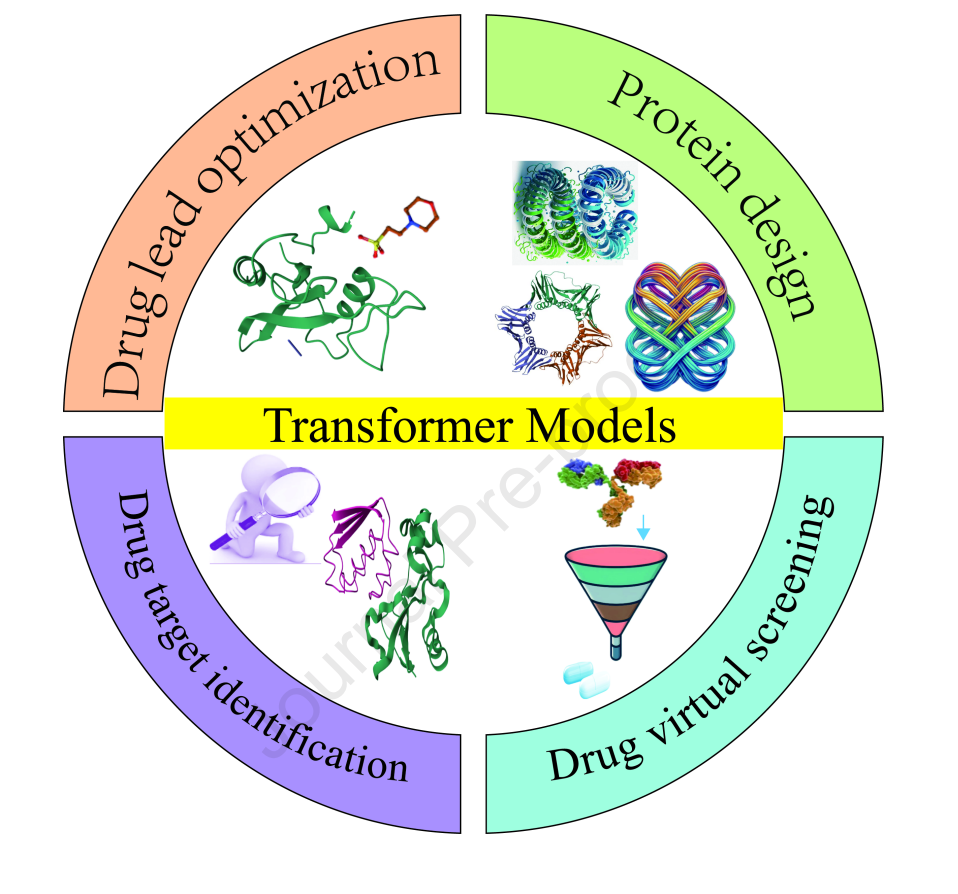

Transformer模型已成为药物发现领域中的关键工具,其独特的架构特征和在处理复杂数据场景中的卓越表现使其脱颖而出。通过利用Transformer架构固有的能力来理解序列数据中复杂的层次依赖性,这些模型在包括新药设计和药物靶点识别等各种任务中展现了显著的效果。预训练的Transformer模型的适应性使其成为推动药物发现、化学和生物学领域数据驱动进步的不可或缺的资产,提供了一个加速这些领域创新和发现的坚实框架。除了其技术实力外,基于Transformer的模型在药物发现、化学和生物学中的成功还延伸至其跨学科的潜力,能够无缝结合生物学、物理学、化学和药理学的见解,弥合不同学科之间的差距。这种综合方法不仅增强了研究工作的深度和广度,还促进了不同领域之间的协同合作和思想交流。在我们的综述中,我们阐明了Transformer在药物发现以及化学和生物学中的诸多应用,涵盖了从蛋白质设计与蛋白质工程、分子动力学、药物靶点识别、Transformer支持的虚拟筛选、药物先导优化、药物成瘾、小数据集挑战、化学和生物图像分析、化学语言理解到单细胞数据等方面。最后,我们通过探讨Transformer模型在药物发现及其他科学领域中的有前景的趋势为本次综述作结。

1. 引言

2014年,Bahdanau等人[1]将注意力机制引入自然语言处理(NLP)模型,为Transformer模型[2]奠定了基础。最初,Transformer是为NLP中的自动翻译任务设计的,但它们因其高度的适应性和灵活性,在NLP以外的多个领域中得到了广泛应用。通过适当的修改和调整,Transformer已经成功应用于计算机视觉(CV)[3]、图像处理[4]、化学[5]和生命科学[6]等领域。自2017年问世以来,由于其多功能性,Transformer引起了广泛关注,推动了各种基于Transformer的模型和应用的不断涌现,包括生成式预训练Transformer(GPT)[7]和基于Transformer的双向编码器表示(BERT)[8]等。即使在如ChatGPT[9]等大型语言模型和聊天机器人等著名的人工智能(AI)应用中,基于Transformer的模型仍然是核心组件,为更深入地理解分子结构、序列和功能铺平了道路[10],[11]。 在过去几年里,随着深度学习(DL)技术的日益发展,尤其是Transformer模型的兴起,重新塑造药物设计和发现方法的兴趣日益浓厚。在这些领域中,Transformer模型的显著成就得益于多个因素。 首先,Transformer固有的处理长距离依赖性的能力在处理复杂的分子结构和化学反应中起到了关键作用。与传统的循环神经网络(RNN)相比,RNN在捕捉序列数据中的长期依赖性时存在困难,而Transformer在识别原子、分子和材料之间的复杂关系上表现出色。这种能力使得Transformer模型能够准确预测药物性质,解码药物分子结构,并通过全面考虑跨越不同空间尺度的众多因素来进行虚拟筛选。因此,基于Transformer的模型为化学系统提供了更全面和细致的理解,从而提高了药物发现中预测的精确性和可靠性。 此外,集成于Transformer架构中的自注意力机制使得并行处理更加高效,这在处理药物发现研究中固有的大数据集时尤为重要。传统的RNN逐步处理顺序数据,在面对大型数据集或复杂的分子排列时会导致计算效率低下。相比之下,Transformer能够同时关注序列中的多个位置,促进跨药物分子不同区域的特征和相互作用的并行计算。这种并行化加速了模型的训练和推理,简化了药物发现领域的实验和分析。因此,基于Transformer的模型加快了药物物理和化学性质、药物分子行为以及药物化学过程的阐明,从而推动了这些领域的研究进展。 此外,Transformer架构固有的可扩展性和适应性使其非常适合应对药物发现中的多种挑战。Transformer可以轻松定制和微调,以适应各种数据类型,从分子表示到实验测量,促进与现有研究方法和数据集的无缝整合。此外,基于Transformer的模型在从预测药物性质到设计新药分子等广泛任务中表现出强大的性能,得益于其灵活的架构和广泛的预训练能力。这种多功能性使研究人员能够将Transformer模型应用于药物设计和发现中的许多问题,并取得了令人期待的成果。因此,Transformer架构的可扩展性和适应性大大促进了其在药物发现研究前沿中的广泛应用和成功。 总体而言,Transformer架构已广泛应用于药物发现的各个方面。在这一框架内的显著应用包括药物靶点识别[12],[13]、基于Transformer的药物虚拟筛选(VS)[14],[15]、药物先导优化[16],[17]、药物成瘾[18],[19]、蛋白质设计与蛋白质工程[20],[21]、小数据集挑战[22],[23]、分子动力学(MD)[24]、化学和生物图像分析[25],[26]以及化学语言理解[27],[28]。尽管这些应用广泛存在,现有文献中仍然缺乏将这些方面关联起来的有序分类法。虽然已有少数关于Transformer的综述文章,但大多数集中在计算机科学[3]、医学[29],[30]、视觉[31]、文本[32],[33],[34]等应用领域[35]。然而,没有一篇文章专注于药物发现中的问题。因此,有必要提供一篇以研究领域为中心的综述,以便对药物发现感兴趣的读者从中受益。 本文的其余部分组织如下:第2节对基础的Transformer技术进行了回顾。第3节讨论了基于Transformer模型在药物发现中的主要应用,涵盖了药物靶点识别、基于Transformer的药物虚拟筛选(VS)、药物先导优化、药物成瘾、蛋白质设计与蛋白质工程、小数据集挑战、分子动力学(MD)、化学和生物图像分析、化学语言理解和单细胞数据等内容。最后,第4节展望了未来的发展方向,包括Chatbots和Sora在药物发现中的作用、多模态学习在组学数据中的应用、催化剂和酶筛选以及定制化Transformer模型在药物发现中的应用。