论文摘要:

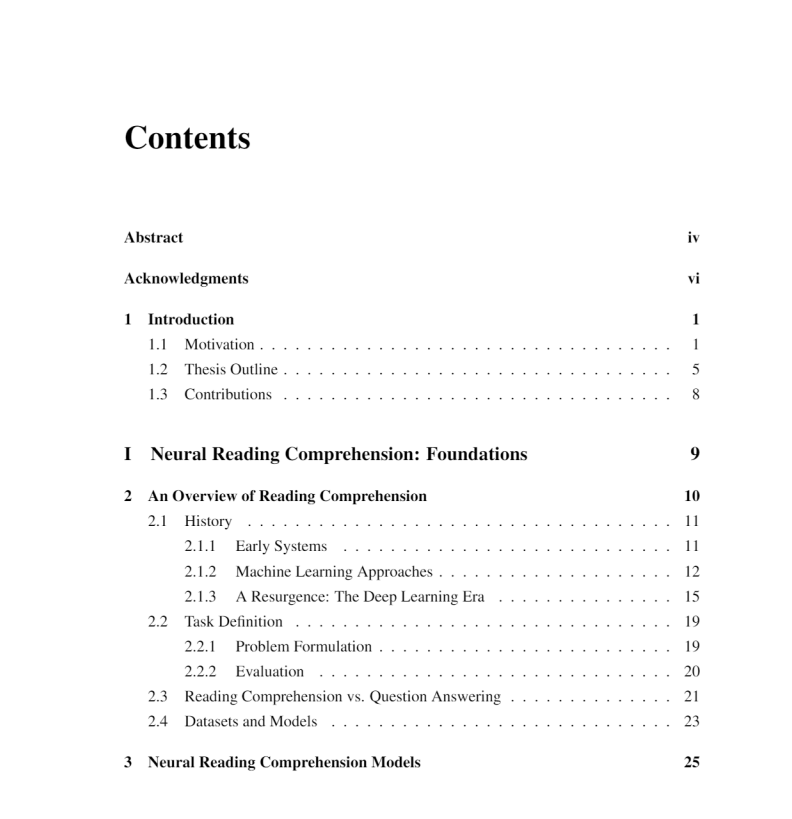

教机器理解人类语言文档是人工智能中最难以捉摸和长期存在的挑战之一。本文探讨了阅读理解的问题:如何构建计算机系统来阅读文章和回答理解问题。一方面,我们认为阅读理解是评价计算机系统对人类语言理解程度的一项重要任务。另一方面,如果我们能够构建高性能的阅读理解系统,那么它将成为问答和对话系统等应用的关键技术。本文以神经阅读理解为研究对象:一种基于深度神经网络的阅读理解模型。与传统的稀疏的、手工设计的基于特征的模型相比,这些端到端神经模型在学习丰富的语言现象方面更加有效,并且在所有现代阅读理解基准上的表现都有很大的提高。本文由两部分组成。第一部分是对神经阅读理解的本质进行概括,介绍我们在构建有效的神经阅读理解模型方面所做的努力,更重要的是了解神经阅读理解模型实际学到了什么,以及解决当前任务需要什么样的语言理解深度。我们还总结了该领域的最新进展,讨论了该领域的未来发展方向和有待解决的问题。在本文的第二部分,我们探讨了如何在最近神经阅读理解成功的基础上建立实际应用。特别是,我们开创了两个新的研究方向:1)如何将信息检索技术与神经阅读理解相结合,解决大规模开放领域的问题;(2)如何从当前的单圈、跨步阅读理解模式中构建会话问答系统。我们在DrQA和CoQA项目中实现了这些想法,并证明了这些方法的有效性。我们相信他们对推动未来的语言技术有很大帮助。

成为VIP会员查看完整内容