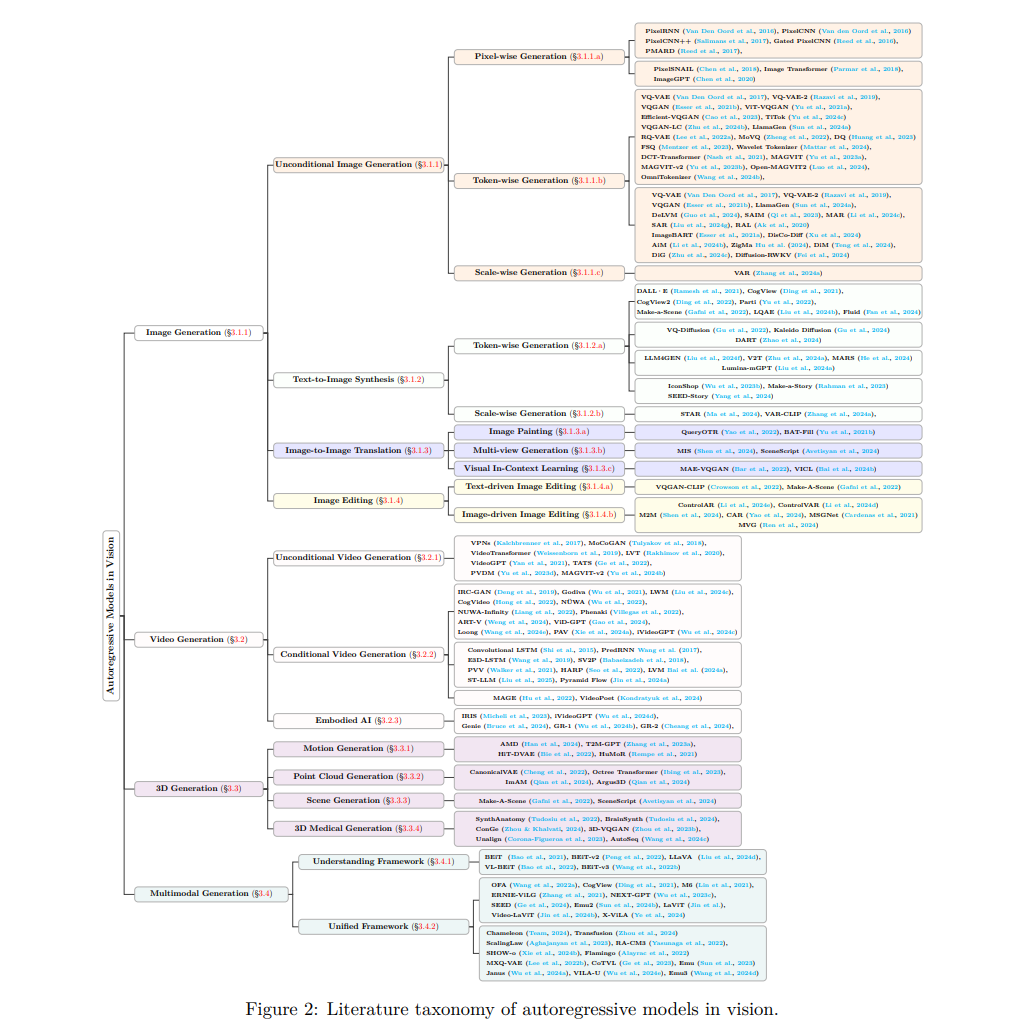

自回归模型在自然语言处理(NLP)领域取得了巨大成功。最近,自回归模型逐渐成为计算机视觉领域的重要研究方向,并在生成高质量视觉内容方面表现出色。NLP中的自回归模型通常在子词级别上进行操作,然而,在计算机视觉中,数据的表示策略可以在像素级、令牌级或尺度级进行,以反映视觉数据的多样性和层次性,这与语言的顺序结构有所不同。本综述全面梳理了视觉自回归模型的相关文献。为了提升不同学科背景的研究者的可读性,我们首先介绍视觉中的序列表示和建模基础。接着,我们将视觉自回归模型的基本框架划分为三类:基于像素、基于令牌和基于尺度的模型,这些分类基于不同的表示策略。然后,我们探讨自回归模型与其他生成模型之间的内在联系。此外,我们对计算机视觉中的自回归模型进行了多维度分类,包括图像生成、视频生成、3D生成和多模态生成,并详细介绍了其在各类领域的应用,包括新兴领域如具身人工智能(Embodied AI)和3D医学人工智能,参考文献多达250篇。最后,我们指出了当前视觉自回归模型所面临的挑战,并提出了未来潜在的研究方向。我们还在Github上建立了一个仓库,收录了本综述涉及的相关文献,网址为:https://github.com/ChaofanTao/Autoregressive-Models-in-Vision-Survey https://arxiv.org/pdf/2411.05902

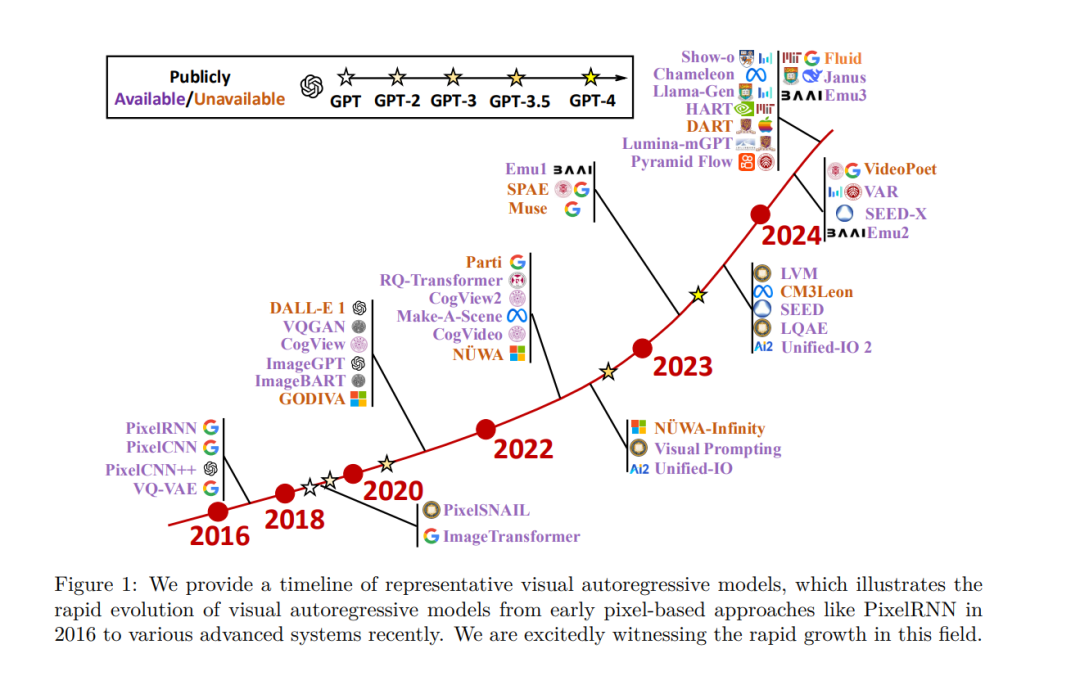

自回归模型通过基于先前元素的条件概率预测序列中的每个元素来生成数据,最初在自然语言处理(NLP)领域获得了突出地位(Vaswani 等人,2017;Radford 等人,2019;Brown 等人,2020;Achiam 等人,2023;Wan 等人,2023;Zhou 等人,2023a)。这种成功可归因于其捕捉长距离依赖和生成高质量、上下文相关输出的内在优势。特别是,经验性缩放定律(Henighan 等人,2020;Hoffmann 等人,2022;Muennighoff 等人,2023;Tao 等人,2024;Lyu 等人,2023)表明,增加模型规模和计算预算会持续改善跨熵损失,在图像生成、视频建模、多模态任务和数学问题求解等各个领域都遵循通用的幂律关系。受其在 NLP 中的成就启发,自回归模型最近开始在计算机视觉领域展示出巨大的潜力。图 1 的时间线展示了视觉自回归模型演变的关键里程碑和发展,强调了它们从 NLP 到计算机视觉的过渡。迄今为止,自回归模型已被应用于广泛的生成任务,包括图像生成(Parmar 等人,2018;Chen 等人,2020)、图像超分辨率(Guo 等人,2022;Li 等人,2016)、图像编辑(Yao 等人,2022;Crowson 等人,2022)、图像到图像翻译(Li 等人,2024e;Li 等人,2024d)和视频生成(Tulyakov 等人,2018;Hong 等人,2022)、多模态任务(Yu 等人,2023c;Lu 等人,2022)以及医疗任务(Ren 等人,2024;Tudosiu 等人,2024)等。这种广泛的适用性强调了进一步探索和应用自回归模型的潜力。随着视觉自回归模型的迅速发展,跟上最新的进展变得越来越具有挑战性。因此,对现有工作的全面综述对于研究社区来说是及时且重要的。本文旨在对视觉自回归的最新发展进行深入概述,并探索未来改进的潜在方向。我们强调,至少有三种由序列表示策略定义的不同类别的视觉自回归模型:基于像素的、基于令牌的和基于尺度的模型。Pixel-RNN(Van Den Oord 等人,2016)作为像素级模型的代表,通过将二维图像转换为一维像素序列来预测下一个像素,捕捉了局部和长距离依赖,但计算成本较高。受 NLP 启发的下一个令牌预测将图像压缩为离散令牌,以高效处理高分辨率图像,代表性模型如 VQ-VAE(Van Den Oord 等人,2017)。VAR(Tian 等人,2024)引入了下一个尺度预测,这是一种分层方法,从粗到细自回归地生成多个尺度的内容,捕捉多分辨率的视觉信息。每个类别都提供了独特的优势和挑战,使其成为未来研究的有前途的方向。我们进一步从多角度介绍了自回归模型在计算机视觉中的分类,基于序列表示策略、底层框架或目标任务对现有模型进行分类。我们的分类旨在提供一个结构化的概览,展示这些模型如何在各种视觉任务中被利用。然后,我们提出了定量和定性的指标来评估其性能和适用性。最后,我们强调了自回归模型当前的局限性,如计算复杂度和模式崩溃,并提出了未来研究的潜在方向。总之,本综述做出了以下贡献:

- 鉴于基于视觉自回归模型的最新进展激增,我们提供了这些模型的全面且及时的文献回顾,旨在让读者快速理解通用的自回归建模框架。

- 我们基于序列表示策略对视觉自回归模型进行了分类,并系统地汇编了各个领域的应用。这旨在帮助特定领域的研究人员快速识别和了解相关工作。

- 我们从大约 250 篇相关参考文献中对视觉中的自回归模型进行了全面回顾,并总结了它们在四个图像生成基准(ImageNet、MS-COCO、MJHQ-30K 和 GenEval bench)中与 GAN/扩散/MAE 方法的比较评估。