1、 Adversarial Graph Embedding for Ensemble Clustering

作者:Zhiqiang Tao , Hongfu Liu , Jun Li , ZhaowenWang and Yun Fu;

摘要:Ensemble Clustering通常通过图分区方法将基本分区集成到共识分区(consensus partition)中,但这种方法存在两个局限性: 1) 它忽略了重用原始特征; 2)获得具有可学习图表示的共识分区(consensus partition)仍未得到充分研究。在本文中,我们提出了一种新颖的对抗图自动编码器(AGAE)模型,将集成聚类结合到深度图嵌入过程中。具体地,采用图卷积网络作为概率编码器,将特征内容信息与共识图信息进行联合集成,并使用简单的内积层作为解码器,利用编码的潜变量(即嵌入表示)重建图。此外,我们还开发了一个对抗正则化器来指导具有自适应分区依赖先验的网络训练。通过对8个实际数据集的实验,证明了AGAE在几种先进的深度嵌入和集成聚类方法上的有效性。

网址:https://www.ijcai.org/proceedings/2019/0494.pdf

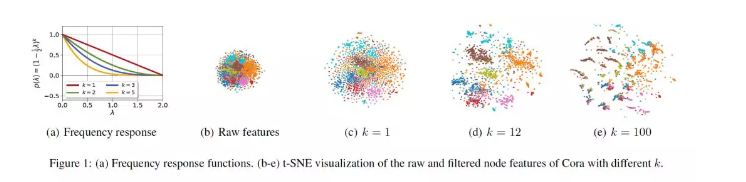

2、Attributed Graph Clustering via Adaptive Graph Convolution

作者:Xiaotong Zhang, Han Liu, Qimai Li and Xiao-Ming Wu;

摘要:Attributed Graph聚类是一项具有挑战性的工作,它要求对图结构和节点属性进行联合建模。图卷积网络的研究进展表明,图卷积能够有效地将结构信息和内容信息结合起来,近年来基于图卷积的方法在一些实际属性网络上取得了良好的聚类性能。然而,对于图卷积如何影响聚类性能以及如何正确地使用它来优化不同图的性能,人们的了解有限。现有的方法本质上是利用固定低阶的图卷积,只考虑每个节点几跳内的邻居,没有充分利用节点关系,忽略了图的多样性。本文提出了一种自适应图卷积方法,利用高阶图卷积捕获全局聚类结构,并自适应地为不同的图选择合适的顺序。通过对基准数据集的理论分析和大量实验,验证了该方法的有效性。实验结果表明,该方法与现有的方法相比具有较好的优越性。

网址:https://www.zhuanzhi.ai/paper/bae18963457b08322d58e01c90e8e467

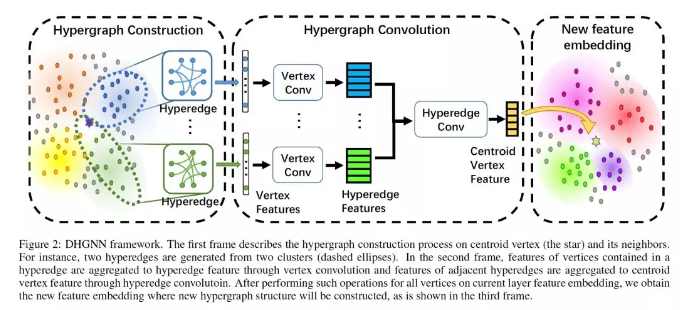

3、Dynamic Hypergraph Neural Networks

作者:Jianwen Jiang , Yuxuan Wei , Yifan Feng , Jingxuan Cao and Yue Gao;

摘要:近年来,基于图/超图(graph/hypergraph)的深度学习方法引起了研究者的广泛关注。这些深度学习方法以图/超图结构作为模型的先验知识。然而,隐藏的重要关系并没有直接表现在内在结构中。为了解决这个问题,我们提出了一个动态超图神经网络框架(DHGNN),它由两个模块的堆叠层组成:动态超图构造(DHG)和超图卷积(HGC)。考虑到最初构造的超图可能不适合表示数据,DHG模块在每一层上动态更新超图结构。然后引入超图卷积对超图结构中的高阶数据关系进行编码。HGC模块包括两个阶段:顶点卷积和超边界卷积,它们分别用于聚合顶点和超边界之间的特征。我们已经在标准数据集、Cora引文网络和微博数据集上评估了我们的方法。我们的方法优于最先进的方法。通过更多的实验验证了该方法对不同数据分布的有效性和鲁棒性。

网址:https://www.ijcai.org/proceedings/2019/0366.pdf

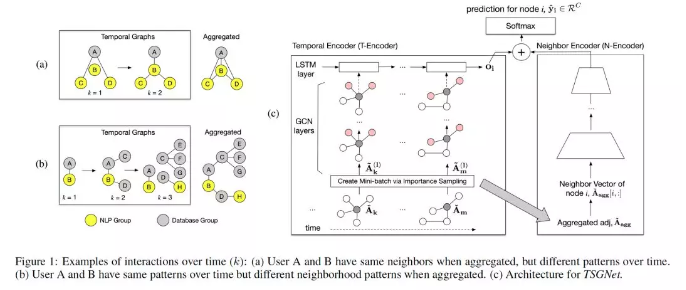

4、Exploiting Interaction Links for Node Classification with Deep Graph Neural Networks

作者:Hogun Park and Jennifer Neville;

摘要:节点分类是关系机器学习中的一个重要问题。然而,在图边表示实体间交互的场景中(例如,随着时间的推移),大多数当前方法要么将交互信息汇总为链接权重,要么聚合链接以生成静态图。在本文中,我们提出了一种神经网络结构,它可以同时捕获时间和静态交互模式,我们称之为Temporal-Static-Graph-Net(TSGNet)。我们的主要观点是,利用静态邻居编码器(可以学习聚合邻居模式)和基于图神经网络的递归单元(可以捕获复杂的交互模式),可以提高节点分类的性能。在我们对节点分类任务的实验中,与最先进的方法相比,TSGNet取得了显著的进步——与四个真实网络和一个合成数据集中的最佳竞争模型相比,TSGNet的分类错误减少了24%,平均减少了10%。

网址:https://www.ijcai.org/proceedings/2019/0447.pdf

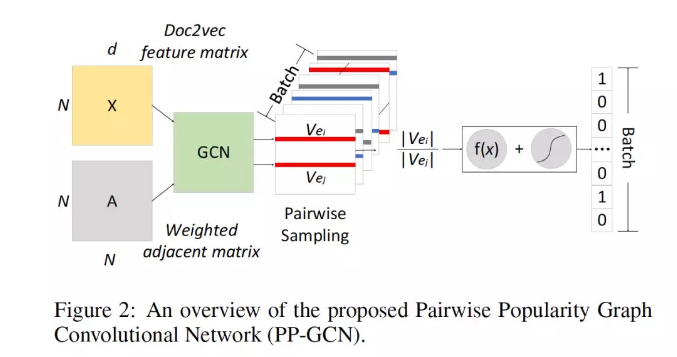

5、Fine-grained Event Categorization with Heterogeneous Graph Convolutional Networks

作者:Hao Peng, Jianxin Li, Qiran Gong, Yangqiu Song, Yuanxing Ning, Kunfeng Lai and Philip S. Yu;

摘要:事件在现实世界中实时发生,可以是涉及多个人和物体的计划和组织场合。社交媒体平台发布了大量包含公共事件和综合话题的文本消息。然而,由于文本中事件元素的异构性以及显式和隐式的社交网络结构,挖掘社会事件是一项具有挑战性的工作。本文设计了一个事件元模式来表征社会事件的语义关联,并构建了一个基于事件的异构信息网络(HIN),该网络融合了外部知识库中的信息,提出了一种基于对偶流行度图卷积网络(PP-GCN)的细粒度社会事件分类模型。我们提出了一种基于事件间社会事件相似度(KIES)的知识元路径实例,并建立了一个加权邻域矩阵作为PP-GCN模型的输入。通过对真实数据收集的综合实验,比较各种社会事件检测和聚类任务。实验结果表明,我们提出的框架优于其他可选的社会事件分类技术。

网址:https://www.zhuanzhi.ai/paper/65dbfd1c2b65d01b2db1b66a3b4efdb6

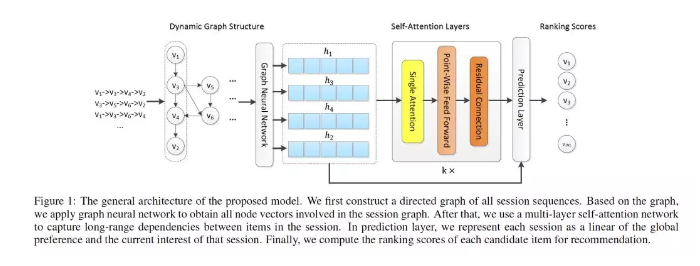

6、Graph Contextualized Self-Attention Network for Session-based Recommendation

作者:Chengfeng Xu, Pengpeng Zhao, Yanchi Liu, Victor S. Sheng, Jiajie Xu, Fuzhen Zhuang, Junhua Fang and Xiaofang Zhou;

摘要:基于会话的推荐旨在预测用户基于匿名会话的下一步行动,是许多在线服务(比如电子商务,媒体流)中的关键任务。近年来,在不使用递归网络和卷积网络的情况下,自注意力网络(SAN)在各种序列建模任务中取得了显著的成功。然而,SAN缺乏存在于相邻商品上的本地依赖关系,并且限制了其学习序列中商品的上下文表示的能力。本文提出了一种利用图神经网络和自注意力机制的图上下文自注意力模型(GC-SAN),用于基于会话的推荐。在GC-SAN中,我们动态地为会话序列构造一个图结构,并通过图神经网络(GNN)捕获丰富的局部依赖关系。然后,每个会话通过应用自注意力机制学习长期依赖关系。最后,每个会话都表示为全局首选项和当前会话兴趣的线性组合。对两个真实数据集的大量实验表明,GC-SAN始终优于最先进的方法。

网址:https://www.ijcai.org/proceedings/2019/0547.pdf

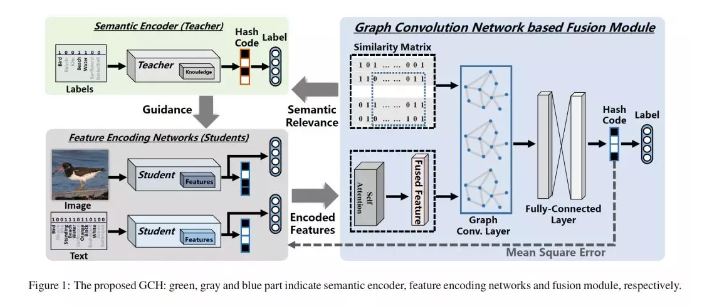

7、Graph Convolutional Network Hashing for Cross-Modal Retrieval

作者:Ruiqing Xu , Chao Li , Junchi Yan , Cheng Deng and Xianglong Liu;

摘要:基于深度网络的跨模态检索近年来取得了显著的进展。然而,弥补模态差异,进一步提高检索精度仍然是一个关键的瓶颈。本文提出了一种图卷积哈希(GCH)方法,该方法通过关联图学习模态统一的二进制码。一个端到端深度体系结构由三个主要组件构成:语义编码模块、两个特征编码网络和一个图卷积网络(GCN)。我们设计了一个语义编码器作为教师模块来指导特征编码过程,即学生模块,用于语义信息的挖掘。此外,利用GCN研究数据点之间的内在相似性结构,有助于产生有区别的哈希码。在三个基准数据集上的大量实验表明,所提出的GCH方法优于最先进的方法。