近期必读的9篇CVPR 2019【图神经网络(GNN)+CV】相关论文和代码

【导读】最近小编推出CVPR2019图卷积网络、CVPR2019生成对抗网络、【可解释性】,CVPR视觉目标跟踪,CVPR视觉问答,医学图像分割,图神经网络的推荐,CVPR域自适应, ICML图神经网络,ICML元学习,ACL2019图神经网络相关论文,反响热烈。最近,CVPR 在2019 年 6 月 16 日 在美国加州的长滩市召开举行。今年共收到了 5165 篇有效提交论文,CVPR 官网也公布了论文的proceedings,显示有1294篇paper,小编发现,今年接受的文章结合GNN的工作有二三十篇,看来,图神经网络已经攻占CV领域,GNN的不同CV应用,很有意思,供大家参考学习,看能否结合,期待好的工作!今天小编专门整理最新十篇CVPR长文,图神经网络(GNN)+CV—多标签图像识别、图卷积跟踪、边缘特征、半监督学习、行为识别、域自适应、点云语义分割、人体姿态回归等。

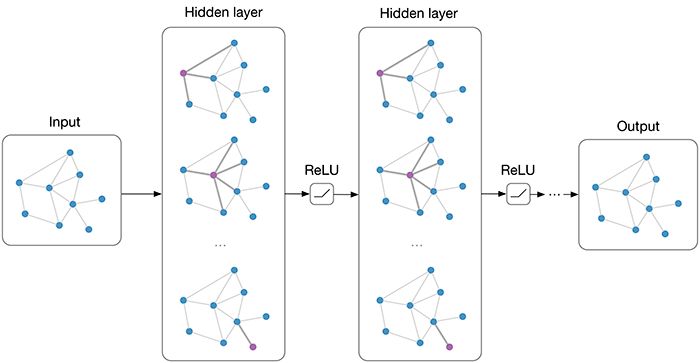

GCN经典结构

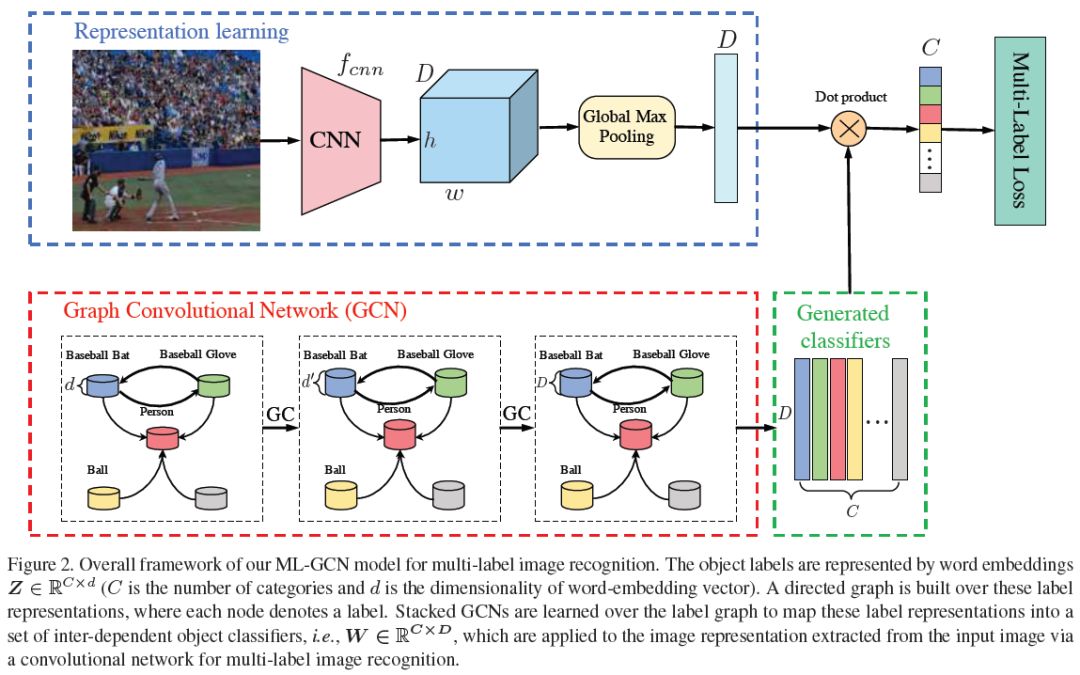

1、Multi-Label Image Recognition with Graph Convolutional Networks (基于图卷积网络的多标签图像识别)

CVPR ’19

作者:Zhao-Min Chen, Xiu-Shen Wei, Peng Wang, Yanwen Guo

摘要:多标签图像识别的任务是预测图像中出现的一组目标标签。由于对象通常同时出现在图像中,因此需要对标签依赖关系进行建模,以提高识别性能。为了捕捉和探索这些重要的依赖关系,我们提出了一种基于图卷积网络(GCN)的多标签分类模型。该模型在对象标签上构建有向图,其中每个节点(标签)由标签的词嵌入表示,GCN学会将这个标签图映射到一组相互依赖的目标分类器中。这些分类器应用于由另一个子网络提取的image descriptor,使整个网络能够端到端可训练。在此基础上,我们提出了一种新的re-weighted方法来建立一个有效的标签相关矩阵,以指导GCN中节点之间的信息传播。在两个多标签图像识别数据集上的实验表明,我们的方法明显优于现有的其他最先进的方法。此外,可视化分析表明,该模型学习的分类器保持了有意义的语义拓扑。

网址:

http://openaccess.thecvf.com/content_CVPR_2019/papers/Chen_Multi-Label_Image_Recognition_With_Graph_Convolutional_Networks_CVPR_2019_paper.pdf

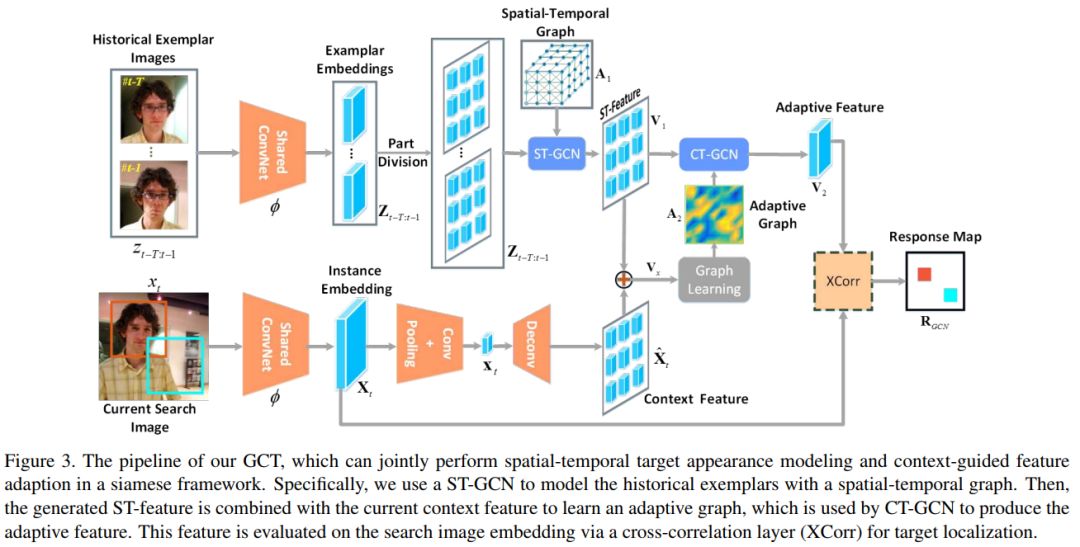

2、Graph Convolutional Tracking(图卷积跟踪)

CVPR ’19

作者:Junyu Gao, Tianzhu Zhang, Changsheng Xu

摘要:近年来,siamese网络的跟踪性能良好。然而,现有的siamese方法大多没有充分利用不同情景下的时空(spatial-temporal)目标外观建模。事实上,spatial-temporal信息可以提供多种特征来增强目标表示,而上下文信息对于目标定位的在线适应非常重要。为了综合利用历史目标样本的时空结构并从上下文信息中获益,本文提出了一种用于高性能视觉跟踪的图卷积跟踪(GCT)方法。具体地说,GCT将两种类型的图卷积网络(GCNs)合并到一个用于目标外观建模的siamese框架中。在此,我们采用时空GCN对历史目标范例的结构化表示进行建模。此外,还设计了一个上下文GCN,利用当前帧的上下文学习目标定位的自适应特征。在4个具有挑战性的基准测试上的广泛结果表明,我们的GCT方法在以每秒50帧左右的速度运行时,相对于最先进的跟踪器表现出色。

网址:

http://openaccess.thecvf.com/content_CVPR_2019/papers/Gao_Graph_Convolutional_Tracking_CVPR_2019_paper.pdf

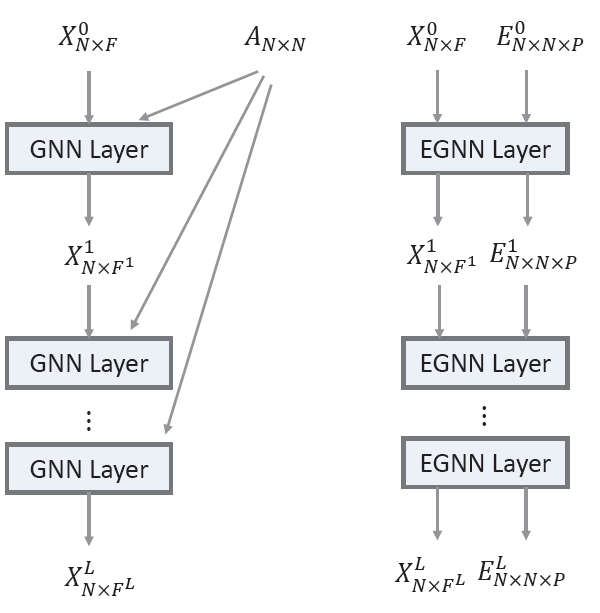

3、Exploiting Edge Features for Graph Neural Networks(基于边缘特征的图神经网络)

CVPR ’19

作者:Liyu Gong, Qiang Cheng

摘要:边缘特征(edge features)包含关于图的重要信息。然而,目前用于graph learning的最先进的神经网络模型,如图卷积网络(GCN)和图注意力网络(GAT),并没有充分利用边缘特征,尤其是多维边缘特征。在本文中,我们为一系列新的图神经网络模型建立了一个新的框架,可以更充分地利用边缘特征,包括那些无向或多维的边缘。该框架可以对现有的图神经网络模型(如GCN和GAT)进行整合。我们提出的框架和新模型具有以下新颖之处:首先,我们建议使用图边缘特征的双重随机归一化方法,而不是目前图神经网络中常用的行或对称归一化方法。其次,我们为每一层的操作构造新的公式,使它们能够处理多维的边缘特征。第三,对于提出的新框架,边缘特征是跨网络层自适应的。第四,提出利用多维边缘特征对边缘方向进行编码。因此,我们提出的新框架和新模型能够利用丰富的图边缘信息资源。将新模型应用于多个citation network的节点分类、全图分类和多个molecular数据集的regression。与目前最先进的方法相比,即该模型取得了较好的性能,证明了在图神经网络中利用边缘特征的重要性。

网址:

http://openaccess.thecvf.com/content_CVPR_2019/papers/Gong_Exploiting_Edge_Features_for_Graph_Neural_Networks_CVPR_2019_paper.pdf

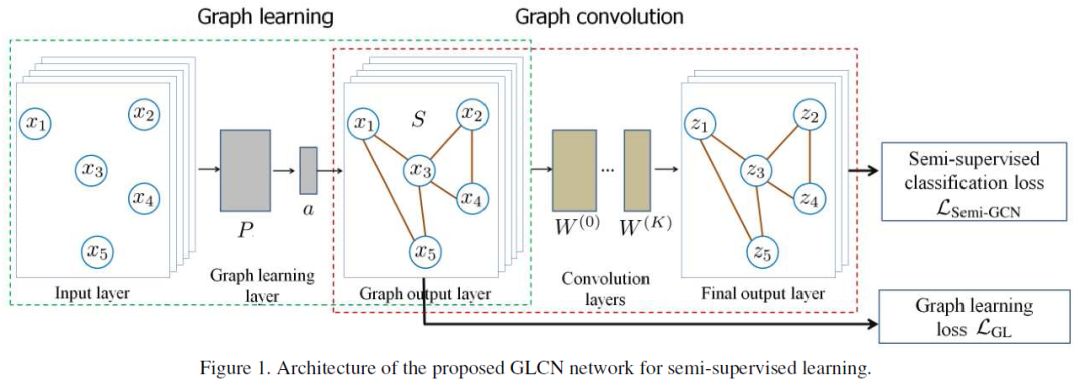

4、Semi-supervised Learning with Graph Learning-Convolutional Networks(图学习卷积网络的半监督学习)

CVPR ’19

作者:Bo Jiang, Ziyan Zhang, Doudou Lin, Jin Tang, Bin Luo

摘要:图卷积神经网络(Graph Convolutional Neural network,简称graph CNNs)在图形数据表示和半监督学习任务中得到了广泛的应用。然而,现有的图神经网络一般使用固定的图,对于半监督学习任务可能不是最优的。本文提出了一种新的Graph Learning-Convolutional Network (GLCN),用于图数据表示和半监督学习。GLCN的目标是通过将图学习和图卷积结合在一个统一的网络结构中,学习一种最优的图结构,用于半监督学习表示。其主要优点是,在GLCN中,给定的标签和估计的标签都被合并在一起,从而可以提供有用的“弱”监督信息来细化(或学习)图的构造,也便于对未知标签估计进行图卷积运算。在7个baseline上的实验结果表明,GLCN的性能明显优于传统的基于固定结构的graph CNNs。

网址:

http://openaccess.thecvf.com/content_CVPR_2019/papers/Jiang_Semi-Supervised_Learning_With_Graph_Learning-Convolutional_Networks_CVPR_2019_paper.pdf

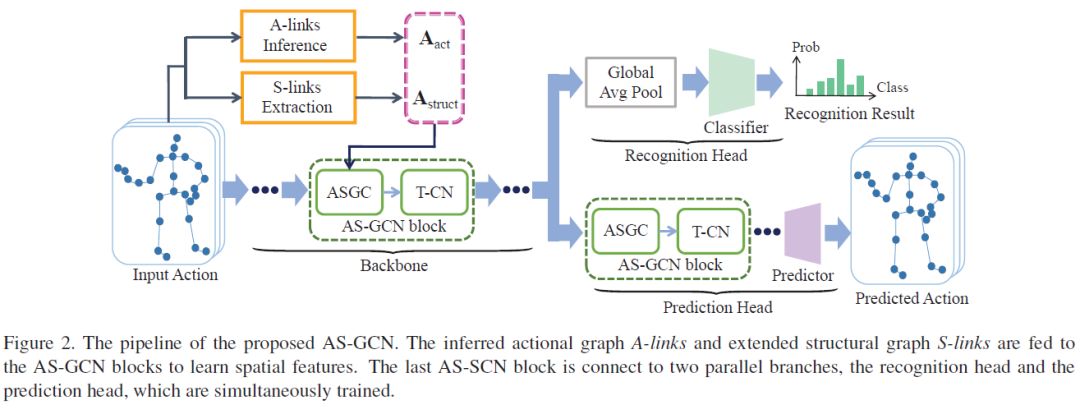

5、 Actional-Structural Graph Convolutional Networks for Skeleton-based Action Recognition(基于Actional-Structural图卷积网络的行为识别)

CVPR ’19

作者:Maosen Li, Siheng Chen, Xu Chen, Ya Zhang, Yanfeng Wang, Qi Tian

摘要:利用skeleton数据进行动作识别是近年来计算机视觉领域的研究热点。以往的研究大多基于固定的skeleton图,只捕捉关节之间的局部物理依赖关系,可能忽略了关节间的隐式关联。为了捕获更丰富的依赖关系,我们引入了一种称为A-link推理模块的编解码器结构,以直接从动作捕获特定于动作的潜在依赖关系,即动作链接。我们还扩展了现有的skeleton图来表示更高阶的依赖关系,即结构链接。将这两种类型的链接结合成一个广义的skeleton图,进一步提出了Actional-Structural Graph Convolutional Networks (AS-GCN),它将动作结构图卷积和时间卷积作为基本的构建块,学习动作识别的时空特征。在recognition head的基础上,增加了一个future pose prediction head,通过自监督来帮助捕获更详细的动作模式。我们使用两个skeleton数据集,NTURGB+D和Kinetics来验证AS-GCN在动作识别中的有效性。与最先进的方法相比,提出的AS-GCN实现了持续的较大改进。AS-GCN作为一种副产品,在未来的姿势预测中也显示出良好的应用前景。

网址:

https://arxiv.org/abs/1904.12659

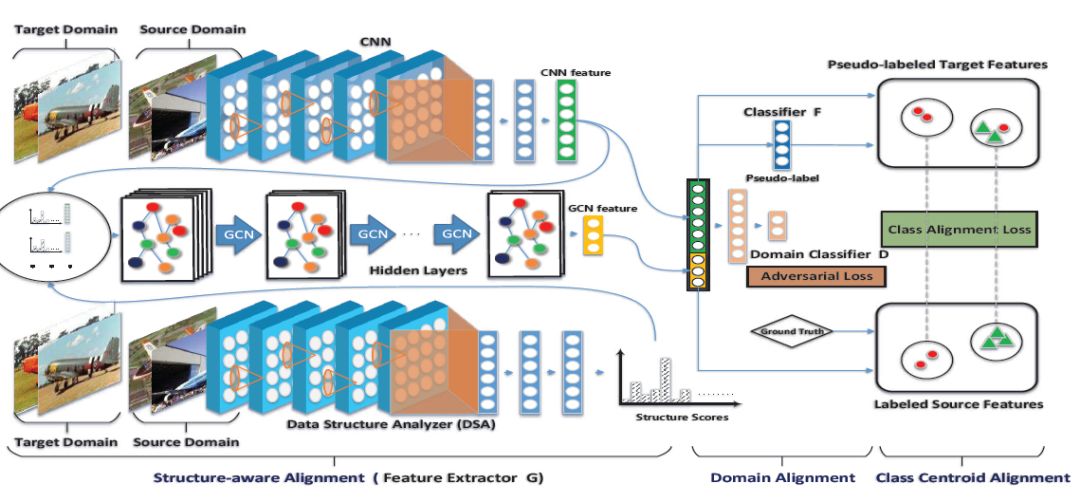

6、GCAN: Graph Convolutional Adversarial Network for Unsupervised Domain Adaptation(GCAN: 用于无监督域自适应的图卷积对抗网络)

CVPR ’19

作者:Xinhong Ma, Tianzhu Zhang, Changsheng Xu

摘要:为了在源域和目标域之间架起桥梁进行域适应,有三种重要的信息类型:数据结构、域标签和类标签。现有的域适应方法大多只利用一种或两种类型的上述信息,不能使它们相互补充和增强。与现有的方法不同,我们提出了一种端到端图卷积对抗网络(GCAN),通过在统一的深度模型中对数据结构、域标签和类标签进行联合建模,实现无监督域自适应。我们提出的GCAN模型有几个优点。首先,据我们所知,这是第一次将这三种信息联合建模到一个用于无监督域自适应的深度模型中。其次,该模型设计了structure-aware alignment、domain alignment和class centroid alignment三种有效的alignment机制,能够有效地学习域不变和语义表示,减少域间的差异,进行域自适应。在五个标准benchmark上的大量实验结果表明,该算法具有良好的性能并且可以对抗目前最先进的无监督域自适应方法。

网址:

http://openaccess.thecvf.com/content_CVPR_2019/papers/Ma_GCAN_Graph_Convolutional_Adversarial_Network_for_Unsupervised_Domain_Adaptation_CVPR_2019_paper.pdf

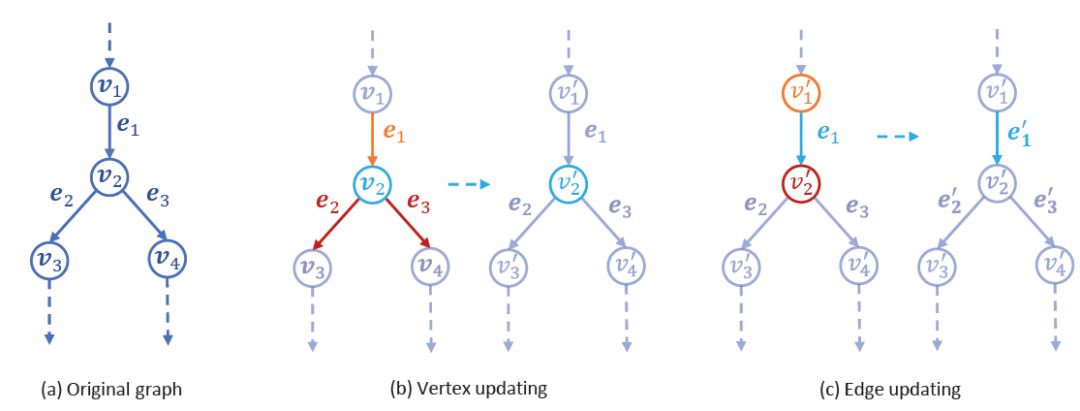

7、Skeleton-Based Action Recognition with Directed Graph Neural Networks(基于skeleton的有向图神经网络动作识别)

CVPR ’19

作者:Lei Shi, Yifan Zhang, Jian Cheng, Hanqing Lu

摘要:由于skeleton数据能较好地适应动态环境和复杂背景,在动作识别任务中得到了广泛的应用。在现有的方法中,skeleton数据中的关节和骨骼信息都被证明对动作识别任务有很大的帮助。然而,如何结合这两种类型的数据,最好地利用关节和骨骼之间的关系仍然是一个有待解决的问题。在这项工作中,我们将skeleton数据表示为一个有向无环图(DAG),基于人体关节和骨骼之间的运动依赖性。设计了一种新的有向图神经网络,用于提取关节、骨骼及其相互关系的信息,并根据提取的特征进行预测。此外,为了更好地拟合动作识别任务,在训练过程的基础上对图的拓扑结构进行自适应处理,取得了显著的改善。此外,利用skeleton序列的运动信息与空间信息相结合,进一步提高了two-stream框架的性能。我们的最终模型在两个大型数据集上进行了测试,NTU-RGBD和Skeleton-Kinetics,并在这两个数据集上都超过了最先进的方法。

网址:

http://openaccess.thecvf.com/content_CVPR_2019/papers/Shi_Skeleton-Based_Action_Recognition_With_Directed_Graph_Neural_Networks_CVPR_2019_paper.pdf

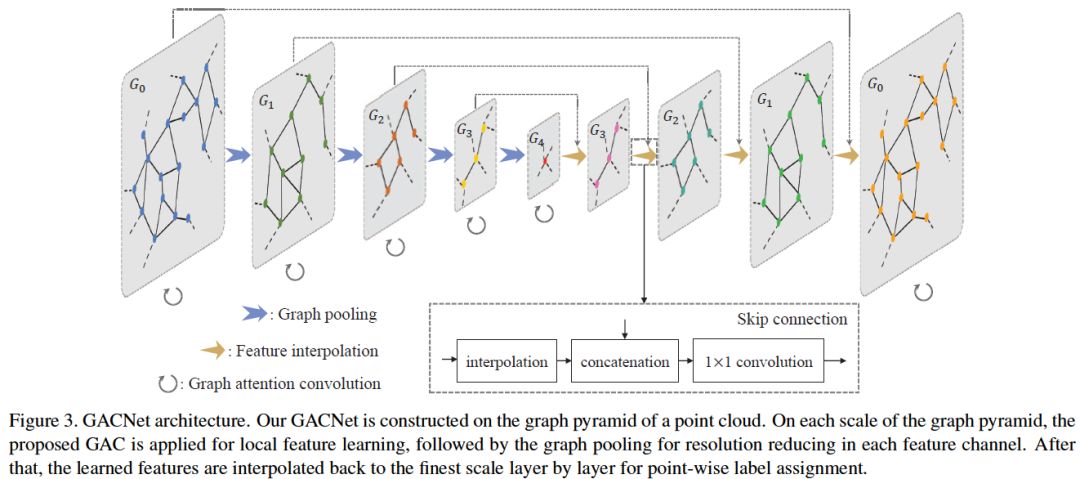

8、 Graph Attention Convolution for Point Cloud Semantic Segmentation(图注意力卷积用于点云语义分割)

CVPR ’19

作者:Lei Wang, Yuchun Huang, Yaolin Hou, Shenman Zhang, Jie Shan

摘要:由于点云特征的各向同性,标准卷积在点云语义分割中存在固有的局限性。它忽略了目标的结构,导致分割结果中poor object delineation和small spurious regions。本文提出了一种新的图注意力卷积(GAC)算法,其内核可以动态地雕刻成特定的形状以适应对象的结构。具体来说,GAC通过给不同的相邻点分配适当的注意力权重,根据它们动态学习的特点,有选择地聚焦于最相关的部分。卷积核的形状是由学习到的注意力权值分布决定的。GAC虽然简单,但是可以捕捉点云的结构化特征,进行细粒度分割,避免了对象之间的特征污染。从理论上讲,我们对GAC的表达能力进行了深入的分析,以展示它是如何学习点云的特征的。在经验上,我们在具有挑战性的indoor 和outdoor数据集上评估了提出的GAC,并都取得了最先进的结果。

网址:

https://engineering.purdue.edu/~jshan/publications/2018/Lei%20Wang%20Graph%20Attention%20Convolution%20for%20Point%20Cloud%20Segmentation%20CVPR2019.pdf

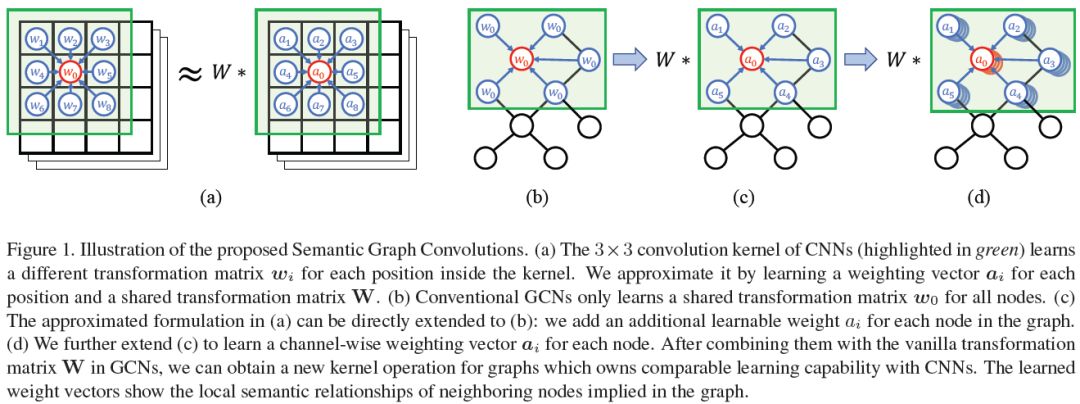

9、Semantic Graph Convolutional Networks for 3D Human Pose Regression(三维人体姿态回归的语义图卷积网络)

CVPR ’19

作者:Long Zhao, Xi Peng, Yu Tian, Mubbasir Kapadia, Dimitris N. Metaxas

摘要:本文研究了学习图卷积网络(GCNs)回归问题。目前GCNs的结构局限于卷积滤波器的小接收域和每个节点的共享变换矩阵。为了解决这些局限性,我们提出了语义图卷积网络(SemGCN),这是一种新型的神经网络结构,用于处理具有图结构数据的回归任务。SemGCN学习捕获语义信息,例如局部和全局节点关系,这些信息在图中没有显式表示。这些语义关系可以通过端到端训练从基本事实中学习,而不需要额外的监督或手工编写的规则。我们进一步研究了SemGCN在三维人体姿态回归中的应用。我们的公式是直观和充分的,因为二维和三维人体姿态都可以表示为编码人体骨骼中关节之间关系的结构化图形。我们进行了全面的研究来验证我们的方法。结果表明,SemGCN在使用的参数减少了90%的情况下,性能仍优于现有的技术水平。

网址:

https://arxiv.org/abs/1904.03345

代码链接:

https://github.com/garyzhao/SemGCN

请关注专知公众号(点击上方蓝色专知关注)

后台回复“CVPR2019GNN2” 就可以获取《九篇论文》的下载链接~

-END-

专 · 知

专知,专业可信的人工智能知识分发,让认知协作更快更好!欢迎登录www.zhuanzhi.ai,注册登录专知,获取更多AI知识资料!

欢迎微信扫一扫加入专知人工智能知识星球群,获取最新AI专业干货知识教程视频资料和与专家交流咨询!

请加专知小助手微信(扫一扫如下二维码添加),加入专知人工智能主题群,咨询技术商务合作~

专知《深度学习:算法到实战》课程全部完成!550+位同学在学习,现在报名,限时优惠!网易云课堂人工智能畅销榜首位!

点击“阅读原文”,了解报名专知《深度学习:算法到实战》课程