模型融合是机器学习社区中的一种高效赋能技术,它不需要收集原始训练数据,也不需要昂贵的计算。随着模型融合在各个领域中变得越来越普遍,全面了解现有的模型融合技术变得至关重要。然而,文献中在系统且深入地审视这些技术方面存在显著的空白。本综述提供了对模型融合方法和理论的全面概述,涵盖了它们在各个领域和场景中的应用,以及未来的研究方向。具体而言,我们首先提出了一种新的分类方法,对现有的模型融合方法进行了详尽的讨论。其次,我们讨论了模型融合技术在大语言模型、多模态大语言模型以及10多个机器学习子领域中的应用,包括持续学习、多任务学习、少样本学习等。最后,我们强调了模型融合的剩余挑战,并讨论了未来的研究方向。关于模型融合的论文完整列表请参见\url{this https URL}。

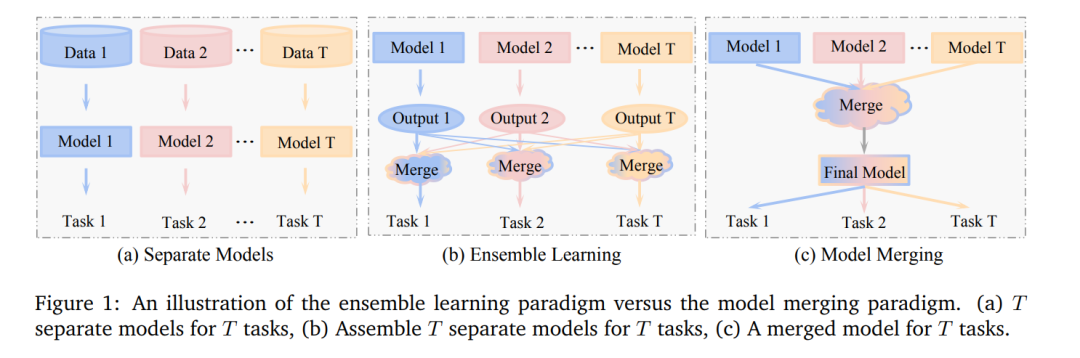

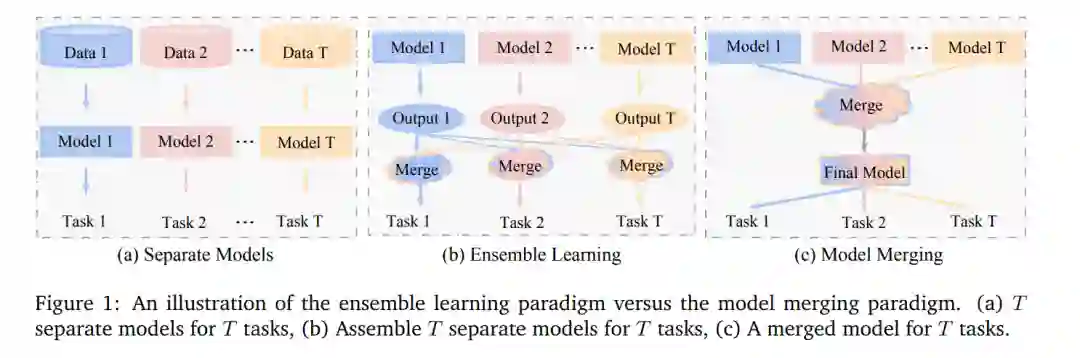

模型融合,也称为模型合并,是一种有效的技术,通过融合多个具有不同能力的独立模型的参数,构建一个通用模型,而无需访问原始训练数据或进行昂贵的计算。与模型融合最相关的概念是集成学习 [33, 109, 142, 180],因为它们都促进了知识的融合与传递。如图1所示,它们之间的主要区别在于,集成学习必须保存所有的单个模型,并在推理阶段融合多个模型的预测(或输出),而模型融合则直接在参数层面进行合并,并且在推理时只有一个最终模型。这使得模型融合具备了更为吸引人的特性。尽管模型融合是一个相对年轻的课题,但它正在快速发展,并且已经在多个领域中找到了应用。例如,在基础模型中,由不同下游任务微调的模型被合并,以增强大语言模型的能力,而具有不同风格的图像生成模型被合并,以创建具有混合风格能力的新模型。特别是,近年来机器学习社区中的预训练和微调检查点数量呈指数级增长,包括开源库如Huggingface [182]、torchvision [111]和timm [181],这使得用户可以轻松获取各种能力的训练良好的专家模型。这些丰富的模型库进一步推动了模型融合方向的快速发展。随着模型融合在机器学习社区的各个领域中变得越来越流行,全面了解现有模型融合技术的优势和局限性及其在不同领域的应用变得至关重要。尽管社区已经做出了一些努力 [48, 96, 157, 214],但仍有许多空白需要填补。更具体地说,MergeKit [48]和FusionBench [157]是技术报告,MergeKit中仅讨论了七种代表性方法,FusionBench中讨论了八种合并方法。此外,Zheng等人 [214] 讨论了“从模型中学习”的话题,并且仅在整个论文中以一个子节(一页)提到了模型融合。与“模型融合”主题最相关的工作是 [96],但在应用方面,它只讨论了模型融合在联邦学习、微调和蒸馏三种场景中的应用。由于模型融合方向的快速发展,它也忽略了许多最近发表的文章。为了解决这些空白,本综述旨在阐明模型融合方向中的方法、理论、应用和未来趋势,提供相关方法的全面分类。特别是,本文通过涵盖三个主要方面来增强对模型融合的全面理解:

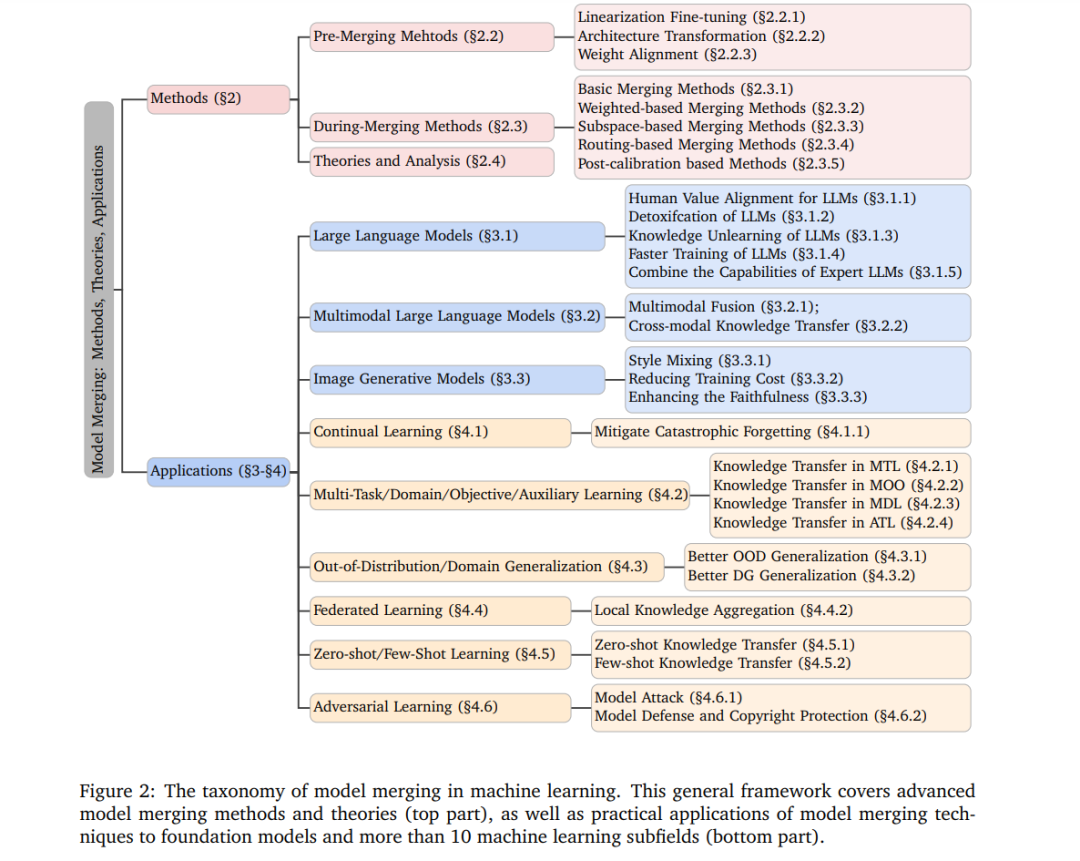

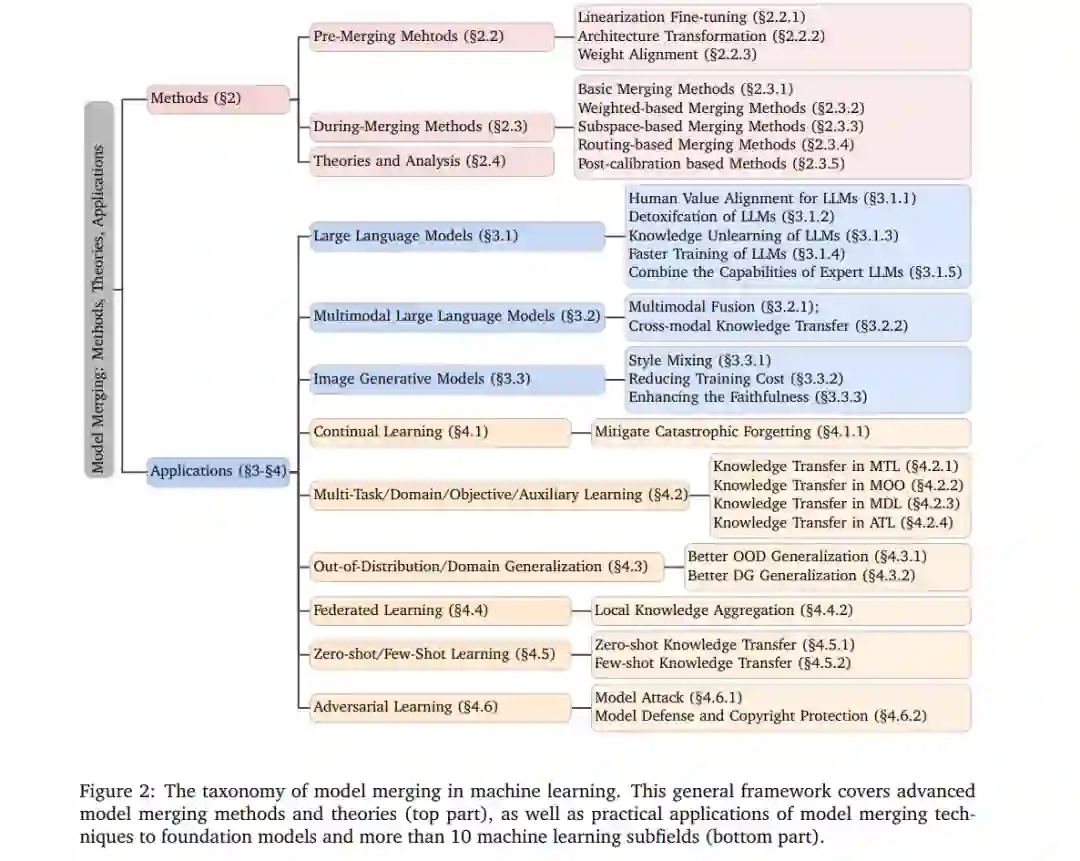

**首先,现有的模型融合方法是如何分类的?**我们首先在图2(上半部分)中提出了一个新的分类法,将现有的模型融合方法分为两个阶段(§2):预融合和融合过程中。(i)预融合方法旨在为融合创造更好的条件。它进一步分为使用线性微调实现权重空间和输入空间的解耦,执行架构转换以将异构模型转换为同质模型,以及对齐权重以将它们置于同一盆地。(ii)融合过程中的方法侧重于设计复杂的技术,将多个模型融合为一个。这些方法解决了在融合模型时的任务冲突和干扰问题。它们可以进一步分为基本融合方法,即执行最简单的参数融合策略;加权融合方法,即根据特定规则计算的重要性来融合多个模型;子空间融合方法,即将多个模型投影到稀疏子空间进行融合;基于路由的方法,即在推理过程中根据输入样本动态融合模型;以及基于后校准的方法,即对融合后的模型进行校正。除了这些方法外,我们还讨论了模型融合的理论或实证分析。

**其次,哪些应用可以从模型融合中受益?**我们详细讨论了模型融合在基础模型(§3)和机器学习的十多个子领域(§4)中的各种用例。如图2(下半部分)所示,模型融合可以应用于多种基础模型,包括大语言模型、多模态大语言模型和图像生成模型。例如,模型融合在大语言模型中可以帮助减轻不真实和有害输出,实现知识去学习,并加速训练。此外,模型融合还出现在不同的机器学习子领域,如持续学习、多任务/多域学习、少样本学习和其他子领域,以解决各种挑战。例如,在持续学习中,模型融合可以减轻旧任务的灾难性遗忘。在多任务学习、多目标学习和多域学习中,它促进了知识传递。此外,在对抗性学习中,模型融合可以用于攻击和防御策略。**第三,模型融合的剩余挑战和未来研究机遇是什么?**尽管融合方法取得了进展并且应用已经得到了充分发展,但该领域仍存在许多未解决的挑战和未来的研究方向(§5)。例如,随着任务数量的增加,现有方法与独立专家模型之间的性能差距显著扩大。此外,当前的模型融合方法在融合过程中产生了巨大的内存成本,并且缺乏信任保证以及深入的理论分析。解决这些空白需要研究人员做出大量努力,以进一步推动该领域的蓬勃发展。

总而言之,本文的主要贡献包括以下三个方面: • 方法概述:我们提供了对模型融合技术方面的全面总结。具体而言,我们提出了一个新的分类法,将现有的模型融合方法分为两个阶段,并根据关键技术进一步细分每个阶段的方法。此外,我们还讨论了与模型融合相关的理论分析工作。 • 应用概述:我们提供了对模型融合应用方面的全面总结。具体而言,我们探索了模型融合在基础模型和10多个机器学习子领域中的应用,展示了模型融合如何解决这些领域中的现有挑战。 • 未来方向:我们概述了模型融合的几个剩余挑战和未来方向。我们认为,未来需要从性能差距、理论分析、信任保证、跨学科应用等方面进一步探索模型融合。 本文的主要结构如下:§1是介绍,§2从技术角度对高级模型融合方法进行了全面讨论。在§3和§4中,我们分别总结了模型融合在各种基础模型和机器学习不同子领域中的应用。剩余的挑战和未来的研究方向在§5中讨论。最后,我们在§6中对本文进行了总结。

高级模型融合方法

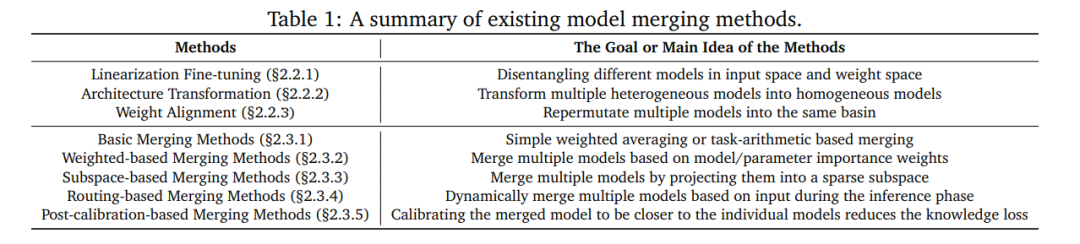

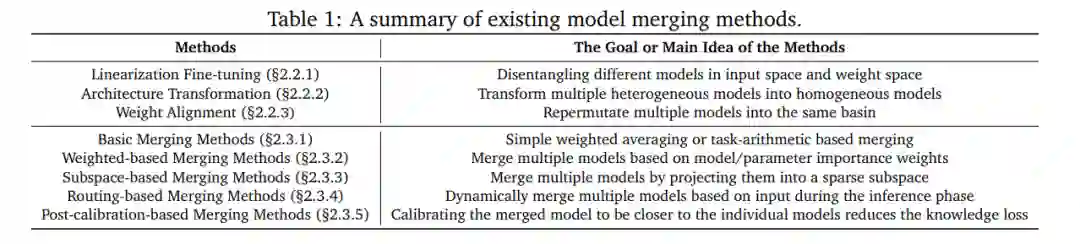

在本节中,我们首先在§2.1中介绍模型融合的符号表示和问题定义。然后,我们详细阐述了高级模型融合方法(表1总结了每类方法的主要目的)。现有的模型融合技术大致可以分为以下两类: (i) 融合前方法 在§2.2中:为模型融合提供更好的先验知识。 (ii) 融合过程中方法 在§2.3中:通过各种策略解决任务冲突/干扰,然后执行参数融合操作。最后,我们在§2.4中总结了模型融合有效性的理论或解释。

模型融合在基础模型中的应用

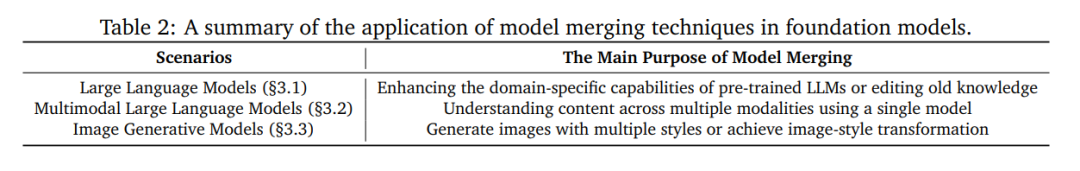

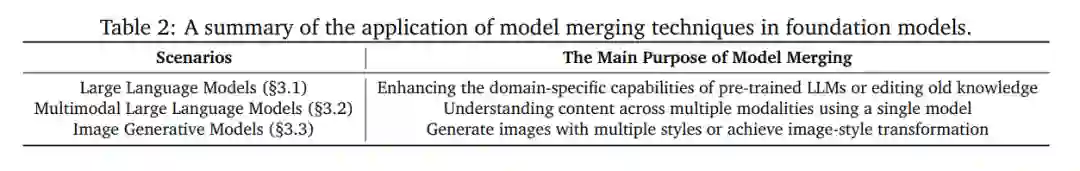

基础模型的出现,包括大语言模型(LLM)、多模态大语言模型(MLLM)和图像生成模型,是近年来人工智能领域技术进步的重要标志。然而,尽管这些大型模型取得了显著进展,但它们仍面临诸多挑战,如LLM生成有害内容、MLLM在融合不同模态信息时的困难,以及图像生成模型在生成混合风格图像时的难度。最新研究表明,模型融合技术为这些基础模型中固有的挑战提供了一个有前景的解决方案。表2首先简要总结了模型融合在基础模型中的应用。然后,§3.1、§3.2和§3.3分别详细讨论了LLM、MLLM和图像生成模型如何从模型融合中受益。

模型融合在不同机器学习子领域的应用

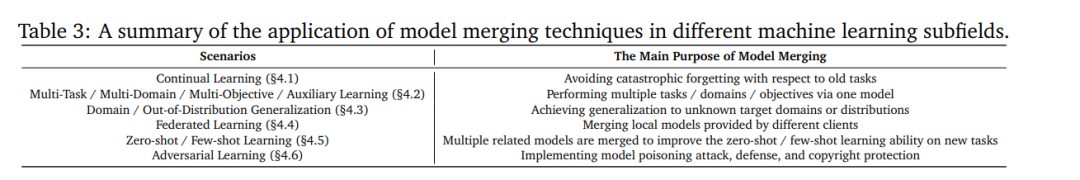

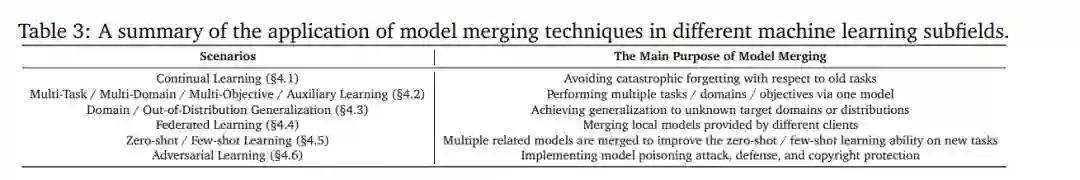

模型融合是一种简单而有效的技术,广泛应用于机器学习的各个子领域,如持续学习、多任务学习、领域泛化、联邦学习、少样本学习和对抗性防御等。在本节中,我们将全面讨论模型融合在不同机器学习子领域中的应用。表3提供了简要总结,§4.1至§4.6中详细介绍了每个应用案例。

结论

模型融合是一种简单而有效的模型增强技术,通过结合多个模型来实现多样化的能力。在本综述中,我们首先全面概述了当前在模型融合领域可用的高级方法和理论。接下来,我们讨论了模型融合技术在各种基础模型(如LLM、MLLM)和机器学习的十多个子领域中的应用,强调了它们在解决各种挑战和困难中的作用。最后,我们识别了模型融合领域中尚存的问题,并提出了六个值得进一步探索的研究方向。我们相信,作为一种高效且模块化的模型赋能解决方案,模型融合技术将在未来的更多实际场景中发挥重要作用。