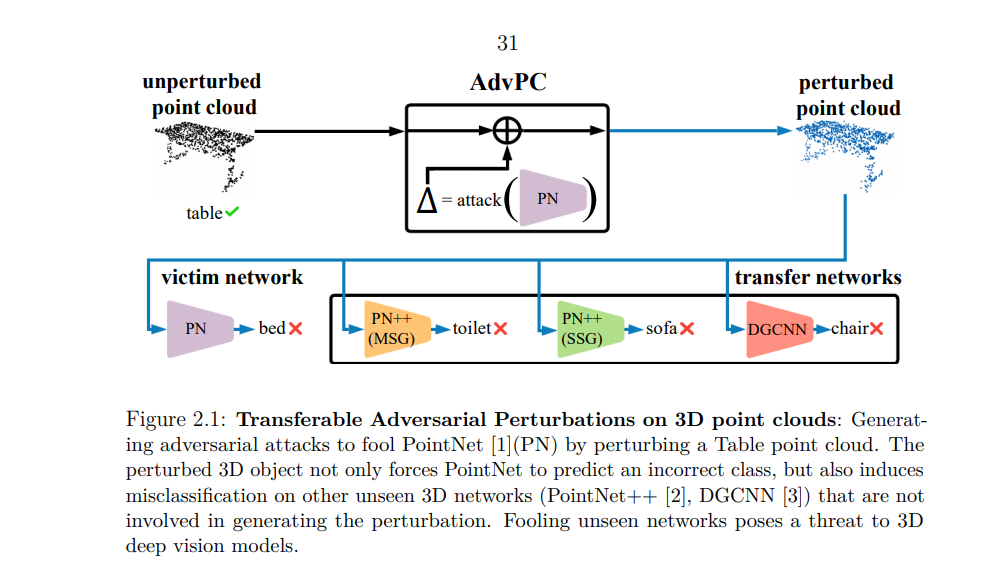

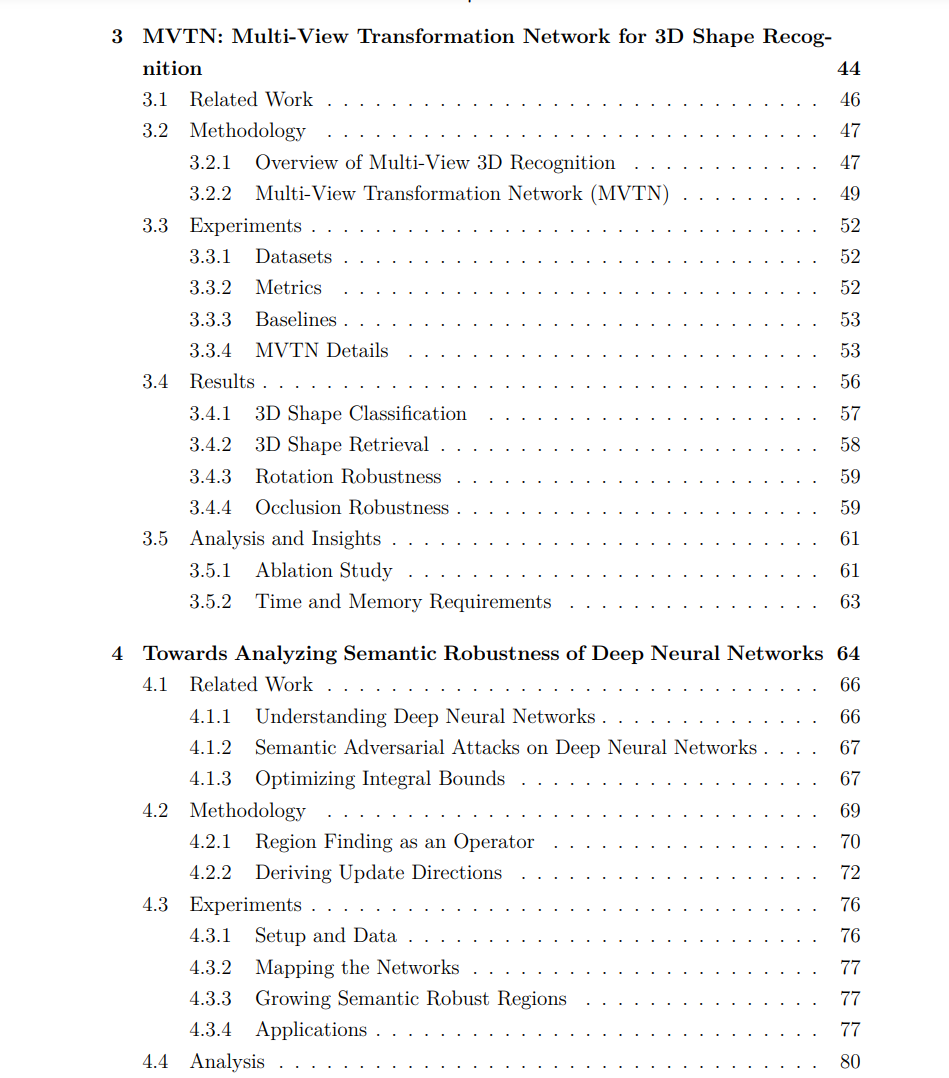

这篇论文提出了一些新颖的方法,用于解决深度神经网络(DNNs)在3D理解和3D设置方面的鲁棒性面临的重要挑战。我们的研究主要集中在两个方面:3D数据和设置的对抗鲁棒性以及DNNs在现实3D场景下的鲁棒性。一个3D理解范式是将3D表示为一组3D点,并直接在这组点上学习函数。我们的第一个工作,AdvPC,解决了当前3D点云对抗攻击的有限可迁移性和防御易用性问题。通过使用点云自动编码器生成更具可迁移性的攻击,AdvPC在3D点云攻击可迁移性方面大幅领先于当前的最先进攻击。此外,与ModelNet40数据集上的其他基准攻击相比,AdvPC增加了破坏防御能力高达38%。另一个3D理解范式是对3D数据的多个图像进行2D处理。第二项工作,MVTN,通过使用多视图转换网络(MVTN)来学习最优视点,解决了选择3D形状识别视点的问题。它将MVTN与多视图方法相结合,在标准基准ModelNet40、ShapeNet Core55和ScanObjectNN上取得了最先进的结果。MVTN还提高了对现实场景(如旋转和遮挡)的鲁棒性。

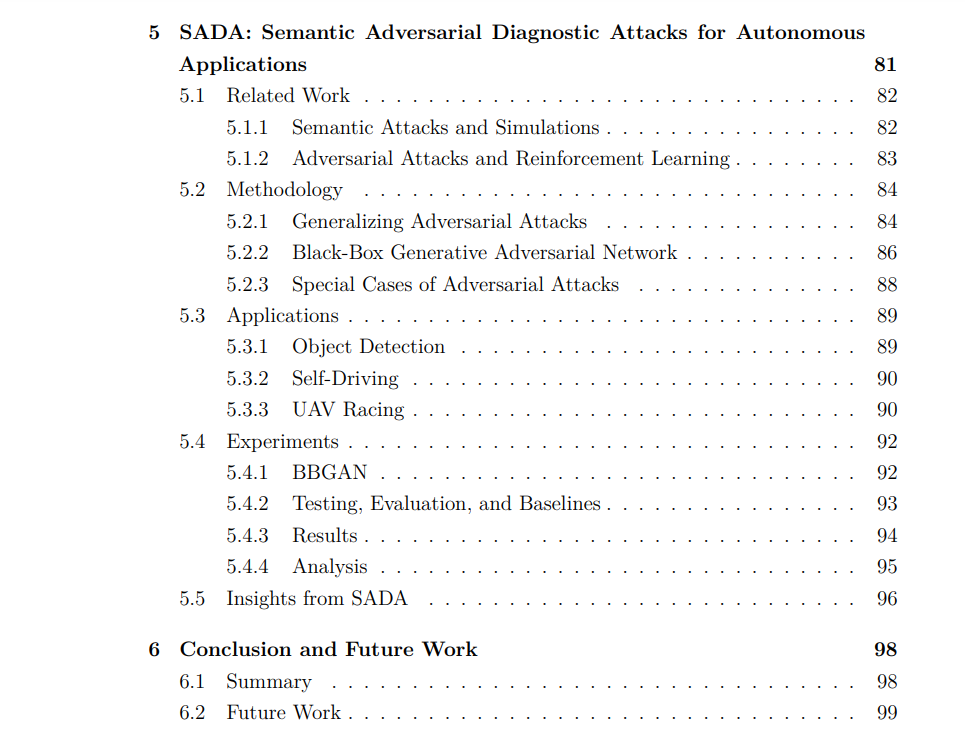

我们的第三项工作分析了二维深度神经网络的语义鲁棒性,通过将DNN全局行为可视化为语义映射并观察一些DNNs的有趣行为,解决了DNNs对语义原语高度敏感的问题。此外,我们开发了一种自下而上的方法来检测DNNs的鲁棒区域,以实现可扩展的语义鲁棒性分析和不同DNNs的基准测试。第四项工作SADA展示了DNNs在自主导航的安全关键应用方面缺乏鲁棒性的问题,超出了简单的分类设置。我们提出了一个通用框架(BBGAN),用于对受过训练的代理进行黑盒对抗攻击,涵盖了对执行任务的代理环境的语义扰动。BBGAN经过训练,可以生成在诸如物体检测、自动驾驶和自主无人机竞速等任务上始终欺骗受过训练的代理的失败案例。

https://repository.kaust.edu.sa/handle/10754/691198