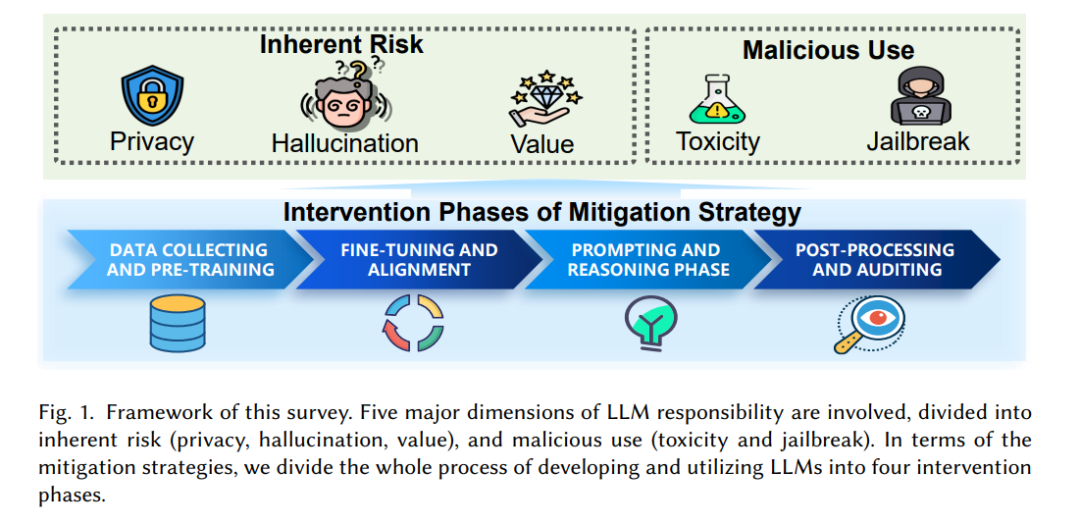

尽管大型语言模型(LLMs)在支持众多现实世界应用和带来积极社会影响方面展现出巨大潜力,但它们在隐私泄露、幻觉输出、价值不一致等固有风险方面仍面临重大挑战,并且在被破解后可能被恶意用于生成有害内容和不道德目的。因此,在本综述中,我们提供了一份全面回顾,旨在减轻这些问题的最新进展,并按照LLM开发和使用的四个阶段进行组织:数据收集与预训练、微调与对齐、提示与推理,以及后处理与审计。我们详细阐述了近年来在隐私保护、幻觉减少、价值对齐、有害性消除和破解防御方面增强LLM性能的最新进展。与之前聚焦于负责任LLMs单一维度的综述不同,本综述提出了一个统一的框架,涵盖这些不同维度,为增强LLM更好地服务于现实世界应用提供了全面的视角。

附加关键词:隐私、幻觉、价值、有害性、破解。

1 引言

大型语言模型(LLMs)在自然语言处理中的卓越能力使我们更接近实现人工通用智能(AGI)。语言不仅仅是沟通的工具 [219],它在思维发展和更高级的认知过程中的基本作用也日益被认识 [198]。因此,语言处理的突破大大增强了人工智能在外部社会沟通和内部认知功能方面的能力,推动其解决现实世界挑战的潜力 [193]。因此,LLMs使得广泛的应用成为可能,从提高社会生产力到促进社会公益,例如代码生成 [122]、自主代理构建 [63, 219]、城市规划 [248]、提高临床效率 [192] 和教育效率 [92]、帮助弱势群体 [175],为构建一个人类与AI共存的良好社会铺平了道路 [165, 193]。 然而,尽管我们享受LLMs带来的便利,我们必须认识到它们可能带来的潜在危险和脆弱性。如果忽视这些问题,已经导致了诸多痛苦的教训 [52, 133]。例如,据报道,三星的员工在进行错误检查、代码优化和转录等任务时,意外地与ChatGPT分享了机密源代码和会议录音,暴露了公司的敏感商业信息 [52]。另一个著名的例子是“奶奶漏洞”,在这个漏洞中,恶意对手通过扮演奶奶的角色来引导LLMs,诱导其生成通常会受到限制的回应,例如如何制作炸弹或编写有害恶意软件的源代码 [39, 164, 249],这对社会构成了严重风险。更悲剧性的案例是,一名男子在与AI聊天机器人的六周对话中,因其鼓励自杀,最终不幸结束了自己的生命,这加剧了他的生态焦虑和自杀倾向 [133]。因此,构建负责任的LLMs至关重要,这些模型能够减轻这些潜在风险和脆弱性,并防止类似的悲剧发生。

受到这些教训的启发,许多研究人员开始关注从不同方面构建负责任的LLMs [25, 37, 145, 194, 218, 226]。其中,最深入探讨的方面是将LLMs与人类价值对齐 [8, 33, 98, 104, 119, 127, 148, 163, 171, 183, 188, 188, 218]。这些工作主要利用LLM微调技术,并结合代表性的人类价值理论所给出的价值维度,如施瓦茨的基本价值理论和道德基础理论 [173, 230]。然而,负责任的LLMs并不能仅仅通过价值对齐技术来实现。例如,幻觉输出本身并不与人类价值不一致,但会显著降低LLMs的可用性。因此,构建负责任的LLMs时应当综合考虑多个方面。同时,LLMs的危险和脆弱性不仅可能出现在生成的文本中,也可能存在于其内部机制中。例如,现有研究揭示,LLM在特定句子中的logits可能泄露私人信息 [58, 59, 132]。因此,在整个LLM生命周期中考虑潜在的危险和脆弱性,并在开发和使用LLMs的相应阶段采取缓解策略,以构建负责任的LLMs,显得尤为重要。

总体而言,我们将LLMs的潜在危险和脆弱性分为两类,即固有风险和恶意使用(见图1)。就固有风险而言,LLMs可能会暴露其用于预训练或微调的语料库中的敏感信息,从而引发隐私泄露问题 [37, 145, 226]。同时,众所周知,LLMs可能会出现幻觉现象,导致生成不准确和误导性的文本 [194]。最后,由于LLM生成文本中嵌入的价值通常直接反映了其训练数据的分布,这些数据通常来自互联网,因此LLMs可能会过度拟合于某一狭窄的价值集,甚至放大不良和不道德的内容,从而导致价值不匹配。在恶意使用方面,LLMs可能被用来生成有害内容,如仇恨言论、骚扰、网络欺凌,对人类造成伤害 [25]。此外,恶意用户可能会越狱LLMs,绕过其安全限制,进行欺诈性目的 [123, 225]。在缓解策略方面,我们将开发和使用LLMs的全过程分为四个阶段,即数据收集与预训练、微调与对齐、提示与推理、后处理与审计,并根据操作的阶段对现有研究进行分类。 在本文中,我们系统总结了近期在构建负责任LLMs方面的研究进展,涵盖了在隐私保护、幻觉减少、价值对齐、有害性消除和破解防御等方面增强LLM性能的技术。与现有的综述不同,后者主要关注单一维度以改善LLM的责任性(例如隐私 [37, 145, 226] 或幻觉 [194]),我们的综述采用统一框架,分析并比较涵盖更广泛维度的现有研究。这一全面的分析有助于我们理解这些不同维度之间的共性和差异,从而更深入地了解构建负责任LLMs的现状和未来方向。 本综述的结构如下:第二节回顾与负责任LLMs相关的现有综述,并对比它们与本文的主要区别;第三节正式介绍并比较构成LLM准备和应用过程的四个阶段;接下来的第四至第八节分别详细介绍现有研究在隐私保护、幻觉减少、价值对齐、有害性消除和破解防御方面的成果;最后,第九节总结负责任LLMs的开放挑战和未来方向,第十节对本文进行总结。