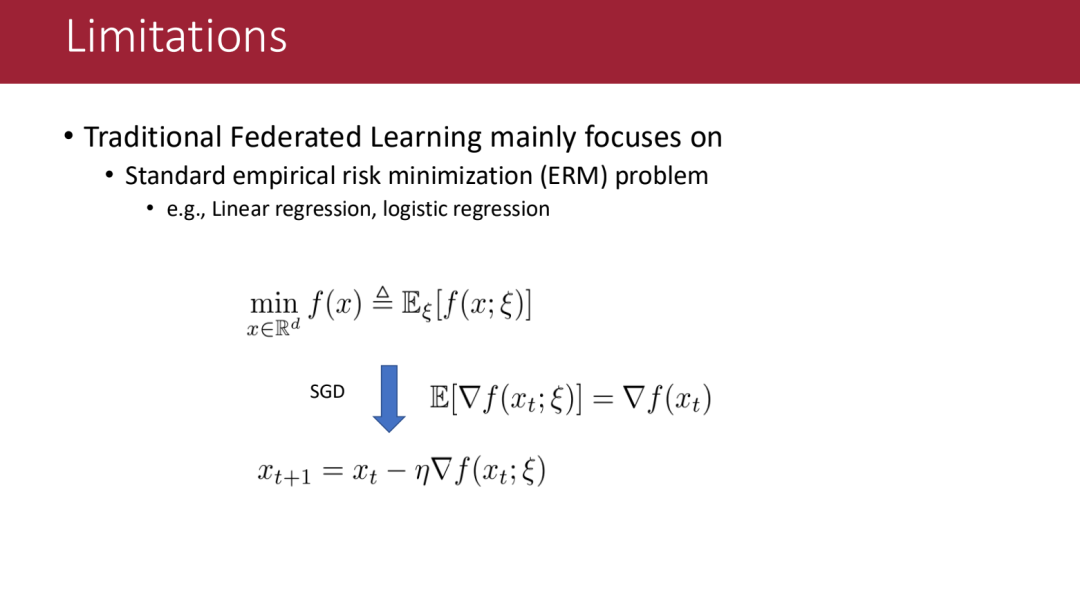

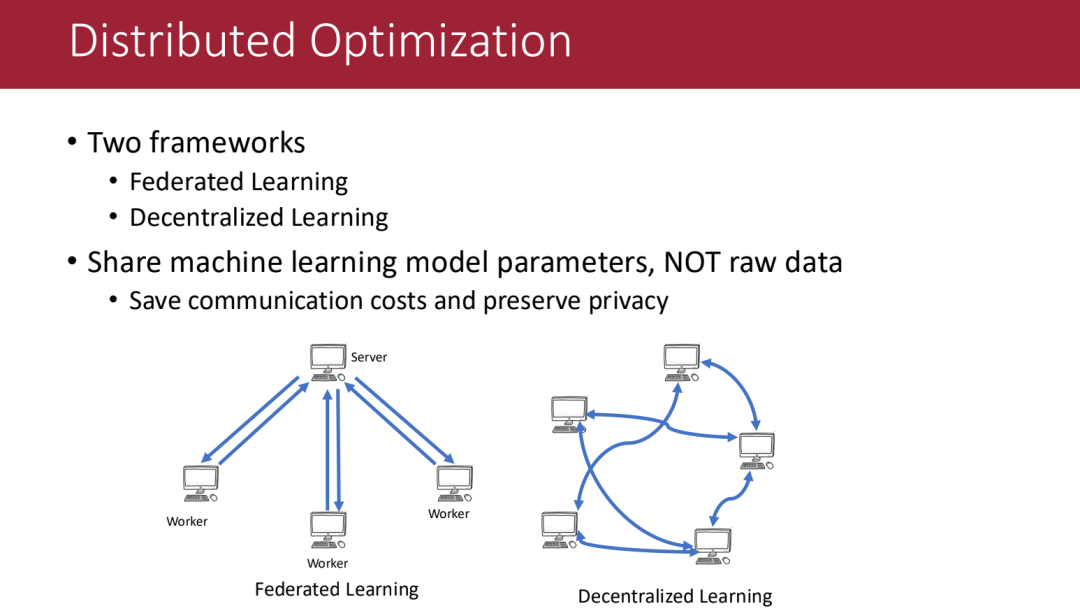

联邦学习近年来受到广泛关注,催生了大量方法。然而,大多数方法仅关注传统的最小化问题,未能解决机器学习中新兴的学习范式。因此,本教程聚焦于可以表述为随机组合优化(SCO)问题和随机双层优化(SBO)问题的学习范式,因为它们涵盖了传统最小化问题之外的各种机器学习模型,如模型无关元学习、不平衡数据分类模型、对比自监督学习模型、图神经网络、神经架构搜索等。组合结构和双层结构为联邦学习带来了独特的计算和通信挑战。为了应对这些挑战,近年来开发了一系列联邦组合优化和联邦双层优化方法。然而,这些进展并未得到广泛传播。因此,本教程旨在介绍联邦SCO和SBO的独特挑战、最新进展以及实际应用。观众将通过本教程深入了解联邦SCO和SBO算法,并学习如何将其应用于实际应用中。 https://hcgao.github.io/tutorial_ijcai2025.html

成为VIP会员查看完整内容

相关内容

Arxiv

42+阅读 · 2023年4月19日

Arxiv

217+阅读 · 2023年4月7日

Arxiv

83+阅读 · 2023年4月4日

Arxiv

147+阅读 · 2023年3月29日