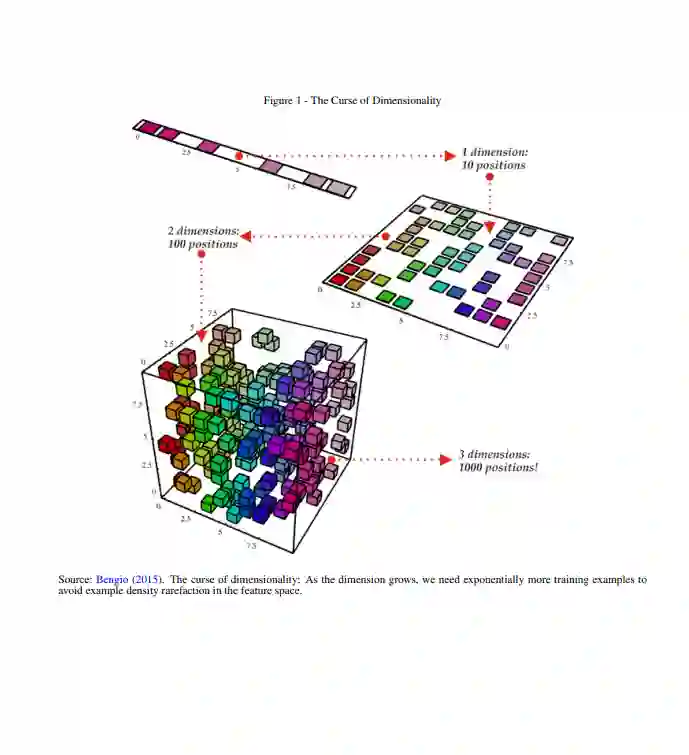

尽管深度学习取得了理论成就和令人鼓舞的实践结果,但在推理、因果推理、可解释性和可解释性等许多领域仍然存在局限性。从应用程序的角度来看,最有效的限制之一与这些系统的鲁棒性有关。事实上,目前的深度学习解决方案都没有告知它们是否能够在推理过程中对一个例子进行可靠的分类。现代神经网络通常过于自信,即使它们是错误的。因此,构建鲁棒的深度学习应用是当前计算机视觉、自然语言处理和许多其他领域的前沿研究课题。构建更可靠的深度学习解决方案最有效的方法之一是提高它们在所谓分布外检测任务中的性能,所谓分布外检测任务本质上是由“知道你不知道”或“知道未知”组成的。换句话说,当提交神经网络未训练的类实例时,具有分布外检测能力的系统可能会拒绝执行无意义的分类。本文通过提出新的损失函数和检测分数来解决目标性分布不均检测任务。不确定性估计也是构建更鲁棒的深度学习系统的关键辅助任务。因此,我们也处理这个与鲁棒性相关的任务,它评估由深度神经网络呈现的概率有多真实。为了证明我们的方法的有效性,除了大量的实验,其中包括最新的结果,我们使用基于最大熵原理的论点来建立所提出的方法的理论基础。与大多数当前的方法不同,我们的损失和得分是无缝的和有原则的解决方案,除了快速和有效的推断,还能产生准确的预测。此外,我们的方法可以并入到当前和未来的项目中,只需替换用于训练深度神经网络的损失,并计算一个快速的检测评分。

成为VIP会员查看完整内容