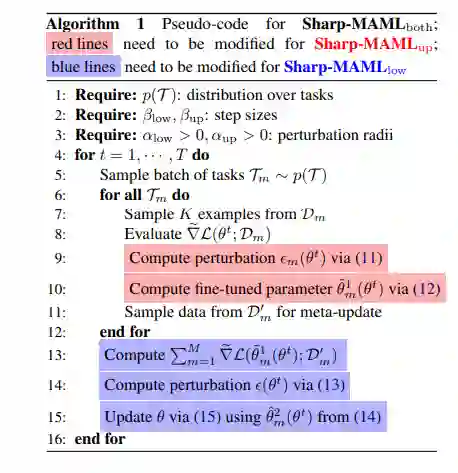

模型无关元学习(Model-agnostic meta learning, MAML)是目前小样本元学习的主流方法之一。尽管MAML是有效的,但由于MAML固有的双层问题结构,其优化具有挑战性。具体而言,MAML的损失情况比经验风险最小化方法复杂得多,可能包含更多的鞍点和局部最小化点。为了应对这一挑战,我们利用最近发明的锐度感知最小化(sharp -aware minimization)方法,提出一种锐度感知的MAML方法(Sharp-MAML)。实验结果表明,Sharp-MAML及其高效计算变体的性能优于现有主流的MAML基准(例如,在Mini-Imagenet上的准确率为+12%)。我们用收敛速度分析和Sharp-MAML的泛化界来补充实证研究。据我们所知,这是第一次在双层学习背景下对锐度感知最小化问题进行实证和理论研究。代码可以在https://github.com/mominabbass/Sharp-MAML上找到。

https://arxiv.org/abs/2206.03996

成为VIP会员查看完整内容

相关内容

Arxiv

0+阅读 · 2022年7月21日

Arxiv

21+阅读 · 2018年12月25日