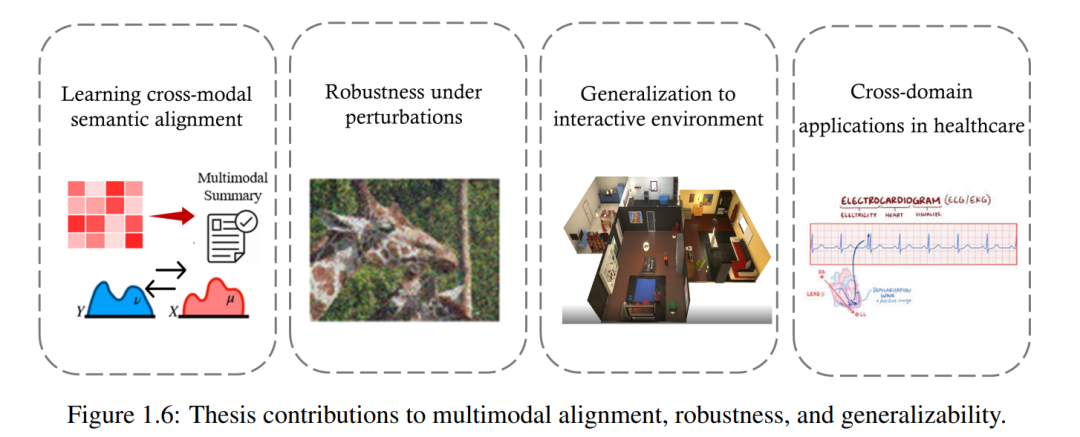

多模态智能,即AI系统可以处理和整合来自多种模态的信息,如文本、视觉、音频等,已经成为当今数据驱动时代的关键概念。这种跨模态的方法在各个行业中具有多样的应用和变革潜力。通过融合异构数据流,多模态AI生成的表示比传统的单模态技术更接近于人类智能。在本论文中,我们旨在通过关注多模态智能的三个关键维度来推动该领域的发展:多模态对齐性、鲁棒性和泛化性。通过引入新方法和方法,我们希望在实际应用中提高多模态模型的性能、鲁棒性和可解释性。本论文探讨了以下关键问题:(1) 我们如何探索不同类型数据之间的内部语义对齐?学习到的对齐如何帮助推进多模态应用?(2) 多模态模型有多鲁棒?我们如何提高模型在实际应用中的鲁棒性?(3) 我们如何将一个已学领域的知识泛化到另一个未学领域?本论文对这三个技术挑战均有贡献。首先,我们在跨模态语义对齐学习方面做出了贡献,我们探索了建立语言与图像/视频数据之间的丰富连接,重点关注多模态摘要任务。通过对齐语言的语义内容与视觉元素,所得模型可以对底层概念有更细致的理解。我们深入研究了基于最优传输的方法来学习跨域对齐,使模型能够提供其多模态推理过程的可解释解释。第二个贡献是我们开发了全面的评估指标和方法来评估多模态模型的鲁棒性。通过模拟分布转移并测量模型在不同场景下的表现,我们可以更深入地了解模型的适应性并识别潜在的脆弱性。我们还采用最优传输通过Wasserstein Geodesic扰动进行数据增强,以提高模型的鲁棒性能。第三个贡献涉及多模态系统的泛化性,重点在交互域和医疗域。在交互域中,我们开发了新的学习范式,通过结合潜在语言编码从视觉观察中学习可执行的机器人策略计划。我们还使用检索增强使视觉-语言模型能够在现实世界的实体中心VQA中识别并提供知识性答案。在医疗领域,我们通过将LLMs的知识转移到临床ECG和EEG上来弥合差距。此外,我们设计了检索系统,可以自动匹配临床医疗信号到数据库中最相似的记录,这一功能可以显著帮助诊断疾病并减轻医生的工作负担。总之,本论文通过增强对齐性、鲁棒性和泛化性,旨在推动多模态AI领域的发展,从而为更复杂和高效的多模态AI系统铺平道路。

世界充满了各种信号,如图像、视频、音频、文本、传感器信号等。人类通过多种感官如视觉、听觉、触觉等自然地感知世界。这种多模态的方法是人类认知的基本方面,并且已经成为人工智能(AI)发展的基石。在当今数据驱动的时代,多模态智能的概念日益重要。这种范式结合了各种形式的数据,如语言、视觉信息、生理信号等,以创建更全面和细致的AI系统。

尽管可用的数据丰富,但目前尚无全面的工具来分析这些数据并利用其中的模式。识别不同模态之间的模式对于利用它们来解决实际领域的特定挑战至关重要。例如:(1) 摘要和推荐:自动生成多媒体新闻摘要或提供在线视频介绍,可以显著提升搜索引擎和在线内容推荐系统的性能。例如,每分钟有超过500小时的视频上传到YouTube,其中大部分没有摘要。缺乏准确的摘要使得开发能够有效帮助用户找到所需内容的搜索引擎和推荐系统变得具有挑战性。(2) 内容创作:文本到图像生成模型经常会生成不正确、不清晰或有偏见的内容。开发更鲁棒的模型以用于实际应用是一个紧迫的问题。(3) 家用机器人:2023年,旨在帮助残障人士完成日常任务的家用机器人市场价值达103亿美元。这些机器人通过视觉感知、口头指令和语音对话等各种交互方式,提供实质性和高效的日常任务支持,利用多模态信息来增强机器人的性能和可靠性是一个复杂的挑战。(4) 医疗应用:例如,仅在急诊科诊断胸痛每年在美国的费用估计为100至120亿美元。开发一种利用多模态医疗数据提供成本效益的患者护理解决方案对社会非常有益。

本论文受这些应用的启发。论文中研究的问题是从这些应用的共同挑战中抽象出来的。接下来,我们将首先介绍一些激励性的应用,描述问题和应对挑战的一般方法。