机器之心报道 编辑:张倩优秀的 GitHub 项目啊!有关 OpenAI ο1 的一切都在这里

在 AI 领域,OpenAI 已经成了指路明灯一般的存在。随着 o1 模型的发布,全世界的 AI 工程师都开始了新一轮的学习。 为了帮助大家尽快抓住重点,机器之心一直在跟进报道相关的解读,包括:

同时,我们也发现了其他一些有用的资源,比如在一个 Github 项目中,有人汇总了最近的高质量技术解读博客以及「可能」与 o1 技术路线相关的论文。相关资源列表会一直更新,

这些博客、论文有些是大家都读过的,还有些可能被淹没在平时的众多资源中。或许从中大家可以找到复现 OpenAI o1 的有效方法。 博客

- 博客 1:Learning to Reason with LLMs

- 作者:OpenAI

- 链接:https://openai.com/index/learning-to-reason-with-llms/

博客概述:这篇博客简单介绍了 OpenAI o1 模型的训练方法,比如思维链的采用、模型安全性的提升等。详情请参见机器之心报道:《刚刚,OpenAI 震撼发布 o1 大模型!强化学习突破 LLM 推理极限》

- 博客 2:OpenAI o1-mini

- 作者:OpenAI

- 链接:https://openai.com/index/openai-o1-mini-advancing-cost-efficient-reasoning/

博客概述:这篇博客介绍了 OpenAI o1-mini 模型的概况。详情请参见机器之心报道:《刚刚,OpenAI 震撼发布 o1 大模型!强化学习突破 LLM 推理极限》

- 博客 3:Finding GPT-4’s mistakes with GPT-4

- 作者:OpenAI

- 链接:https://openai.com/index/finding-gpt4s-mistakes-with-gpt-4/

博客概述:这篇博客介绍了 CriticGPT——OpenAI 基于 GPT-4 训练的一个专门给 ChatGPT 挑毛病的新模型。它通过精准地分析 ChatGPT 的回答并提出建设性的批评,帮助人类训练师更准确地评估模型生成的代码,并识别其中的错误或潜在问题。据介绍,在 CriticGPT 的辅助下,人们审查 ChatGPT 代码的准确率提高了 60%。研究人员还发现,CriticGPT 在很多情况下比人类专家更擅长发现错误,它们甚至能在一些被认为是「完美无缺」的任务中找出问题,尽管这些任务大多数并不是代码任务,对 CriticGPT 来说有点超纲。 由于该研究发表时,Jan Leike 等 OpenAI 超级对齐团队成员已经离职,因此也被称为对齐团队「遗作」。详情请参见机器之心报道:《OpenAI 前对齐团队「遗作」:RLHF 不够用了!用 GPT-4 训练 GPT-4》

- 博客 4:Summary of what we have learned during AMA hour with the OpenAI o1 team

- 作者:Tibor Blaho

- 链接:https://twitter-thread.com/t/1834686946846597281

- 推文链接:https://x.com/btibor91/status/1834686946846597281

博客概述:最近,OpenAI o1 团队开展了一次答疑活动,这个帖子总结了答疑的概要,包括模型命名和推理范式,o1 模型的尺寸和性能,输入 token 上下文和模型能力,工具、功能和即将推出的特性,CoT 推理,API 和使用限制,定价、微调与扩展,模型开发和研究见解,提示技术和最佳实践等几个模块。每个模块的总结都比较简短,感兴趣的读者可以参见原文。

- 博客 5:OpenAI’s Strawberry, LM self-talk, inference scaling laws, and spending more on inference

- 作者:Nathan Lambert(Allen AI 研究科学家)

- 链接:https://www.interconnects.ai/p/openai-strawberry-and-inference-scaling-laws

博客概述:在文章中,作者讨论了 OpenAI 的新方法「Strawberry」及推理 scaling law,强调了推理计算的投入对 AI 能力提升的重要性。作者指出,扩大推理计算比单纯扩大模型规模更有效,类似 AlphaGo 的推理技术能够显著提升模型表现。文章呼吁未来 AI 开发要更多关注推理技术。 这篇博客发布于 9 月初,当时 OpenAI 还没有发布 o1 模型,因此现在看起来非常有前瞻性。

- 博客 6:Reverse engineering OpenAI’s o1

- 作者:Nathan Lambert(Allen AI 研究科学家)

- 链接:https://www.interconnects.ai/p/reverse-engineering-openai-o1

博客概述:这篇博客系统讨论了 OpenAI o1。o1 通过训练新模型处理长推理链,并使用大量强化学习来实现。与自回归语言模型不同,o1 在线为用户搜索答案,展示了新的 scaling law—— 推理 scaling law。博客还讨论了 o1 的一些技术细节,包括其如何使用强化学习进行训练,以及它在推理时的高成本。此外,博客还探讨了 o1 对未来 AI 领域的影响,包括它如何改变 AI 产品的部署堆栈和期望,以及它如何作为一个模型,通过不同的生成策略来实现复杂的任务。最后,博客提出了一些关于 o1 结构和功能的问题,并讨论了在开源领域复制这种系统所面临的挑战。作者还对 AI 未来的发展方向表示了期待,认为 AI 的进步将继续奖励那些敢于想象不可能很快变为可能的人。

论文

OpenAI o1 贡献者参与撰写的论文

- 论文 1:Training Verifiers to Solve Math Word Problems

- 机构:OpenAI

- 作者:Karl Cobbe, Vineet Kosaraju, Mohammad Bavarian, Mark Chen, Heewoo Jun, Lukasz Kaiser, Matthias Plappert, Jerry Tworek, Jacob Hilton, Reiichiro Nakano, Christopher Hesse, John Schulman

- 链接:https://arxiv.org/abs/2110.14168

论文概述:这篇论文发布于 2021 年 10 月。论文指出,尽管最先进的语言模型在很多任务上表现优异,但在处理多步骤数学推理时仍有困难。为了解决这个问题,作者创建了 GSM8K 数据集,包含 8500 个多样化的小学数学问题。研究发现,即使是大型 Transformer 模型也难以在这些任务上取得好成绩。为了提高性能,作者建议训练验证器来评估模型答案的正确性。通过在测试时生成多个答案并选择验证器评分最高的答案,这种方法显著提升了模型在 GSM8K 上的表现,并证明了这种方法比传统的微调方法更有效。

- 论文 2:Generative Language Modeling for Automated Theorem Proving

- 机构:OpenAI

- 作者:Stanislas Polu, Ilya Sutskever

- 链接:https://arxiv.org/abs/2009.03393

论文概述:这篇论文发布于 2020 年 9 月,Ilya Sutskever 是作者之一。论文探讨了基于 Transformer 的语言模型在自动定理证明中的应用。研究的动机是,自动定理证明器与人类相比的一个主要限制 —— 生成原创的数学术语 —— 可能可以通过语言模型的生成来解决。作者介绍了一个名为 GPT-f 的自动证明器和证明助手,用于 Metamath 形式化语言,并分析了其性能。GPT-f 发现了被 Metamath 主要库接受的新短证明,据作者所知,这是基于深度学习系统首次为形式数学社区贡献并被采纳的证明。

- 论文 3:Chain-of-Thought Prompting Elicits Reasoning in Large Language Models

- 机构:谷歌大脑

- 作者:Jason Wei, Xuezhi Wang, Dale Schuurmans, Maarten Bosma, Brian Ichter, Fei Xia, Ed Chi, Quoc Le, Denny Zhou

- 链接:https://arxiv.org/abs/2201.11903

论文概述:这篇论文发布于 2022 年 1 月。论文探讨了如何通过生成一系列中间推理步骤(即「思维链」)来显著提高大型语言模型进行复杂推理的能力。具体来说,作者提出了思维链提示的方法,即在提示中提供几个思维链的示例,以此来引导模型进行更深入的推理。实验表明,这种方法在三个大型语言模型上提高了算术、常识和符号推理任务的性能。

- 论文 4:Let's Verify Step by Step

- 机构:OpenAI

- 作者:Hunter Lightman, Vineet Kosaraju, Yura Burda, Harri Edwards, Bowen Baker, Teddy Lee, Jan Leike, John Schulman, Ilya Sutskever, Karl Cobbe

- 链接:https://arxiv.org/abs/2305.20050

论文概述:这篇论文发布于 2023 年 5 月。论文探讨了大型语言模型在复杂多步推理任务中的表现及其可靠性问题。作者比较了两种训练方法:结果监督(outcome supervision)和过程监督(process supervision),前者仅对最终结果提供反馈,后者则对每个推理步骤提供反馈。研究发现,过程监督在训练模型解决 MATH 数据集中的问题时,显著优于结果监督。具体来说,采用过程监督的模型在 MATH 测试集的一个代表性子集中解决问题的成功率为 78%。此外,论文还展示了主动学习(active learning)在提高过程监督效率方面的重要性。为了支持相关研究,作者还发布了 PRM800K 数据集,这是一个包含 800,000 个步骤级人类反馈标签的完整数据集,用于训练他们的最佳奖励模型。 由于包括 Ilya 在内的多位 o1 核心贡献者都参与了这篇论文,有人猜测这是 o1 模型训练的方法论。感兴趣的读者可以重点阅读。也可参阅机器之心的报道《OpenAI 要为 GPT-4 解决数学问题了:奖励模型指错,解题水平达到新高度》。

- 论文 5:LLM Critics Help Catch LLM Bugs

- 机构:OpenAI

- 作者:Nat McAleese, Rai Michael Pokorny, Juan Felipe Ceron Uribe, Evgenia Nitishinskaya, Maja Trebacz, Jan Leike

- 链接:https://arxiv.org/abs/2407.00215

论文概述:这篇论文发布于 2024 年 6 月。论文介绍了一种通过训练「批评者」模型(即前面提到的 CriticGPT )来提高人类评估机器学习模型输出的方法。这些批评者模型是大型语言模型,它们被训练来提供自然语言反馈,指出代码中的问题。研究表明,这些模型在识别代码错误方面比人类更有效,甚至能够发现人类审查者未发现的错误。尽管存在局限性,如可能产生误导的幻觉错误,但结合人类和机器的团队可以减少这种误导,同时保持错误检测的效率。

- 论文 6:Self-critiquing models for assisting human evaluators

- 机构:OpenAI

- 作者:William Saunders, Catherine Yeh, Jeff Wu, Steven Bills, Long Ouyang, Jonathan Ward, Jan Leike

- 链接:https://arxiv.org/pdf/2206.05802

论文概述:这篇论文发布于 2022 年 6 月。论文研究了如何通过微调大型语言模型,使用行为克隆来生成自然语言的批评性评论,以帮助人类发现摘要中的缺陷。实验表明,这些模型生成的评论能够揭示人类和机器生成摘要中的问题,包括故意误导的错误。研究发现,更大的模型在撰写有帮助的评论和自我批评方面表现更好,并且能够利用自我批评来改进自己的摘要。论文还提出了一个比较批评能力、生成能力和辨别能力的框架,并指出即使是大型模型也可能有未表达的知识。这项研究为使用人工智能辅助的人类反馈来监督机器学习系统提供了概念验证,并公开了训练数据集和实验样本。 其他论文

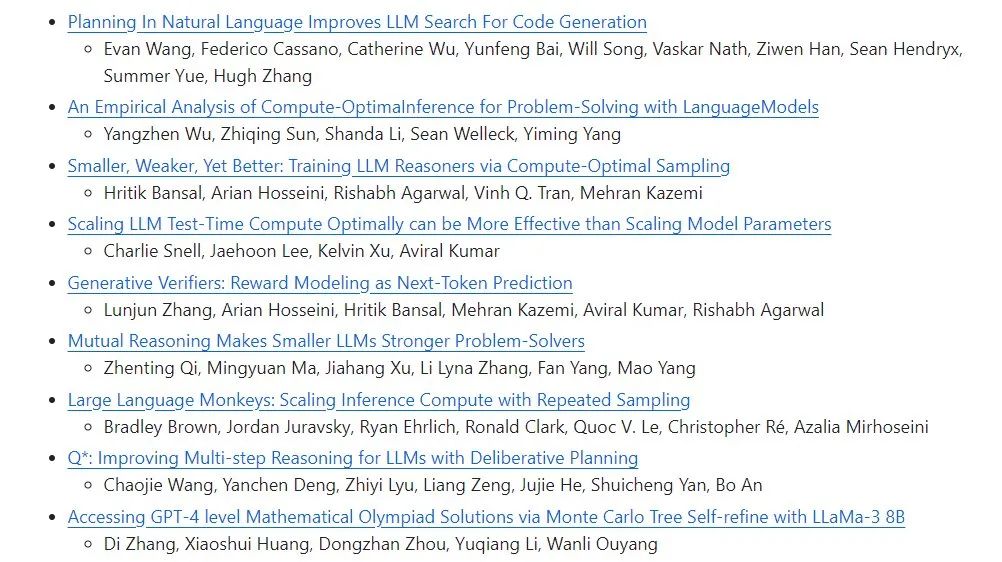

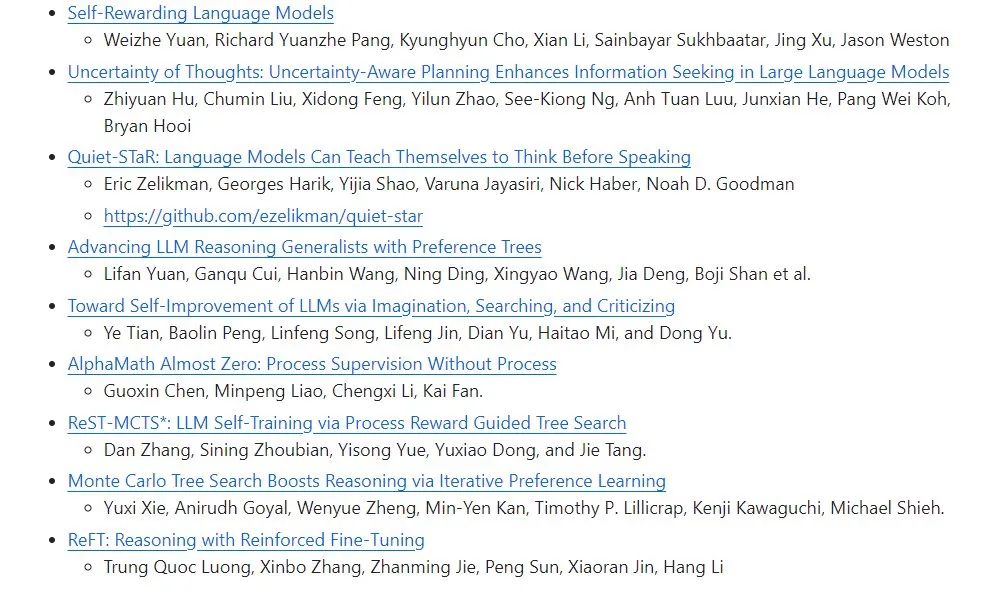

除了以上论文,作者还按照年份列出了一些可能与 OpenAI o1 相关的论文,列表如下: 2024 年:

2023 年:

2022 年:

2021 年:

2017 年:

更多信息请参见原 GitHub 库。 相关阅读:

- 刚刚,OpenAI 震撼发布 o1 大模型!强化学习突破 LLM 推理极限

- OpenAI o1 深夜炸场,核心贡献者有哪些?我们看到了大量华人的名字

- o1 改变了 Scaling 范式?Self-Play 还值得 All In 吗?

- OpenAI o1 智商 120,还是被陶哲轩称为「平庸的研究生」,但实力究竟如何?

© THE END 转载请联系本公众号获得授权 投稿或寻求报道:content@jiqizhixin.com