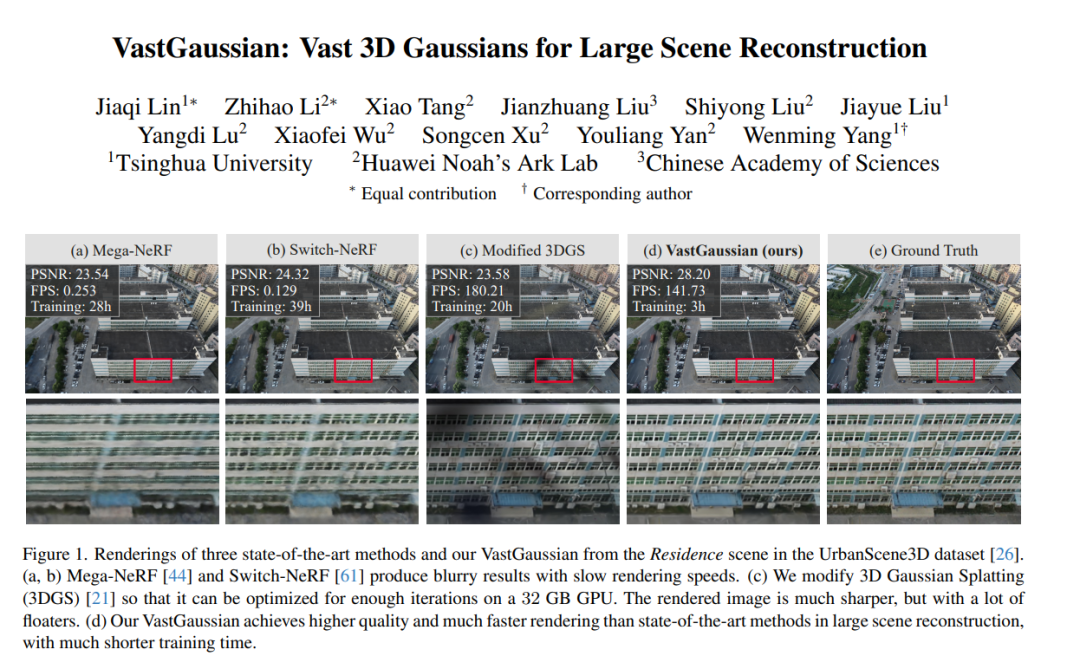

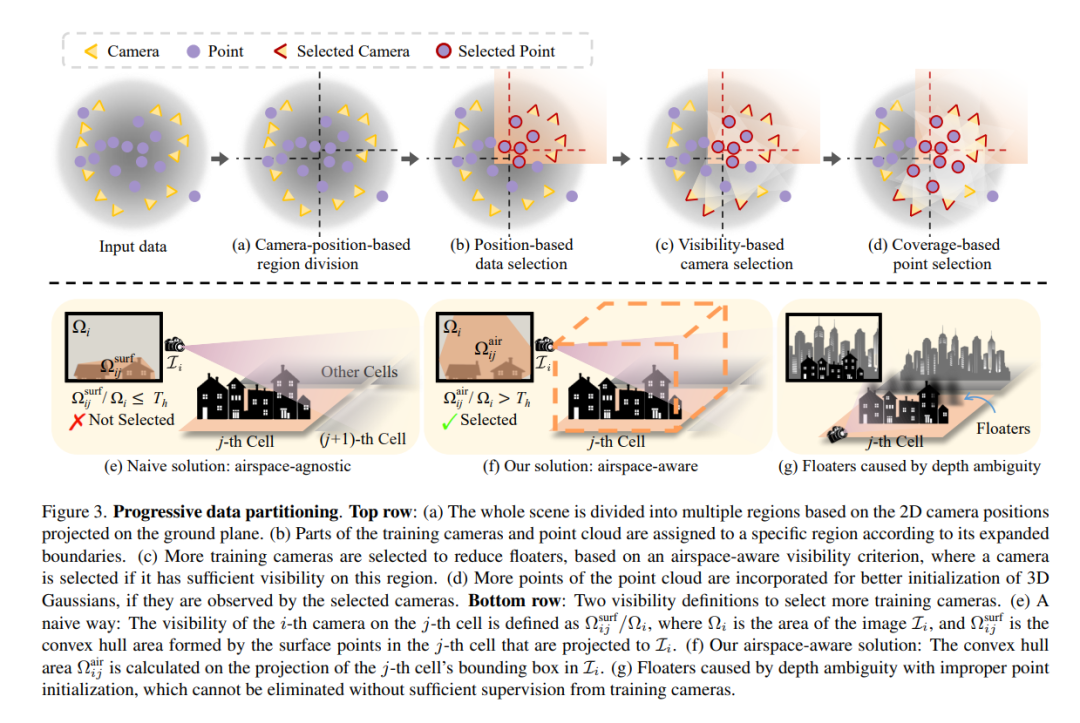

现有基于NeRF的大场景重建方法通常在视觉质量和渲染速度上有限制。虽然最近的3D高斯Splatting在小规模和以物体为中心的场景上表现良好,但将其扩展到大场景上存在挑战,因为受到视频内存有限、优化时间长和明显的外观变化的限制。为了应对这些挑战,我们提出了VastGaussian,这是第一个基于3D高斯Splatting的大场景高质量重建和实时渲染方法。我们提出了一种渐进式分割策略,将大场景分割成多个单元,其中训练相机和点云以空域感知的可见性标准适当分布。这些单元在并行优化后合并成一个完整的场景。我们还在优化过程中引入了解耦的外观建模,以减少渲染图像中的外观变化。我们的方法超越了现有的基于NeRF的方法,并在多个大场景数据集上达到了最先进的结果,实现了快速优化和高保真的实时渲染。项目页面:https://vastgaussian.github.io。

https://arxiv.org/pdf/2402.17427.pdf

成为VIP会员查看完整内容

相关内容

Arxiv

42+阅读 · 2023年4月19日

Arxiv

223+阅读 · 2023年4月7日

Arxiv

152+阅读 · 2023年3月29日