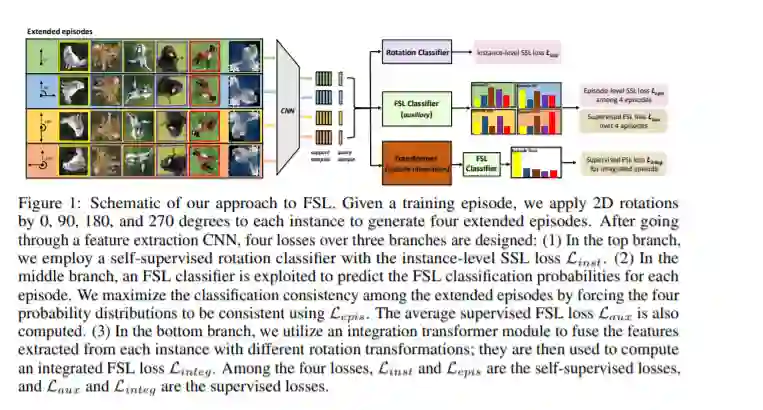

目前的深度神经网络需要为每个新任务收集大量带标签的训练数据,在一定程度上限制了其实用性。给定来自一组源任务的数据,可以使用两种迁移学习方法来克服此限制:小样本学习(FSL)和自监督学习(SSL)。前者旨在通过使用源任务设计学习场景来学习“如何学习”,以模拟用很少的带标签样本来解决目标新任务的挑战。相反,后者利用所有源任务中的无注释预定义任务来学习可泛化的特征表示。本文提出了一个创新的实例级和场景级的预定义任务(IEPT)框架,该框架无缝地将SSL集成到FSL中。具体来说,给定FSL场景,我们首先将几何变换应用于每个实例以生成扩展场景。在实例级别,按照标准的SSL执行转换识别。重要的是,在场景级别中我们设计了两个SSL-FSL混合学习目标:(1)场景级别的预定义任务,会最大限度地提高来自不同扩展场景的FSL分类预测结果之间的一致性;(2)将从每个实例中跨不同场景提取的特征进行集成,以构建用于元学习的单个FSL分类器。大量实验表明,我们提出的模型(即带有IEPT的FSL)达到了最新的技术水平。

成为VIP会员查看完整内容

相关内容

Arxiv

13+阅读 · 2020年12月3日

Arxiv

7+阅读 · 2018年11月4日