创新和竞争正推动分析师和数据科学家转向越来越复杂的预测建模和机器学习算法。这种复杂性使这些模型准确,但也使它们的预测难以理解。当准确性超过可解释性时,人类的信任就会受到影响,影响业务采用、监管监督和模型文档。

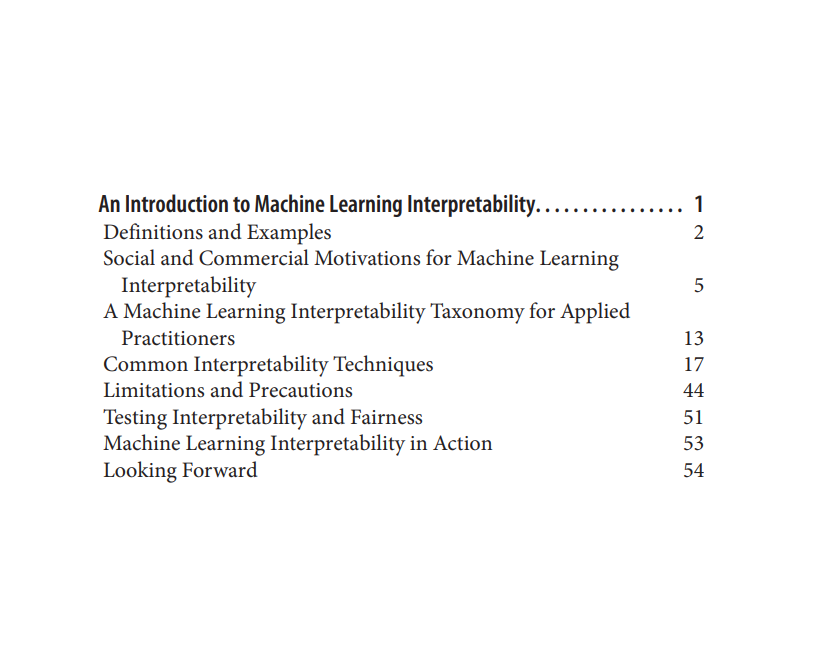

银行、保险和医疗保健尤其需要可解释的预测模型。在这本电子书中,Patrick Hall和Navdeep Gill来自H2O。Ai全面介绍了机器学习可解释性的思想,并研究了一套机器学习技术、算法和模型,以帮助数据科学家在保持可解释性的同时提高预测模型的准确性。 * 了解如何在实践中应用机器学习和预测建模 * 理解机器学习的可解释性、公平性、问责性和透明度的社会和商业动机 * 探索线性模型和更精确的机器学习模型之间的差异 * 了解可解释性的定义,并了解主导可解释性研究的团体 * 研究用于分类和描述可解释机器学习方法的分类法 * 学习数据可视化的几种实用技术,训练可解释的机器学习模型,并为复杂模型预测生成解释 * 探索测试模型可解释性的自动化方法

成为VIP会员查看完整内容

相关内容

专知会员服务

67+阅读 · 2019年12月9日

Arxiv

20+阅读 · 2023年3月21日