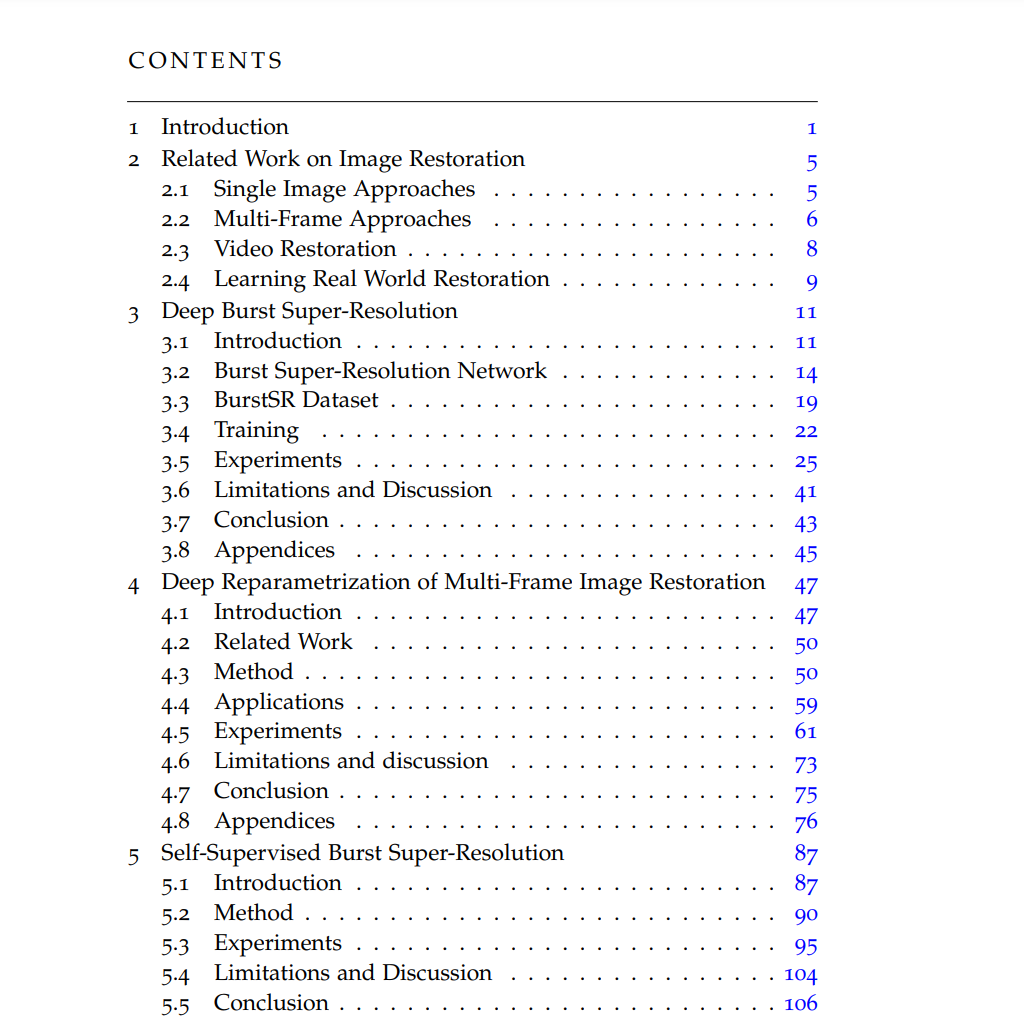

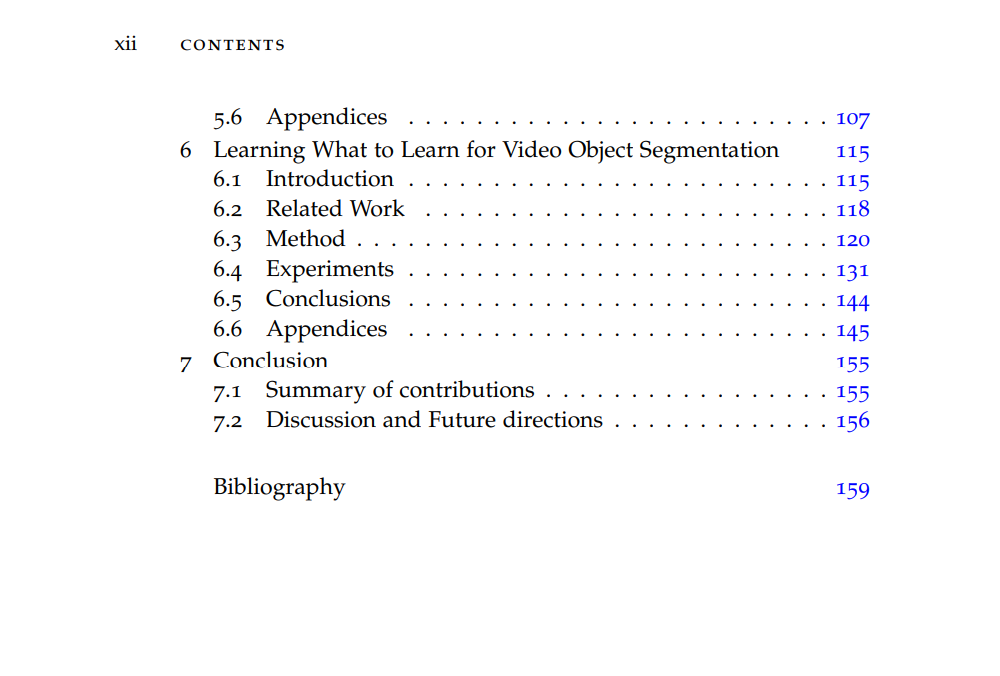

移动相机的兴起已导致摄影学经历了基础性的变革,这归因于它们的低成本、小尺寸以及易用性。然而,对移动相机施加的硬件限制显著降低了它们照片的质量。因此,现代相机依赖软件技术来提高图像质量。一个有前景的方向是结合来自多图像的信息来生成更高质量的图像。在本文中,我们处理这个多帧图像恢复问题。 首先,我们为RAW burst超分辨任务引入一种新颖的架构。我们的网络将多个噪声RAW图像作为输入,并生成一个去噪、去马赛克并超分辨的RGB图像作为输出。为了在现实世界的数据上实现训练和评估,我们还额外收集了第一个burst超分辨数据集,包括智能手机burst和高分辨率DSLR参考。尽管我们的训练对中存在空间和颜色的不对齐,但我们在现实世界的burst上展示了有前景的超分辨表现。

接下来,我们提出了一种深度重参数化的最大后验概率(MAP)公式,通常用于多帧图像恢复任务。我们通过引入学习到的误差度量和目标图像的潜在表示来派生出我们的方法,这将MAP目标转换为一个深度特征空间。深度重参数化允许我们直接在潜在空间中建模图像生成过程,并将学到的图像先验集成到预测中。

第三,我们引入了一种用于RAW burst超分辨的自监督训练策略。我们的方法只使用噪声低分辨率burst进行训练,从而消除了使用复杂方法收集配对训练数据或手动调整合成管道的需要。这是通过开发一种新颖的自监督目标来实现的,该目标可以利用burst中存在的混叠的高频信息来进行训练监督。

最后,我们引入了一种生成burst或视频中物体的逐像素分割掩模的方法。我们的方法不仅限于分割一组已知的物体类别,而是可以学习以few-shot方式分割新物体,给定一个分割掩模或定义物体的边界框。我们相信,这样的分割掩模可以作为改善恢复性能的有用线索,特别是在动态物体的情况下。