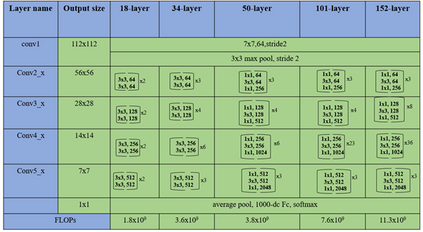

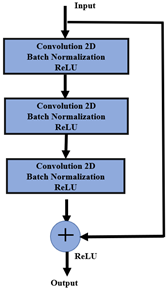

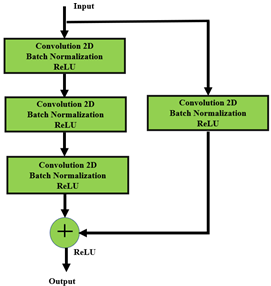

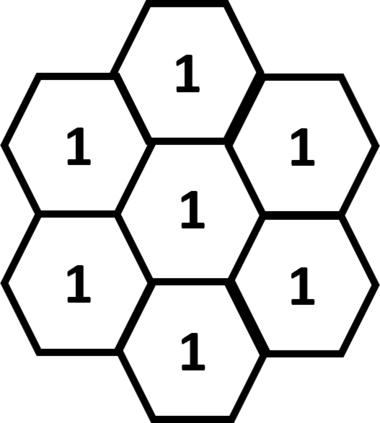

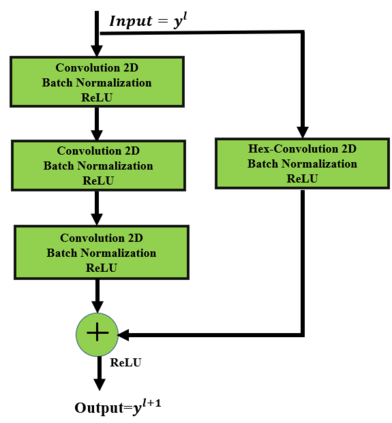

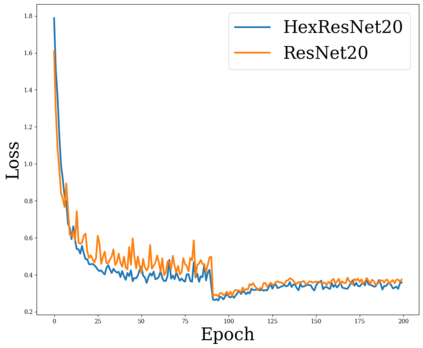

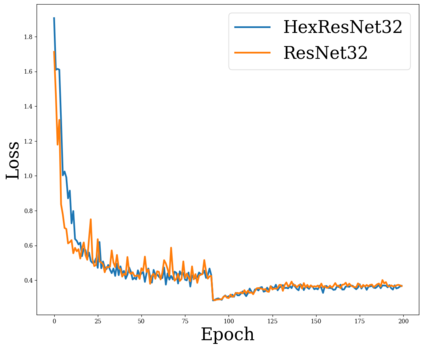

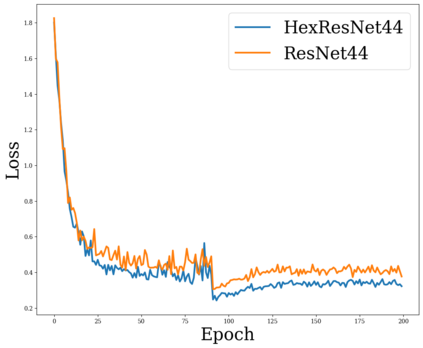

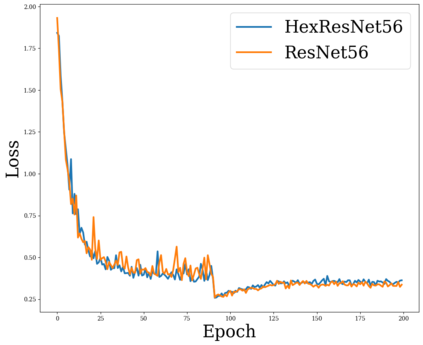

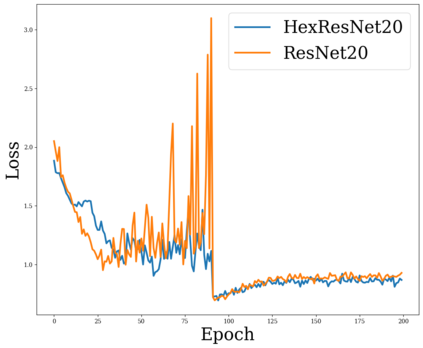

Deep neural network has been ensured as a key technology in the field of many challenging and vigorously researched computer vision tasks. Furthermore, classical ResNet is thought to be a state-of-the-art convolutional neural network (CNN) and was observed to capture features which can have good generalization ability. In this work, we propose a biologically inspired deep residual neural network where the hexagonal convolutions are introduced along the skip connections. The performance of different ResNet variants using square and hexagonal convolution are evaluated with the competitive training strategy mentioned by [1]. We show that the proposed approach advances the baseline image classification accuracy of vanilla ResNet architectures on CIFAR-10 and the same was observed over multiple subsets of the ImageNet 2012 dataset. We observed an average improvement by 1.35% and 0.48% on baseline top-1 accuracies for ImageNet 2012 and CIFAR-10, respectively. The proposed biologically inspired deep residual networks were observed to have improved generalized performance and this could be a potential research direction to improve the discriminative ability of state-of-the-art image classification networks.

翻译:深神经网络作为许多富有挑战性和经过大力研究的计算机愿景任务领域的一项关键技术得到了确保。此外,古典ResNet被认为是最先进的进化神经网络(CNN),并观测到能够捕捉到具有良好概括能力的特征。在这项工作中,我们建议建立一个由生物启发的深残余神经网络,在跳动连接中引入六边形共变。使用正方形和六边形共振的不同ResNet变量的性能与[1]所述的竞争性培训战略一起进行评估。我们表明,拟议方法提高了CIFAR-10号香草ResNet结构的基线图像分类准确度,并在2012年图像网络数据集的多个子集中也观察到了同样的精确度。我们观察到,2012年图像网络和CIFAR-10号的基线顶层-1电弧分别平均提高了1.35%和0.48%。观测到,拟议的由生物启发的深海残余网络提高了普遍性能,这可能是提高状态图像分类网络的区别性能力的潜在研究方向。