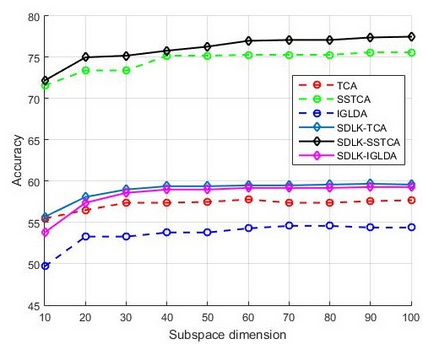

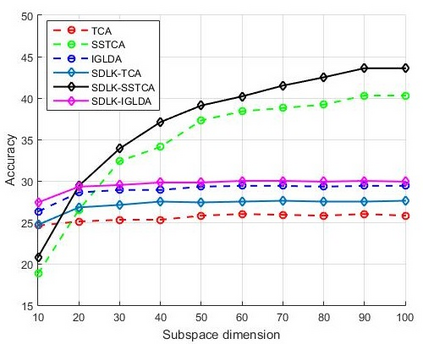

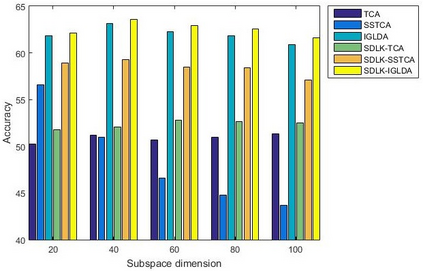

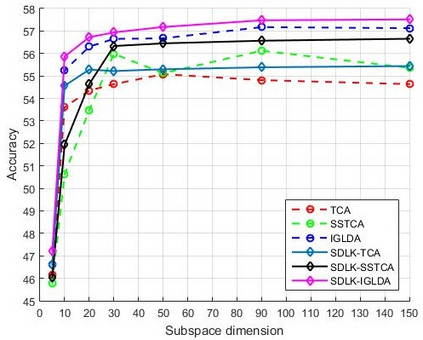

Reproducing Kernel Hilbert Space (RKHS) is the common mathematical platform for various kernel methods in machine learning. The purpose of kernel learning is to learn an appropriate RKHS according to different machine learning scenarios and training samples. Because RKHS is uniquely generated by the kernel function, kernel learning can be regarded as kernel function learning. This paper proposes a Domain Adaptive Learning method based on Sample-Dependent and Learnable Kernels (SDLK-DAL). The first contribution of our work is to propose a sample-dependent and learnable Positive Definite Quadratic Kernel function (PDQK) framework. Unlike learning the exponential parameter of Gaussian kernel function or the coefficient of kernel combinations, the proposed PDQK is a positive definite quadratic function, in which the symmetric positive semi-definite matrix is the learnable part in machine learning applications. The second contribution lies on that we apply PDQK to Domain Adaptive Learning (DAL). Our approach learns the PDQK through minimizing the mean discrepancy between the data of source domain and target domain and then transforms the data into an optimized RKHS generated by PDQK. We conduct a series of experiments that the RKHS determined by PDQK replaces those in several state-of-the-art DAL algorithms, and our approach achieves better performance.

翻译:Kernel Hilbert 空间( RKHS ) 是机器学习中各种内核方法的常见数学平台。 内核学习的目的是根据不同的机器学习情景和培训样本, 学习适当的 RKHS 。 由于 RKHS是由内核函数独创产生的, 内核学习可以被视为内核功能学习。 本文建议了基于样本- 依赖和可学习的内内核( SDLK- DAL) 的“ 内存学习方法 ” (SDLK- DAL) 。 我们工作的第一项贡献是提出一个基于机器学习中各种内内核方法的常见数学方法。 内核学习的目的是根据不同的机器学习方案, 根据不同的机器学习方案, 学习的目的是根据不同的机器学习方案, 根据不同的机内学习机器学习不同的机器学习程序, 以抽样、 可学习的、 可学习的正正正正半确定基半确定基质矩阵(SDQQKK) 方法, 将PDQQQKKK 的 和 AL-DK AL AL 数据序列, 通过将 AS AS AS AS AS 确定 数据源 的 的,, 最深的 PK,,, 最 最 最 最 最 最 最 最 的 P 的 P 的 P 的 P 的 P 的 P 的 P 的 的 的 、 、 的 PKKKK 的 P 的 P, 的 P 的 P 的 P 的 P 的 P,, 的 P 的 P 的 P 的 P 的 的 P 的 P, 的 P 的 P 的 P 的 P 的 的 的 的 P 的 的 的 的 的 的 P 的 的 的 的 P 的 的 的 的 的 的 的 的 P 和 P 的 P 的 的 的 的 的 的 P 的 P 的 P 的 的 的 的 的 P 的 的 的 的 P 的 的 的 的 的 的 的 的, 和 P,