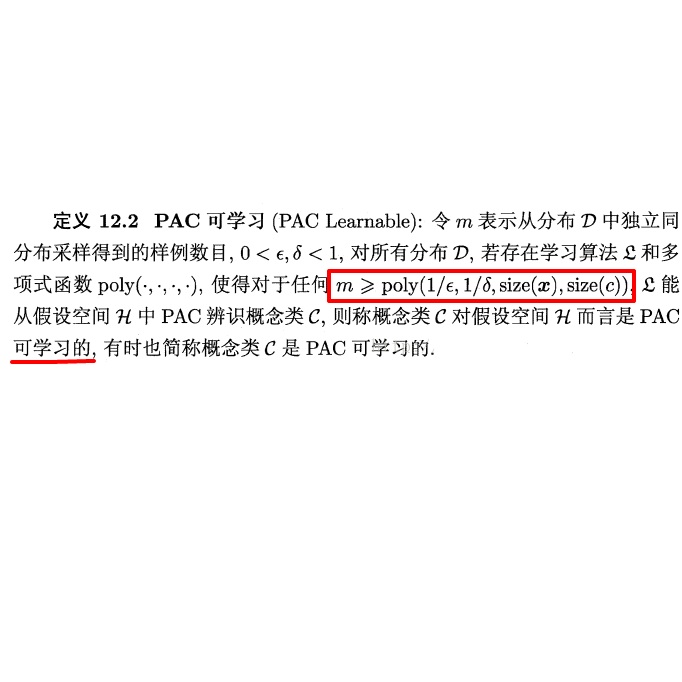

This paper offers a new hybrid probably approximately correct (PAC) reinforcement learning (RL) algorithm for Markov decision processes (MDPs) that intelligently maintains favorable features of its parents. The designed algorithm, referred to as the Dyna-Delayed Q-learning (DDQ) algorithm, combines model-free and model-based learning approaches while outperforming both in most cases. The paper includes a PAC analysis of the DDQ algorithm and a derivation of its sample complexity. Numerical results are provided to support the claim regarding the new algorithm's sample efficiency compared to its parents as well as the best known model-free and model-based algorithms in application.

翻译:本文为Markov决定程序提供了一种新的可能大致正确(PAC)的强化学习(RL)新混合算法,该算法明智地保持了父母的有利特征。设计算法称为Dyna-Delauled Q-learning(DDQ)算法,结合了不使用模型和基于模型的学习方法,在多数情况下都优于这两种方法。该文件包括对DDQ算法的分析及其样本复杂性的衍生。提供了数字结果,以支持关于新算法相对于其父母的抽样效率以及应用中最著名的不使用模型和基于模型的算法的索赔。