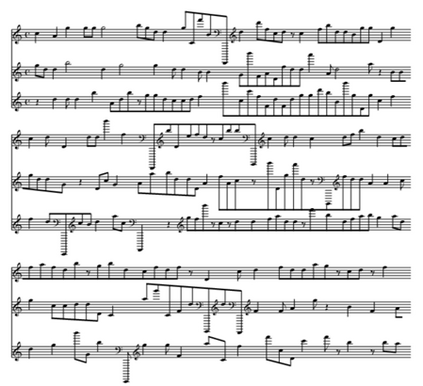

Automatic Music Generation (AMG) has become an interesting research topic for many scientists in artificial intelligence, who are also interested in the music industry. One of the main challenges in AMG is that there is no clear objective evaluation criterion that can measure the music grammar, structural rules, and audience satisfaction. Also, original music contains different elements that should work together, such as melody, harmony, and rhythm; but in the most of previous works, AMG works only for one element (e.g., melody). Therefore, in this paper, we propose a Multi-Objective Genetic Algorithm (MO-GA) to generate polyphonic music pieces, considering grammar and listener satisfaction. In this method, we use three objective functions. The first objective function is the accuracy of the generated music piece, based on music theory; and the other two objective functions are modeled scores provided by music experts and ordinary listeners. The scoring of experts and listeners separately are modeled using Bi-directional Long Short-Term Memory (Bi-LSTM) neural networks. The proposed music generation system tries to maximize mentioned objective functions to generate a new piece of music, including melody and harmony. The results show that the proposed method can generate pleasant pieces with desired styles and lengths, along with harmonic sounds that follow the grammar.

翻译:对于许多人工智能科学家来说,自动音乐产生(AMG)已成为一个有趣的研究课题,他们也关心音乐产业。AMG的主要挑战之一是没有明确的客观评价标准可以测量音乐语法、结构规则和观众满意度。此外,原音乐包含不同的元素,这些元素应该共同发挥作用,例如旋律、和谐和节奏;但在大部分以前作品中,AMG只为一个元素(例如旋律)工作。因此,我们在本文件中提议建立一个多角度遗传基因阿尔高音(MO-GA)来生成多字形音乐片,同时考虑到语法和听众满意度。在这个方法中,我们使用三个客观功能。第一个客观功能是制作的音乐作品的准确性,以音乐理论为基础;其他两个目标功能是音乐专家和普通听众提供的模型分数。专家和听众的评分分别以双向短期记忆(Bi-LSTM)神经网络为模型。拟议的音乐生成系统试图尽可能优化所提到的客观功能,包括能够生成新的曲调的音调和音调方法,并展示能够生成新的曲的完美的音调。