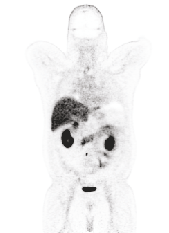

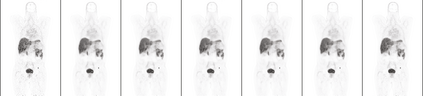

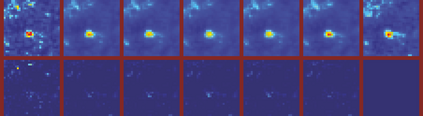

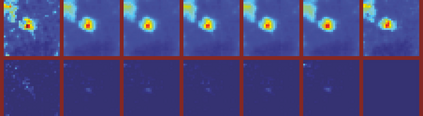

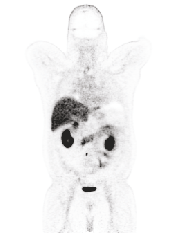

Position emission tomography (PET) is widely used in clinics and research due to its quantitative merits and high sensitivity, but suffers from low signal-to-noise ratio (SNR). Recently convolutional neural networks (CNNs) have been widely used to improve PET image quality. Though successful and efficient in local feature extraction, CNN cannot capture long-range dependencies well due to its limited receptive field. Global multi-head self-attention (MSA) is a popular approach to capture long-range information. However, the calculation of global MSA for 3D images has high computational costs. In this work, we proposed an efficient spatial and channel-wise encoder-decoder transformer, Spach Transformer, that can leverage spatial and channel information based on local and global MSAs. Experiments based on datasets of different PET tracers, i.e., $^{18}$F-FDG, $^{18}$F-ACBC, $^{18}$F-DCFPyL, and $^{68}$Ga-DOTATATE, were conducted to evaluate the proposed framework. Quantitative results show that the proposed Spach Transformer can achieve better performance than other reference methods.

翻译:由于数量上的优点和高度敏感性,在诊所和研究中广泛使用排放定位成像仪(PET),因为其数量上的优点和高度敏感性,因此在诊所和研究中广泛使用其位置定位成像仪(SNR),但受信号到噪音比率低的影响。最近革命性神经网络(CNNs)被广泛用来提高PET图像质量。尽管在本地地貌提取方面是成功和有效的,但CNN由于其有限的可接受领域,无法很好地捕捉远程依赖性。全球多头自我关注(MSA)是获取远程信息的流行方法。然而,计算3D图像的全球管理协议的计算成本很高。在这项工作中,我们提议了高效的空间和频道智能解码器变异器,Spach变换器,能够利用基于本地和全球地貌感光学的空间和频道信息。基于不同PET追踪器数据集的实验,即$ ⁇ 18美元FG,$F-ACBC, $18美元,F-DCFPYL, $F-DCFyL, 和$68GA-DATATA, $G$GATA, $G, $G-DATA,我们可以,我们提出的方法可以更好地评估。SVI 。SMADA/Q。 SVA/QA/QADADADADADA,可以提供。