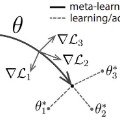

Model-agnostic meta-learning (MAML) is arguably one of the most popular meta-learning algorithms nowadays. Nevertheless, its performance on few-shot classification is far behind many recent algorithms dedicated to the problem. In this paper, we point out several key facets of how to train MAML to excel in few-shot classification. First, we find that MAML needs a large number of gradient steps in its inner loop update, which contradicts its common usage in few-shot classification. Second, we find that MAML is sensitive to the class label assignments during meta-testing. Concretely, MAML meta-trains the initialization of an $N$-way classifier. These $N$ ways, during meta-testing, then have "$N!$" different permutations to be paired with a few-shot task of $N$ novel classes. We find that these permutations lead to a huge variance of accuracy, making MAML unstable in few-shot classification. Third, we investigate several approaches to make MAML permutation-invariant, among which meta-training a single vector to initialize all the $N$ weight vectors in the classification head performs the best. On benchmark datasets like MiniImageNet and TieredImageNet, our approach, which we name UNICORN-MAML, performs on a par with or even outperforms many recent few-shot classification algorithms, without sacrificing MAML's simplicity.

翻译:模型- 不可知的元学习( MAML) 可以说是当今最流行的元学习算法之一。 然而, 它在微小分类上的性能远远落后于最近许多专门解决这一问题的算法。 在本文中, 我们指出如何培训MAML以优于微小分类的几大关键方面。 首先, 我们发现MAML在其内部循环更新中需要大量梯度步骤, 这与其在微小分类中的通用使用相矛盾。 第二, 我们发现MAMLL在元测试中敏感于类级标签任务。 具体地说, MAML在微小分类中, MAML 元在启动一个美元- 美元- 网络分类器的初始化过程中, 这些美元的方法, 在元测试期间, 然后有“ $ N. $ $ ” 的不同变异的配对数项任务 。 我们发现这些变异导致一个巨大的准确性差异, 使MAML 在微小分类中不稳定 。 第三, 我们调查了几种方法, 使MAMLML 变异性,, 其中的元培训一个单一的矢量矢量级 开始对所有的 IMLMAL- IMLMAL 方向, IMLMALMALMALMALMALMA 的 的排序 的 的 格式, 格式, 的 的, 的 的 的, 和, 在分类中, 在 IMFI 的 的 的 的 IMFI IMFI IMFI 的 的 的 IMFI IMFI 。