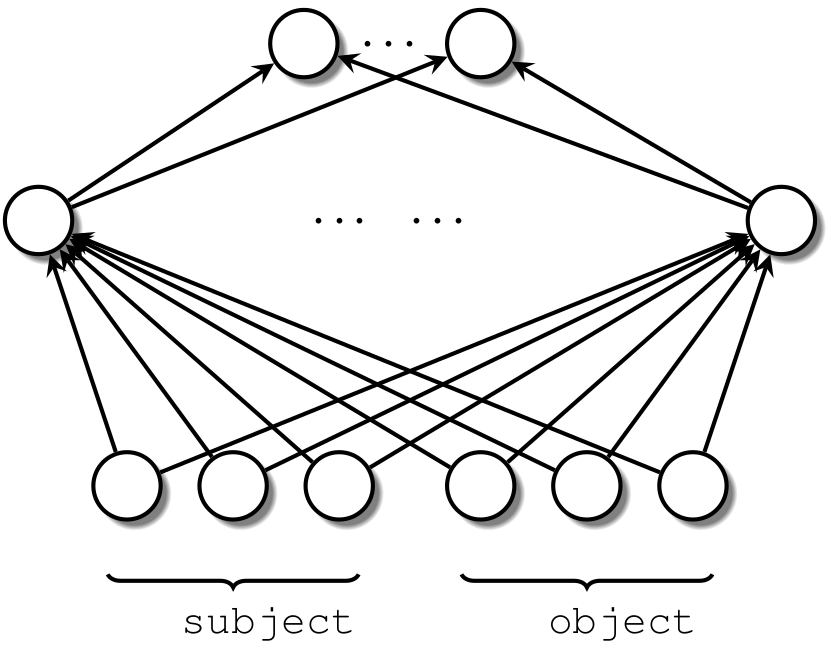

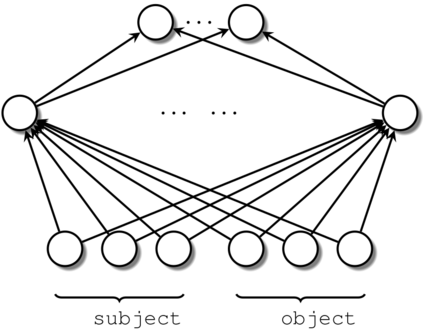

Knowledge graph completion refers to predicting missing triples. Most approaches achieve this goal by predicting entities, given an entity and a relation. We predict missing triples via the relation prediction. To this end, we frame the relation prediction problem as a multi-label classification problem and propose a shallow neural model (SHALLOM) that accurately infers missing relations from entities. SHALLOM is analogous to C-BOW as both approaches predict a central token (p) given surrounding tokens ((s,o)). Our experiments indicate that SHALLOM outperforms state-of-the-art approaches on the FB15K-237 and WN18RR with margins of up to $3\%$ and $8\%$ (absolute), respectively, while requiring a maximum training time of 8 minutes on these datasets. We ensure the reproducibility of our results by providing an open-source implementation including training and evaluation scripts at {\url{https://github.com/dice-group/Shallom}.}

翻译:知识图的完成是指预测缺失的三重关系。 多数方法都是通过预测实体, 给一个实体和关系来实现这一目标。 我们通过关系预测来预测缺失的三重关系。 为此, 我们将关系预测问题定义为一个多标签分类问题, 并提出一个精确推断实体间缺少关系的浅色神经模型( SHALLOM ) 。 SHALLOM 类似于 C-BOW, 因为两种方法都预测周围象征( (s,o) 的中央象征(p) 。 我们的实验表明, SHALLOM 在FB15K-237 和 WN18RRR 上的表现优于最先进的方法, 其间距分别高达 $3 ⁇ 美元和$8 ⁇ $( 绝对值), 同时要求这些数据集上的最大培训时间为8分钟。 我们通过提供开放源实施,包括在url{https://github.com/dice- group/Shalom}确保我们的成果能够重新体现。 。 。