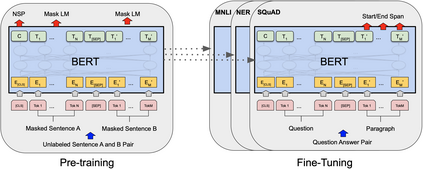

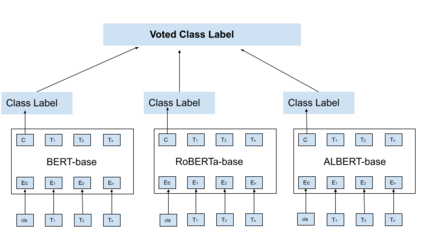

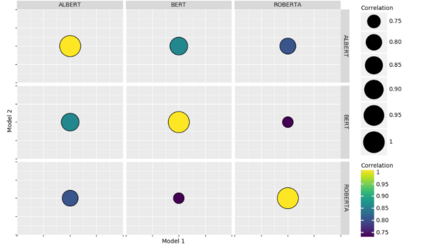

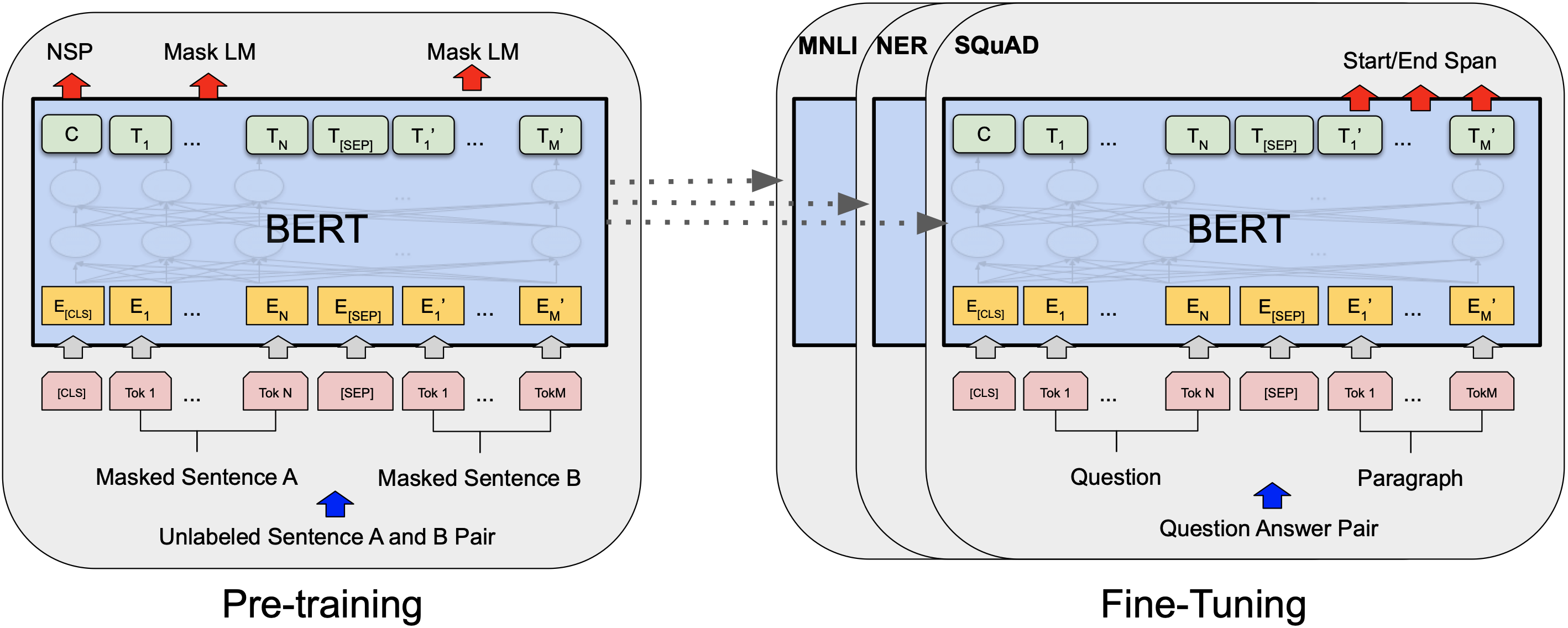

Sentiment analysis can provide a suitable lead for the tools used in software engineering along with the API recommendation systems and relevant libraries to be used. In this context, the existing tools like SentiCR, SentiStrength-SE, etc. exhibited low f1-scores that completely defeats the purpose of deployment of such strategies, thereby there is enough scope for performance improvement. Recent advancements show that transformer based pre-trained models (e.g., BERT, RoBERTa, ALBERT, etc.) have displayed better results in the text classification task. Following this context, the present research explores different BERT-based models to analyze the sentences in GitHub comments, Jira comments, and Stack Overflow posts. The paper presents three different strategies to analyse BERT based model for sentiment analysis, where in the first strategy the BERT based pre-trained models are fine-tuned; in the second strategy an ensemble model is developed from BERT variants, and in the third strategy a compressed model (Distil BERT) is used. The experimental results show that the BERT based ensemble approach and the compressed BERT model attain improvements by 6-12% over prevailing tools for the F1 measure on all three datasets.

翻译:感官分析可以为软件工程工具以及API建议系统和相关图书馆使用的工具提供合适的引导。在这方面,SentiCR、SentiStrength-SE等现有工具展示了低F1-分数,完全破坏了部署这类战略的目的,因此有足够的改进业绩的余地。最近的进展显示,基于预先培训模型的变压器(如BERT、RoBERTA、ALBERT等)在文本分类任务中显示出更好的结果。在此背景下,本研究探索了基于BERT的不同模型,以分析GitHub评论、Jira评论和Stack overtraproll post 等的句子。本文提出了三个不同的战略,以分析基于BERT的情绪分析模型,在第一个战略中,基于BERT的预先培训模型经过微调调整;在第二个战略中,根据BERT变式模型开发了一个模块,在第三个战略中,采用了压缩模型(DITI BERT)。实验结果显示,BERERT基于通用的GMMM1 和压缩模型, 超过了所有MISARM 3 工具。