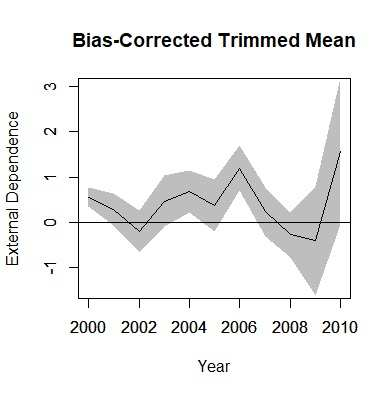

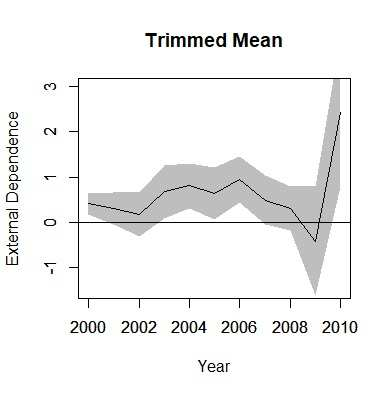

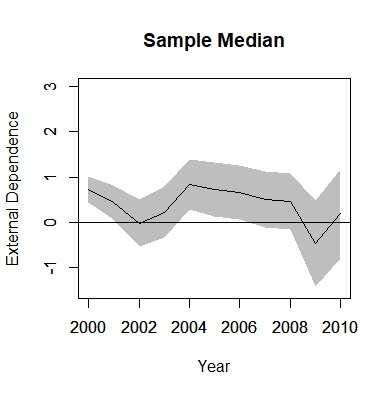

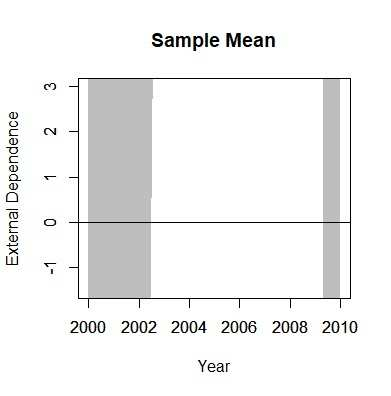

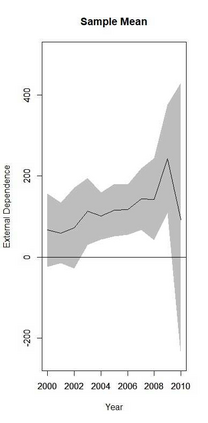

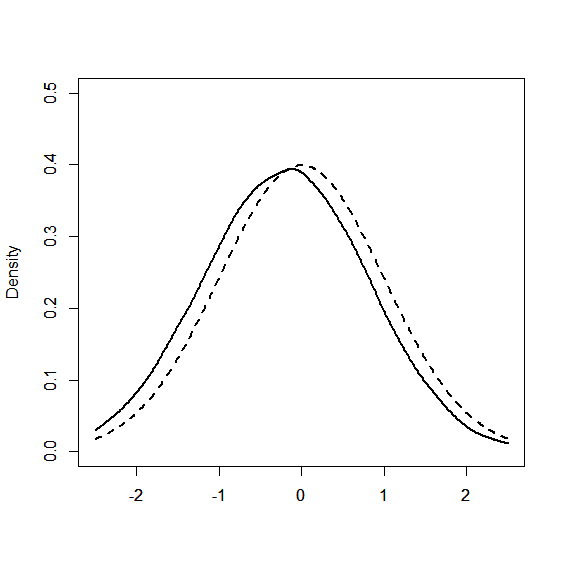

Empirical researchers often trim observations with small denominator A when they estimate moments of the form E[B/A]. Large trimming is a common practice to mitigate variance, but it incurs large trimming bias. This paper provides a novel method of correcting large trimming bias. If a researcher is willing to assume that the joint distribution between A and B is smooth, then a large trimming bias may be estimated well. With the bias correction, we also develop a valid and robust inference result for E[B/A].

翻译:经验研究人员在估计表E[B/A]的时,往往用小分母A对观测进行精细处理。大裁剪是减少差异的常见做法,但会产生很大的裁剪偏差。本文提供了纠正大裁剪偏差的新方法。如果研究人员愿意假设A和B之间的联合分布是顺利的,那么,就可以对大裁剪偏差作出很好的估计。通过对偏差的纠正,我们还为E[B/A]制定了有效和有力的推论结果。

相关内容

专知会员服务

16+阅读 · 2019年11月30日

【变分推断课件】Lectures on Variational Inference: Approximate Bayesian Inference in Machine Learning(附带pdf)

专知会员服务

35+阅读 · 2019年11月30日

专知会员服务

36+阅读 · 2019年10月17日