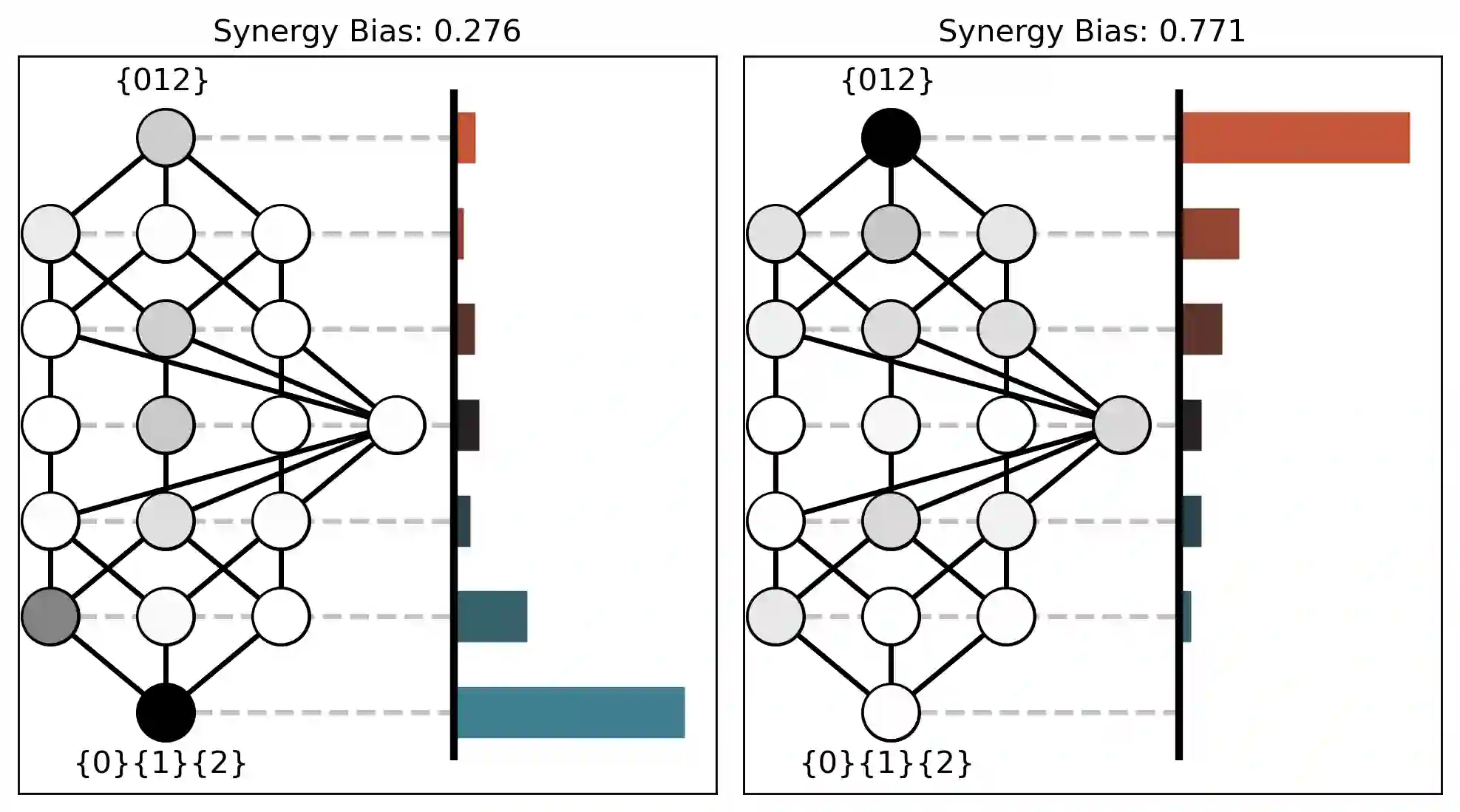

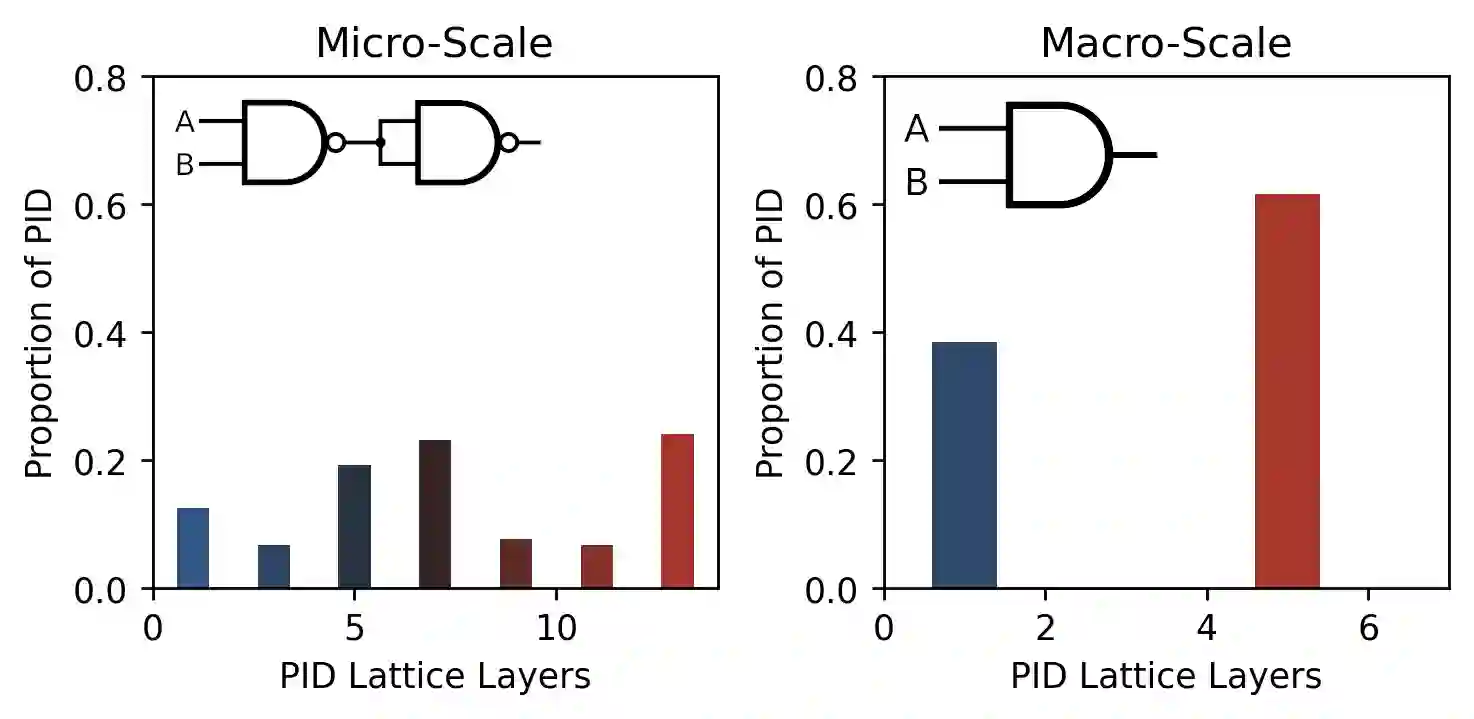

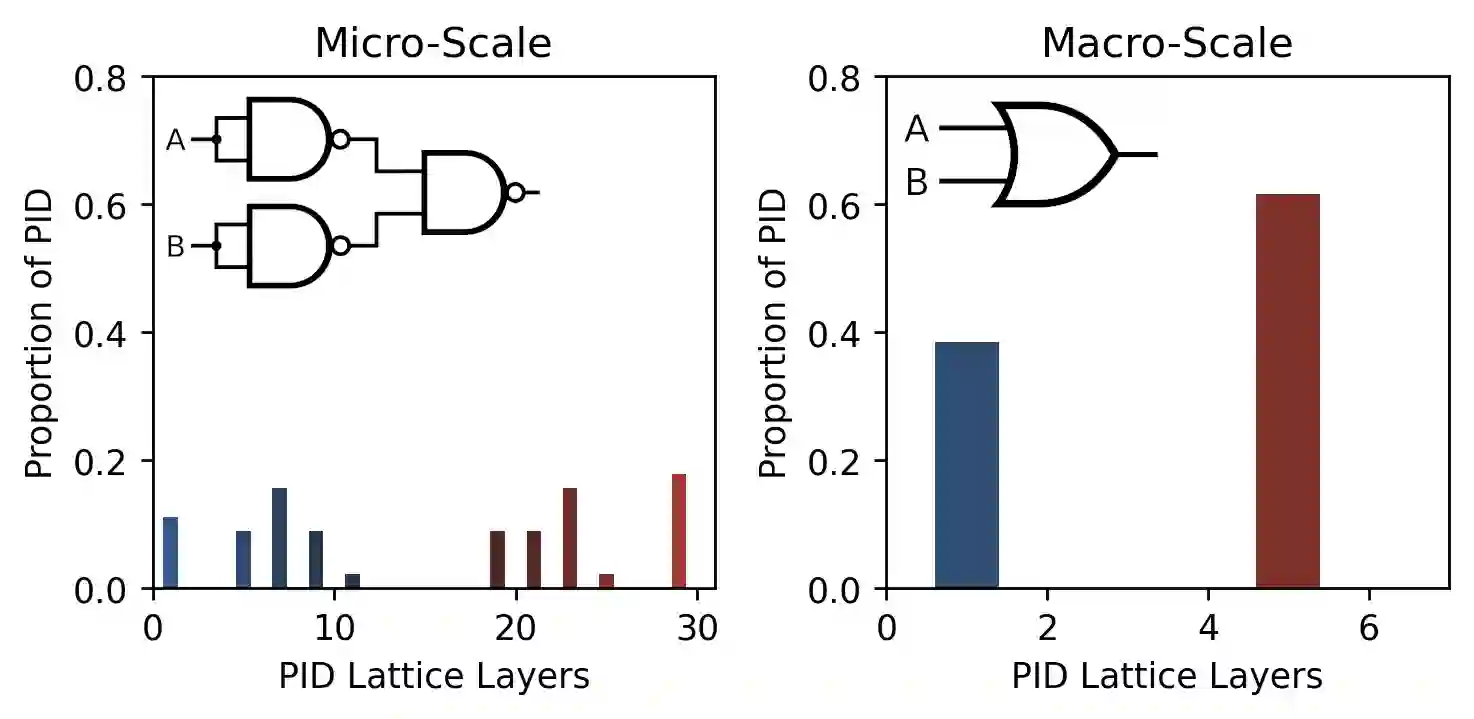

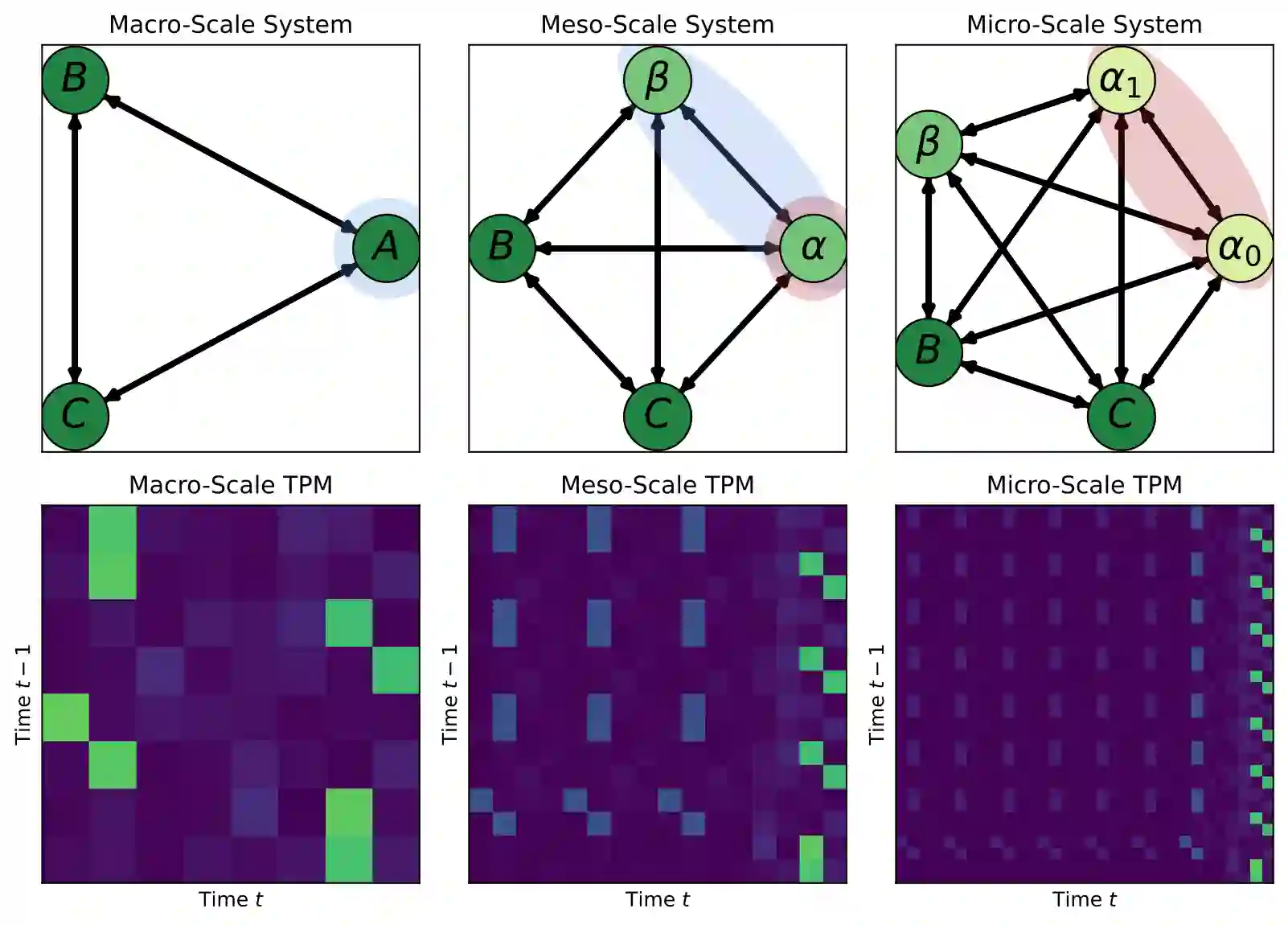

Is reduction always a good scientific strategy? Does it always lead to a gain in information? The very existence of the special sciences above and beyond physics seems to hint no. Previous research has shown that dimension reduction (macroscales) can increase the dependency between elements of a system (a phenomenon called "causal emergence"). However, this has been shown only for specific measures like effective information or integrated information. Here, we provide an umbrella mathematical framework for emergence based on information conversion. Specifically, we show evidence that a macroscale can have more of a certain type of information than its underlying microscale. This is because macroscales can convert information from one type to another. In such cases, reduction to a microscale means the loss of this type of information. We demonstrate this using the well-understood mutual information measure applied to Boolean networks. By using the partial information decomposition, the mutual information can be decomposed into redundant, unique, and synergistic information atoms. Then by introducing a novel measure of the synergy bias of a given decomposition, we are able to show that the synergy component of a Boolean network's mutual information can increase at macroscales. This can occur even when there is no difference in the total mutual information between a macroscale and its underlying microscale, proving information conversion. We relate this broad framework to previous work, compare it to other theories, and argue it complexifies any notion of universal reduction in the sciences, since such reduction would likely lead to a loss of synergistic information in scientific models.

翻译:减少总是一个良好的科学战略吗? 它是否总是导致信息增加? 物理上和物理以外的特殊科学的存在本身似乎暗示没有。 以前的研究显示, 减少规模( 宏观尺度) 能够增加系统各元素之间的依赖性( 被称为“ 诱发” 现象 ) 。 然而, 这只表现在有效的信息或综合信息等具体措施上。 在这里, 我们为基于信息转换的出现提供一个总括数学框架。 具体地说, 我们证明宏观尺度可能拥有比其内在微观尺度更多的某种类型的信息。 这是因为宏观尺度可以将信息从一种类型转换为另一种类型。 在这种情况下, 将规模缩小为微观尺度意味着这类信息的损失。 我们使用对布林网络应用的深层相互信息衡量尺度来证明这一点。 通过部分信息分解, 相互信息可以分解成一个冗余、 独特和协同的信息原子。 然后, 我们通过引入一种新型的计量方法, 来显示, 大规模规模的网络的协同部分可以将信息转换成另一种类型的信息。 在宏观尺度上, 相互信息变变的模型中, 也可以将这种分级化为 。