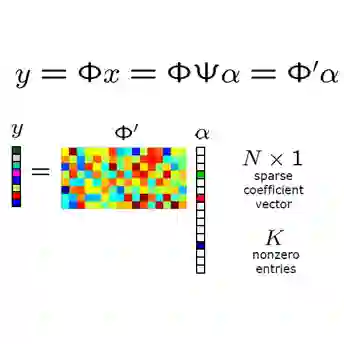

1-bit compressive sensing aims to recover sparse signals from quantized 1-bit measurements. Designing efficient approaches that could handle noisy 1-bit measurements is important in a variety of applications. In this paper we use the approximate message passing (AMP) to achieve this goal due to its high computational efficiency and state-of-the-art performance. In AMP the signal of interest is assumed to follow some prior distribution, and its posterior distribution can be computed and used to recover the signal. In practice, the parameters of the prior distributions are often unknown and need to be estimated. Previous works tried to find the parameters that maximize either the measurement likelihood via expectation maximization, which becomes increasingly difficult to solve in cases of complicated probability models. Here we propose to treat the parameters as unknown variables and compute their posteriors via AMP as well, so that the parameters and the signal can be recovered jointly. Compared to previous methods, the proposed approach leads to a simple and elegant parameter estimation scheme, allowing us to directly work with 1-bit quantization noise model. Experimental results show that the proposed approach generally perform much better than the other state-of-the-art methods in the zero-noise and moderate-noise regimes, and outperforms them in most of the cases in the high-noise regime.

翻译:1比位压缩遥感的目的是从量化1比位测量中恢复稀少的信号。 设计能够处理噪音1比位测量的高效方法在各种应用中很重要。 在本文中,我们使用近似传递信息( AMP) 来实现这一目标, 因为它的计算效率和最新性能很高。 在 AMP 中, 假定有兴趣的信号会遵循某些先前的分布, 并且其后方分布可以计算并用来恢复信号。 实际上, 先前分布的参数往往未知, 需要估算。 先前的工程试图找到参数, 通过预期最大化来最大限度地提高测量可能性, 在复杂概率模型中, 这一点越来越难以解决。 我们在这里建议将参数作为未知变量处理, 并且通过 AMP 来拼凑它们的后方, 这样参数和信号就可以被联合恢复。 与以前的方法相比, 拟议的方法可以导致简单而优雅的参数估计计划, 使我们能够直接使用 1比位量化噪声模型。 实验结果显示, 拟议的方法一般比其他高的、 高等级和最高级的系统方法中, 在最中, 高的零和最高级的系统中, 的系统中、最优。