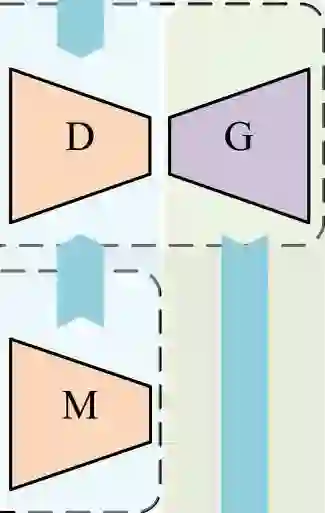

Federated learning is gaining popularity as a distributed machine learning method that can be used to deploy AI-dependent IoT applications while protecting client data privacy and security. Due to the differences of clients, a single global model may not perform well on all clients, so the personalized federated learning method, which trains a personalized model for each client that better suits its individual needs, becomes a research hotspot. Most personalized federated learning research, however, focuses on data heterogeneity while ignoring the need for model architecture heterogeneity. Most existing federated learning methods uniformly set the model architecture of all clients participating in federated learning, which is inconvenient for each client's individual model and local data distribution requirements, and also increases the risk of client model leakage. This paper proposes a federated learning method based on co-training and generative adversarial networks(GANs) that allows each client to design its own model to participate in federated learning training independently without sharing any model architecture or parameter information with other clients or a center. In our experiments, the proposed method outperforms the existing methods in mean test accuracy by 42% when the client's model architecture and data distribution vary significantly.

翻译:联邦学习作为一种分布式的机器学习方法,在保护客户数据隐私和安全的同时,可以用来部署AI依赖IoT应用软件,这种分散式的机器学习方法越来越受欢迎。由于客户的不同,单一的全球模式可能不能对所有客户都产生良好效果,因此,个人化的联谊学习方法,即为每个客户培训更适合其个人需要的个人化模式,成为研究热点。大多数个性化的联邦学习研究侧重于数据异质性,而忽视模型结构差异性的需要。大多数现有的联谊学习方法统一地设置了参与联合学习的所有客户的模型结构,这对每个客户的个人模型和当地数据分发要求都是不方便的,也增加了客户模式渗漏的风险。本文提出一个基于共同培训和基因化对抗网络(GANs)的联谊学习方法,允许每个客户设计自己的模型,独立地参加进化学习培训,而不与其他客户或中心分享任何模型结构或参数信息。在我们的实验中,拟议的方法比现有的方法要优于平均测试方法的准确性方法,在客户数据结构出现大幅变化的情况下,42 %的数据结构分配。