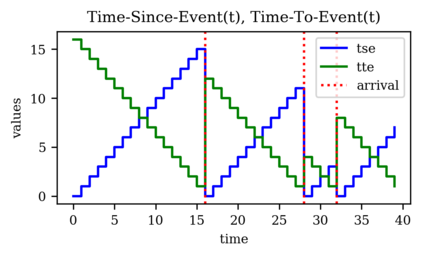

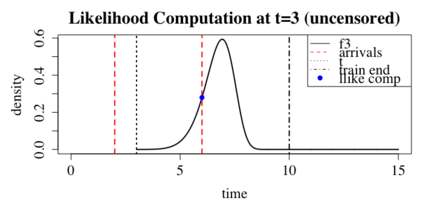

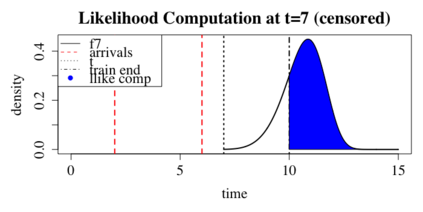

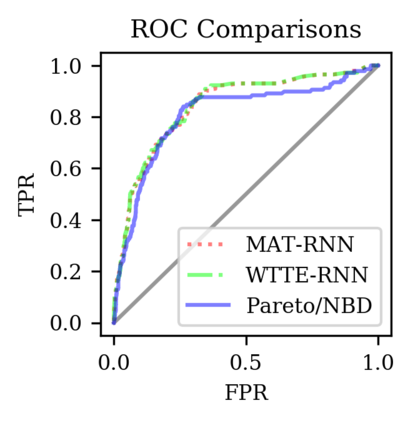

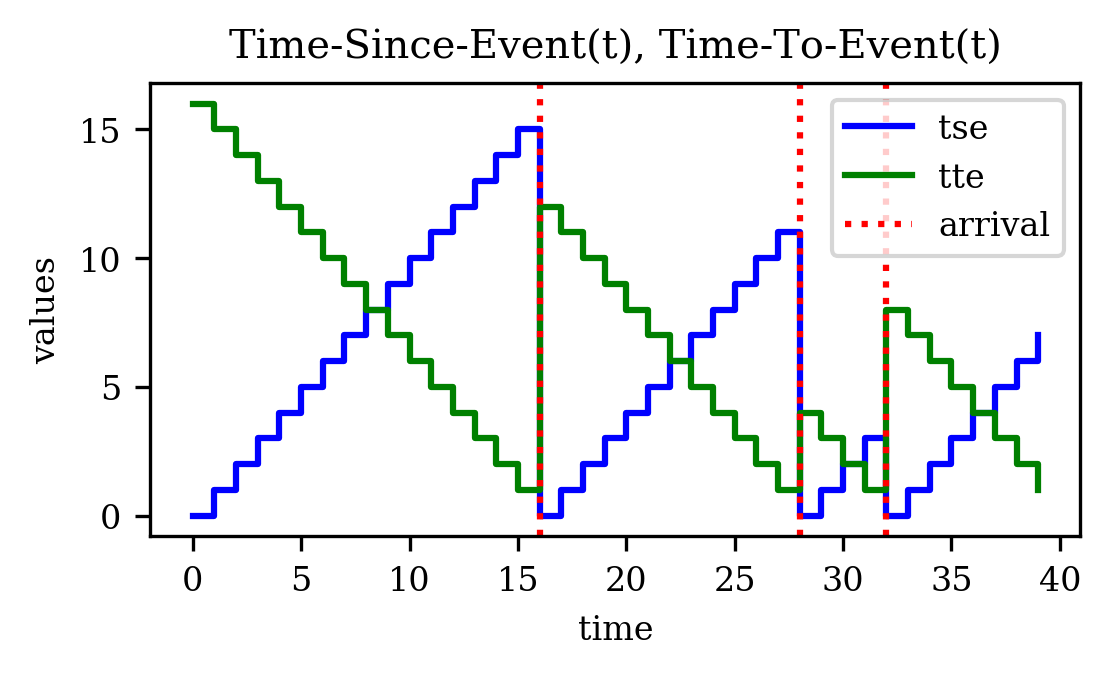

Access to a large variety of data across a massive population has made it possible to predict customer purchase patterns and responses to marketing campaigns. In particular, accurate demand forecasts for popular products with frequent repeat purchases are essential since these products are one of the main drivers of profits. However, buyer purchase patterns are extremely diverse and sparse on a per-product level due to population heterogeneity as well as dependence in purchase patterns across product categories. Traditional methods in survival analysis have proven effective in dealing with censored data by assuming parametric distributions on inter-arrival times. Distributional parameters are then fitted, typically in a regression framework. On the other hand, neural-network based models take a non-parametric approach to learn relations from a larger functional class. However, the lack of distributional assumptions make it difficult to model partially observed data. In this paper, we model directly the inter-arrival times as well as the partially observed information at each time step in a survival-based approach using Recurrent Neural Networks (RNN) to model purchase times jointly over several products. Instead of predicting a point estimate for inter-arrival times, the RNN outputs parameters that define a distributional estimate. The loss function is the negative log-likelihood of these parameters given partially observed data. This approach allows one to leverage both fully observed data as well as partial information. By externalizing the censoring problem through a log-likelihood loss function, we show that substantial improvements over state-of-the-art machine learning methods can be achieved. We present experimental results based on two open datasets as well as a study on a real dataset from a large retailer.

翻译:大量人口获得大量数据的情况使得有可能预测客户购买模式和对市场营销运动的反应。特别是,对经常重复购买的流行产品进行准确的需求预测至关重要,因为这些产品是利润的主要驱动因素之一。然而,由于购买者购买模式极为多样化,而且由于各产品类别之间在购买模式上的依赖性,每个产品都存在不同的产品,因此购买模式非常分散。传统的生存分析方法证明在处理受审查数据方面是有效的,方法是假设在抵达时间之间进行参数分布分配。然后,通常在倒退框架内安装分配参数。另一方面,基于神经网络的模型采取非参数方法从更大的功能类别中学习关系。然而,由于缺乏分配假设,很难模拟部分观察的数据。在本文件中,我们直接模拟到到到产品类别之间采购模式的每个阶段都观察到的信息。我们通过基于网络的正常网络(RNNN)来模拟到多个产品之间的购买时间。而不是预测到到达时间的点,而基于神经网络的模型模型模型模型模型模型模型模型模型模型则从更大的功能中得出一个真实的、类似于RNNNNU的目前的数据输出参数,从而可以部分地将这些数据用于计算出一个观察到的外部数据流值。