自编码器

·

题目: FEEDBACK RECURRENT AUTOENCODER

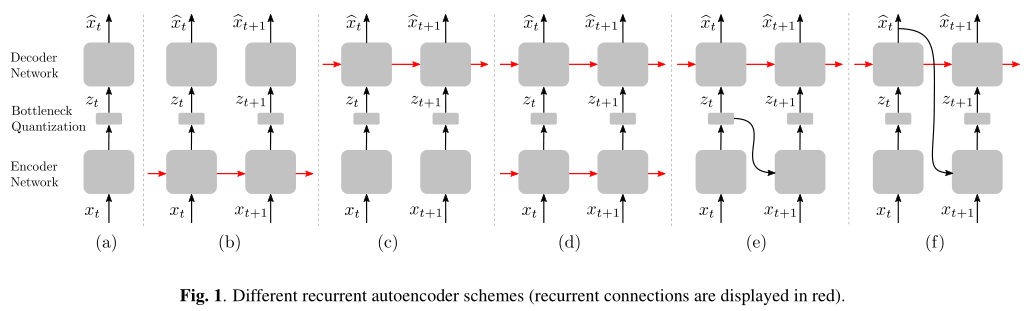

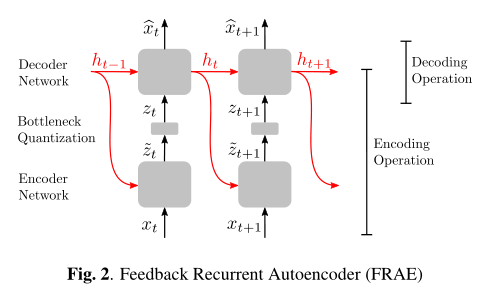

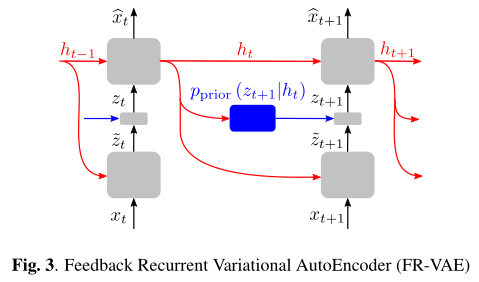

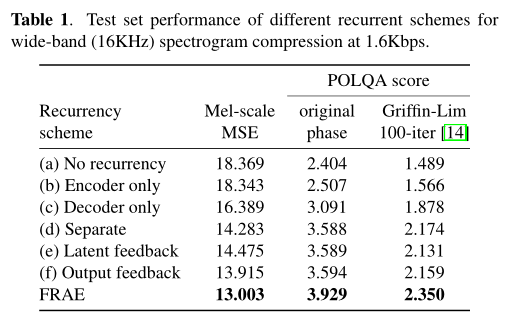

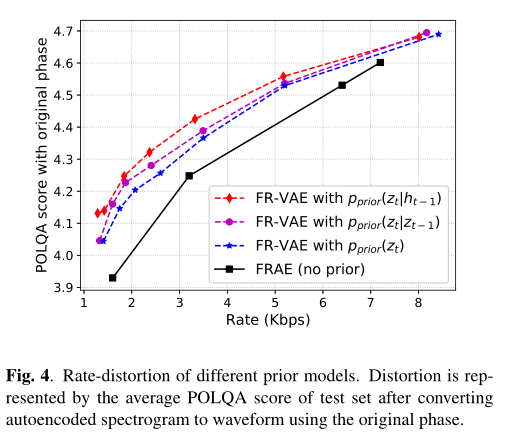

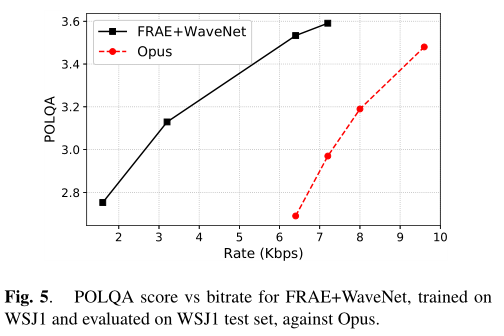

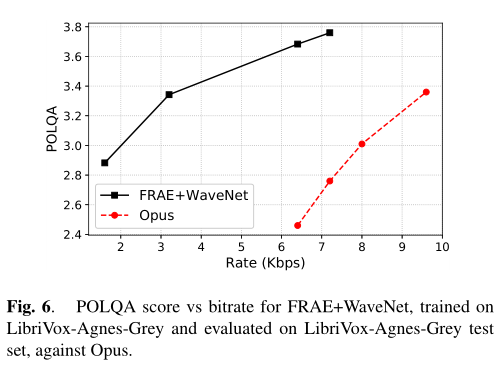

摘要: 在这项工作中,我们提出了一种新的递归自编码器架构,称为反馈递归自编码器(FRAE),用于时序数据的在线压缩。FRAE的重流结构是为了有效地提取沿时间维的冗余,并允许对学习的数据进行紧凑的离散表示。我们证明了它在语音谱图压缩中的有效性。具体来说,我们证明了FRAE与一个强大的神经声码器相结合,可以在低的固定比特率下产生高质量的语音波形。我们进一步证明,通过增加一个潜在空间的学习先验和使用熵编码器,我们可以实现更低的可变比特率。

成为VIP会员查看完整内容

相关内容

专知会员服务

13+阅读 · 2019年12月13日