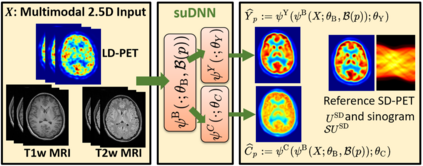

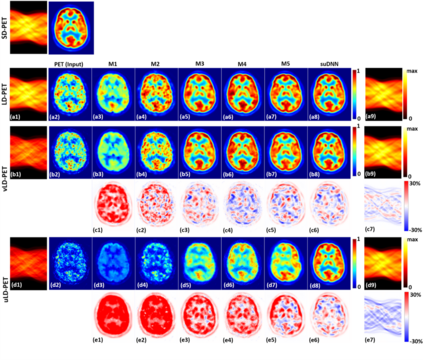

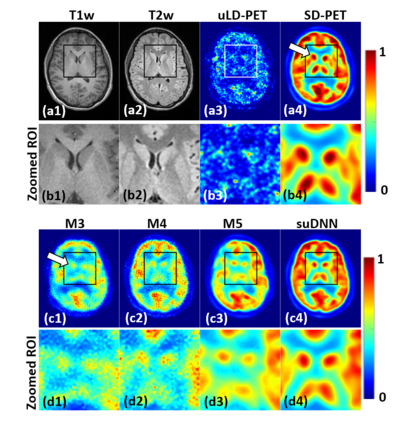

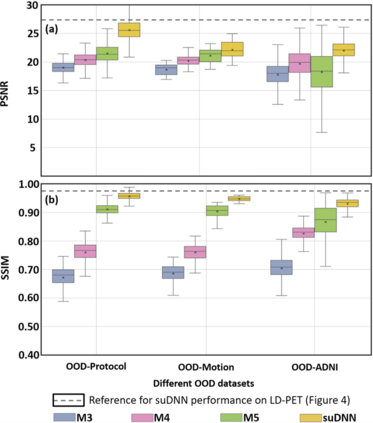

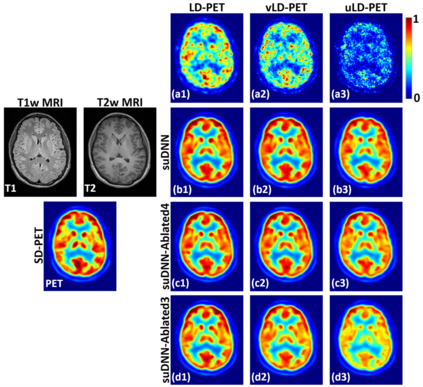

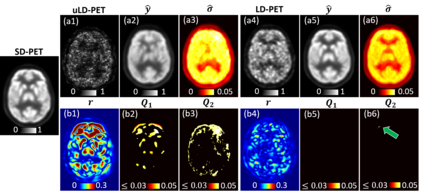

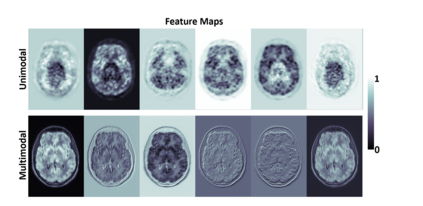

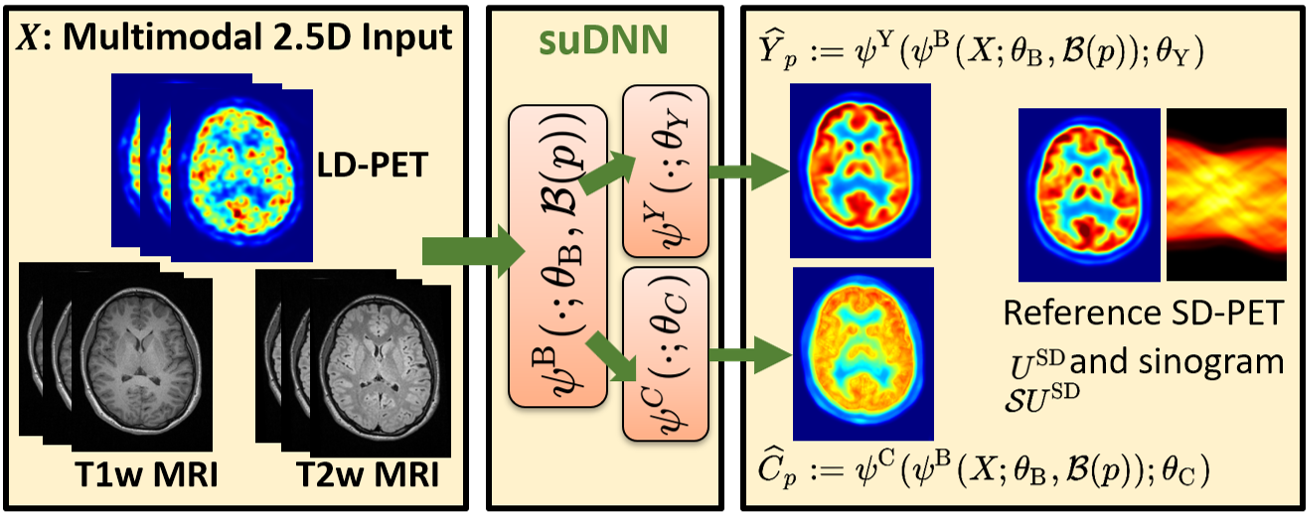

Radiation exposure in positron emission tomography (PET) imaging limits its usage in the studies of radiation-sensitive populations, e.g., pregnant women, children, and adults that require longitudinal imaging. Reducing the PET radiotracer dose or acquisition time reduces photon counts, which can deteriorate image quality. Recent deep-neural-network (DNN) based methods for image-to-image translation enable the mapping of low-quality PET images (acquired using substantially reduced dose), coupled with the associated magnetic resonance imaging (MRI) images, to high-quality PET images. However, such DNN methods focus on applications involving test data that match the statistical characteristics of the training data very closely and give little attention to evaluating the performance of these DNNs on new out-of-distribution (OOD) acquisitions. We propose a novel DNN formulation that models the (i) underlying sinogram-based physics of the PET imaging system and (ii) the uncertainty in the DNN output through the per-voxel heteroscedasticity of the residuals between the predicted and the high-quality reference images. Our sinogram-based uncertainty-aware DNN framework, namely, suDNN, estimates a standard-dose PET image using multimodal input in the form of (i) a low-dose/low-count PET image and (ii) the corresponding multi-contrast MRI images, leading to improved robustness of suDNN to OOD acquisitions. Results on in vivo simultaneous PET-MRI, and various forms of OOD data in PET-MRI, show the benefits of suDNN over the current state of the art, quantitatively and qualitatively.

翻译:红外线辐射暴露在红外射线透视成像(PET)成像中,在对辐射敏感人群(例如孕妇、儿童和成年人等需要纵向成像的孕妇、儿童和成人等)的研究中限制了其使用率; 降低PET放射性tracer的剂量或获取时间会减少光度计数,从而降低图像质量; 最近以深神经网络为基础的图像到图像转换方法(DNN)使得能够绘制低质量的PET图像(使用大量减少的剂量获得的),以及相关的磁共振成像(MRI)图像,以高质量的PET图像为主; 然而,这种DNNNT方法侧重于与培训数据统计特征相匹配的测试数据应用,很少注意评估这些DNNNN在新批发外(OOOOOD)采购方面的性能; 我们提出了一个新的DNNN,用以模拟(一) PET成像系统基于罪理学的定量物理学物理学基础,以及(二)通过每伏氧MRI 图像(MRI) 图像的精度和相应的高质量参考框架(即S-NON-DIMO-D) 的低度、低度图像的不确定性和低级的数值分析框架。