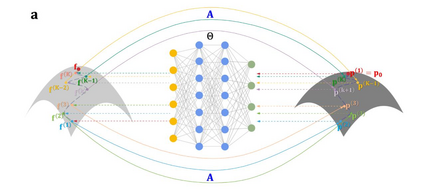

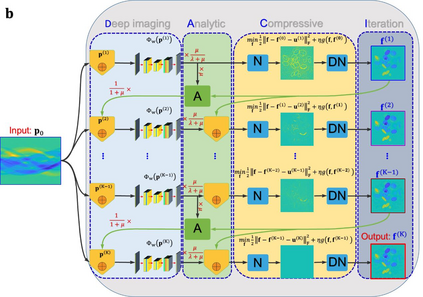

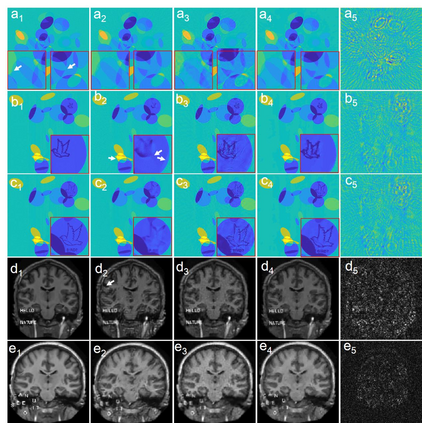

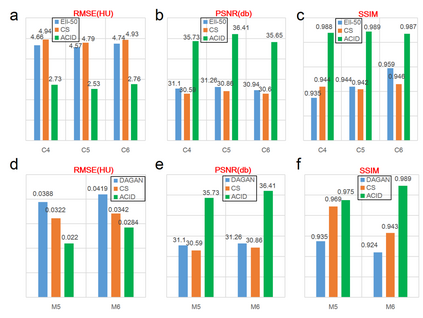

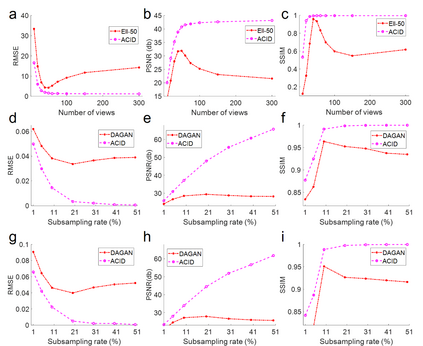

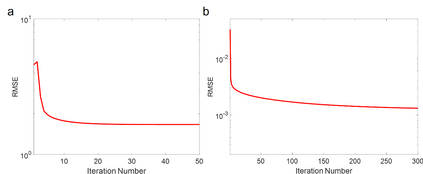

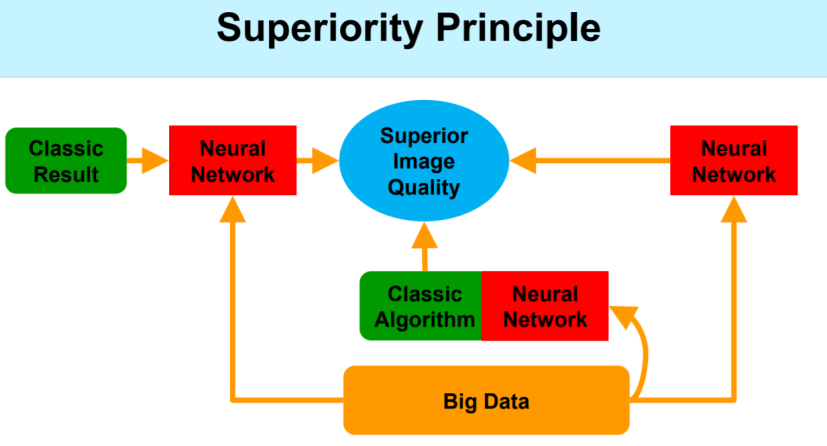

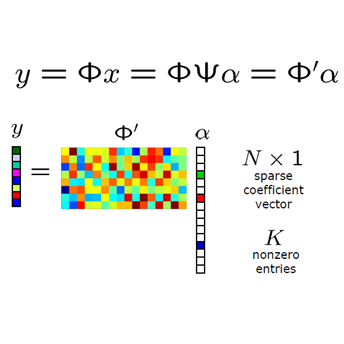

While the field of deep tomographic reconstruction has been advancing rapidly since 2016, there are constant debates and major challenges with the recently published PNAS paper on instabilities of deep learning in image reconstruction as a primary example, in which three kinds of unstable phenomena are demonstrated: (1) tiny perturbation on input generating strong output artifacts, (2) small structural features going undetected, and (3) increased input data leading to decreased performance. In this article, we show that key algorithmic ingredients of analytic inversion, compressed sensing, iterative reconstruction, and deep learning can be synergized to stabilize deep neural networks for optimal tomographic image reconstruction. With the same or similar datasets used in the PNAS paper and relative to the same state of the art compressed sensing algorithm, our proposed analytic, compressed, iterative deep (ACID) network produces superior imaging performance that are both accurate and robust with respect to noise, under adversarial attack, and as the number of input data is increased. We believe that deep tomographic reconstruction networks can be designed to produce accurate and robust results, improve clinical and other important applications, and eventually dominate the tomographic imaging field.

翻译:虽然自2016年以来深层地形重建领域进展迅速,但最近出版的关于图像重建中深层学习不稳定性的PNAS论文作为一个主要例子,不断进行辩论并面临重大挑战,其中展示了三种不稳定现象:(1) 产生强大产出文物的投入微小扰动,(2) 未探测到的小型结构特征,(3) 投入数据增加导致性能下降。在文章中,我们显示分析反转、压缩感应、迭接重建以及深层学习的关键算法成分可以协同增效,稳定深层神经网络,以进行最佳的图像图像重建。在PNAS论文中使用的相同或类似数据集,与艺术压缩感测算法的同一状态相比,我们提议的分析、压缩、迭代(ACID)网络产生超强的成像性能,与噪音、对抗性攻击下和投入数据增加有关,因此,我们发现深层成像重建网络可以设计出准确和稳健的结果,改进临床和其他重要应用,并最终控制成像场。