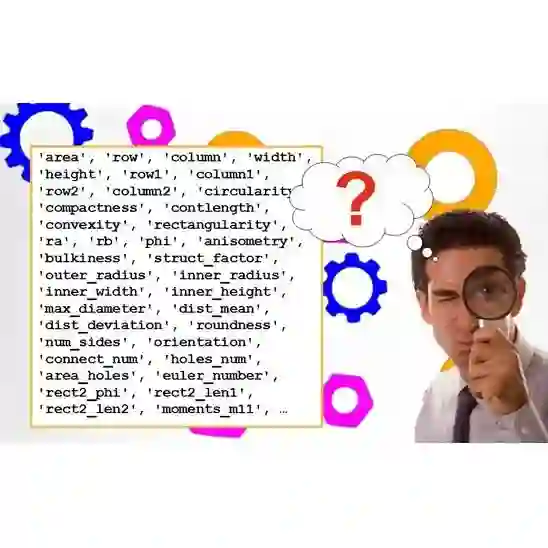

Training predictive models on high-dimensional datasets is a challenging task in artificial intelligence. Users must take measures to prevent overfitting and keep model complexity low. Thus, the feature selection plays a key role in data preprocessing and delivers insights into the systematic variation in the data. The latter aspect is crucial in domains that rely on model interpretability, such as life sciences. We propose UBayFS, an ensemble feature selection technique, embedded in a Bayesian statistical framework. Our approach enhances the feature selection process by considering two sources of information: data and domain knowledge. Therefore, we build an ensemble of elementary feature selectors that extract information from empirical data, leading to a meta-model, which compensates for inconsistencies between elementary feature selectors. The user guides UBayFS by weighting features and penalizing specific feature combinations. The framework builds on a multinomial likelihood and a novel version of constrained Dirichlet-type prior distribution, involving initial feature weights and side constraints. In a quantitative evaluation, we demonstrate that the presented framework allows for a balanced trade-off between user knowledge and data observations. A comparison with standard feature selectors underlines that UBayFS achieves competitive performance, while providing additional flexibility to incorporate domain knowledge.

翻译:高维数据集的培训预测模型是人工智能中一项艰巨的任务。用户必须采取措施防止过度配置和保持模型复杂性低。因此,特征选择在数据处理前处理中发挥着关键作用,并对数据中的系统变异提供了洞察力。在依赖模型可解释性的领域,如生命科学,后一个方面至关重要。我们建议采用包含在巴伊西亚统计框架中的混合特征选择技术UBayFS。我们的方法通过考虑两个信息来源,即数据和域知识,加强了特征选择过程。因此,我们建立了一套基本特征选择器,从经验数据中提取信息,导致形成一个元模型,以弥补基本特征选择器之间的不一致。用户指南以加权特征和惩罚特定特征组合的方式指导UBayFS。框架基于多种可能性和新版本的受限Drichlet型先前分布,包括初始特征权重和侧项限制。在定量评估中,我们证明所提出的框架允许用户知识与数据观测之间的平衡交易,从而形成一种元模型,从而补偿基本特征选择器之间的不一致。与标准特征选择器进行比较,同时提供具有竞争力的功能选择器。