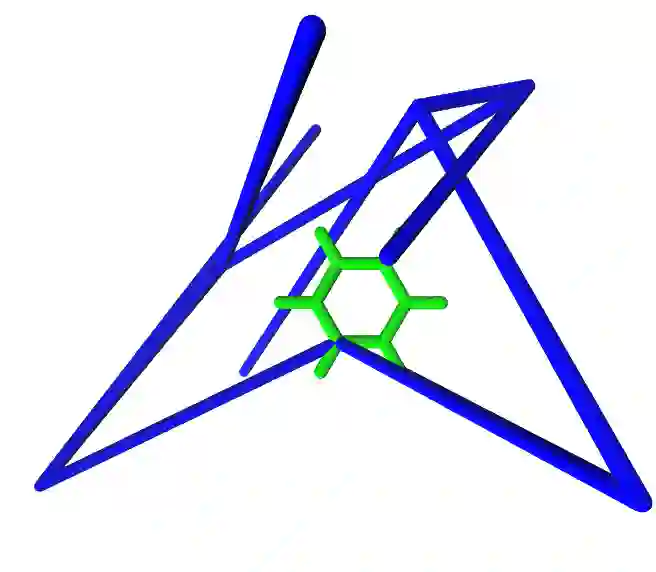

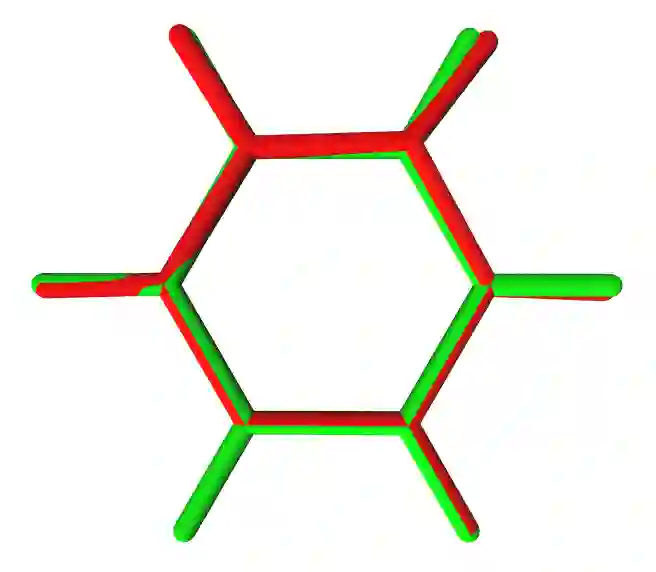

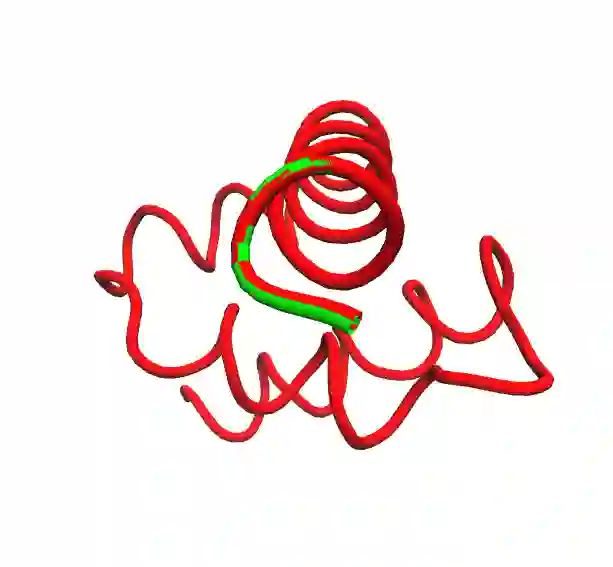

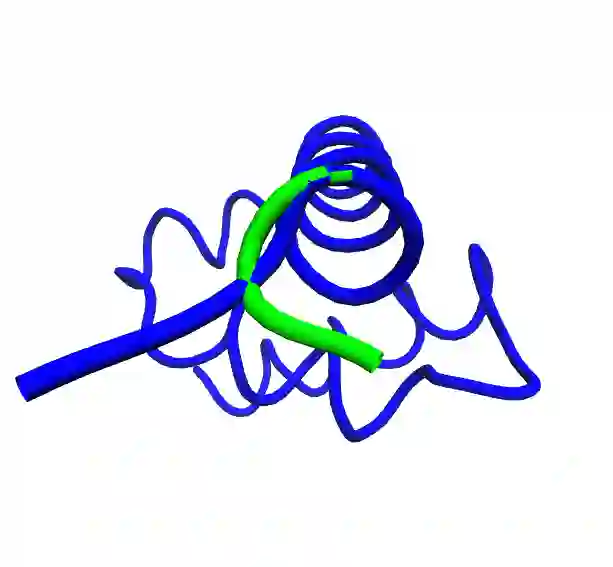

Monte Carlo (MC) methods are important computational tools for molecular structure optimizations and predictions. When solvent effects are explicitly considered, MC methods become very expensive due to the large degree of freedom associated with the water molecules and mobile ions. Alternatively implicit-solvent MC can largely reduce the computational cost by applying a mean field approximation to solvent effects and meanwhile maintains the atomic detail of the target molecule. The two most popular implicit-solvent models are the Poisson-Boltzmann (PB) model and the Generalized Born (GB) model in a way such that the GB model is an approximation to the PB model but is much faster in simulation time. In this work, we develop a machine learning-based implicit-solvent Monte Carlo (MLIMC) method by combining the advantages of both implicit solvent models in accuracy and efficiency. Specifically, the MLIMC method uses a fast and accurate PB-based machine learning (PBML) scheme to compute the electrostatic solvation free energy at each step. We validate our MLIMC method by using a benzene-water system and a protein-water system. We show that the proposed MLIMC method has great advantages in speed and accuracy for molecular structure optimization and prediction.

翻译:Monte Carlo (MC) 方法是分子结构优化和预测的重要计算工具。 当明确考虑溶剂效应时,由于与水分子和移动离子相关的大量自由程度,MMC方法变得非常昂贵。 另一种隐性溶液MC方法可以通过对溶剂效应应用一种平均的实地近似法,同时保持目标分子的原子细节,大大降低计算成本。两种最受欢迎的隐性溶解模型是Poisson-Boltzmann(PB) 模型和通用生化(GB)模型,其方式是使GB模型接近PB模型,但在模拟时间里速度要快得多。在这项工作中,我们开发了一种基于机器学习的隐性溶解溶液(MLMIMC)方法,将隐性溶剂模型在准确性和效率方面的优势结合起来。具体地说,MLIMC方法使用一种快速和准确的PB机器学习(PBMMM) 方法,在每一步步上对电静态溶解解脱能能源进行计算。我们验证了我们的MLIMC方法,使用苯水系统以及蛋白质-MLI的精确度系统。