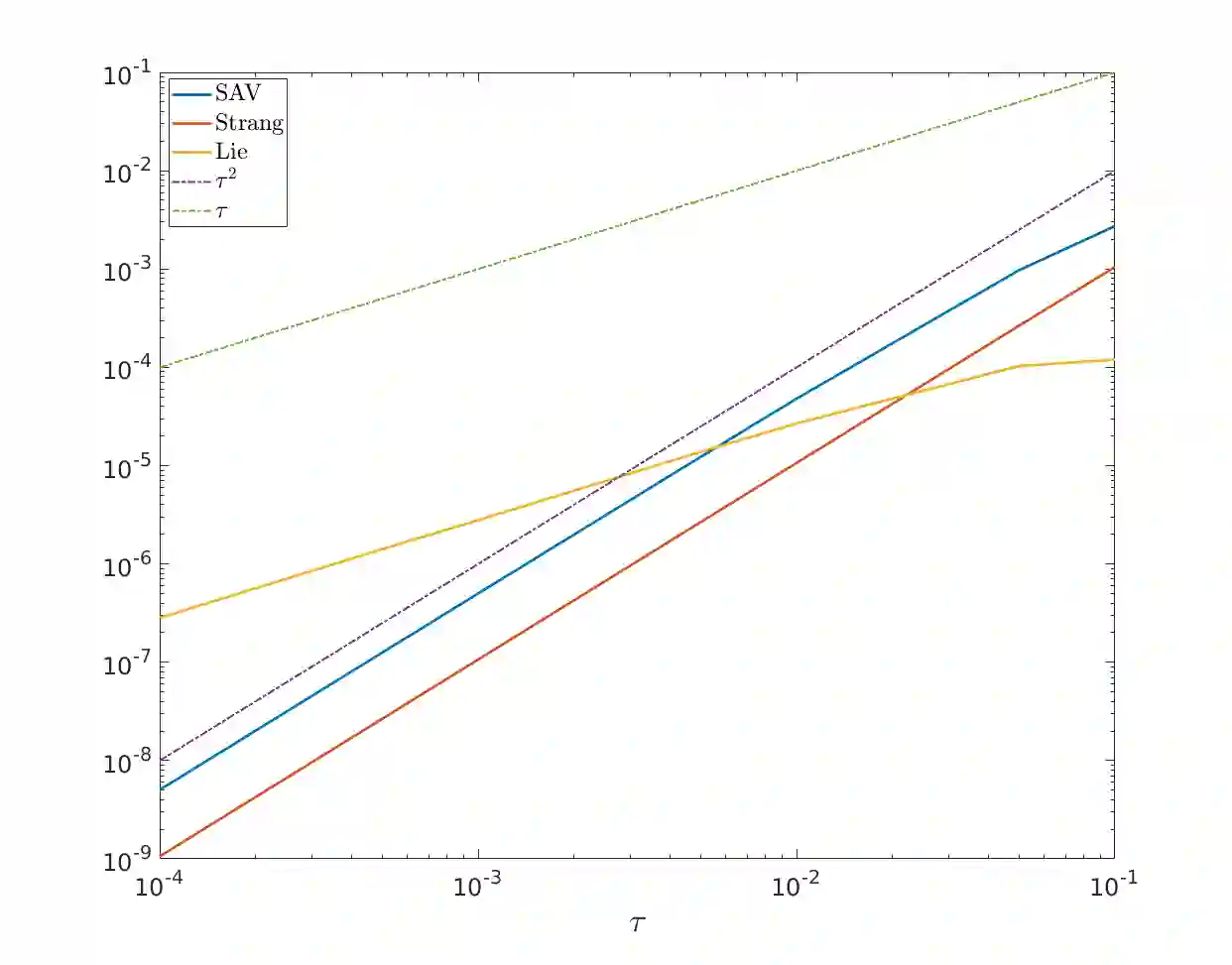

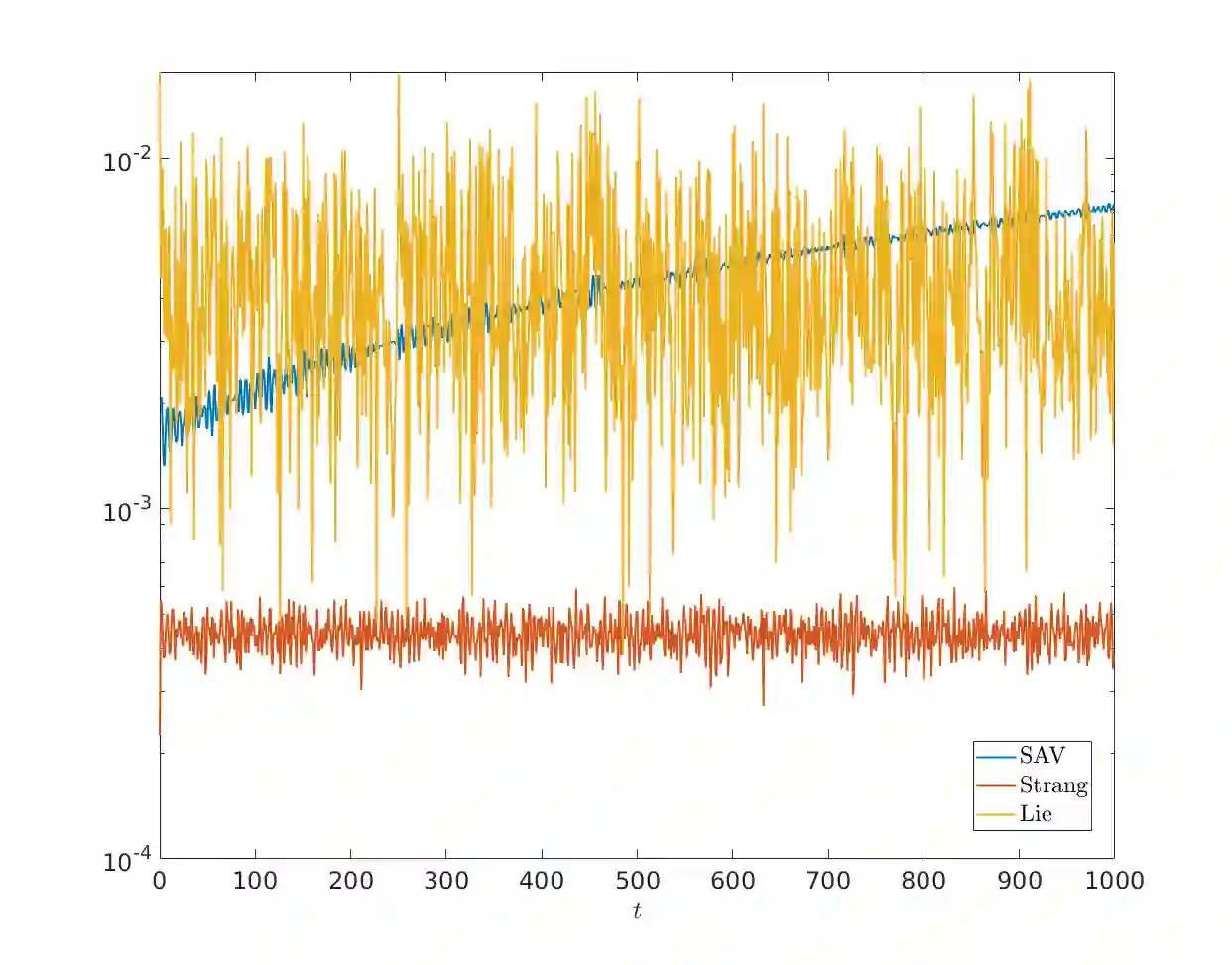

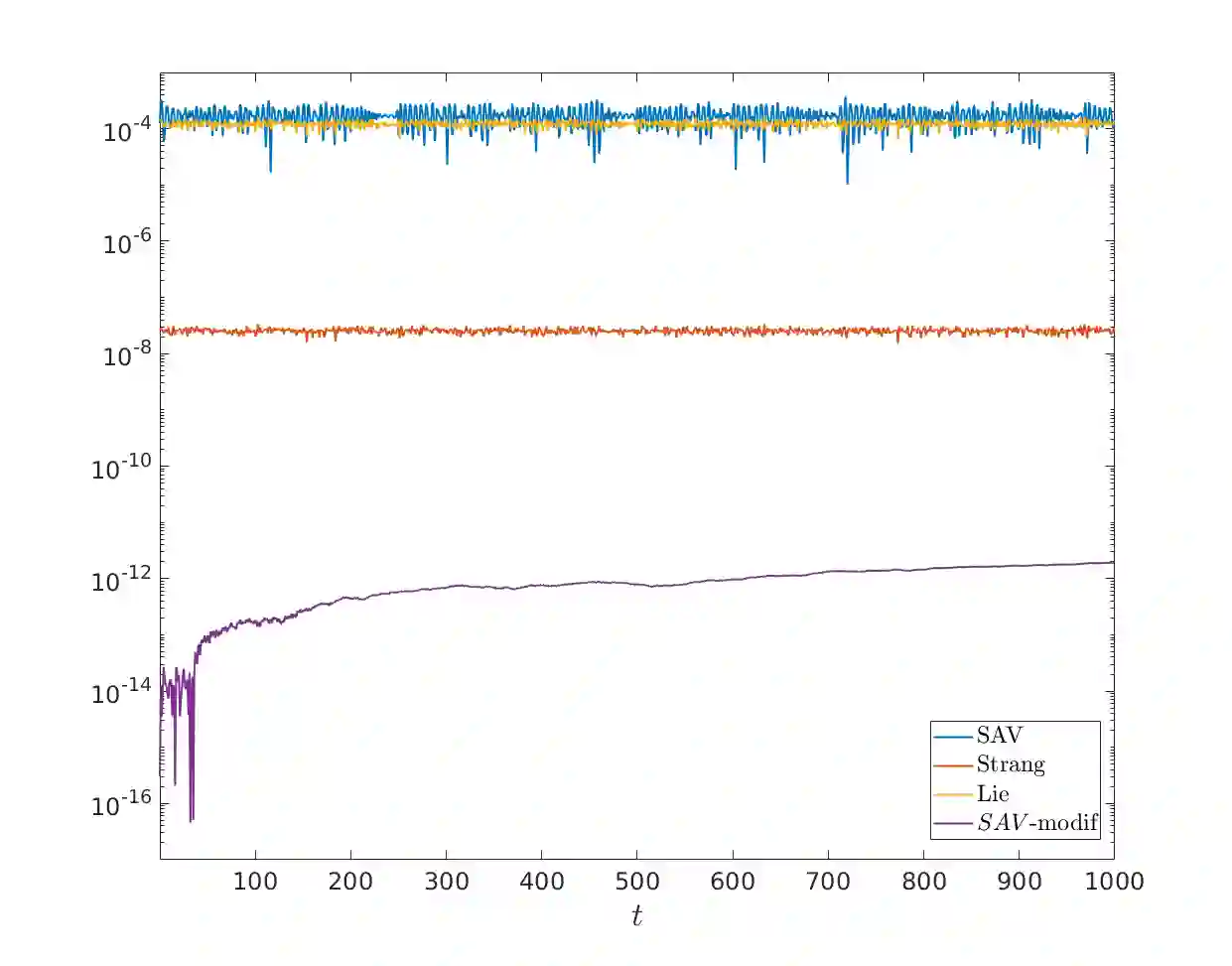

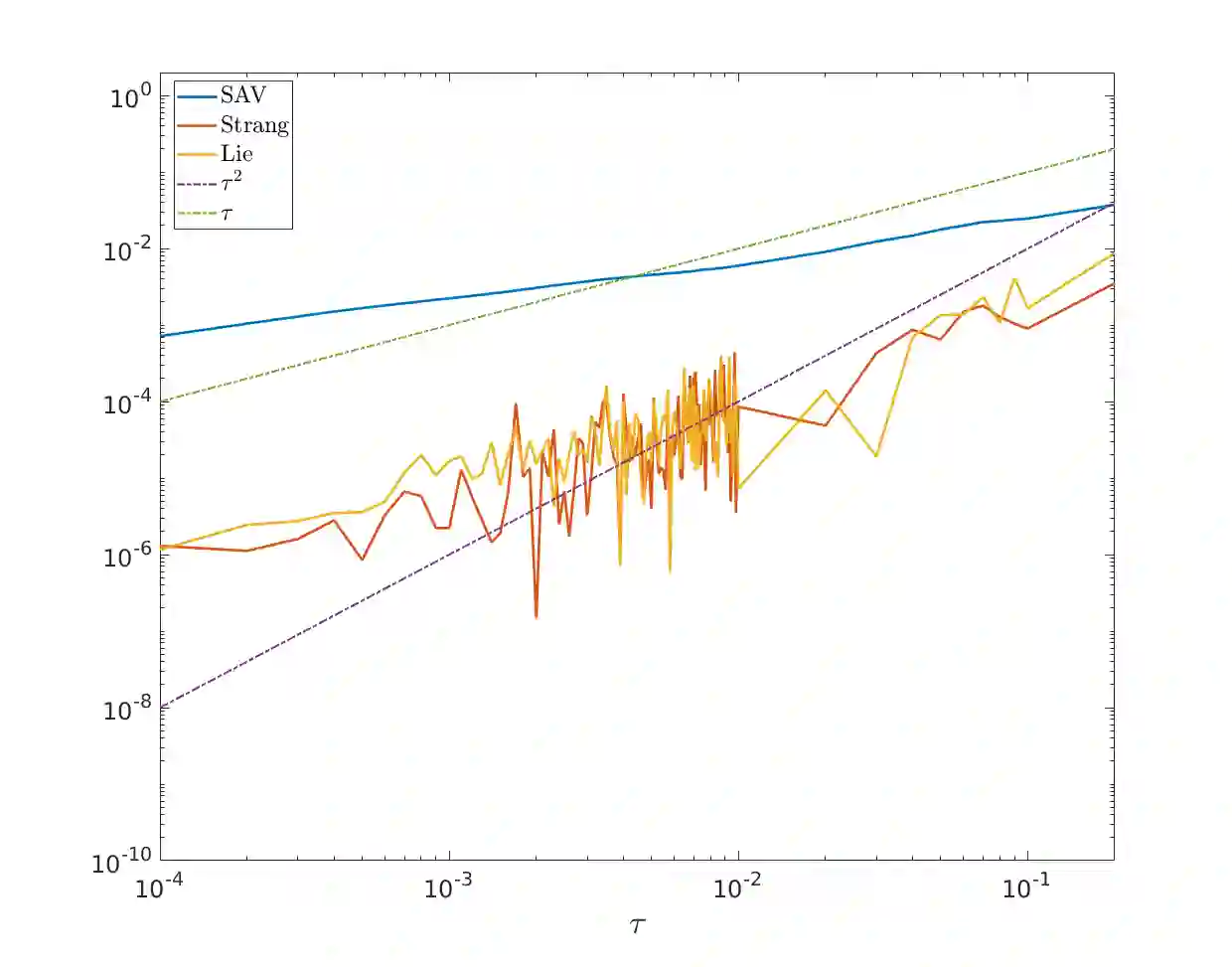

We carry out the convergence analysis of the Scalar Auxiliary Variable (SAV) method applied to the nonlinear Schr\"odinger equation which preserves a modified Hamiltonian on the discrete level. We derive a weak and strong convergence result, establish second-order global error bounds and present long time error estimates on the modified Hamiltonian. In addition, we illustrate the favorable energy conservation of the SAV method compared to classical splitting schemes in certain applications.

翻译:我们对适用于非线性Schr\'odinger方程式的Scalar辅助变量(SAV)方法进行了趋同分析,该方程式将修改的汉密尔顿人保留在离散水平上。我们得出了一个薄弱和强烈的趋同结果,确定了二级全球误差界限,并对修改的汉密尔顿人提出了长期误差估计。此外,我们举例说明了SAV方法与某些应用中传统的分裂计划相比,有利于节能。

相关内容

专知会员服务

19+阅读 · 2020年6月29日

专知会员服务

54+阅读 · 2020年3月5日

专知会员服务

36+阅读 · 2019年10月17日

Arxiv

0+阅读 · 2021年9月6日

Arxiv

0+阅读 · 2021年9月2日