项目名称: 使用L1范数的捆绑调整方法研究

项目编号: No.61203276

项目类型: 青年科学基金项目

立项/批准年度: 2013

项目学科: 自动化学科

项目作者: 戴志军

作者单位: 中国地震局地球物理研究所

项目金额: 24万元

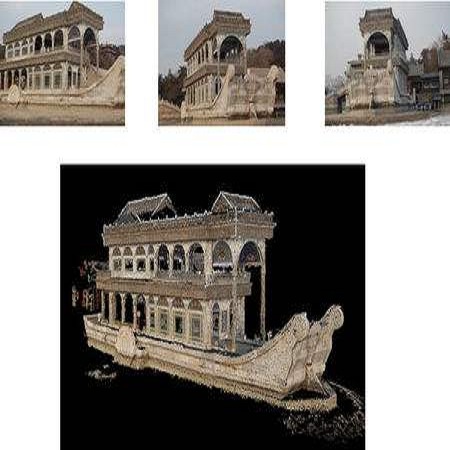

中文摘要: 捆绑调整是对具有稀疏耦合特征的参数进行优化的方法,这个方法在三维视觉研究领域有重要应用。经过四十多年的发展,这个方法在使用L2范数的情况下所涉及的理论、算法、及相关优化工具已经比较完善。但经典的L2方法在实际应用中存在对外点敏感的不足之处。L1范数具有和L2范数相类似的几何意义且对外点鲁棒,但采用L1范数存在不可微的问题,当前非线性L1范数的优化方法非常匮乏且效率不高。 为此,本课题研究具有稀疏耦合这种特殊形式的L1范数优化问题。重点解决三个科学问题:初始点选取、原始问题转换为一系列凸问题的高效求解方法、利用稀疏耦合性质的加速方法。然后把方法集成为工具包并应用到相关领域来迭代改进。通过本课题的研究,可望得到高效鲁棒的捆绑调整方法、提高三维重建的精度、改进相关领域的优化方法。因此,本课题的研究具有重要的科学意义和应用价值。

中文关键词: 捆绑调整;L1 范数;多视几何;三维重建;稀疏优化

英文摘要: Bundle adjustment is a method for optimizing parameters with sparse coupling properties. This method plays an important role in the research area of 3D vision. After 40 years development, the theories, algorithms, and tools related with the method using the L2 norm has been matured. However, the classical L2 method is sensitive to outliers in the practical applications. Using the L1 norm has the geometric meaning as well as the L2 norm and it is robust to outliers. However, using the L1 norm has the problem of non-differentiable, and currently for non-linear L1 norm there are only few optimization methods which are not efficient. Thus, we study the L1 norm optimization problem with the special form of sparse coupling. We will put our main efforts on three scientific problems which are the choosing of an initial point, efficient solutions for the methods of conversion from the original problem to convex problems, and the speedup methods by the properties of sparse coupling. After that, we will provide a toolbox for this problem and apply it to related fields for iterative improvements of the methods. Through the research of this project, we are expected to get efficient and robust methods of bundle adjustment, enhance the precision of 3D reconstruction, and improve optimization methods in related fields. Theref

英文关键词: bundle adjustment;L1 norm;multi-view geometry;3d reconstruction;sparse optimization