ECCV 2020 | 一键挑出高质量图像!中科大&微软提出挑图神器:GIQA

点击上方“CVer”,选择加"星标"置顶

重磅干货,第一时间送达

挑图神器:GIQA: Generated Image Quality Assessment

做生成模型的同学们,你们是不是或多或少都遇到过这个问题:用一个生成网络生成了一批图,为了挑选几张最好的做demo,可能要花费大量的时间精力。为了解决这个问题,我们给大家介绍一篇我们在ECCV 2020上的一个工作,在该工作中我们提出了一个全新的研究方向:生成图片质量评估(GIQA)。通过对单张生成图片质量的打分,我们可以“一键”挑出高质量的图。

论文地址:https://arxiv.org/abs/2003.08932

代码:https://github.com/cientgu/GIQA

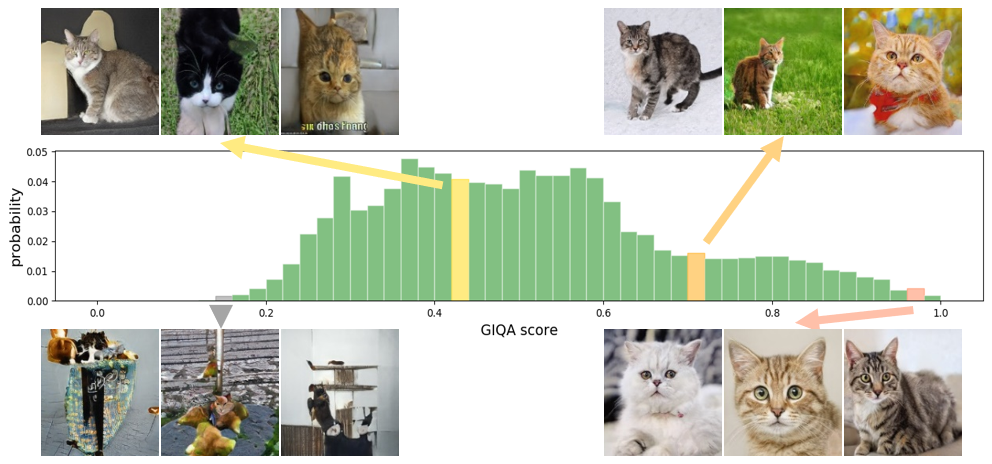

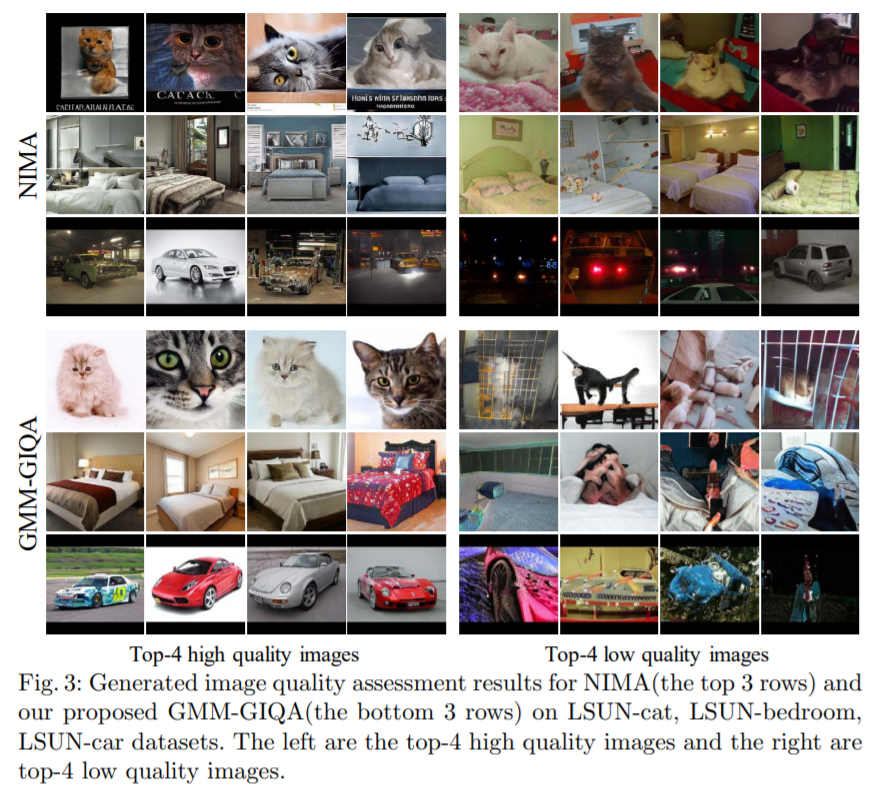

这些年来,深度生成模型取得了巨大的进展,诞生了很多有趣的应用,然而,并非所有生成的结果都很完美。如下图所示,图中四个角上的图片的图片均为StyleGAN在一个猫的数据集上生成结果。在这些图片中,既有很多高质量的猫(右下),也有很多图质量很差(完全看不出来是猫,左下)。

以往大家为了评估哪张图生成的好,往往都是要靠人来判断,这需要花费大量人力成本。在实际应用中,由于对于生成图片的最差质量缺少把控,很多产品遭受到了各种质疑。基于此,我们提出了生成图像质量评估(GIQA)这一研究方向,并希望实现评价算法以自动地对生成图片的质量进行打分。为了实现这个目的,我们提出了基于学习的,和基于数据的三种方法,利用这些方法,我们能够实现对生成图片的质量进行打分,同时实现很多有趣的应用。上图中展示了我们对一个模型的生成图片进行打分的分布结果,在右下,右上,左上,左下中我们分别展示了模型评价的从高质量到低质量的生成图片,可以观察到我们算法评价的质量基本上和人的评价是一致的。

下面我们将介绍我们是怎么实现用算法进行生成图片质量评价的。

基于学习的GIQA:

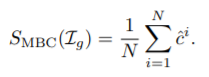

我们发现,在训练GAN的时候,生成图片的质量会随着迭代次数的增加越来越好。一个简单的想法是用迭代次数当质量的”伪标签”,通过监督式的学习,来学一个打分器,对生成图片的质量进行打分。然而,用迭代次数当质量并不精确,我们通过多个二分类器(Multiple binary classifiers)回归标签来平滑去噪,通过平均这些分类器的分数,可以极大的增强鲁棒性和泛化能力。我们称之为MBC-GIQA。

数据驱动GIQA:

我们重新思考质量评估这个问题,发现“质量”很难定义好。生成模型希望能生成服从已有的真实数据分布(real distribution)的图片,因此,我们认为”质量”表征的是一张生成图片和真实数据分布的接近程度。通俗的说,就是一张生成图片有多大可能性来自于真实分布。这个概率越大,表示质量越高。因此,另一个直观的想法是对真实分布直接建模。我们根据建模是参数化模型还是非参数化模型分成两部分。

参数化模型:GMM-GIQA:

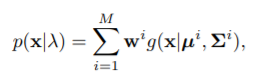

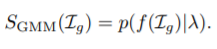

我们将用高斯混合模型(GMM)来拟合真实数据分布在特征层面的特征。对于一张待测的图片I,我们先提取他特征x, 这个特征x在真实数据分布中出现的概率就表示了该图的质量。

非参数化模型:KNN-GIQA:

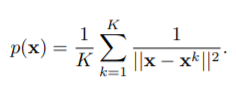

此外,我们还可以用K近邻(KNN)来对真实数据分布在特征层面建模。对于待测图片I及其提取的特征x,若它与真实图片距离越近,表示其出现的概率高,也就表示其质量高。

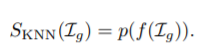

在我们收集的LGIQA质量评估数据集上,GMM-GIQA能取得最好的结果,远远超过传统的图像质量评估的方法。我们也最推荐大家使用GMM-GIQA的方法。我们也展示了图片显示我们的方法筛选出的图片相比传统的方法更符合人类的认知。

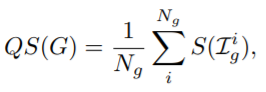

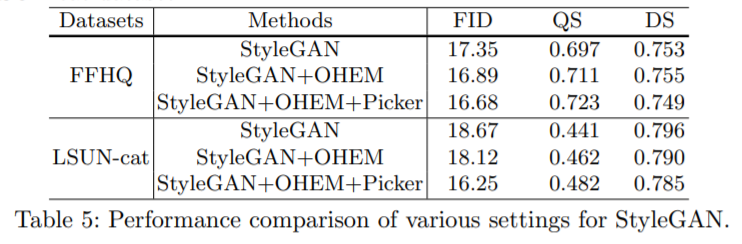

我们的方法还有很多衍生应用。其中一个是模型质量评估。对于生成模型,我们可以独立的衡量生成图片的质量和多样性。一批生成图片的质量的平均值可以用来衡量模型的生成图片质量,我们称之为Quality Score(QS).

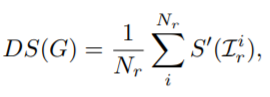

相似的,我们用一批真实图片在生成图片中的质量衡量的平均值当成模型多样性的衡量Diversity Score(DS)。

我们用这些方法在unconditional GAN和conditional GAN上有验证了其有效性。

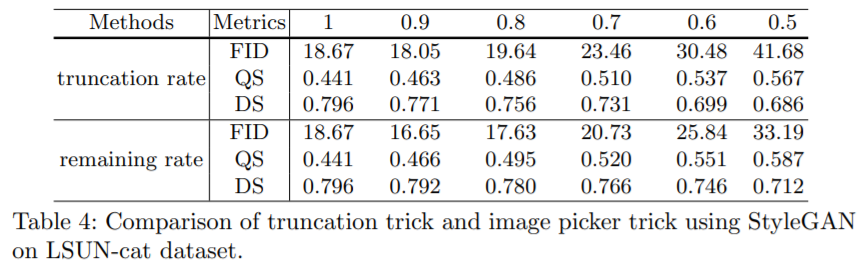

第二个有趣的应用是通过后处理丢弃一部分图片,让剩下的图片有更好的生成质量,我们验证了其比传统的truncation trick能更好的兼顾质量和多样性。

第三个应用是结合OHEM(Online Hard Example Mining),在GAN的训练过程中,通过给低质量生成图片更高的惩罚权重,我们可以让GAN生成出更高质量的图片。

最后总结一下,GIQA是一个新颖而且对研究和产业都很有意义的一个研究方向,我们提出了几种GIQA的方法,验证了其有效性与其具有的应用价值。相信通过本文的抛砖引玉,能有更多的人研究GIQA这个领域并对其他任务提供更多的参考价值。

下载

在CVer公众号后台回复:ECCV2020,即可下载上述内容

重磅!CVer-论文写作与投稿交流群成立

扫码添加CVer助手,可申请加入CVer-论文写作与投稿 微信交流群,目前已满2000+人,旨在交流顶会(CVPR/ICCV/ECCV/ICML/ICLR/AAAI等)、顶刊(IJCV/TPAMI等)、SCI、EI等写作与投稿事宜。

同时也可申请加入CVer大群和细分方向技术群,细分方向已涵盖:目标检测、图像分割、目标跟踪、人脸检测&识别、OCR、姿态估计、超分辨率、SLAM、医疗影像、Re-ID、GAN、NAS、深度估计、自动驾驶、强化学习、车道线检测、模型剪枝&压缩、去噪、去雾、去雨、风格迁移、遥感图像、行为识别、视频理解、图像融合、图像检索、论文投稿&交流、PyTorch和TensorFlow等群。

一定要备注:研究方向+地点+学校/公司+昵称(如论文写作+上海+上交+卡卡),根据格式备注,可更快被通过且邀请进群

▲长按加微信群

▲长按关注CVer公众号

点赞和在看!让更多CVer看见