赛尔译文 | 基础模型的机遇与风险 (四)

原文:On the Opportunities and Risks of Foundation Models 链接:https://arxiv.org/pdf/2108.07258.pdf 译者:哈工大 SCIR 张伟男,朱庆福,聂润泽,牟虹霖,赵伟翔,高靖龙,孙一恒,王昊淳,车万 翔(所有译者同等贡献) 转载须标注出处:哈工大 SCIR

编者按:近几年,预训练模型受到了学术界及工业界的广泛关注,对预训练语言模型的大量研究和应用也推动了自然语言处理新范式的产生和发展,进而影响到整个人工智能的研究和应用。近期,由斯坦福大学众多学者联合撰写的文章《On the Opportunities and Risks of Foundation Models》,将该模型定义为基础模型(Foundation Models),以明确定义其在人工智能发展过程中的作用和地位。文章介绍了基础模型的特性、能力、技术、应用以及社会影响等方面的内容,以此分析基于基础模型的人工智能研究和应用的发展现状及未来之路。鉴于该文章内容的前沿性、丰富性和权威性,我们(哈工大 SCIR 公众号)将其翻译为中文,希望有助于各位对基础模型感兴趣、并想了解其最新进展和未来发展的读者。因原文篇幅长达 200 余页,译文将采用连载的方式发表于哈工大 SCIR 公众号,敬请关注及提出宝贵的意见!

-

引言 -

能力 -

应用 -

技术 -

社会 -

结论

4.技术

4.1 建模

Authors: Drew A. Hudson, Antoine Bosselut, Alex Tamkin, Omar Khattab, Fared Quincy Davis, Fiaxuan You, Trevor Gale

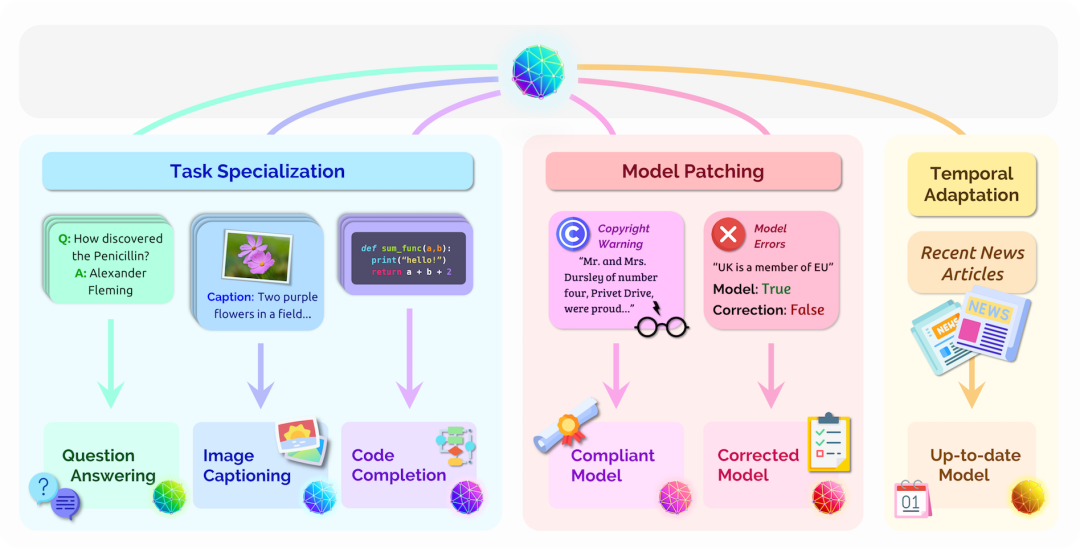

在这里,我们确定并讨论了五个这样的属性,包括表达性、扩展性、多模态性、存储性和组合性,我们认为这些属性对于一个基础模型来说是至关重要的:(1)提炼和积累来自不同来源和领域的知识,(2)以高效和可扩展的表示方式组织它,以及(3)灵活地把它泛化迁移到新的环境中。对于这些属性中的每一个,我们都阐述它们的必要性,提供包含这些属性的当代模型的例子,并探索未来研究和发展的关键挑战和有希望的实现途径。概况图见图1。

4.1.1 表达性

表达性涉及到网络在理论上和实践上对其训练的数据分布进行建模,并以灵活的方式表示它的能力。之前的工作提出了正式的表达性评价标准,以描述一个网络可以计算的功能的复杂性,或者更准确地说,近似的功能,这基本上受其深度、宽度、连接性和结构模式的影响 [Raghu et al. 2017]。

正如“没有免费的午餐”(NoFreeLunchBeorem)定理所表明的,没有一个单一的模型或算法最适合所有的情况[WolpertandMacreadyl997],因此,对于我们的目的,我们特别感兴趣的是确定哪些模型可以有效地捕捉自然信息的某些特定方面,如人类语言或现实世界的图像[Goodfellowetal.2016]。这些模式要么是连续的(如视觉),要么是离散的(如语言),具有明显的层次性和高维度,并且在其组成元素之间呈现出一系列复杂的关系和互动,无论这些元素是像素、文字还是物理对象。

事实上,生成模型最近在建模方面的突破为神经网络的高表达性提供了强有力的证据, 因为它们成功地表达了文本[Brown et al. 2020; Devlin et al. 2019; Lieber et al. 2021; Wang and Komatsuzaki 2021]、听觉[van den Oord et al. 2016]和视觉[Karras et al. 2020; Brock et al. 2018] 领域的分布,并产生高逼真度、多样性和真实性的样本。

归纳偏好。 过去十年中,神经网络在自然数据建模方面的成功很大程度上归功于网络的深度,这可以通过它们所组成的堆叠的非线性层的数量或它们在推理链中的计算步骤的数量来大致衡量。大深度在提高网络的表达力方面起着至关重要的作用,使它们能够形成强大的分层和分布式表征,可以从训练数据到新的未见过的例子进行泛化[He et al. 2016b; Levine et al. 2020] 。

通用近似定理[Lu et al. 2019b]确实指出,即使是简单的多层感知器(MLPs)也能代表广泛的函数集,而不同的归纳偏好,如在循环神经网络(RNN)或卷积神经网络(CNNs)中实现的偏置[Goodfellow et al. 2016],可以提高学习效率,增强特定网络对不同形式信息的建模能力:前者是语言、语音和时间序列中常见的顺序数据,后者则是图像或视频中的空间变量信息。

Transformer与注意力。 同时,最近引入的Transformer[Vaswani et al. 2017]表明了捕捉长距离依赖关系和元素之间成对或高阶互动的重要性。它们建立在自注意力机制[Vaswani etal.2O17; Bahdanauetal.2O14]的基础上,该机制能够缩短计算路径,并提供直接的手段来比较输入数据上距离较远的元素(例如一个代词和它在一个句子中的先行词,或者两个提到相同主题的句子)。

从另一个角度来看,注意力和门控结构(如LSTM[Hochreiter and Schmidhuber 1997]或Mixture-of-Experts[Shazeer et al. 2017])中体现的乘法交互,为MLP和CNN的固定权重计算提供了更灵活的选择,动态地使计算适应当前的输入。这对语言建模特别有用,例如,给定一个像“She ate the ice-cream with the X”这样的句子,虽然前馈网络总是以相同的方式处理它,但基于注意力的模型可以根据输入调整其计算-如果介词短语(PP)附属词X是“spone”,则更新“ate”这个词的上下文表述;如果X是指“strawberries”,则将其与“ice-cream”联系起来。[Zavrel et al. 1997]。

通用的计算。 与之前的架构相比,注意力的最后一个明显优势源于其更强的通用性,即它不与特定的任务或领域紧密相连,就像卷积的局部感受域或递归网络的顺序假设一样,两者都反映了视觉和语言模态的固有特性。我们假设,注意力和Transformer的通用性质有助于它们广泛适用于各种研究问题和应用[Liu et al. 2019; Dosovitskiy et al. 2020; Hudson and Zitnick 2021]。

这种对比捕捉到了任务限定和表达性之间更普遍的权衡:具有更强结构性预设的模型可以利用它们来提高受益于这些假设的特定任务的样本效率;而反过来,整合了较弱归纳偏好的模型学习得更慢,但反过来可以扩展到更大的数据量并适应多样化的领域,因为它们不依赖限制性或特定任务的假设。随着数据和计算资源变得更容易获得,我们观察到,探索具有最小的归纳偏好的模型,可以“让数据自己说话”,似乎是该领域未来研究的一个更有前途的方法。

挑战和未来方向。 尽管神经网络,特别是基础模型在表达能力方面取得了巨大的进步和成就,但仍存在明显的挑战。主要的方法[Choromanski et al. 2020; Dosovitskiy et al. 2020] 一直在为极长距离的依赖关系建模而努力,例如那些出现在书籍、电影甚至DNA序列中的依赖关系,这可能要归因于当前基于Transformer的方法的二次方的计算量[Wang et al. 2020c; Lin et al. 2021]。

这一挑战本质上反映了效率和表达力之间的权衡:通过短而直接的计算路径对长距离交互进行明确建模,一方面提高了表达力,但另一方面,由于连接性的增加所带来的计算,可扩展性受到影响[Child et al. 2019; Kitaev et al. 2020; Choromanski et al. 2020]。GANformer[Hudson and Zitnick 2021]和 Perceiver[Jaegle et al. 2021b,a]等模型探索了平衡这两种特性的Transformers,该Transformers依赖于双点或瓶颈注意力,因此在保持高扩展性的同时提高了计算效率。我们认为,在这两个目标之间确定一个有效的平衡点为未来的研究提供了一个有趣的途径。

另一个重要的研究方向与基础模型的扩展有关,到目前为止,基础模型主要集中在语言领域[Peters et al. 2018; Devlin et al. 2019; Brown et al. 2020],涉及不同的模态,如结构[Scarselli et al. 2008; Velickovic et al. 2017]和感知[Tolstikhin et al. 2021; Jaegle et al. 2021b; Tan and Le 2021],每个模态涉及一系列独特的相关挑战。同样,我们认为,探索推理的架构(§2.4: 推理), 要求迭代计算链和与符号信息的互动,构成了未来基础模型研究的一个有价值的目标。

4.1.2 可扩展性

与模型的表达性密切相关的是可扩展性的概念。随着来自不同来源的丰富数据变得更加容易获得,计算资源变得更加强大和高效(§4.4:系统),我们应该寻找方法来匹配这种进步速度,并利用它来提高人工智能的能力和通用性。为了使基础模型能够有效地适应复杂的高维分布的图像或文本,它们应该在所有层面上具有可扩展性:包括模型的深度和宽度, 以及它们的训练时间、参数数量和它们能够处理的数据量。

优化。 具体来说,基础模型应该同时具备以下特点(1)易于训练(§4.2:训练),具有对数据中的噪声或瑕疵的弹性,以及对不稳定因素的鲁棒性,如梯度消失[Helfrichetal 2018; Glorot and Bengio 2010]或梯度爆炸[Hochreiter and Schmidhuber 1997; Nair and Hinton 2010],而且(2)易于适配(§4.3:适配),能够克服灾难性遗忘现象[Kirkpatrick et al. 2017]和支持少试学习[Sung et al. 2018]。我们仍然处于理解驱动学习算法可扩展性原则的早期阶段, 虽然最近的工作已经开始对这些主题进行一些说明[Liu et al. 2020b; Kuditipudi et al. 2019; Nakkiran et al. 2019],但还有很多工作要做。

硬件兼容性。 除了鲁棒性和优化方面,基础模型还应该具有实际效率(§4.4: 系统),并利用当代和未来的硬件[Hooker 2020]。这方面的一个例子是并行性,这是由GPU支持的计算的一个重要属性。事实上,相对于之前占主导地位的循环方法,Transformer的巨大成功在很大程度上是由其更高的并行性驱动的。

展望未来,考虑到系统开发的快速进展,我们应该进一步确保模型的设计能够共同适应未来的硬件发展。因此,基础模型最好能够适用于分布式训练等方案,这种方案越来越流行,例如Mixture-of-Experts,,并可能利用计算或表示的稀疏性等特性,例如Longformer[Beltagy et al. 2020]、Big-Bird[Zaheer et al. 2020]和Sparse Transformer[Child et al. 2019]等方法,这些方法可能会在未来硬件和处理器中变得更为重要。

4.1.3 多模态性

4.1.4 存储性

4.1.5 组合性

4.1.6 总结

4.2 训练

Authors: Alex Tamkin

训练目标是描述如何将模型架构和大量数据转换为基础模型的数学函数。例如,GPT-3 使用语言建模目标进行训练,该目标奖励模型正确预测下一个单词[Shannon 1948]。我们首先列出这些训练方法的一些训练目标,描述当前方法中重要的权衡点,并对未来发展方向进行概括。

4.2.1 Goals of training objectives

鉴于最近该方面研究的快速进展,我们在这里只对训练算法的一些关键目标进行概括。2

2 我们使用"training"而不是"pretraining",一方面是希望强调基础模型本身的首要地位,另一方面是因为一些适应下游任务的基础模型不涉及任何后期训练。

利用广泛的数据。 自监督学习算法的兴起解锁了隐藏在难以通过手工注释获取的互联网规模数据集中的潜力。这种数据有多种形式,包括图像、录音和视频(§2.2: 视觉);机器人和传感器数据(§2.3: 机器人学);既可以单独使用,也可以与其他形式(如图像)配对(§2.1: 语言)使用的文本数据。由于这些数据缺乏外部注释,研究人员的主要关注点是为其定制自监督算法,利用每种数据中的独特结构为基础模型生成训练信号。

领域完整性。 基础模型训练算法的一个重要目标是达到领域完整,训练算法需要使模型对领域中的下游任务具有广泛的适用性(参见§2.1: 语言, §2.2: 视觉, §2.3: 机器人学)。此属性对于基础模型的泛化能力至关重要。例如,语言建模可能要求模型在学习预测文档中的下一个单词时获得诸如共指、情感和翻译等通用能力。相比之下,像情感分类这样的监督学习任务可能会习得更狭窄范围的能力(参见 §2.1: 语言)。同时,哪些任务将带来领域完整能力,甚至如何评价模型功能的全部维度都不存在明显的先验(参见 §4.4: 评价 和 §4.10: 理论)。

规模和计算效率。 训练基础模型的过程必须可靠地将数据、模型架构和计算转换为功能多样的模型。为了最大化基础模型的能力,我们需要确定训练过程的瓶颈,并提出新的训练算法来消除它们。自监督算法的兴起使模型大小和计算资源成为越来越突出的瓶颈 [Kaplan et al. 2020; Henighan et al. 2020],导致对模型评价不仅需要考虑其能力大小,还需要考虑获得这些能力所需要的计算量与计算类型(§4.4: 评价)。不同训练目标的效率可能会有很大差异3,在固定计算预算的情况下,训练方法的设计对于获取强大的模型至关重要。因此,训练算法研究人员的一个主要目标是设计具有更丰富训练信号的训练目标,从而提高学习速度并获得更强能力的模型。4 推动这方面发展的一个关键因素是模型能力在不同类型的架构、计算和数据量下的变化具有惊人的可预测性 [Hestness et al. 2017; Kaplan et al. 2020],这是一个引人注目的现象,它使模型开发人员能够根据相对清晰的趋势而不是昂贵的随机搜索做出选择。

3 例如,ELECTRA [Clark et al. 2020] 是 BERT [Devlin et al. 2019] 效率的四倍;用于 CLIP 的对比训练方法与生成训练方法之间的差异是12倍[Radford et al. 2021]

4 当然,计算机系统设计人员的一个关键目标是减轻训练中的算力瓶颈(参见§4.5: 系统)并且训练方法的选择最终也受到多样化、高质量数据(§4.6: 数据)的可用性的限制,这一点也是包括机器人技术(§2.3: 机器人学)和低资源语言(§2.1: 语言)等许多领域的主要挑战。

4.2.2 当前 SSL 方法中的设计权衡

当前用于训练基础模型的自监督学习(SSL)方法多种多样,它们的共同点是,它们无需人工注释即可从未标记的数据中转换出可用于训练的预测问题。SSL 通过精心设计的约束来从未标记数据中生成丰富的训练信号,这些约束有些在数据本身(例如,编辑或噪声)方面,有些在模型能够表示或处理数据的方式方面(例如,潜在瓶颈)。在某种程度上,这些约束“烘焙”了模型应用在下游任务时所需的各种能力(§4.3: 适配)。5

5 例如,用于训练 GPT-3 的因果语言建模目标 [Brown et al. 2020] 通过语言前缀来训练模型。对比学习使用的颜色抖动增强 [Chen et al. 2020c] 鼓励保持对下游任务没有用的属性的不变性。深入理解这些约束的特定选择和结构如何影响模型获得的能力是未来工作的一个重要领域(§4.10: 理论)。

在这里,我们描述了当前模型探索的三个重要设计选择,以及它们各自在最终获取能力方面的权衡。

我们应该在什么抽象级别进行建模? 一个基本问题是基础模型的输入表示应该是什么。一种选择是在原始字节级别对输入进行建模。然而,这种高维度输入可能会导致模型专注于输入信息的语义层级较低的方面6 \footnote{例如,背景中的杂草、音频的压缩方式或单词的拼写方式},减慢了它获得更加通用的能力的速度。当训练像Transformer 这样的计算成本随输入大小成二次方增长的模型时,这些方法也变得难以使用 [Vaswani et al. 2017]。7另一种选择是使用领域知识来减少模型的输入空间—此类策略包括补丁嵌入[Dosovitskiy et al. 2020] 以及固定的或学习得到的标记化策略[Schuster and Nakajima 2012; Sennrich et al. 2016; Kudo and Richardson 2018; van den Oord et al. 2017; Ramesh et al. 2021]。这些方法可能会缓解生成式方法面临的一些挑战,但也有可能会丢弃输入中有用的信息。8 选择连续输入还是离散输入也需要进行针对适配性(§4.3: 适配 作出权衡);我们需要推进更多的工作来权衡这两种方法的好处。

6 例如,杂草、音频压缩伪像或单词拼写

7 查看 §2.2: 视觉 和§4.1: 建模 中对例如图像和视频等高维数据的训练成本的讨论

8 例如,标记文本可能会阻碍学习押韵、双关语或其他受益于字符级信息的任务 [Branwen 2020]

生成式模型与判别式模型 生成式训练方法在概念上优雅且功能强大— 它们训练模型以学习输入的联合或条件分布。生成基础模型的两大家族包括自回归基础模型 [van den Oord et al. 2016; Radford and Narasimhan 2018; Chen et al. 2020d; Yang et al. 2019; Ramesh et al. 2021],它们逐块生成输入,以及降噪基础模型 [Devlin et al. 2019; Raffel et al. 2019],它们在训练中先对输入进行破坏并指导模型对输入进行恢复。训练模型的不同方法也决定了适配下游任务期间可用的交互类型9(详见§2.5: 交互 和§4.3: 适配)。未来的模型可能会存在更丰富的交互方式。10

9 例如,像 GPT-3 这样的自回归模型可启用基于前缀的调节,而像 T5 或 BERT 这样的降噪模型则可使用双向上下文替换任意长度的跨度及修复拼写错误。

10 其他在基础模型领域研究较少的生成式方法包括基于扩散和分数的模型 [Sohl-Dickstein et al. 2015; Song and Ermon 2019; Ho et al. 2020]、VAEs [Kingma and Welling 2014]、流模型 [Dinh et al. 2015; Kingma and Dhariwal 2018] 和 GANs[Goodfellow et al. 2014] — 这些方法是否也能像自回归或去噪方法一样实现广泛能力的学习还有待观察。

虽然生成式训练方法有其好处,但最近一些判别方法也受到了关注。这些方法不能实现基于生成的交互,但它们可以在高维连续设置(如图像、音频和视频)中为基于分类或回归的任务提供更有效的学习。大多数这些方法为输入或部分输入输出相应的向量,这些向量被训练为在输入的不同“视图”下相似或被用来预测输入的各部分是真实的还是虚假的[Clark et al. 2020; Iida et al. 2021]。更好地理解生成式训练和判别式训练之间的权衡,以及捕捉两种方法的优点,仍然是未来研究的有趣方向。

捕获多模态关系。 另一个越来越重要的研究领域是捕获多种数据之间的关系。这可能因建模者的上下文和目标变化而存在不同的含义。例如,CLIP [Radford et al. 2021] 和 ViLBERT [Lu et al. 2019a] 都是多模态视觉语言,但在实现多模态的具体方式上有所不同。11前者将图像和文本分别编码为向量,使拥有来自单一模态的示例的用户能够检索、评分或分类来自其他模态的示例。后者在模型的早期阶段联合处理图像和文本,支持下游应用程序,如视觉问答,其中提供对相关图像和文本对(例如,图像和关于它们的问题)的推理。多模态基础模型仍然是一个新兴的研究领域;在模型实现多模态的不同方式以及更好地理解这些附加模态带来的功能等方面,仍有很多未探索的地方。

11 在 §2.2: 视觉 和 §2.1: 语言 查看有关视觉和语言中多模态的更多讨论

4.2.3 前进的道路

本章节的最后,我们对未来基础模型训练的一些重要目标进行讨论。

Out-of-the-box SSL 目前,SSL 训练方法是高度特定于领域的:在自然语言处理、计算机视觉和语音处理中流行的是不同的方法。这有两个主要缺点:首先,这些不同的技术使得掌握潜藏在为什么每种方法有效下共同线索和科学原理变得具有挑战性。其次,这种领域特异性使得我们需要为每个新领域(包括医学、科学和新的多模态设置)从头开发新的基础模型训练方法。能够在任何类型的数据上有效训练基础模型的更一般的训练目标将成为基础模型训练社区 [Tamkin et al. 2021a] 的一个重要里程碑。

获得丰富的训练信号 很明显,并非所有的训练目标都是相同—有些训练目标比其他训练目标效率更高,能够将给定的计算预算转化为更强大的基础模型。是否有比目前已知的方法更有效的训练方法?如果是这样,我们怎样才能找到它们?这些调查将受到多种因素的影响,包括未来的软件和硬件进步(§4.5: 系统)带来的新的可能。我们也不需要将数据(§4.6: 数据)和训练算法视为独立因素:不仅数据的质量和可用性会影响训练信号,12 随着模型的改进,训练算法本身也可能自适应地寻找或构建更丰富的训练示例以加速学习[Tamkin et al. 2021b]。

12 包括任何不受欢迎或有偏见的能力(§5.1: 不平等和公平 )

目标导向的基础模型训练。 诸如提示信息(§4.3: 适配)之类的适配方法利用了基本上训练之后才会产生的即时属性。我们能否将在复杂世界中理解和可靠执行目标作为模型训练目标的一部分?专注于开发通用能力将这一方向与通过强化学习(Stiennon et al. [2020])使现有基础模型适配特定任务区分开来。人们可以想象当前方法的更复杂版本,它们从原始的在线[Klyubin et al. 2005; Singh et al. 2005; Salge et al. 2013; Shakir Mohamed 2015; Florensa et al. 2017; Pathak et al. 2017; Haber et al. 2018] 或离线 [Precup et al. 2000; Lange et al. 2012; Ajay et al. 2021; Yang and Nachum 2021; Schwarzer et al. 2021] 或离线[Precup et al. 2000; Lange et al. 2012; Ajay et al. 2021; Yang and Nachum 2021; Schwarzer et al. 2021] 交互中获得各种现实世界的能力,而无需人工注释或任务构建。此类方法可能使用与现有 SSL 算法非常相似的技术:例如,在目标导向的上下文中训练序列模型,它们可以被直接要求自我调节来执行某些任务(例如,UDRL [Schmidhuber 2019; Srivastava et al. 2019] 或决策转换器 [Chen et al. 2021b];另见§2.3: 机器人学)。在简单的交互环境中已经出现的复杂行为 [Baker et al. 2020] 表明基础模型的多任务、多智能体和多模态目标导向训练是未来研究的有趣途径。

4.3 适配

Authors: Xiang Lisa Li*, Eric Mitchell*, Sang Michael Xie, Xuechen Li, Tatsunori Hashimoto

虽然基础模型提供了一个强大的通用引擎来处理多模态信息,在使用前适配化基础模型对于某些应用程序是必要的。从广义上讲,适配程序依据附加信息对基础模型进行调节来产出适配模型,或者通过包含新数据或提示的输入来启动基础模型,或者通过更新部分或全部基础模型的参数以反映新讯息。例如,在文本摘要中,在输入文章后附加诸如TL;DR之类的提示可以通过充当任务说明来提高基础模型性能[Radford et al. 2019]。除此之外,使用组织的内部特定领域数据微调基础模型的参数可以通过添加与组织用例相关的信息来提高模型的准确性。在本节中,我们描述了现有的适配方法以及确定特定适配程序是否适合特定环境的几个因素。我们还描述了适配基础模型的各种用例,包括相对研究完善的设置,例如将基础模型专门化到特定任务或领域,以及相对推测性的设置,如测试时数据删除[Bourtoule et al. 2019] 和编辑模型在特定输入[Sinitsin et al. 2020]上的行为。最后,我们为基础模型适配的未来研究提出了一个长期目标。

4.3.1 基础模型适配方法

已经提出了许多适配基础模型的方法,这使得决定which 适配程序用于特定问题或计算环境变得困难。我们强调从业者在选择适配程序时要考虑的三个特别重要的因素:(1) 计算预算(特别是存储空间和内存大小);(2) 可用的特定任务数据量;(3) 获得基础模型梯度的范围。

因素 1:计算预算。 对于具有数十亿或数万亿参数的基础模型,微调所有模型参数可能需要非常大的内存。此外,对许多任务进行单独微调可能会产生不可接受的存储成本。有很多工作提出了减少基础模型适配过程的存储占用的方法,我们将这类轻量级适配方法称为低存储适配。通常,此类中的方法会冻结大部分预训练的基础模型参数,仅学习相对较少的特定任务参数(通过微调一些预训练参数或添加全新模块),从而减少每个任务的存储开销。

这种算法的关键设计决策是选择要适配的参数。也许最简单的方法是只调整预训练模型的最后一层,而其他工作只调整模型的偏置向量 [Zaken et al. 2021]、低秩残差以模拟权重张量[Hu et al. 2021] 或模型参数的掩码[Zhao et al. 2020b]。另一行研究强调利用“软”提示信息[Li and Liang 2021; Qin and Eisner 2021; Liu et al. 2021e; Lester et al. 2021; Hambardzumyan et al. 2021],他们通常是任意的参数化向量序列而非模型词汇,将这些提示信息与输入激活层、输入层或所有层进行拼接来调整基础模型。另一种方法冻结所有模型参数,并在现有模型层 [Houlsby et al. 2019] 之间交错插入参数可训练的新的 MLP 模块。虽然这些轻量级适配技术似乎在下游任务上权衡了参数效率和性能,但它们有时也可以达到与完全微调相当的性能,尽管更新的参数少了1000 [Zaken et al. 2021; Li and Liang 2021; Hu et al. 2021]。Lester et al. [2021] 显示了一个实例,当模型大小增加时,完全微调和轻量级适配之间的性能差距消失。我们仍然不确定轻量级适配技术如何随着模型尺寸的增加而变化[Aghajanyan et al. 2020]。因为GPU内存通常是比磁盘存储更受限的资源,对基础模型的民用化而言,低内存适配程序可能比低存储适配程序更关键。已经提出了各种用于低内存模型训练的技术,这些技术可以直接应用于基于微调的适配过程(§4.5: 系统)。然而,一些低内存程序,如梯度检查点 [Chen et al. 2016] 权衡了计算消耗和内存占用,可能会显著加剧基础模型 [Bender et al. 2021] 的能源消耗。

因素 2:数据可用性。 任务专用化需要特定于任务的标记数据作为训练信号。13然而,注释的成本因任务和语言而异;例如,标注 MRI 数据需要专业的医学知识,而注释英文文本的情感只需要常识判断。当适配数据充足时,我们可能会应用传统的微调方法或其轻量级的对应方法。在低资源语言的设置中,结合提示信息和微调已被证明是一个很有前途的方向 [Schick and Schütze 2021a,b; Gao et al. 2020c; Perez et al. 2021; IV et al. 2021; Min et al. 2021]。Le Scao and Rush [2021] 表明,一个经过精心调整的提示可以替代大约 100 个训练示例,并且微调一个精心提示的基础模型比无条件基础模型的数据效率要高得多。

13 提示信息是一个例外,尽管我们可能会认为提示信息隐式表示了一批标记数据中包含的信息[Le Scao and Rush 2021]。

因素 3:对基础模型梯度的访问权限。 尽管基础模型对一些研究社区产生了重大影响,目前几乎没有大型基础模型(具有超过 500 亿个参数)上标准化的分布实践。随着我们逐渐意识到滥用基础模型的潜在危害(参见 §5.2: 滥用),提供对基础模型的所有参数进行微调的访问权限可能会导致伦理问题。此外,大多数用户没有足够的计算资源来利用他们的完全访问权限。例如,基础模型的内存要求可能会妨碍许多组织和机构对其进行直接微调。因此,未来的基础模型提供者可能会限制对模型完整参数的访问,而是提供替代API 访问,如早期基础模型 GPT-3 所示。在一种极端情况下,如果基础模型提供者仅允许访问模型输出(例如,提示信息的文本续写、生成的图像或评价图像与文本描述之间对齐的分数),则可以使用上下文学习来对基础模型进行适配 [Brown et al. 2020]。上下文学习冻结基础模型参数,并通过调节(通常是自然语言)提示信息来控制基础模型的输出,提示信息可能由任务说明或演示组成。为了提高上下文学习的性能,需要仔细设计提示信息,这可以通过手动搜索或自动程序 [Jiang et al. 2020; Shin et al. 2020] 进行,并数据上进行验证。另一种极端情况,如果基础模型提供者授予对模型参数梯度的访问权限,则可以进行完全的微调,更新所有模型参数以提高下游任务的性能。作为中间立场,我们可能仅获得对基础模型输入的梯度访问权限,14其维度比基础模型参数低得多。在这种情况下,我们可以部署轻量级自适应技术 [Liu et al. 2021e; Li and Liang 2021; Lester et al. 2021],它会冻结模型参数并为每个任务优化连续表示的前缀或提示信息。

14 假设基础模型提供者的输入空间是连续的

当模型的所需用例不同于用于基础模型训练的相对通用的训练目标 (§4.2: 训练) 时,适配很有用。最常考虑的是基础模型被适配以用于执行特定任务(例如,文本摘要或图像中的动物分类)的情况,这缩小了模型的范围。实际上,本节前面描述的绝大多数现有方法都针对此设置。然而,其他形式的适配也是很有用的,例如进行局部模型编辑以纠正对特定输入的不良预测或向训练有素的基础模型添加隐私约束,这些都是与任务无关的适配。在本小节中,我们描述了适配的各种用例、最适用于它们的方法,以及剩余挑战。

任务专门化。 基础模型适配研究最广泛的案例是任务专用化,其中基础模型适配用于优化特定任务或任务集的性能。例如,专攻摘要任务将诱导基础模型行为从输入文档中提取关键思想并将它们重新组织成简短的摘要句子。各种适配程序已被证明对任务专用化有效,与未适配模型[Howard and Ruder 2018; Brown et al. 2020] 的性能相比存在显著改善。除了研究相对广泛的针对特定任务的基础模型专用化之外,其他与任务无关的适配问题由于其规模和计算需求特点,对于基础模型来说变得越来越具有挑战性(但同样重要)。例如,训练基础模型的成本使得随着时间的推移持续训练以保持模型的预测与当前事件保持同步尤其昂贵。此外,用于训练基础模型 (§4.6: 数据) 的大规模匿名数据可能使得我们很难防止个人信息泄漏到训练集中;因此,我们可能需要一种在事后有效地从基础模型中删除训练数据的机制。

时间适配。 理想情况下,基础模型存储的知识与世界状态密切相关,与模态无关。然而,世界在不断变化;如新的国家领袖被选出,服装风格的改变,社会规范和信仰转变(§5.6: 规模伦理),并且语言的使用不断发展,导致输入分布、目标预测分布或两者的转变。正如§4.8: 对分布变化的鲁棒性 中所讨论的那样,由于时间偏移引起的分布偏移,这种时间偏移带来了具有挑战性的统计问题。对于基础模型,时间偏移也提出了一个特别困难的计算问题;由于训练基础模型 [Shoeybi et al. 2019; Brown et al. 2020] 的计算要求很高,从头开始频繁重新训练可能会带来不可接受的财务或环境影响 [Bender et al. 2021] (§5.3: 环境),或者花费时间太长而不足以保持模型最新。在视觉领域,跨中间时间点对未标记数据进行渐进式自训练可以适配长期的时间变化,但这仍然是一个昂贵的再训练过程 [Kumar et al. 2020a]。

在语言模型的背景下,按时间划分的诊断数据集有助于量化大型语言模型过时的速度[Lazaridou et al. 2021; Hombaiah et al. 2021; Dhingra et al. 2021],研究也表明重新加权训练数据和在生产时期使用新数据更新模型参数的动态评价等经典技术 [Mikolov et al. 2010]) 可以部分缓解,但不能完全解决这个问题。在它打算建模的时间段上显式地调节语言模型是另一种已经显示出一些希望 [Dhingra et al. 2021] 的技术。解决时间偏移的另一种策略是设计基于检索的(半参数化)模型,该模型通过从大型、人类可解释的数据库(例如,维基百科文章)中检索附加上下文来增强模型输入 [Karpukhin et al. 2020; Lewis et al. 2020b; Guu et al. 2020; Khandelwal et al. 2020; Khattab et al. 2020]。对于基于检索的模型,适配即更新数据库中的单个信息单元(例如,如百科全书文章的单个段落)而不重新训练模型。虽然很有前景,但基于检索的方法的挑战仍然存在于训练准确的检索机制和准确调节检索到的信息 [Lewis et al. 2020b] 方面。我们将在本节后面的更通用的持续学习环境中重新讨论时间适配问题。

领域专用化。 除了任务专用化之外,通常需要将基础模型专用化到特定领域(例如法律文档),而不限制基础模型可以完成的任务的广度。这种专用化导致基础模型训练和适配数据分布(§4.8: 对分布变化的鲁棒性)之间的不匹配,这可能需要新的适配方法来处理。先前的工作发现,多样化和通用的预训练数据会导致当前适配方法的负迁移。例如,Cole et al. [2021] 表明只在 iNaturalist 动物分类数据集上微调预训练的模型比在 iNaturalist 以及 750K 其他图像熵微调预训练的模型提供更好的下游性能;同样,只对法律文件进行预训练的 LegalBERT [Chalkidis et al. 2020] 比 BERT [Devlin et al. 2019] 性能有所提升,后者在法律文件中文本分类和序列标记的下游任务上使用了更加多样化的训练集。领域专用化的一种方法是增加一个中间适配步骤,其中基础模型继续对来自专业领域的未标记数据进行训练。例如,这种方法显着提高了卫星图像和特定的文本主题的下游性能 [Reed et al. 2021; Gururangan et al. 2020]。然而,在某些领域,例如法律文档 [Chalkidis et al. 2020],接续的基础模型训练可能比从头开始重新训练表现更差。阐明接续训练对表现的有益或无益的场景是未来工作的重要方向。

局部模型编辑。 在某些情况下,对基础模型进行局部的调整很有价值,局部调整是指模型的预测分布应该仅针对单个输入或单个输入周围的局部邻域进行调整,而不改变模型对不相关的输入的反应。例如,当基础模型对特定输入短语和目标语言产生特别有问题的误译时,希望在不影响模型对不相关短语的反应的情况下纠正这种误译。过去的工作研究了通过新的预训练目标将近似局部更新应用于大型神经网络的问题,这些目标可以轻松地使用标准梯度下降 [Sinitsin et al. 2020] 、可以预测底层模型的参数编辑方式的高阶网络 [Cao et al. 2021] 以及约束微调程序[Zhu et al. 2020] 等方式对模型进行编辑。然而,现有方法在执行模型编辑而不损害模型的全局性能可靠性方面存在差异。此外,由于所需要计算的高阶梯度 [Sinitsin et al. 2020; Cao et al. 2021] 的规模和训练目标的计算成本较大,将这些方法扩展到大规模基础模型存在一定的困难。

应用约束。 某些情况下,我们需要调整基础模型以满足隐私约束。举例来说,Carlini et al. [2021] 证明现有的基础模型能够记住训练数据中的敏感信息,并且通过标准 API 查询这种方式即可以操纵模型暴露出这些数据。该问题的解决除了需要数据管理方面的改进,开发适配程序以消除或减少特定数据对训练模型的影响也是一个补充的解决方案。在此方向上发展出的适配策略(以及更好的预训练方法)也将使采用通用数据保护条例(GDPR)基础模型的机构受益,因为该条例将赋予用户被遗忘的权利。虽然关于机器学习主题的研究[Bourtoule et al. 2019; Cao and Yang 2015] 已经开始受到关注,但该问题尚未针对基础模型进行深入研究。此外,在较少监管的互联网数据上训练的基础模型已显示出针对特定群体的有害偏见[Bender et al. 2021; Basta et al. 2019; Kurita et al. 2019; Sheng et al. 2019]并且可以产出有害的输出 [Gehman et al. 2020](§5.2: 滥用)。虽然诸如在精心设计的数据集上进一步微调基础模型(可能微调多代)[Solaiman and Dennison 2021] 或应用可控生成技术等策略[Keskar et al. 2019]在减轻模型的有害表现方面取得了一些成功,但真正实现公平且安全的基础模型的获取(§5.1: 不平等和公平)可能需要综合数据收集、训练和适配等阶段,并在领域专家的帮助下进一步展开研究。

考虑到适配即将模型的现有知识与新的数据或训练目标相结合,适配的一种自然延伸即是持续学习 [McCloskey and Cohen 1989; Parisi et al. 2019]。从各种方面考量,无论是使模型的知识与现实事件或文化发展保持同步,亦或不断添加来自全新领域或模式的可用数据,还是随着社会价值观或法律的发展不断编辑模型的记忆,遵守隐私或法律限制,对基础模型的不断调整都是十分有价值的技术。然而,持续学习通常会导致神经网络中灾难性遗忘问题 [McCloskey and Cohen 1989; Ratcliff 1990; Kirkpatrick et al. 2017],即随着训练分布的变化,旧的任务或数据会被迅速遗忘。

我们认为基础模型的持续适配是未来适配研究的一个可能的“重大挑战”,可能需要在模型架构、训练和目标等方面进行创新。正如上面的时间适配小节所述,有越来越多的工作关注连续的语言模型训练。一个更一般的、具体的里程碑是在不同的任务/数据流上逐步训练基础模型,使其达到与同时在所有任务/数据上完成训练后固定的基础模型相同的下游任务性能。实现这样的目标可能需要更深入的理解在不同的基础模型规模上灾难性遗忘问题不同表现的机理,利用元学习 [Schmidhuber 1987; Santoro et al. 2016; Finn et al. 2017] 的见解来尽快学习每个新领域、模式、任务,尽可能开发新的架构或培训目标,或解决其他无法预见的挑战。尽管存在很多有待解决的问题,持续的基础模型适配有望更快地响应社会文化价值观的变化,更好地利用现有知识来学习新概念,通过消除训练的计算负担,减少环境影响并增加基础模型的可访问性,减少由于遗忘而必须重新学习先前学习的概念数量。

本期责任编辑:冯骁骋

理解语言,认知社会

以中文技术,助民族复兴