直接在光子计算设备上训练神经网络!光电路AI又近了一步

研究证明,人工神经网络的训练可以直接在光子芯片上进行。这一重大突破表明:光学电路可以执行人工神经网络的关键功能,我们或许可以因此找到出价格更低,速度更快,更节能的方法,来完成语音或图像识别等复杂任务。

斯坦福大学的研究小组负责人范汕洄表示:“光子芯片比数字计算机能更高效地执行神经网络计算,意味着我们可以解决更复杂的问题。例如,这将提高人工神经网络执行自动驾驶汽车任务的能力,或者对语音问题做出合适的回应等。”

神经网络是人工智能的一种,它用互相连接的单元来处理信息,这种方式类似于大脑。使用神经网络来执行复杂任务时,需要训练算法中的关键步骤来对输入进行分类,例如语音识别时,需要对不同的单词进行分类。

尽管最近有实验证明光学人工神经网络的例子,但它们的训练步骤仍然在传统的数字计算机上进行,只是最终将训练所得的设置导入光子计算电路。在光学学会的高影响力研究期刊《Optica》上,斯坦福大学的研究人员发表的文章描述了一种直接在光学设备中训练神经网络的方法,这种方法使用了“反向传播”算法的光学版本。反向传播算法是训练传统神经网络的标准方法,只是过去都只在传统计算机上进行训练。

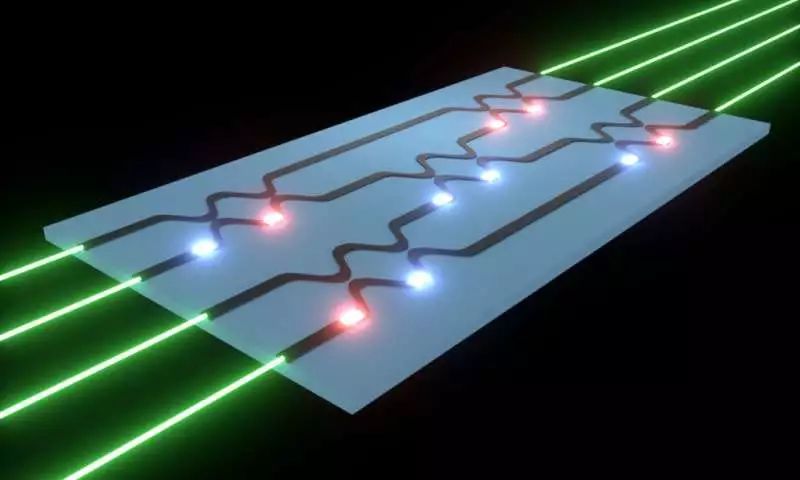

图丨上图中蓝色的方块代表的是一块光电路,研究显示这样的光电路可以用来训练神经网络。当然,完整的网络需要多块这样的光电路。图中绿色的激光信号将信息输入光电路,穿过黑色的光波导路(optical waveguides)。光波导路中弯曲的部分是可调节的分束器,神经网络的重要操作在此完成。通过改变图中红色和蓝色光学移相器的设置可以调节分束器,以完成对神经网络的训练。(图片来源: Tyler W. Hughes, 斯坦福大学)

该论文的第一作者 Tyler W. Hughes 说:“使用物理设备而非计算机进行训练可以使过程更加准确,神经网络应用中,训练步骤本身的计算量是非常大的,因此在光子计算设备进行训练对于提高人工神经网络的效率、速度和节能表现来说都至关重要。”

光学神经网络

通常神经网络都在传统计算机上执行,但是人们仍然致力于设计专门针对神经网络计算的硬件,其中基于光学的设备可以执行并行计算而且比电子设备省电,因此吸引了很多研究。

在这项新研究中,研究人员设计的光子芯片复制了传统计算机训练神经网络的方式,使得神经网络可以完全在光子计算设备上进行。

人工神经网络就像是有多个调节旋钮的黑盒子,在训练期间,这些旋钮以极小的幅度被旋动,然后系统被检测,查看算法的性能是否得到改善。

Hughes 说:“我们的方法不仅可以预测该朝那个方向转动旋钮,还可以预测每个旋钮的旋转程度,以接近所需的性能。这种方法显着加快了训练速度,特别是对于大型网络,因为我们可以并行获取每个旋钮的信息。”

在芯片上训练

新的训练协议在具有可调分束器的光子计算电路上运行,这些分束器可通过改变光学移相器的设置来调整。携带着信息的激光束被发射到光学电路中,并通过分束器。

新的训练协议中,激光首先被输入到光电路中,当激光从光电路的另一端射出时,系统会计算实际射出值与预期结果的差异,然后该信息被用于产生新的光信号反向传回光电路。在此过程中,通过测量每个分束器周围的光强度,研究人员展示了随着每个分束器设置的改变,神经网络性能将会如何改变。移相器的设置可以根据此信息进行改变,该过程可以不断重复直到神经网络产生期望的结果。

研究人员通过训练算法执行复杂的功能来测试光学神经网络的效果,例如在一组点内挑选出复杂的特征。他们发现光学神经网络的表现与传统计算机类似。

范汕洄说:“我们的研究表明物理定律也可以用来实现计算机科学算法。通过在光学领域训练神经网络,我们可以得知神经网络系统可以只使用光学器件来执行特定功能。”

研究人员计划进一步优化系统,并希望用它来实现神经网络的实际应用。他们设计的方法可以与各种神经网络架构一起使用,也可用于如“可重构光学器件”等应用。

-End-

参考:

https://phys.org/news/2018-07-closer-optical-artificial-neural-network.html