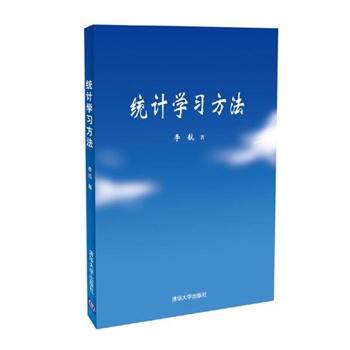

重磅发布!李航《统计学习方法》第二版最新版视频课上线!速来围观!

说起机器学习最响当当的书籍,李航博士的《统计学习方法》一定是榜上有名了!许多互联网企业的面试、笔试题目,都参考这本书。

这本书第一版就包含了众多主要的监督学习算法与模型,通过作者 6 年时间的努力,第二版已正式发布啦!

作者在在第二版加入了无监督学习的主要算法和模型。不知道你有没有拿到新书开始看起来了呢?

从监督学习和无监督学习这两大块出发,基本上传统机器学习的主要概念就能一步步掌握了!

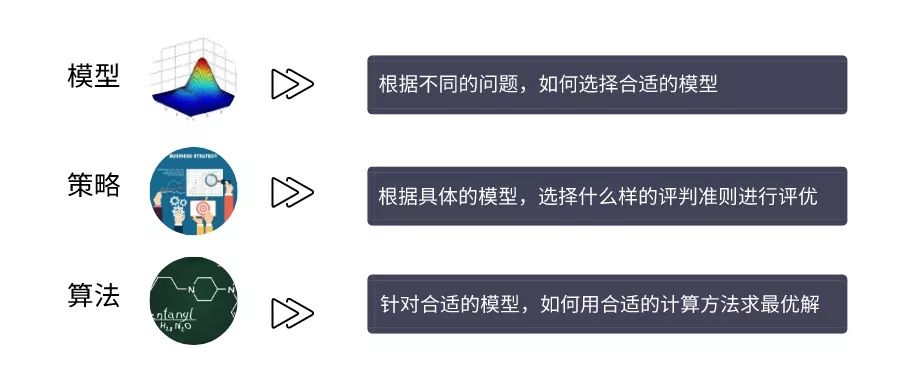

《统计学习方法》是由三要素构成,即方法=模型+策略+算法,你需要掌握:

掌握这三点,意味着你能弄懂机器学习最核心的原理。而《统计学习方法》就是基于这些内容做出了详细的讲解和说明。因此,不仅是在学术界,还是在工业界,这都是一本必读好书

但面对想学好机器学习的同学们来说,自己看书还是会有各种各样的困难,无法理解作者背后的逻辑,无法进行系统梳理

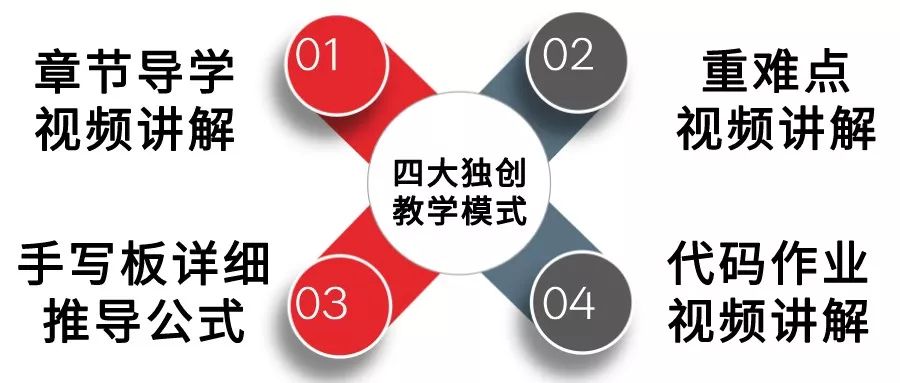

为此,在统计学习方法第二版书刚出来不久后,我们就紧接着推出了一场集章节导学视频+书籍重难点及手推公式视频讲解+代码作业视频讲解+三维度答疑为一体的第二版的《李航统计学训练营》,并加入了无监督学习部分!

独创四大教学模式,通过5步帮你务实理论功底

针对书本每一章节内容先进行导读梳理,帮助你理解书本章节内容,学习重难点知识,并对一些重要的先修知识和概念进行补充讲解,让你知道应该怎么学习。

针对书中的重难点内容,录制重难点知识讲解的视频,讲解知识点,说明知识点是什么、为什么、怎么做,结合实际案例进行讲解

导师亲自手推公式,细致到每一步骤,让课程内容充实紧凑,涉及到应用多元统计与随机过程等学科知识相串联。

为了增强实战能力,我们针对每一章节都设计了代码作业,并且提供详细的作业讲解视频和代码的完整复现,帮你在完成作业以后能够充分理解背后蕴含的原理

为了保证大家遇到难题能够及时被解决,我们设计的三维度答疑的方式:

1、导师接受1对1提问,12小时内保证解决问题

2、微信群助教及时互动,群友互答

3、每月统一收集问题直播答疑,系统讲解重难点

Week1

【视频课】第1章 统计学习方法概论

理解“本章概要”的5点内容

理解模型过拟合产生的原因以及造成的影响

理解机器学习的评价标准:模型的泛化能力

熟悉极大似然估计和贝叶斯估计基本思想和求解方法

【视频课】第2章 感知机

掌握感知机的模型形式、损失函数及对应的优化问题

掌握随机梯度下降算法原理

理解感知机模型中随机梯度算法的收敛性

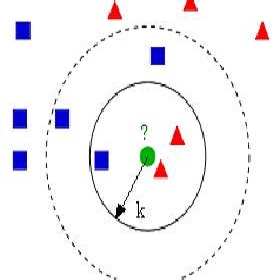

【视频课】第3章 k近邻

掌握k近邻算法的原理

理解k近邻算法三要素及模型对应的损失函数

掌握k近邻算法在分类问题上的求解过程

作业:

【推导】推导正态分布均值的极大似然估计和贝叶斯估计

【思考题】思考感知机模型的假设空间?模型复杂度体现在哪里?

【代码复现】自编程/调用sklearn实现一个感知机算例

【思考题】思考k近邻算法的模型复杂度体现在哪里?什么情况下会造成过拟合?

【代码复现】自编程/调用sklearn实现一个k近邻算法算例

作业视频讲解:

极大似然估计和贝叶斯估计作业

感知机算例自编程和sklearn实现

Week2

【视频课】第4章 朴素贝叶斯法

理解朴素贝叶斯模型的模型假设

理解后验概率最大化与期望损失最小化的关系

掌握极大似然估计的求解过程

掌握贝叶斯估计的求解过程

【视频课】第5章 决策树

理解信息增益、基尼系数的含义和计算方法

掌握ID3算法

了解决策树剪枝的目的和剪枝准则

掌握CART生成算法

作业:

【代码复现】自编程/调用sklearn实现朴素贝叶斯算法

【证明题】证明CART剪枝算法中,当α确定的情况下,存在唯一的最小子树Ta使得损失函数Cα(T)最小。

【代码复现】调用sklearn实现决策树算例,有余力者进行自编程实现

作业视频讲解:

K近邻算法自编程和sklearn实现

朴素贝叶斯自编程和sklearn实现

Week3

【视频课】第6章 逻辑斯谛回归与最大熵模型

掌握二项逻辑斯谛和多项逻辑斯谛模型的模型形式和似然函数

掌握二项逻辑斯谛求解中的梯度下降法

理解最大熵模型的思想,了解拉格朗日对偶性

理解最大熵模型中的改进的迭代尺度算法

【视频课】第7章 支持向量机

理解线性可分支持向量机硬间隔最大化的思想、对应的优化问题、对偶问题和相应算法

理解硬间隔最大化解的存在唯一性

理解线性支持向量机软间隔最大化的思想、对应的优化问题、对偶问题和相应算法

了解核函数在非线性支持向量机中的应用和对应的算法

了解序列最小最优化算法的基本思想

作业:

【代码复现】自编程/调用sklearn实现逻辑斯缔回归模型,尝试改变参数,选择不同算法

【代码复现】手算/自编程/调用sklearn完成习题7.2,求线性可分支持向量机的最大间隔分离超平面和分类决策函数

作业视频讲解:

决策树自编程和sklearn实现

逻辑斯蒂回归自编程和sklearn实现

Week4

【视频课】第8章 提升方法

掌握AdaBoost算法的求解过程

理解AdaBoost算法的训练误差

理解AdaBoost算法是前向分步算法的一个特例

掌握回归问题的提升树算法

【视频课】第9章 EM算法及推广

通过例题9.1掌握EM算法E步和M步的求解过程

了解EM算法求解如何用从最大化观测数据似然函数导出

掌握高斯混合模型如何用EM算法估计参数

作业:

【代码复现】自编程/调用sklearn对提升方法例题8.1进行实现

【代码复现】自编程求解两分量高斯混合模型的参数

作业视频讲解:

支持向量机算例自编程和sklearn实现

提升方法算例的自编程和sklearn实现

Week5

【视频课】第10章 隐马尔科夫模型

了解隐马尔科夫模型的三要素和三个基本问题

通过例题10.2,掌握隐马尔可夫模型概率计算中的向前算法

理解隐马尔科夫模型参数的非监督学习算法

通过例题10.3,理解维特比算法

【视频课】第11章 条件随机场

理解概率无向图

通过例题11.1和例题11.2,掌握线性链条件随机场模型参数形式和矩阵形式

掌握条件概率和期望的前向-后向算法

掌握改进的迭代尺度法和拟牛顿法优化的目标函数

通过例题11.3,掌握预测的维特比算法

作业:

【代码复现】自编程实现隐马尔可夫模型的前向、后向和维特比算法

【代码复现】自编程实现条件随机场习题11.4

作业视频讲解:

用EM算法自编程估计两分量高斯混合模型的参数

自编程实现隐马尔可夫模型的前向、后向和维特比算法

自编程实现条件随机场习题11.4

Week6

【视频课】第13章 无监督学习概论

理解无监督学习基本原理

理解机器学习三要素

熟悉无监督学习方法

【视频课】第14章 聚类方法

理解聚类的基本概念:相似度或距离、类或簇、类与类之间的距离

掌握层次聚类方法

掌握k均值聚类的模型、策略、算法和算法特性

【视频课】第15章 奇异值分解

掌握奇异值分解的定义与性质

掌握奇异值分解的计算步骤

熟悉奇异值分解与矩阵近似

作业:

【推导】推导由类与簇的第一个定义得出其他三个定义

【思考题】思考k均值聚类与高斯混合模型加EM算法的异同点?

【代码复现】自编程实现一个k均值聚类案例

【思考题】思考矩阵的奇异值分解与对称矩阵的对角化的异同点?

【代码复现】自编程矩阵的奇异值分解

作业视频讲解:

几类典型的聚类分析方法(系统聚类法、重心法等)

k均值聚类案例的自编程实现

证明任何一个秩为1的矩阵可写成两个向量的外积形式

Week7

【视频课】第16章 主成分分析

理解总体主成分分析的定义与性质

掌握求解总体主成分的基本定理与运用

理解样本主成分分析的定义与性质

掌握相关矩阵的特征值分解算法

掌握数据矩阵的奇异值分解算法

【视频课】第17章 潜在语义分析

理解单向量空间与话题向量空间

掌握潜在语义分析算法-矩阵奇异值分解算法

掌握非负定矩阵分解算法

了解非负定矩阵分解的形式

作业:

【代码复现】自编程实现主成分分析案例

【证明题】证明样本协方差矩阵S是总体协方差矩阵的无偏估计

【代码复现】自编程实现潜在语义分析的奇异值分解法和非负定矩阵分解法

作业视频讲解:

潜在语义分析自编程实现

主成分分析自编程实现

Week8

【视频课】第18章 概率潜在语义分析

了解概率潜在语义分析模型的基本想法

掌握概率潜在语义分析模型的生成模型、共线模型

掌握概率潜在语义分析模型的参数和几何解释

掌握概率潜在语义分析运用生成模型学习的EM算法

【视频课】第19章 马尔科夫链蒙特卡罗法

理解蒙特卡罗法的随机抽样、数学期望估计和积分计算步骤

理解马尔科夫链的基本定义、离散状态与连续状态、基本性质

熟悉马尔科夫链蒙特卡罗法的基本想法和实现步骤

掌握Metropolis-Hastings算法基本原理与单分量Metropolis-Hastings算法

熟悉吉布斯抽样基本原理与算法并进行抽样计算

作业:

【证明题】证明如果马尔科夫链是不可约的,且有一个状态是非周期的,则其他所有状态也是非周期的。

【代码复现】自编程实现马尔科夫链,尝试改变参数,选择不同状态转移矩阵

【代码复现】自编程实现习题18.3潜在语义分析

作业视频讲解:

概率潜在语义分析自编程实现

马尔科夫链自编程实现

证明可逆马尔科夫链一定是不可约的

Week9

【视频课】第20章 潜在狄利克雷分配

理解狄利克雷分布的定义与共轭先验

掌握潜在狄利克雷分配模型的基本定义、概率图模型

理解潜在狄利克雷分配模型中随机变量序列的可交换性

熟悉LDA吉布斯抽样算法的基本想法、主要部分和后处理

理解LDA的变分推理过程

掌握LDA的变分EM算法的基本结构与推导步骤

作业:

【思考题】LDA的吉布斯抽样算法、变分EM算法中利用到狄利克雷分布的部分是哪些?

【证明题】推导狄利克雷分布数学期望公式

【代码复现】自编程针对17.2.2文本案例,使用LDA模型进行话题分析

作业视频讲解:

LDA模型话题分析自编程实现

LDA的吉布斯抽样算法的变分EM算法的Python实现

Week10

【视频课】第21章 PageRank算法

理解有向图和随机游走模型的基本想法

理解PageRank的基本定义和一般定义

掌握PageRank的计算-迭代算法、幂法和代数算法

【视频课】第22章 无监督学习方法总结

熟悉各无监督学习方法的关系和特点

熟悉基础机器学习方法

熟悉话题模型之间的关系和特点

作业:

【证明题】假设方阵A是随机矩阵,即其每个元素非负,每列元素之和为1,证明A的k次方仍是随机矩阵,其中k是自然数

【代码复现】自编程/调用Python验证习题21.2,以不同的初始分布向量进行迭代,仍得到同样的极限向量R

【证明题】PageRank 一般定义中的马尔科夫链具有平稳分布

作业视频讲解:

证明随机矩阵的最大特征值为1

PageRank算法自编程和Python实现

有好的课程教材,也必须要有好的导师,才能让学习能力倍速提升,我们的导师团,个个都是行业内的精英,深受学员好评

现任香港某大学数学系博士

毕业于国内双一流重点大学硕士学位

曾任国内知名电商平台大数据算法工程师

曾获数学建模竞赛,国家二等奖

上海交通大学应用统计研究生

浙江大学统计学专业

在精英世家教授英国、美国本科生统计学、数学和金融等多门学科

授课经验丰富,擅长R语言,Matlab和Python

加量!升级!不加价!

现加入13小时无监督学习课程!

共计40+节视频课+20+节作业讲解课

(最后一次98,下期即将涨价为198元)

购买即赠送《统计学习方法》电子版

报名时间:2020年2月14日—2019年2月28日

支持七天无理由退款,一次购买,支持无限次回放!永久有效!

支持手机/电脑倍速播放!学习体验更流畅~

我们的老师在往期训练营里备受好评!而我们,还在不断的更新迭代课程内容!

学完有效果吗?事实证明,统计学是所有人工智能算法课的基础,也是最重要的一环

除了优质的课程设计,我们还准备了多重福利!凡深度之眼学员均可领取48小时免费时长!这里的GPU来自于全球各地,通过DBC(区块链技术)分布式网络连接在一起,没有中心化服务器,你的数据都是加密传输的,不会被窃取,非常安全!而且价格便宜,低至1小时不到1块钱!

为了鼓励学员,我们还一直坚持对于优秀的学生发放奖金(训练营采取积分机制,打卡、老师助教点评、点赞都会得到相应的积分,凭积分就可以换取相应奖品!)

VIP学员已享受超值福利不参与返款活动

按学习任务要求完成全勤打卡且排名前20的同学,我们将赠送你深度之眼定制周边福利!

最后一次98,下期即将涨价为198元!

10周你能获得的 不仅仅是知识和能力

更有一群陪你学习的伙伴~

省下一张电影票马上开始学习吧!

报名时间:2020年2月14日—2019年2月28日

添加班主任微信进学员内部群

开启你的升级打怪之旅

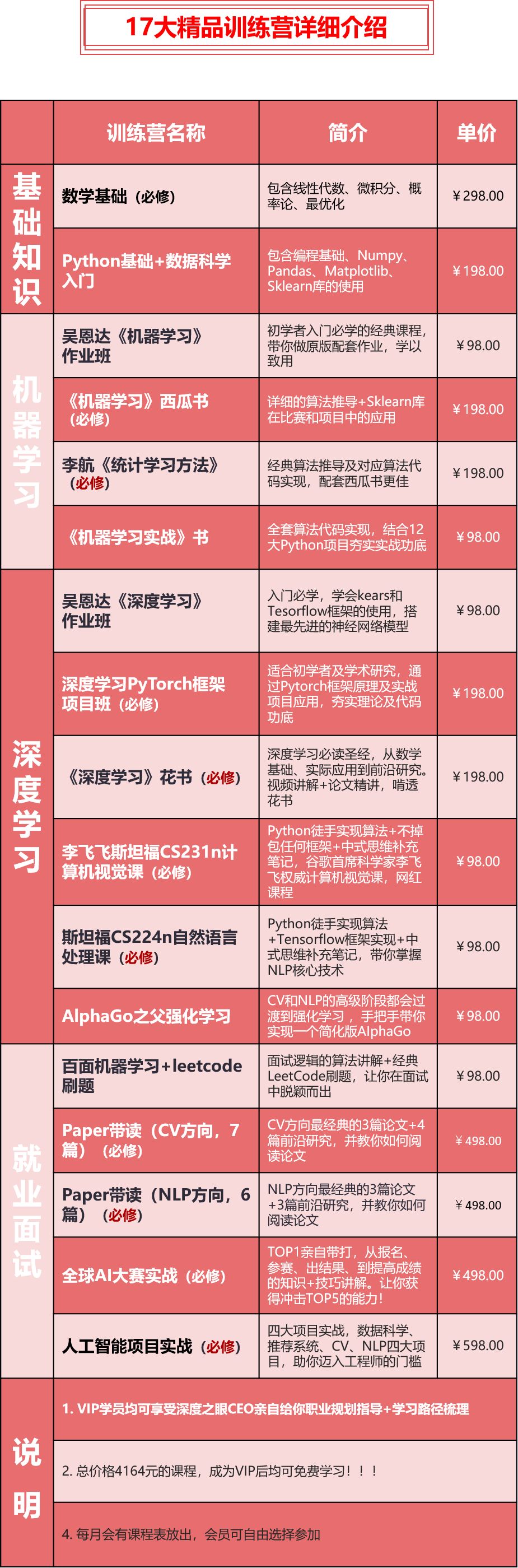

一年畅学17大主题训练营,从小白入门到进阶大神的最佳学习路径

添加班主任微信

~了解VIP特权吧~

Q、付完98元后面还要再付钱吗?

A、一次性购买完整课程就是98元,没有任何其他付款内容

Q、课程资料在哪里看?

A、所有的课程资料均会在深度之眼公众号内上传。

Q、报名后可以退款吗?

A、本服务为虚拟内容产品,支持七天无理由退款

Q、可以开具发票吗?

A、可以开具普通电子发票,请联系微信班主任填写需要的信息即可。