不可错过!首门《自监督学习统计模型》课程!霍普金斯Daniel Khashabi讲授

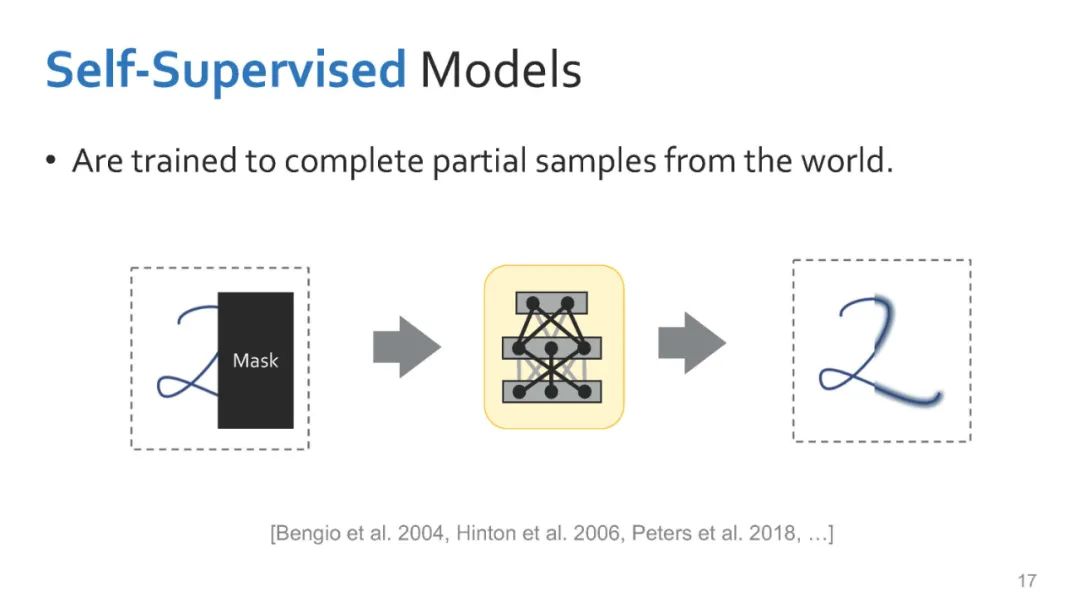

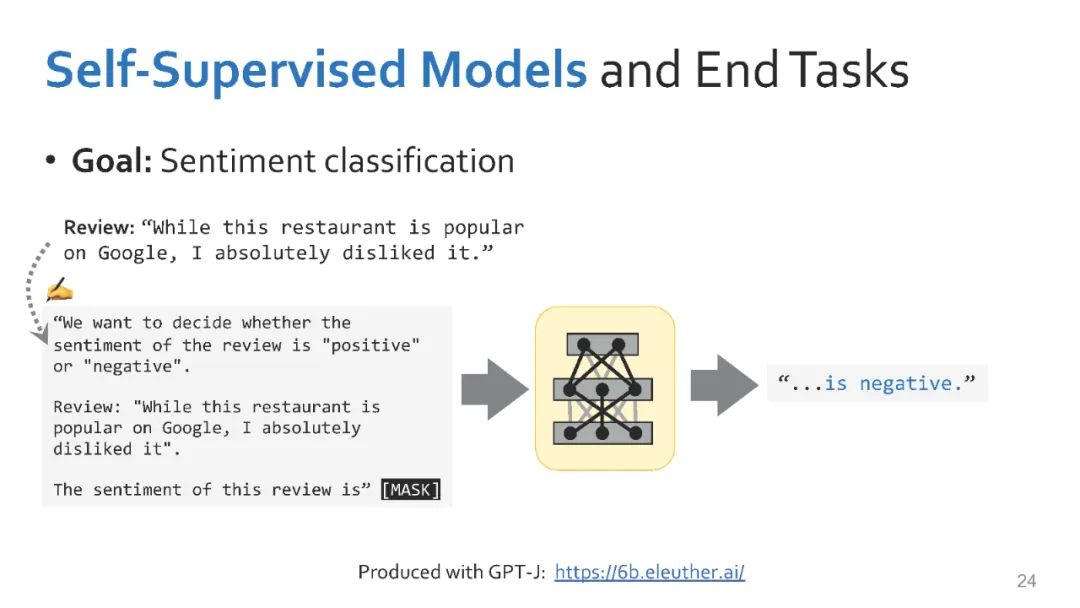

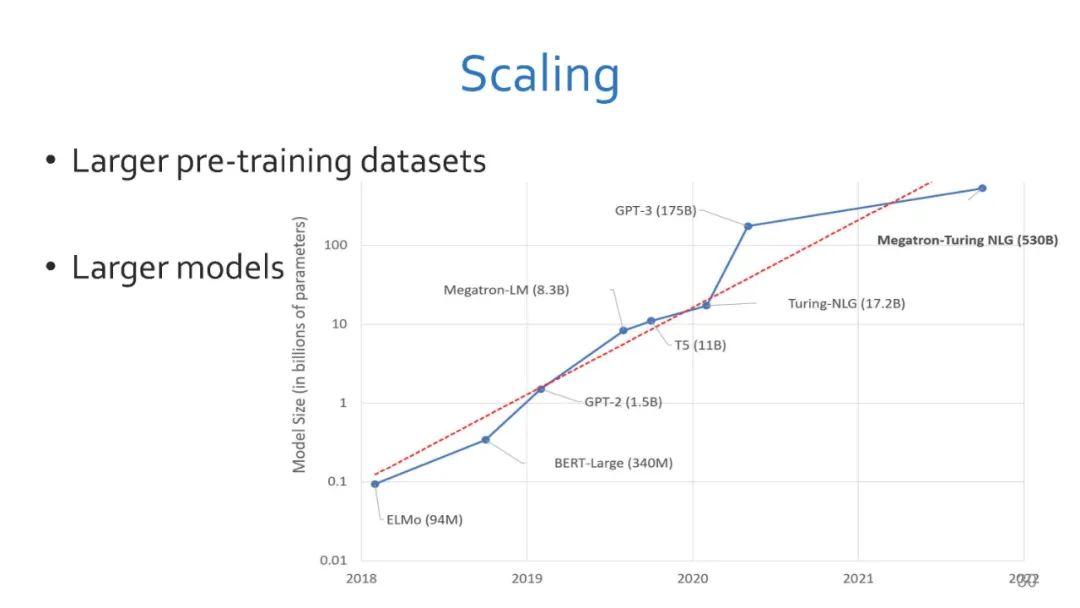

大量自监督(预训练)模型的兴起改变了许多数据驱动领域,如自然语言处理、计算机视觉、机器人和医疗成像。这门高级研究生课程旨在提供与这些模型相关的问题的整体观点:我们将从我们如何走到这里的历史开始,然后深入研究最新的成功故事。然后我们将关注这些技术的影响:社会危害、安全风险、法律问题和环境影响。本课程将以对这一发展轨迹的未来影响的反思结束。

前提条件:学生必须在深度学习、机器学习、人工智能和自然语言处理方面有丰富的经验。熟悉线性代数,统计学和概率,以及学习模型的设计和实现(通过学习库之一,如PyTorch, Tensorflow, Keras, JAX)。学生必须能够阅读论文并从论文中提取关键概念和观点。

讲者:

Daniel Khashabi 的研究重点是通过自然语言的视角,研究智能行为的计算基础。目标是探索不同的方法,我们可以开发和评估系统,理解和推理(和关于)自然语言在不同的环境。主要认同自然语言处理(ACL、NAACL、EMNLP)和人工智能社区(AAAI、IJCAI),在某种程度上,认同机器学习社区(ICLR、NeurIPS、ICML)。

https://danielkhashabi.com/

目录内容:

1. Course overview, plan and expectations

2. Preliminaries: Past, Architectures, Pre-training, Capabilities

3. Pretraining Language Models

4. Architectures

5. In-context Learning

6. Social Harms: Bias

7. Memorization and Privacy

8. Pretraining Coding Models

9. Pretraining Vision-Language Models

10. Pretraining Speech/Audio Models

11. Evolving Memory

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“SLSM” 就可以获取《不可错过!首门《自监督学习统计模型》课程!霍普金斯Daniel Khashabi讲授》专知下载链接