英伟达小样本换脸AI:金毛一秒变二哈,还有在线试玩

新智元报道

新智元报道

编辑:肖琴

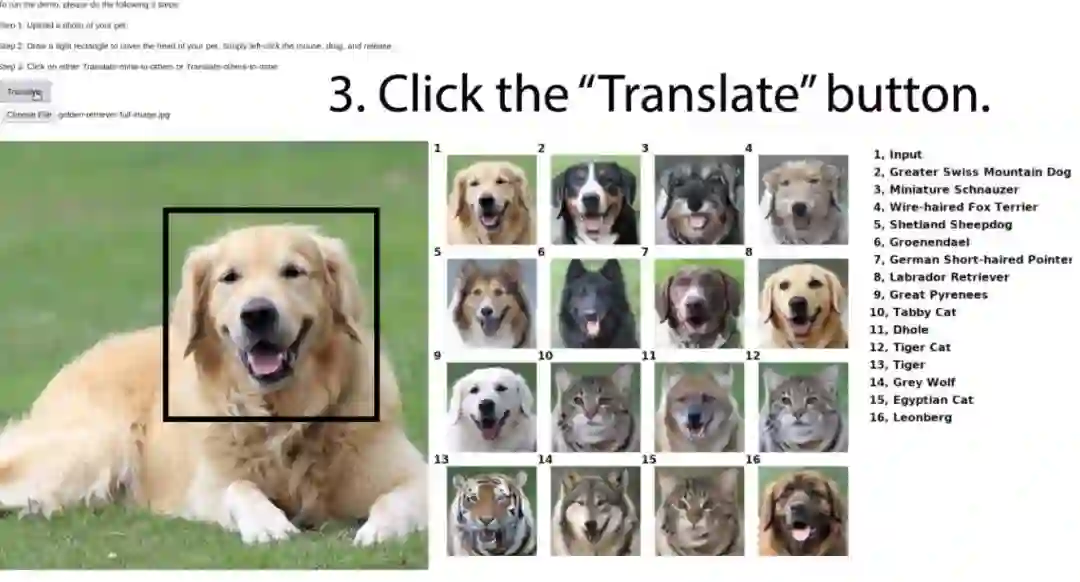

【新智元导读】发明“草图秒变风景照”图像生成器GauGAN的英伟达研究团队,最近推出更有趣“宠物换脸”GANimals。只需上传一张照片,金毛能变成哈士奇、雪豹、老虎……这是什么黑科技,快来新智元 AI 朋友圈 分享你的萌宠换脸吧~

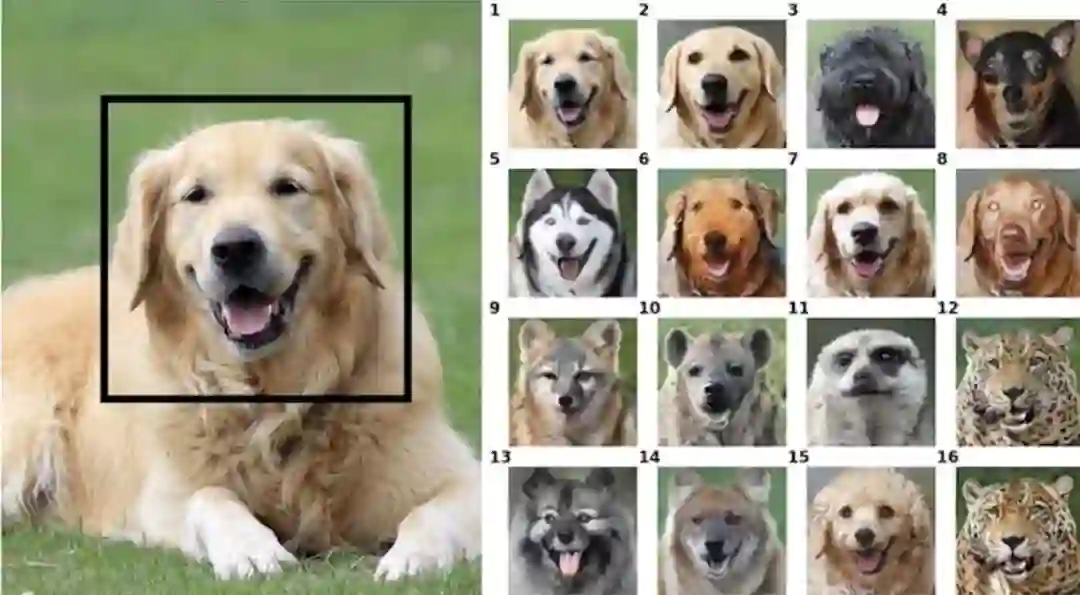

金毛的“吐舌头、歪头”等表情被迁移到其他动物脸上

点击“进入空间站”分享你的萌宠换脸

FUNIT的解释

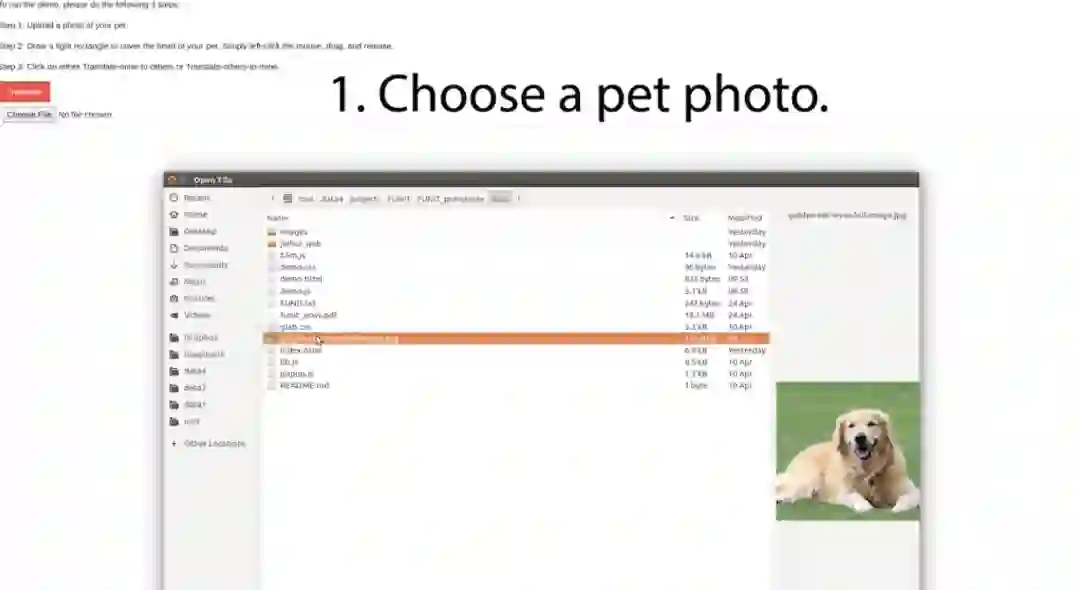

所提出的FUNIT框架旨在通过利用在测试时可用的几个目标类图像,将源类的图像映射到目标类的类似图像。

为了训练FUNIT,研究人员使用来自一组对象类(例如各种动物物种的图像)中的图像,称为源类(source classes)。同时,不假设任何两个类之间存在配对的图像(即,不同物种的任何两个动物都不会是完全相同的姿势)。

研究使用源类里的图像来训练一个multi-class无监督图像到图像转换模型。

在测试过程中,研究人员从一个称为目标类(target class)的新对象类中提供少量几张图像。模型必须利用少量的目标图像来将源类里的任何图像转换为目标类里的类似图像。

图1

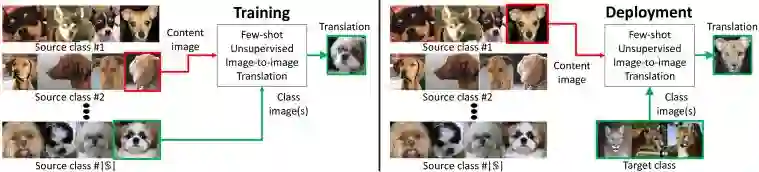

训练。训练集由各种对象类(源类)的图像组成。我们训练了一个模型在这些源对象类之间转换图像。

部署。我们向训练模型显示极少量目标类里的图像,这就足以将源类的图像转换为目标类的类似图像了,即使模型在训练期间从未见过目标类的任何图像。

需要注意的是,FUNIT生成器有两个输入:1)一个内容图像;2)一组目标类图像。它的目的是生成与目标类图像相似的输入图像的转换。

该框架由一个有条件的图像发生器G和一个多任务对抗性鉴别器D组成。

与现有无监督image-to-image translation框架中有条件的图像生成器不同,它们是将一张图像作为输入,而这里的生成器G需要同时将一张内容图像x和一组K类图像{y1, ..., yK}作为输入,生成输出图像x¯,公式如下:

主要结果

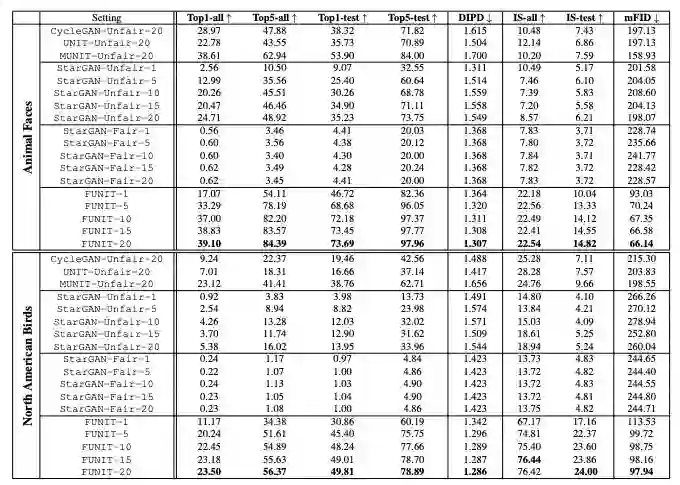

如表1所示,FUNIT框架在Animal Faces和North American Birds两个数据集的所有性能指标都优于用于小样本无监督图像到图像转换任务的基线模型。

FUNIT在Animal Faces数据集的1-shot和5-shot设置上分别达到82.36和96.05 的Top-5 测试精度,以及在North American Birds数据集上分别达到60.19和75.75的Top-5 测试精度。

这些指标都明显优于相应的基准模型。

表1:FUNIT与基线模型的性能比较。↑表示数值越大越好,↓表示越小越好。

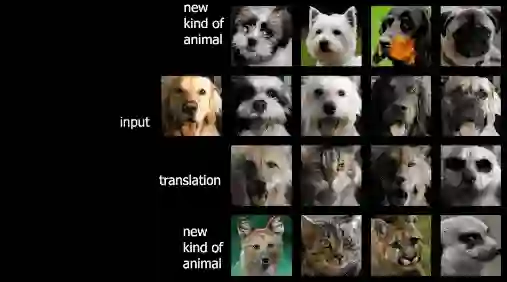

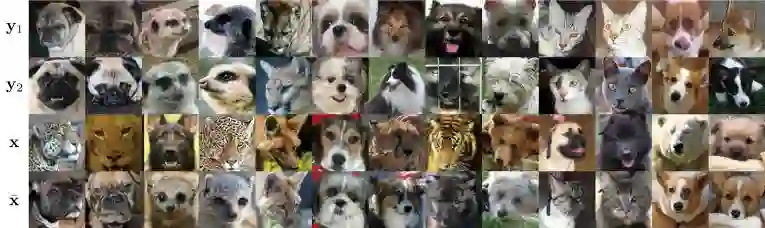

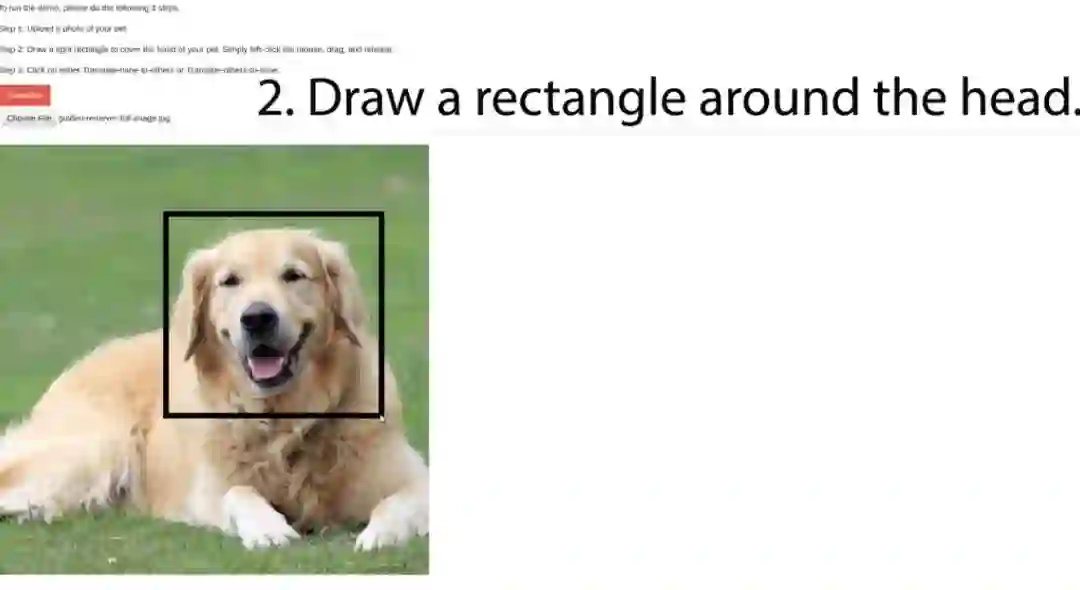

在图2中,研究人员对FUNIT-5计算的few-shot translation的结果进行了可视化。

图2:无监督图像-图像转换结果的可视化。计算结果采用FUNIT-5模型。

从上到下分别是来自动物面孔、鸟、花和食物数据集的结果。每个示例随机展示了2张目标类中的图像,输入内容图像x,以及转换后的输出图像x¯。

结果表明,模型能够成功地将源类的图像转换为新的类中的相似图像。对象在输入内容图像x和相应输出图像x¯中的姿态基本保持不变。输出图像也非常逼真,类似于目标类中的图像。

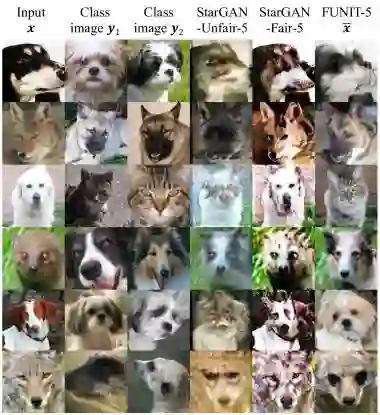

图3提供FUNIT与基线模型的结果比较。可以看到,FUNIT生成了高质量的图像转换输出。

图3:小样本图像到图像转换效果的比较。

从左到右的列分别是输入内容图像x,两个输入目标类图像y1,y2,来自不公平的StarGAN基线的转换结果,来自公平的StarGAN基线的转换结果,以及来自FUNIT框架的结果。

参考链接:

https://blogs.nvidia.com/blog/2019/10/27/ai-gans-pets-ganimals/

论文和GitHub:

https://arxiv.org/pdf/1905.01723.pdf

https://nvlabs.github.io/FUNIT/petswap.html

https://github.com/NVlabs/FUNIT