硬核课程全网首发!高级人工智能:多模态大模型LLM与AIGC前沿技术实战

2023夏季班招生简章

高级人工智能:多模态大模型LLM与AIGC前沿技术实战

Advanced Artificial Intelligence:

LLM & AIGC cutting-edged Training Camp

在这一次AIGC的革新中 你不必是一名旁观者

用4个月时间构建自己的多模态LLM机器人

GPT-4机器人7*24小时做你的私人助教

把握技术革新 突破职业瓶颈

硅谷专家 GPT开源贡献者

带你攻克最新技术

以 ChatGPT,Midjourney 为代表的的生成模型从 2022 年下半年开始为这个世界带来了巨大的震撼,目前众多公司也积极投身于此,新兴的 AI 产品如雨后春笋般出现。可是作为企业用人方,会发现掌握 AIGC 核心技术的人才寥寥无几,而我们作为求职者,希望加入这次技术浪潮却也不知道如何入门。这门课程,硅谷AI算法研究员、ChatGPT 相关开源版作者带你手把手掌握这些核心知识,不论是找工作,还是自己完成AI项目,都能有效地帮助你!

注意:本课程不是一门面向非技术人员通识课,也不是一门教大家怎么使用 AIGC 工具的课程。

一

你现在是否面临以下问题?

● 作为传统的技术工作者,算法工作者,看到最近的技术发展,希望能够加入此次技术革命,突破职业瓶颈;

● 在 AIGC 的浪潮下,Transformer, LLM, Diffusion, LoRa, Prompt Enginering, GPT-3.5/4, PPO, HFRL, DALL-E, ViTransformer, WGAN, Pix2Pix 这些技术你是否感到迷茫?这门课程带你一次性从原理到实战掌握以上概念!

● 想做自己的大模型,没有合适的机器,数据,找不到门路?这门课为你提供最先进的 A100(速度为 V100 的 150%,P100GPU 的 3500%)与项目完整流程,让你动手实战,掌握内容!

二

本课程特色

1. 本课程区别于目前其他对于 AIGC 进行科普、工具使用类的课程。我们邀请的老师都是从 2017 年 WordEmbedding 第一个预训练模型推出就开始进行大模型模型相关工作、研发的一线研发人员。导师对于大模型、预训练的理解和实践经验能够非常实际地帮助大家。

2. 本课程为了能够让大家进一步理解目前 GPT 相关产品的能力,表现,以及性能极限,我们全程为大家提供以 OpenAI 最新的 GPT-4 作为 API 驱动的助教机器人。助教机器人与你一对一交流,7*24 小时解决你的任何问题。并且,你在这个过程中,会对目前 AIGC 的能力有更加深刻、实际的理解。

3. 区别于浅尝辄止的“学习”,“研讨”怎么使用现有的 AIGC 项目,我们导师带领大家完成 4 次完整、前沿的 AIGC 项目实战。从 Transformer,GPT,Diffusion,GAN,让大家全链路掌握 AIGC 的核心技术。 并且此次参与课程的同学能够参与开源版 ChatGPT 项目。项目作者亲自授课,不仅锻炼自己的能力,更能使得你在 AI 岗位求职中脱颖而出。

4. 本课程为大家提供了目前 Nvidia 最先进的 A100 服务器。以及 30 核 CPU 服务器。为大家的模型训练保驾护航!

三

导师介绍

赵老师:硅谷行业头部大厂计算机视觉 AI 算法研究员,毕业于美国佛罗里达大学计算机科学系。超过 10 年 AI 与深度学习,计算机视觉与图形学等领域经验。工作中对预训练模型,尤其是视觉深度学习模型(CNN / ViT 等)有深刻理解和实战经验。赵老师在工作之余帮助计算机视觉从业者提升从业能力,其课程深入浅出,高屋建瓴,在计算机视觉从业者中广受好评。

郭老师:中国头部互联网企业算法工程师,开源大语言模型(ChatGLM, CPM)贡献者,开源项目爱好者。从 2013 年起一直从事 NLP 相关工程及研究工作,具备丰富的产业实战经验。

高老师:前 IBM 人工智能与认知服务数据科学家,目前在美国加州从事 AI 研究。自 2012 年起进行对话机器人的研究工作。近十多来持续从事人工智能相关研究、企业落地。曾经作为技术负责人参与落地多个大中华区AI项目。

四

授课计划

● 课程合计 18 周(或 18 + 8 周求职机试指导)

● 每周3小时直播研讨+实战代码指导课,基于在线视频会议

“

AIGC课程详细安排

Detailed Curriculum

本次课程正式开始时间为2023年5月7日,5月7日之前,我们为大家提供 pyTorch,强化学习,预训练模型等预习资料。并且大家可以开始使用基于 GPT-4 的机器人,感受其能力。

导论预备课程/ 授课老师,高老师

第一周 : 从WordEmbedding到Transformer

什么是预训练模型?为什么需要进行本文的向量化?

从 Word2Vec,GLoVE,FastText,再到self-Attention 机制,Transformer 的原理变迁与技术增长路线

大规模预训练模型在图片、图网络中(Graph Network)中的应用和影响

什么是多模态?多模态的意义是什么?原理是什么?

第二周 : 强化学习的原理,强化学习与 AIGC 的关系和作用 (因内容交错,本节课程大约为 5 个小时)

强化学习在AIGC中的作用

马尔科夫决策过程,Bellman方程

从蒙特卡洛模拟到Temperal Difference

Q-Learning与Deep-Q-Learning

Policy Gradient,REINFORCE 算法

PPO算法的原理

大语言模型(LLM)与文本生成

/ 主讲老师,郭老师

第三周 : 大语言模型在自然语言处理中的应用

Self-attention与multi-head多头Transformer的原理详解

GPT模型的原理

GPT-2/3/3.5/4的演化和比较

BERT, RoBERTa, T5, XLnet等模型的对比

目前其他主流语言模型的比较

如何根据业务选择最合适自己的语言模型

第四周 : 大语言模型的 Fine-Tuning, Prompt Engineering

Fine-Tuning的原理,迁移学习的原理以及它与LLM的关系

Pre-Train预训练与Fine-Tuning的工作流

如何解决数据集相关问题

Instruction Learning

Few-Short Leanring与Meta-Leanring,few-short leanring在LLM中应用

使用Prompt来完成自定义任务,Prompt的设计与优化方法

Prompt-Tuning技术,Prompt-Tuning与传统Fine-Tunning技术的区别

第五周 : 基于人类反馈的强化学习训练(RLHF)

LoRa: Learning from Rules and Arguments. 基于规则定义的语言能力增强

人机交互AI系统的工作流与框架(workflow与framework)

PPO算法在ChatGPT中的应用分析

如何设计Reward Model

PPO算法在ChatGPT中的算法实践

Off-Policy训练与Importance Sampling

Imitation与Reverse Reinforcement Learning在RLHF中的应用

第六周 : 大语言模型的部署实践

模型压缩与剪枝技术、知识蒸馏

ONNX + TensorRT

模型部署的量化技术

GPTQ量化: Post-Trainng Quantization for Generative Pre-trained Transformers

第七周 : 基于开源模型的多模态实践

Visual-ChatGPT的原理

如何准备自己的数据集

Finetune ChatGLM

第八周 : 开源版ChatGPT的待完成任务解析

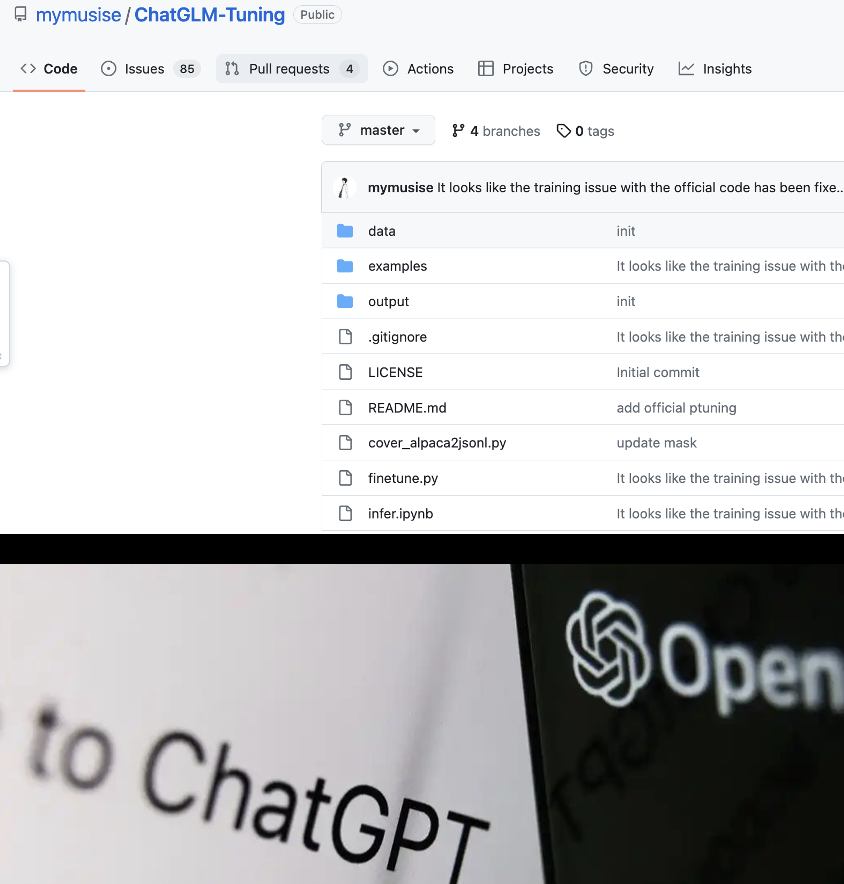

ChatGLM-Tuning的原理与项目架构解析

目前待完成的任务介绍与完成过程分析

成为该项目贡献者的指引

第一个大项目:成为开源版ChatGPT——ChatGLM-Tuning的源代码贡献者

项目介绍:通过前八周的课程,大家对自然语言处理相关的预训练模型,尤其是 Transformer,HFRL,GPT,Prompt 等技术都有了一定的理论基础。那么现在,大家就要将这些知识转化为实际的项目,我们将参与完成 ChatGLM-Tuning 项目中的功能,我们的导师将指导大家完成。通过这个项目,你不仅亲手实践,学习了最新的 GPT 大模型相关的实操构建,进一步构建符合自己的需求、符合公司业务需求大模型对话机器人,并且目前各个公司人工智能项目对掌握此能力的人才需求量大涨,而该项目会为自己的简历添加重要的项目履历。

▲ 图例:项目1示例

Transformers与计算机视觉

/ 主讲老师,赵老师

第九周 : 视觉 Transformer(ViT)及视觉 AIGC 导论

视觉AIGC的学习目标

视觉AIGC方向求职的面试准备与业务学习

ViT的理论介绍与实现原理

ViT: An Image is Worth 16x16 Words: Transformers for Image Recognition at Scale

DeiT: Training Data-Efficient Image Transformers & Distillation through Attention

TNT: Transformer in Transformer

ConVit、MLP-Mixer、Swin Transformer等混合方案

第十周 : ViT 的高级方法,DALL-E

Transformer的结构升级

视频Transformer:TimeSFormer, VideTransformer

Transformer,GPT与图像生成模型

DALL-E:基于文本生成图像的原理

ViT与计算机视觉专门问题的结合应用:

检测任务(Object Detection)与ViT

分割任务(Semantic Segmentation)与ViT

Image Caption

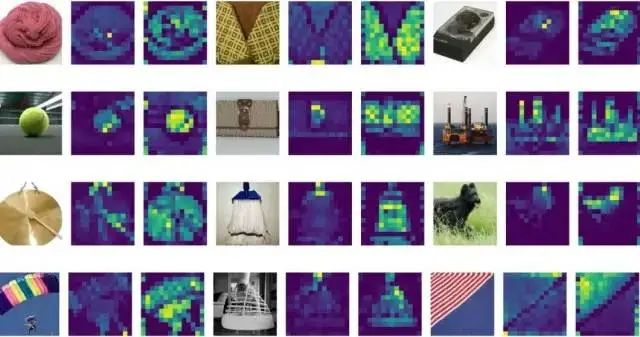

项目二导引:利用 ViT 进行图像分类/物体检测

项目介绍:通过该项目能够掌握 ViT 的理论认识以及上手技能;同时,也能理解 CV 领域一路走来的发展,无论是技术上从传统 CV 算法,到深度学习(deep learning,也即 DL)卷积神经网络(Convolutional Neural Network,也即 CNN),再到现阶段 ViT,还是从内容上的分类/检测入手。因而,通过这个项目,能够使同学对 CV 领域的技术与内容,有直观也深入的理解。同时,由于 Transformer 的天然特性,也对非视觉类数据的处理有了一定的积累。

深度神经网络与计算机视觉:第一类生成模型

/ 主讲老师,赵老师

第十一周 : 对抗生成网络(GAN, Generative Adversarial Network )

GAN的结构与原理:Discriminator/Generator

GAN原理详解:KL/JS散度,最优判别器

GAN的原始实现方法

第十二周 : GAN的发展与Wasserstein GAN

GAN存在的问题:Mode Collapse,难以训练

以上问题优化的原理与优化目标

Wasserstein GAN(WGAN)与原理,WGAN-GP

Unrolled GAN, Spectral Normalization, Noise Injection, Mixing Regularizationd等其他优化方法

第十三周 : GAN的高级应用

实例分析:视频中的颜色矫正

从UNet到WNet的升级

WGAN-GP与Patch GAN的结合

Perceptual Loss的应用

光流(optical flow):基础且重要的视觉理论

第十四周 : GAN的进阶发展

Pix2Pix:Conditional GAN + Patch GNA

Cycle-GAN:非成对数据与Consistency Loss

SPADE:可控 GAPN

第十五周 : 项目指引课:GAN 在图像矫正领域的应用

项目介绍:GAN 是一类强大的生成类模型,其早于 diffusion model,因而已真实应用于实际场景当中。在这个项目中,我们将利用所学的 GAN 相关知识,进行静态图片与动态视频的矫正工作。切实体会课上所讲的理论知识如何应用在实际工作中,并能够避免很多目前所存在的人云 亦云似的一知半解的讹传,真正做到学以致用。同时,在项目进行中,会介绍大量切实可行 的技巧,这些技巧是普适的,能够被所有架构应用。不仅如此,我们也会介绍一些 CV 领域底层的思想,使大家的学习工作不仅流于表面,也能够深入到本质。

▲ 图例:项目3示例

Latent Diffusion:

第二类生成模型与其应用

第十六周 : Latent Diffusion 导论

Diffusion 过程与生成模型

Denoising diffusion probabilistic model(DDPM)介绍

Latent diffusion model(LDM)原理

LDM 的实现原理和方法

LDM 的应用: 图像、视频、文本生成

第十七周 : Diffusion Model 进阶

Diffusion Model 进展:Learnable Diffusion, Reversible generative model 与 LDM

面向未来的Diffusion: Causal generative modeling, 数据缺失

Diffusion与强化学习的结合

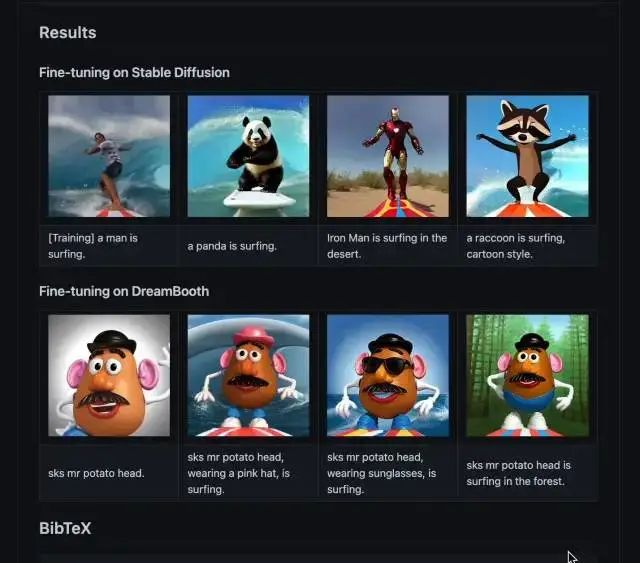

第十八周 : 结业项目:利用 Latent Diffusion Model进行基于文字描述的图像生成

项目介绍:在经过第一个项目(进行 ViT/Transformer 技能储备)以及第二个项目(CV 技能储备)后,我们终于做好储备,得以迎来最后一部分的项目内容,即进行利用 LDM 的图像生成工作。

LDM 是最新的生成式模型,其内容上的最大特点便是利用语言文字进行图像生成;同时在技术上,也与 GAN 不同。具有训练相对简单,效果相对较好(当然,通过我们的讲解,GAN 技术同样也可以做到此点)的特点,因而目前热度较高。在这个背景下,我们将带领大家直 观感受 LDM 究竟是如何完成这点的。

▲ 图例:项目4 示例

五

课程收费

5.1 前沿实战班

课程售价 : 10800元或1500美金

4 个月直播课程训练;

参与开源 ChatGLM 功能开发,成为 Github 高星项目参与者;

完成自己的 Latent Diffusion Model 文本生成模型

提供 30 核 CPU 服务器;

5.2 就业强化班

课程售价 : 13800元或1900美金

包含“前沿实战班”所有权益

机试攻克:包含目前售价为 7800 元持续 8 周的算法机试强化课程——授课老师为赵老师,硅谷算法 AI 算法研究员

实战强化:提供 30 核 40G NVIDIA-A100 GPU 先进服务器(A100GPU 计算速度为 V100 的 155%,为 P100GPU 的 3500%)

注:本次提供的GPU使用时长为4个月

5.3 课程开始时间

2023年5月7日(周日)早上9:30

5.4 不满意退费保障

本次课程正式开始时间为2023年5月7日,我们为大家提供为期一个月的退费期,不满意可随时提出退款。

付费至- 5月21日:提出退费 3天内退还100%学费

5月22日-5月28日:提出退费 3天内退还50%学费

5月29日-6月06日:提出退费 3天内退还25%学费

六

相关QA

6.1. 本课程的学员构成是怎样的?

回答:我们只开设最前沿的核心技术课程,以最近一年我们的学员为例:其中 75% 为 AI 研发人员,大学老师或者相关科研人员,20% 的学员为相关专业的高年级研究生。

6.2. 本课程是否能提供发票?

回答:本课程能够开具发票。事实上,我们课程中有大约 25% 的学员是大学老师或者研究员,我们的课程为他们提供了非常实际的帮助。

6.3. 我的基础不太够,但是我很想学,该怎么办?

如果您的基础不太够,我们这里有从 Python 零基础到神经网络,再到深度学习、CNN,计算机视觉,自然语言处理的全系列AI基础课程。我们都是免费提供给大家。大家可以先学习基础课程,等待下一期开班。

报名

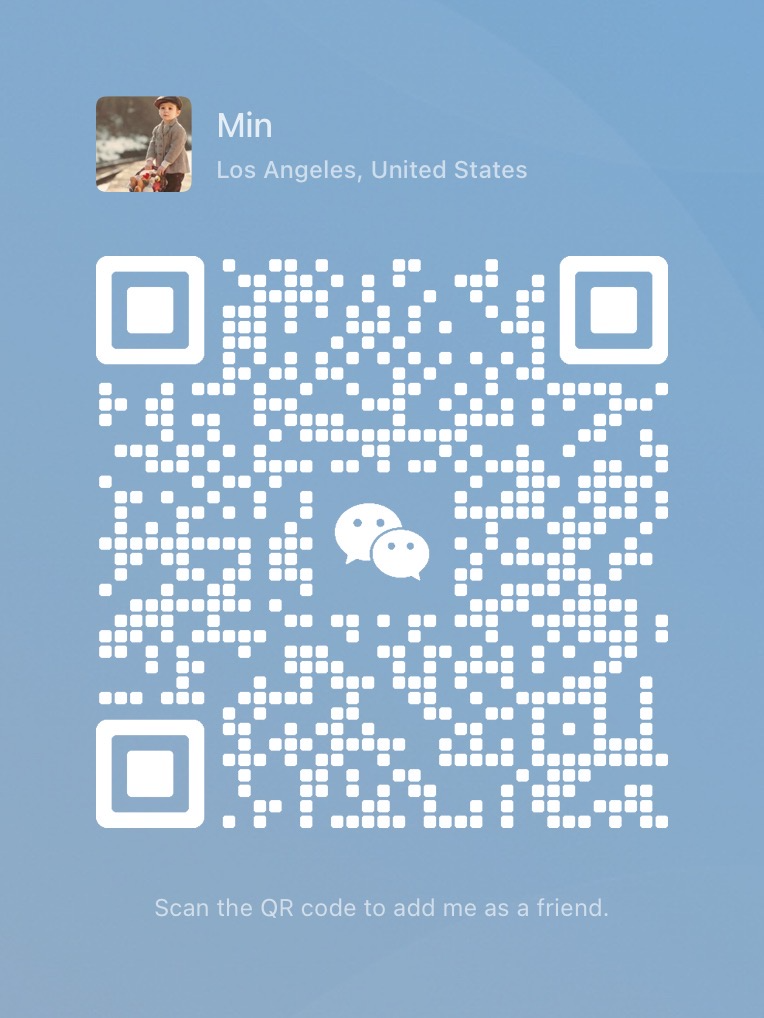

预报名2023夏季AIGC课程的同学请咨询下方二维码

因时差问题,微信通过可能需要大家等待,感谢理解!

前30名报名可享有GPT-4私人助理机器人1年使用权限,报名后即可使用

课程监制与出品人-高老师

(高老师,赵老师往期学员凭学习记录可享受一定优惠)