【AAAI2022】基于对比学习的预训练语言模型剪枝压缩

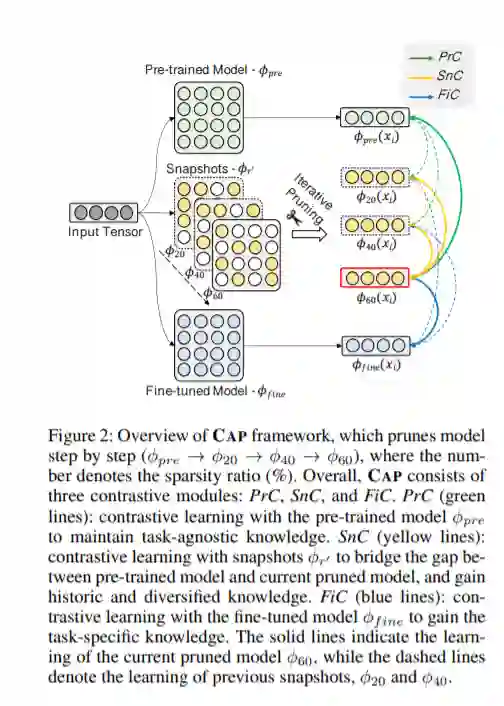

在预训练和微调范式下,预训练语言模型(PLMs)在各种自然语言处理(NLP)任务中取得了巨大的成功。由于具有大量的参数,PLM需要大量的计算和资源。因此,模型剪枝被引入到大规模PLM的压缩中。然而,以往的方法大多只考虑下游任务的特定知识,而忽略了修剪过程中基本的任务不可知知识,这可能会导致灾难性遗忘问题,导致泛化能力较差。为了在我们的剪枝模型中保持任务不可知论和任务特定的知识,我们提出了对比剪枝(CAP)在预训练和微调范式下。它被设计成一个通用框架,兼容结构化和非结构化剪枝。CAP统一于对比学习,使得经过修剪的模型能够从预训练的任务不可知知识模型和精细调整的任务特定知识模型中学习。此外,为了更好地保留剪枝模型的性能,快照(即每次剪枝迭代时的中间模型)也可以作为剪枝的有效监督。我们大量的实验表明,采用CAP能够持续地产生显著的改进,特别是在非常高的稀疏性场景中。在只保留3%模型参数(即97%稀疏度)的情况下,CAP在QQP和MNLI任务中分别成功地实现了原BERT算法的99.2%和96.3%的性能。此外,我们的探索性实验表明,经过CAP修剪的模型具有较好的泛化能力。

https://www.zhuanzhi.ai/paper/d2442bf43a31aaa81587f38a17e6c85d

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“CAPLM” 就可以获取《【AAAI2022】基于对比学习的预训练语言模型剪枝压缩》专知下载链接

登录查看更多

相关内容

Arxiv

0+阅读 · 2022年4月15日