Mish:一个新的state of the art的激活函数,ReLU的继任者

点击上方“计算机视觉life”,选择“星标”

快速获得最新干货

作者:Less Wright

编译:ronghuaiyang(AI公园)

对激活函数的研究一直没有停止过,ReLU还是统治着深度学习的激活函数,不过,这种情况有可能会被Mish改变。

Diganta Misra的一篇题为“Mish: A Self Regularized Non-Monotonic Neural Activation Function”的新论文介绍了一个新的深度学习激活函数,该函数在最终准确度上比Swish(+.494%)和ReLU(+ 1.671%)都有提高。

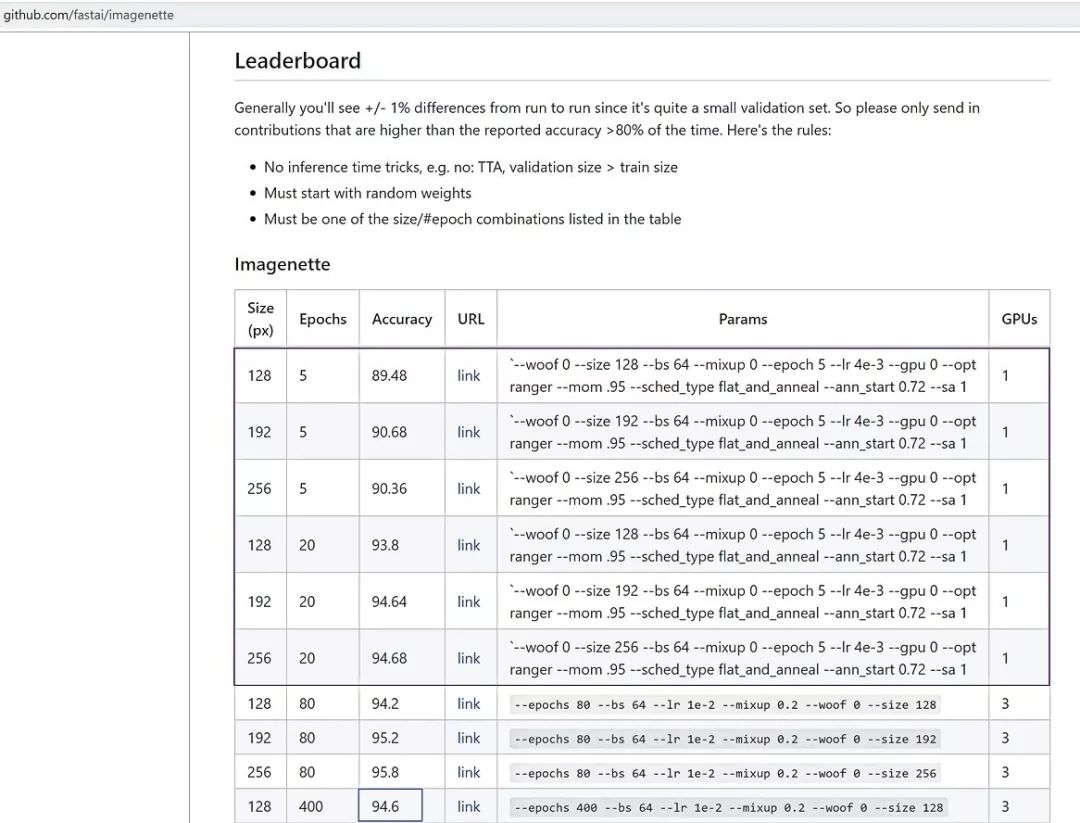

我们的小型FastAI团队使用Mish代替ReLU,打破了之前在FastAI全球排行榜上准确性得分记录的一部分。结合Ranger优化器,Mish激活,Flat + Cosine 退火和自注意力层,我们能够获得12个新的排行榜记录!

我们12项排行榜记录中的6项。每条记录都是用Mish而不是ReLU。(蓝色高亮显示,400 epoch的准确率为94.6,略高于我们的20 epoch的准确率为93.8:)

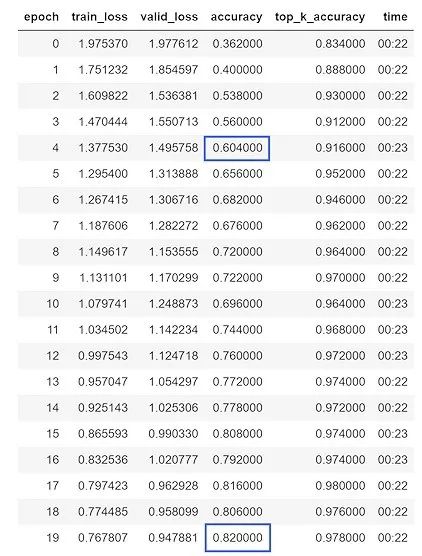

作为我们自己测试的一部分,对于ImageWoof数据集的5 epoch测试,我们可以说:

Mish在高显著性水平上优于ReLU (P < 0.0001)。(FastAI论坛@ Seb)

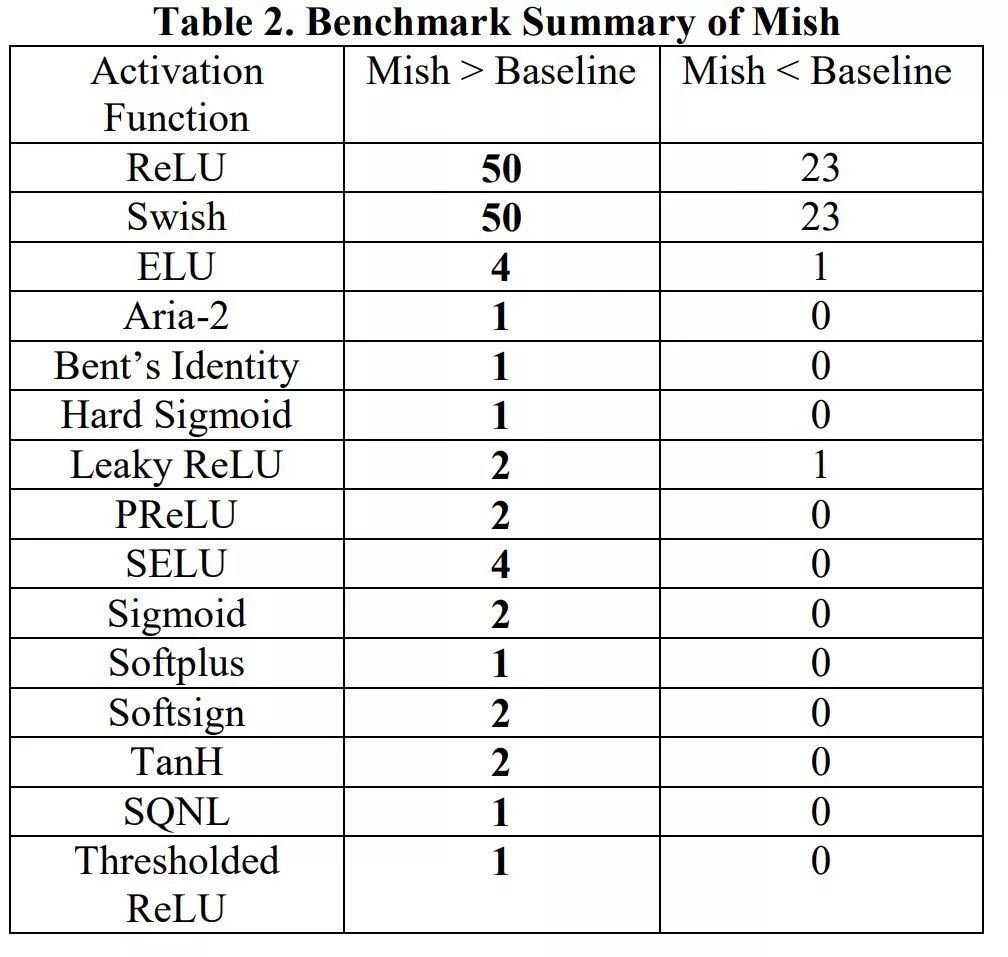

Mish已经在70多个基准上进行了测试,包括图像分类、分割和生成,并与其他15个激活函数进行了比较。

我做了一个Mish的PyTorch实现,用它替换了ReLU,没有做任何其他更改,并在困难的ImageWoof数据集上使用广泛的优化器(Adam、Ranger、RangerLars、Novograd等)对它进行了测试。

我发现Mish在训练稳定性、平均准确率(1-2.8%)、峰值准确率(1.2% - 3.6%)等方面都有了全面的提高,与本文的结果相匹配或超过。

下面是Ranger Optimizer + Mish与FastAI排行榜相比:

这是通过简单地在FastAI的XResNet50中使用Mish替换ReLU,并使用各种优化器(上面的Ranger结果)运行来实现的。没有任何其他变化,包括学习率。注意:优化Mish的学习率很可能会获得更好的结果。本文提出了相对于ReLU而言,较低的学习率供参考。

Mish检查了理想的激活函数应该是什么(平滑、处理负号等)的所有内容,并提出了一套泛化的初始测试。在过去的一年里,我测试了大量新的激活函数,其中大多数都失败了,从基于MNIST的论文,到基于更真实的数据集的测试。因此,Mish可能最终会为深度学习实践者提供一种新的激活功能,并有很大的机会超过长期占据主导地位的ReLU。

我通过下面的PyTorch代码链接提供了Mish,以及一个修改过的XResNet (MXResNet),这样你就可以快速地将Mish放入你的代码中,并立即进行测试!

让我们后退一步,了解什么是Mish,为什么它可能改进ReLU上的训练,以及在神经网络中使用Mish的一些基本步骤。

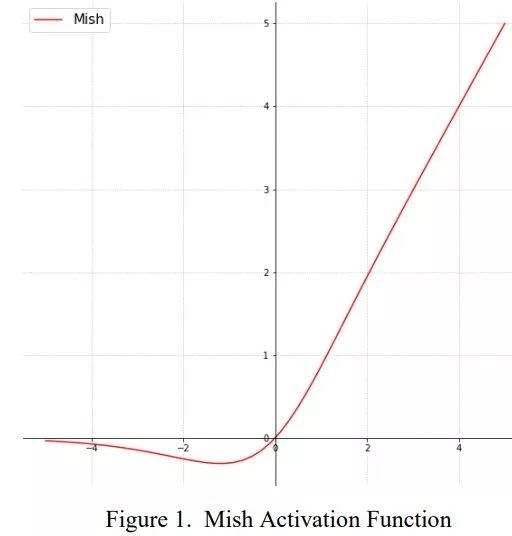

什么是Mish?

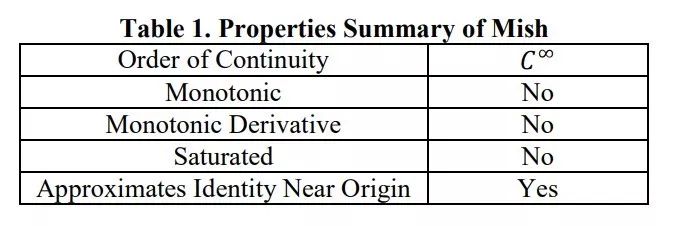

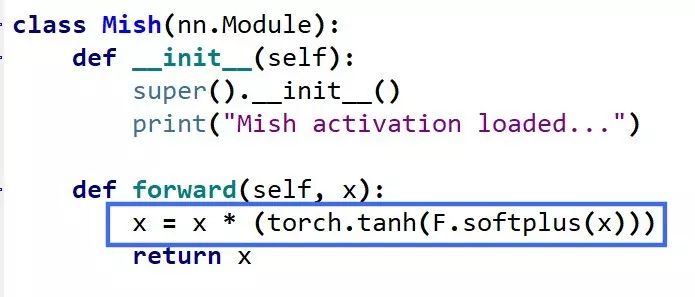

直接看Mish的代码会更简单一点,简单总结一下,Mish=x * tanh(ln(1+e^x))。

其他的激活函数,ReLU是x = max(0,x),Swish是x * sigmoid(x)。

PyTorch的Mish实现:

Tensorflow中的Mish函数:

Tensorflow:x = x *tf.math.tanh(F.softplus(x))

Mish和其他的激活函数相比怎么样?

下图显示了Mish与其他一些激活函数的测试结果。这是多达73个测试的结果,在不同的架构,不同的任务上:

为什么Mish表现这么好?

以上无边界(即正值可以达到任何高度)避免了由于封顶而导致的饱和。理论上对负值的轻微允许允许更好的梯度流,而不是像ReLU中那样的硬零边界。

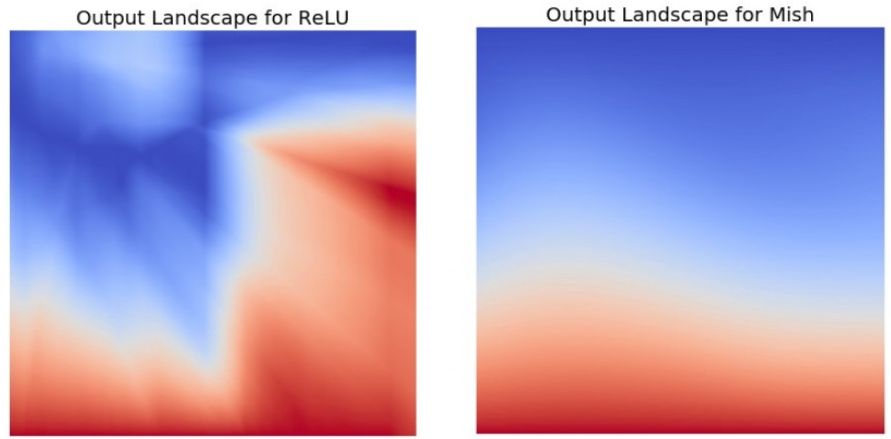

最后,可能也是最重要的,目前的想法是,平滑的激活函数允许更好的信息深入神经网络,从而得到更好的准确性和泛化。

尽管如此,我测试了许多激活函数,它们也满足了其中的许多想法,但大多数都无法执行。这里的主要区别可能是Mish函数在曲线上几乎所有点上的平滑度。

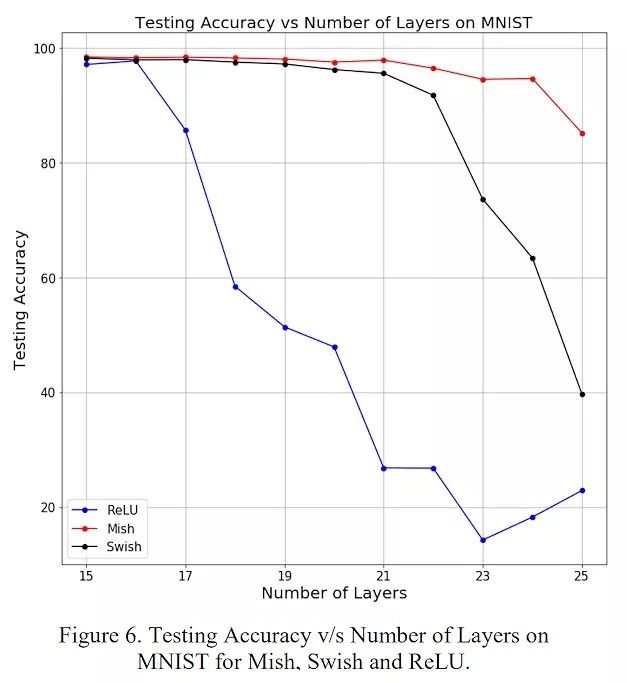

这种通过Mish激活曲线平滑性来推送信息的能力如下图所示,在本文的一个简单测试中,越来越多的层被添加到一个测试神经网络中,而没有一个统一的函数。随着层深的增加,ReLU精度迅速下降,其次是Swish。相比之下,Mish能更好地保持准确性,这可能是因为它能更好地传播信息:

如何把Mish放到你自己的网络中?

Mish的PyTorch和FastAI的源代码可以在github的两个地方找到:

1、官方Mish github:https://github.com/digantam98/Mish

2、非官方的Mish使用inline提升速度:https://github.com/lessw2020/mish

3 、我们与Ranger和Mish (MXResNet的一部分)一起的FastAI的记录:https://github.com/lessw2020/Ranger-Mish-ImageWoof-5

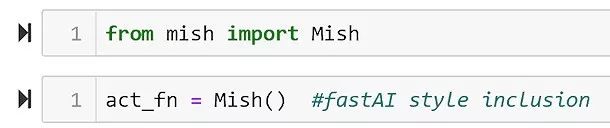

复制mish.py到你的相关目录,并包含它,然后将你的网络激活函数指向它:

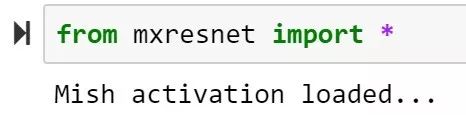

另外,FastAI用户可以使用修改后的XResNet加载和测试,使用Mish而不是ReLU。复制文件mxresnet.py到本地目录或路径:

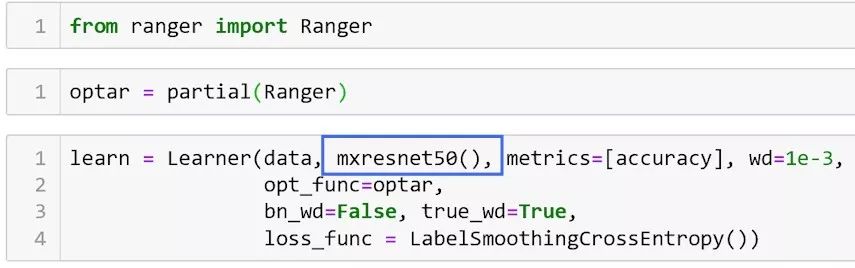

接下来指定相关的ResNet大小(18、34、50、101、152),并加载体系结构(cnn_learner,等等)。下面是我如何加载mxresnet50,使用Ranger优化:

总结

ReLU有一些已知的弱点,但是通常它执行起来很轻,并且在计算上很轻。Mish具有较强的理论渊源,在测试中,就训练稳定性和准确性而言,Mish的平均性能优于ReLU。

复杂度只稍微增加了一点(V100 GPU和Mish,相对于ReLU,每epoch增加大约1秒),考虑到训练稳定性的提高和最终精度的提高,稍微增加一点时间似乎是值得的。

最终,在今年测试了大量新的激活函数后,Mish在这方面处于领先地位,我怀疑它很有可能成为AI未来的新ReLU。

英文原文:https://medium.com/@lessw/meet-mish-new-state-of-the-art-ai-activation-function-the-successor-to-relu-846a6d93471f

高效对接AI领域项目合作、咨询服务、实习、求职、招聘等需求,背靠25W公众号粉丝,期待和你建立连接,找人找技术不再难!

交流群

欢迎加入公众号读者群一起和同行交流,目前有SLAM、检测分割识别、三维视觉、医学影像、GAN、自动驾驶、计算摄影、算法竞赛等微信群(以后会逐渐细分),请扫描下面微信号加群,备注:”昵称+学校/公司+研究方向“,例如:”张三 + 上海交大 + 视觉SLAM“。请按照格式备注,否则不予通过。添加成功后会根据研究方向邀请进入相关微信群。请勿在群内发送广告,否则会请出群,谢谢理解~

推荐阅读

最新AI干货,我在看