【CMU教程】高效大规模机器学习训练,198页PDF带你概览领域前沿进展

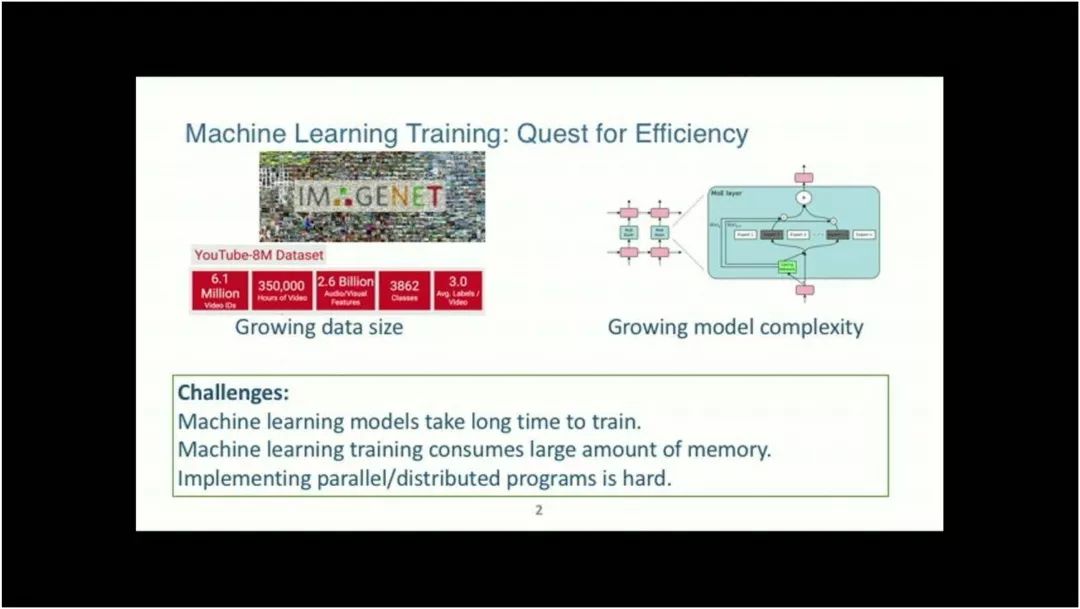

【导读】近些年来,机器学习已经在许多真实场景中取得了巨大成功。但是,在实际应用过程中,由于模型复杂度及数据集容量的增加,研究人员面临着计算资源受限的严峻挑战,使得业界迫切需要新的计算框架来完成大型模型的训练工作,从而使研究人员能够轻松地验证新想法。

原文链接:

https://www.microsoft.com/en-us/research/video/scheduling-for-efficient-large-scale-machine-learning-training/

1.课程介绍

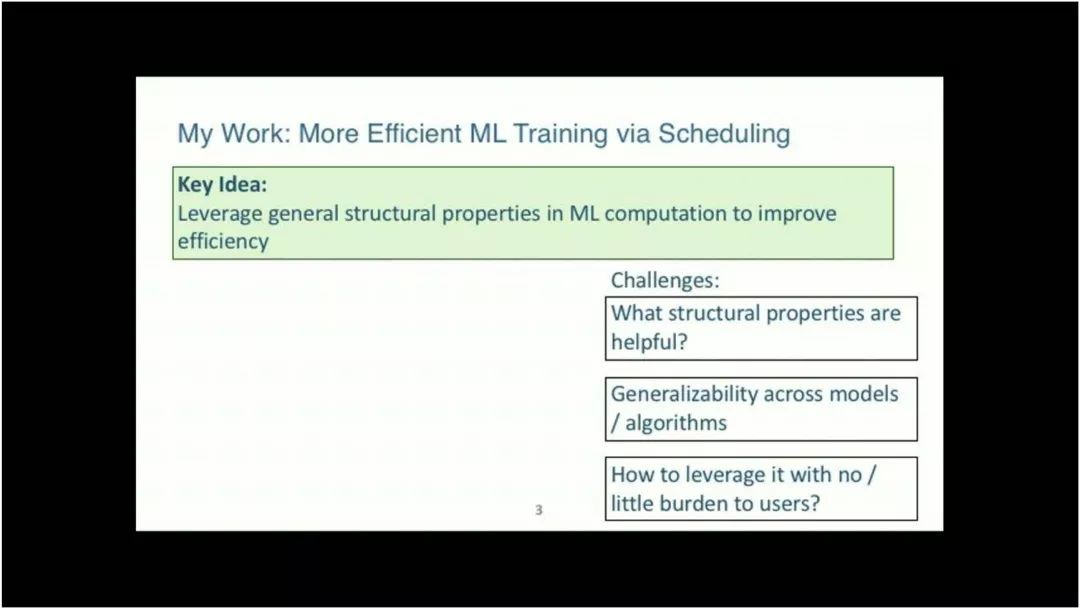

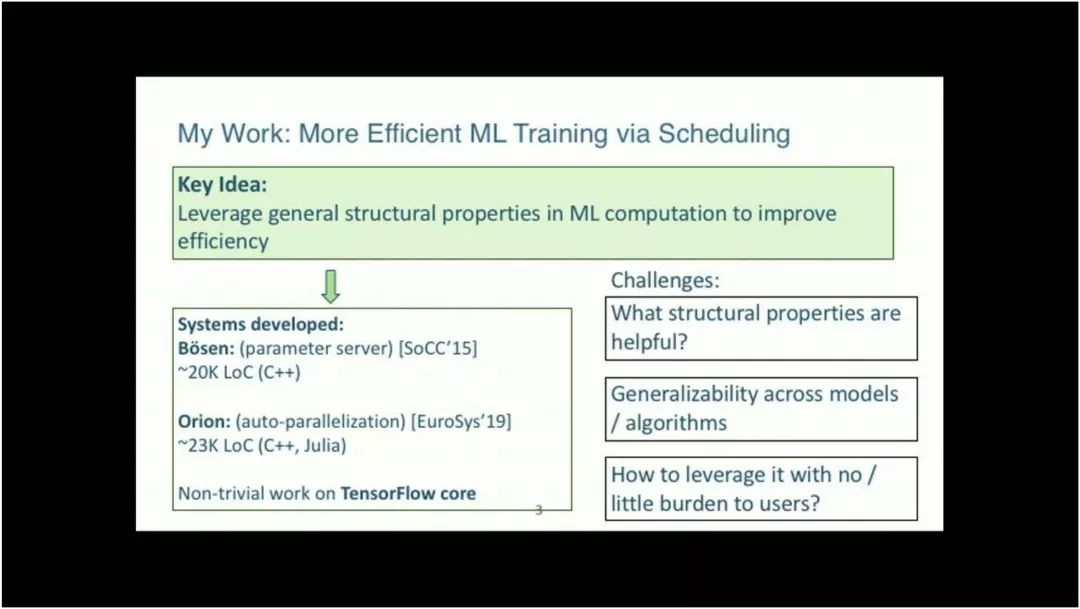

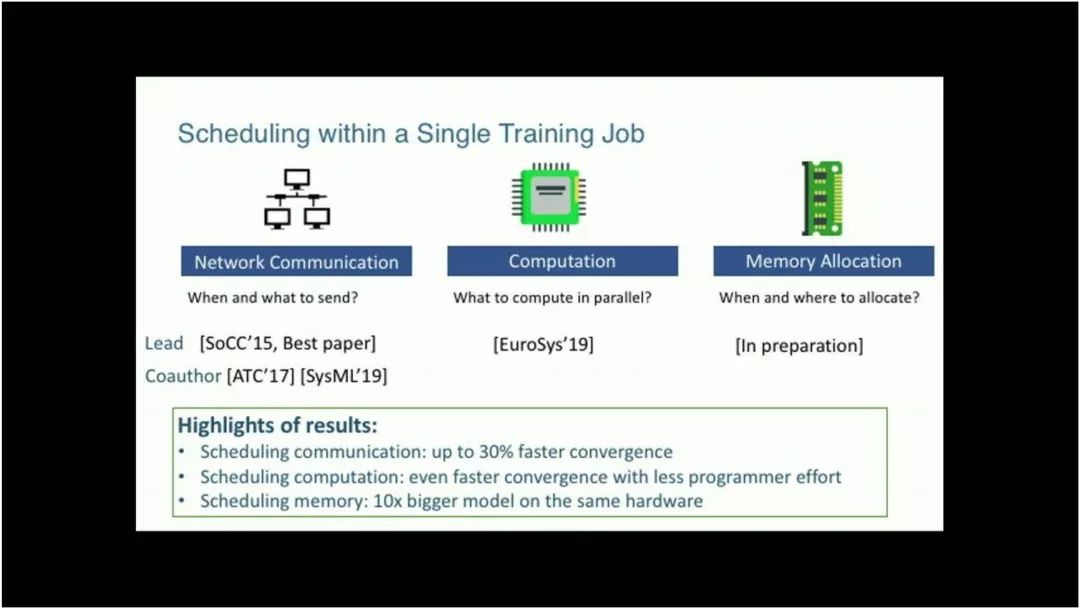

在本次讲座中,将重点介绍两种分布式训练系统:Bosen和Orion。它们可以在不需要大量人力工作的前提下,通过调度网络内部通信及并行计算来改善训练时间。此外,通过在TensorFlow中调度内存占用,我们减少了87%的GPU内存消耗,并且能够在相同的硬件上完成10倍参数的模型训练工作。

讲师:Jinliang Wei(韦金良)

本科毕业于普渡大学,博士期间师从Garth A. Gibson 及 Eric P. Xing,主要研究方向是分布式系统、数据库系统及机器学习应用。

个人主页:

http://www.cs.cmu.edu/~jinlianw/

2.内容预览

-END-

专 · 知

专知,专业可信的人工智能知识分发,让认知协作更快更好!欢迎登录www.zhuanzhi.ai,注册登录专知,获取更多AI知识资料!

欢迎微信扫一扫加入专知人工智能知识星球群,获取最新AI专业干货知识教程视频资料和与专家交流咨询!

请加专知小助手微信(扫一扫如下二维码添加),加入专知人工智能主题群,咨询技术商务合作~

专知《深度学习:算法到实战》课程全部完成!560+位同学在学习,现在报名,限时优惠!网易云课堂人工智能畅销榜首位!

点击“阅读原文”,了解报名专知《深度学习:算法到实战》课程