【ECCV2022】对比视觉Transformer的在线持续学习

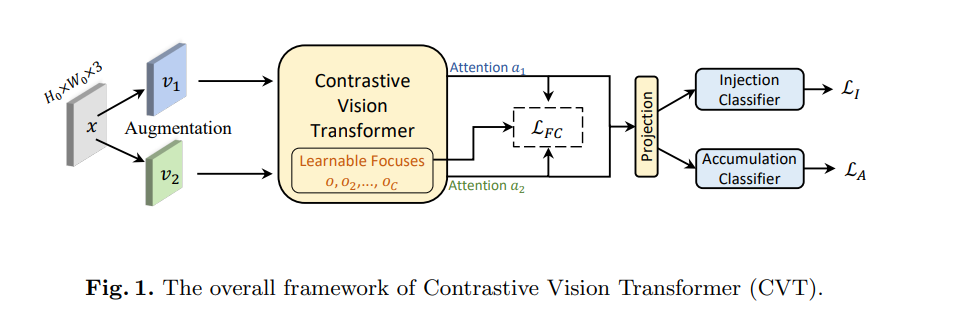

在线连续学习(Online continuous learning, Online CL)研究从无任务边界的在线数据流中学习顺序任务的问题,旨在适应新数据的同时缓解对过去任务的灾难性遗忘。本文提出了一种对比视觉Transformer(CVT)框架,该框架设计了一种基于Transformer结构的focal对比学习策略,以实现在线学习的更好的稳定性-可塑性权衡。具体地说,我们设计了一种新的外部注意力机制,隐式地捕捉了之前的任务信息。此外,每节课都有可学习的重点,可以积累上节课的知识,缓解遗忘。基于可学习的重点,我们设计了焦点对比损失,以重新平衡对比学习之间的新和过去的课程和巩固以前学习表征。此外,CVT包含一个双分类器结构,用于解耦学习电流类和平衡所有观察类。大量的实验结果表明,我们的方法在在线CL基准测试中以更少的参数实现了最先进的性能,并有效地缓解了灾难性的遗忘。

https://arxiv.org/abs/2207.13516

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“CLVT” 就可以获取《【ECCV2022】对比视觉Transformer的在线持续学习》专知下载链接

登录查看更多

相关内容

Arxiv

0+阅读 · 2022年10月2日

Arxiv

0+阅读 · 2022年9月30日

Arxiv

23+阅读 · 2020年3月7日