宾大视觉惯性里程计无人机集群

Visual-Inertial Odometry,VIO中文名为视觉惯性里程计。对无人机的定位来说,实时性是一个重要的条件,视觉里程计常常要在计算代价和精确度之间做权衡。VIO可以在同样的条件下,获得更好的效果。同时价格成本也是重要的指标,相比于昂贵的激光雷达,摄像机和IMU是低价普适的传感器。

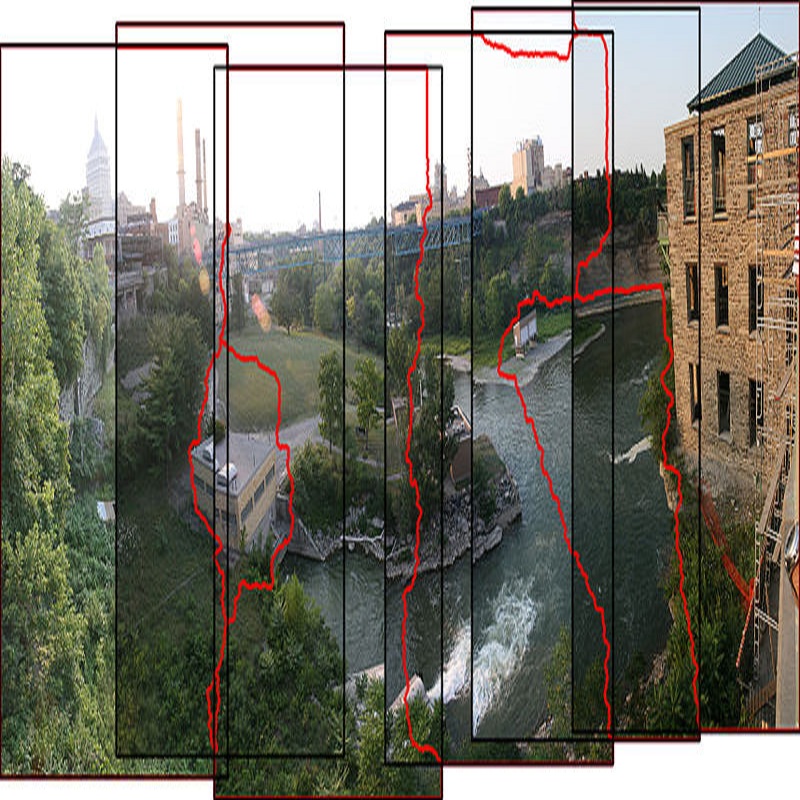

图像匹配技术是计算机视觉的重要组成部分, 在目标识别、图像拼接、运动跟踪、图像检索、自动定位等研究中起着重要作用。图像特征匹配是图像匹配的一种重要方法,图像进行特征匹配分三个关键步骤:检测关键点、提取描述向量和特征匹配;通过检测关键点和提取描述向量构造出局部特征描述子,然后进行特征匹配。

绝大多数四旋翼飞行器在自主飞行时都依赖于某种外部定位信息,通常是一个动作捕获系统,有时是借助GPS。零度自控研究过VIO集群,但在日常集群表演中为可靠起见,采用二维码视觉定位,为了舞台表演效果更好,对地面的二维码做了隐身处理。宾比法尼亚大学的Vijay Kumar实验室的Aaron Weinstein, Adam Cho, and Giuseppe Loianno更专注纯粹的视觉惯性里程计定位,让一群12个重量为250g的四旋翼飞行器以紧密的队形飞行,每个飞行器仅仅使用了一个小相机和一个简单的IMU装置;当然,单一的相机和IMU是可伸缩的,现在很多的智能技术正在趋于成熟,因此只要空间允许,可以根据实际需求拥有越来越多的传感器。像立体照相机这样的传感器可以用于绘制环境地图并识别其他车辆,从而获得完全分布式的解决方案。

这是最大的一群不依赖于运动捕获或GPS的视觉惯性里程计四旋翼飞行器。与之前的一些工作相比,解决方案主要有以下几个区别:

第一,研发了一个可扩展(Scalable)和可延伸(extensible)的多视觉四旋翼飞行器控制架构。这里可扩展指可以很容易地向系统中加入额外的飞行器而不损失整个系统的性能表现。

第二,这是第一次在不依赖GPS或者一个外部动作捕捉系统的情况下,将感知,路径规划和控制结合来实现多可互换飞行器(达到12个四旋翼飞行器)的自动导航。

第三,使用商业化的零部件并将源代码开源在网上。这是目前为止最大的不依赖于动作捕捉系统或者GPS的自动四旋翼飞行器蜂群系统。我们希望任何人都能在不使用昂贵的动作捕捉系统的情况下实验开发多MAV集群系统。

四旋翼飞控基于运行ROS系统高通骁龙开发板。该开发板包含一个四核处理器,一对VGA立体相机和一个4K摄像机。飞行中每个无人机仅仅使用了一到两个核的处理能力,一个简单的惯性单元IMU,以及一个朝下的带有160°视野的VGA摄像头。每个四旋翼的工作是利用视觉惯性里程计(VIO)来估计它从起始位置移动的距离和方向,这样就能很好的逼近它的相对位置。它简单地识别并跟踪其相机视角中的视觉特征:如果无人机的摄像头看见一个物体,而这个物体在整个框架中从右向左移动,无人机就可以推断(在它的IMU的帮助下)它正在向右移动。像这样的航迹计算方法会导致一些漂移,在位置估计上的小错误会随着时间的推移而增加,但是宾夕法尼亚大学的研究人员们已经设法控制了误差,即使在无人机飞行超过100米之后,总体位置误差仅仅超过半米。

每个无人机跟踪记录它自己的位置的同时,还将这些位置信息更新以10 Hz的频率通过一个5G Hz的Wi-Fi发送给一个地面基站。基站上运行着ROS系统,收集所有这些位置更新信息,然后将命令发回给集群以改变队形。每一个独立无人机唯一收到的只是一系列目标点坐标和一个开始时间;因为每个无人机独自计算自己的轨迹,所以地面基站并不需要做所有的规划。这使得整个事情变得轻量化和分散,使得集群系统可以很容易地扩展到更多的无人机规模。值得注意的是,对于每个无人机而言,它根本不是一个集群的一部分— 它只监视自己的位置然后从一个坐标点移动到另一个坐标点,完全意识不到(直接或非直接地)它周围还有其他的无人机。尽管如此,整个系统工作的很好,可以从视频中看到,无人机并没有发生相互碰撞。

视频中的户外测试有以下几个点需要注意。其中有些是在非常低的光线条件下完成的,对于任何VIO系统来说,都是一个令人印象深刻的表现,因为VIO系统依赖于足够的特征识别来进行良好的位置估计,在晚上这会是一件棘手的事情。还有一件你可能无法从视频看出的事,户外测试的平均风速是10mph,18mph的阵风。这是一个非常鲁棒的跟踪,换句话说,这使得它更像是一个可以实际使用的系统,而不仅仅是一个先进的试验例子。

宾大研究人员下一步正在研究鲁棒性、环路闭合、密集重建等一些关键技术。目前正在开发一个基于视觉里程计的能使漂移减小的闭环模块,因为在这个项目里每个机器人需要知道它的起始位置,但当闭环问题解决了的时候就不需要了。为了在灾难场景中以分布列的方式获得一个协调密集的重建环境,这些车辆将很快部署,也在努力减少地面基站的数量,同时着手研究一种增加地层回弹的新战术。最后,我们也在人机交互方面做了一些改进和探索,使机器人更好地完成和支持与人类之间的协调。

源自:泡泡机器人SLAM

长按识别图中二维码关注我们!