![]()

本文为约3772字,建议阅读6分钟

本文介绍

了近期关于人工智能新技术的发展方向问题的讨论和热议。

如果图灵、冯诺依曼看到现在这个样子,他们会怎么说?

毫无疑问,人工智能是最近的热门专业,同时也是高收入的保证,吸引着越来越多的学生和从业者。但新技术快速的发展背后,也一直有人在担心未来的问题:深度学习是真正有效的方向吗?不断增大的模型,会不会让 AI 研究变成仅限科技巨头的游戏?

在这些话题上,既有纽约大学教授 Gary Marcus 和图灵奖得主 Yann LeCun 的论战,也有在论坛和推特,机器学习社区经年累月的讨论。

![]()

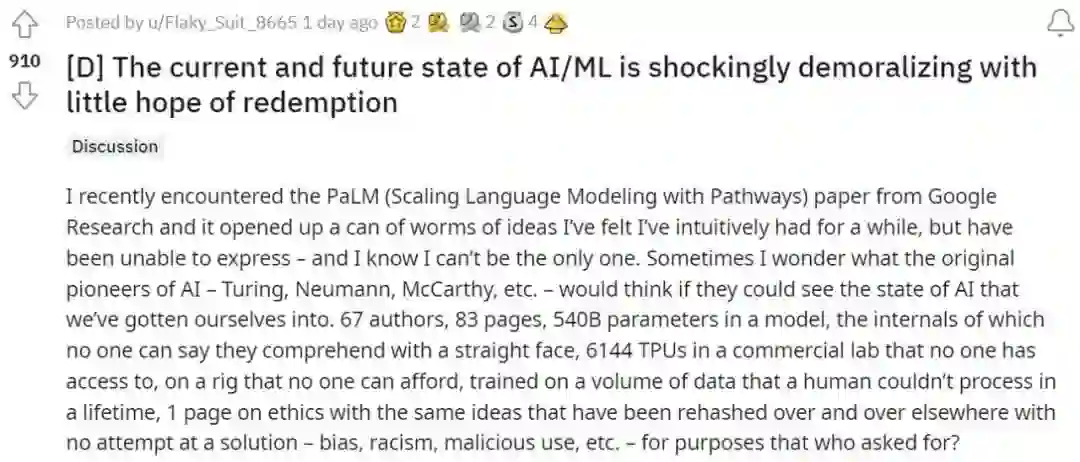

「我觉得 AI / 机器学习前途的令人震惊的黯淡,几乎没有救赎的希望」一位 AI 从业者最近在 Reddit 的机器学习板块发了一个帖子。

我最近看到了 Google Research 的 PaLM(Scaling Language Modeling with Pathways)论文,它打开了一大堆新的思路,其中很多我感觉自己已思考了一段时间,但一直无法表达——我肯定不是唯一一个这样想的。

有时候我想知道 AI 的最初先驱者——图灵、冯诺伊曼、麦卡锡等——如果他们能看到现在 AI 领域的状态,现在会怎么想。

PaLM 论文有 67 位作者,83 页,模型包含 5400 亿个参数,以至于没有人可以自信地说他们理解内部结构,谷歌用来训练它的 6144 块 TPU 是其他研究难以企及的条件,模型的训练使用了人类一生也无法处理的大量数据。这篇论文的一页是关于道德的,其中包含在其他研究中一遍又一遍地重复,但没有什么解决方案的相同想法——偏见、种族主义、恶意使用等——这又有什么目的呢?

2016 年,当我作为 AI 研究工程师开始职业生涯时,我对两种类型的任务最感兴趣——1)

大多数人可以做的那些

,但通常被认为是

乏味且不可扩展的

。我说的是图像分类、情感分析,甚至是文档摘要之类。2)

人类由于各种原因缺乏执行能力的任务——预测、风险分析、玩游戏等等

。我仍然热爱我的职业,我尝试只在这些领域的项目上研究,但它们正变得

越来越难

。

这是因为,在技术的发展过程中,我们把人工智能推入原本是人类独有的领域这件事已变得流行,并且毫无疑问是被接受的,这些领域在自我实现方面位于马斯洛需求层次的顶端——艺术、音乐、写作、唱歌、编程等等。这些领域的能力曲线呈负对数——绝大多数人根本做不到,大约 10% 的人可以做得很好,1% 或更少的人可以做得非常出色。

人工智能生成的一个很少讨论的问题是:在没有极端威胁的情况下,我们以技术改变世界为名牺牲最顶尖那批人的成就,直到人工智能能力范围成为常态

。这是因为相对于人类,人工智能是廉价、快速和无限的,以至于对人类成就的投资将在社会、教育和个人层面逐年减少。与几十年前取代人类的 AI 游戏不同,我们不能仅仅取消机器的资格并继续玩,就好像它们不存在一样。

不论我在哪里,甚至在这个论坛(机器学习讨论区)上,我都会遇到对当前业内最佳(SOTA)AI 生成系统,如 GPT-3、CODEX、DALL-E 等技术的普遍赞赏,却几乎没有人将其影响延伸到逻辑结论,在研究者声称要解决甚至重点关注的领域中,未来的一切可能都会归于平均值,归于平庸。

如果你是艺术家或作家,并且正在使用 DALL-E 或 GPT-3 来「增强」你的工作,或者如果你是一名程序员,会说出「GitHub Co-Pilot 让我成为一个更好的程序员」这样的话吗?这可能意味着你在打乱自己的创作过程,即思想→(可选文字)→行动→反馈→重复,变成了在画布上播种来自机器的想法,你无法理解其出处,也无法理解机器解释的可靠性。你做的越多,你的创作过程就越依赖于机器,直到你必须质疑没有它你是否可以保持这样水平的工作。

当我还是一名大学生时,有一段时间,我认为我的想法是革命性的和开创性的,直到我真正开始写下这些想法,然后在清醒的时候回顾它们,我意识到它们根本没有那么特别。

我相信当前人工智能的发展对人类产生负面影响的风险是巨大的,尤其是从跨越几代人的长期阶段去看,而我们大多数人甚至不会意识到它已经发生了,就像沸水中的青蛙一样。

如果你像我一样有孩子,你怎么能意识到目前这些领域的 SOTA 预计 20 至 30 年会如何,然后告诉孩子他们在艺术、写作或音乐的天赋是值得追求的?你怎么能假装诚实地告诉他们,多年来自动纠错的广泛应用并没有让你和其他人在拼写方面变得越来越糟糕?(即使我相信大多数人都会同意这个任务是有必要自动化的)

此外,我还没有讨论 AI 生成系统的长期应用所导致的「训练 - 生成 - 训练 - 生成」反馈循环。这些模型的第 1 代是根据人类生成的大量网络数据进行训练的,但如果允许这些系统在不受限制或验证的情况下不断吐出内容,从长远来看,那么第 4 代或第 5 代会发生什么?最终我们一定会遇到这种情况,即 AI 几乎只在 AI 生成的内容上进行训练,因此随着每一代的更迭,它逐渐陷入平庸,而使用当前的方法将再也不能解决这个问题。

经过热情地、坚持不懈地追求这个方向,我确信我们的 AI/ML 开发人员、公司和国家已经上了一条不归路,这主要是因为我们在时间和金钱上的投资,以及与我们竞争对手之间的囚徒困境。然而,作为一个共同体,我们为短期利益而选择的这个方向几乎肯定会使人类变得更糟,主要是对那些无能为力的人——我们的孩子、我们的孙子和更多后代。

如果你是一名 AI 研究员,或是像我这样的数据科学家,当多年来一直朝着这个方向发展职业生涯时,你能如何扭转局面?你每年的 TC 收入(总收入)可能接近或超过 20 万美元,并且有一个家庭要养家糊口,无论你对这个领域的发展方向有何看法,都为时已晚。

如果你有一家公司,如何接受竞争对手将他们的 AutoML 解决方案推向市场,而自己原地不动?此外,如果你是像 Jeff Dean 这样的领域内的带头人,你如何向老板和股东自证团队在 AI 上投的数十亿美元,同时平衡道德问题?

你不能——

唯一的答案是越来越大的模型,越来越多的应用程序,越来越多的数据,越来越自动化,然后进一步自动化

。

如果你身处美国这样的国家,当你的竞争对手(例如中国)一心一意地全速前进,并逐渐取代你在全球权力格局中的许多领域?这时你又如何开发负责任的人工智能?不参加比赛就意味着认输,不是吗?

即使我在这里描述的事情都没有发展到这样的程度,为什么很多人还是不认真对待并忽视了这种可能性呢?如果我所说的一切都是在散布恐惧气氛,那么我很想听听你的观点,20 到 30 年后,

人类与 AI 的共存会是怎样一种场景

?

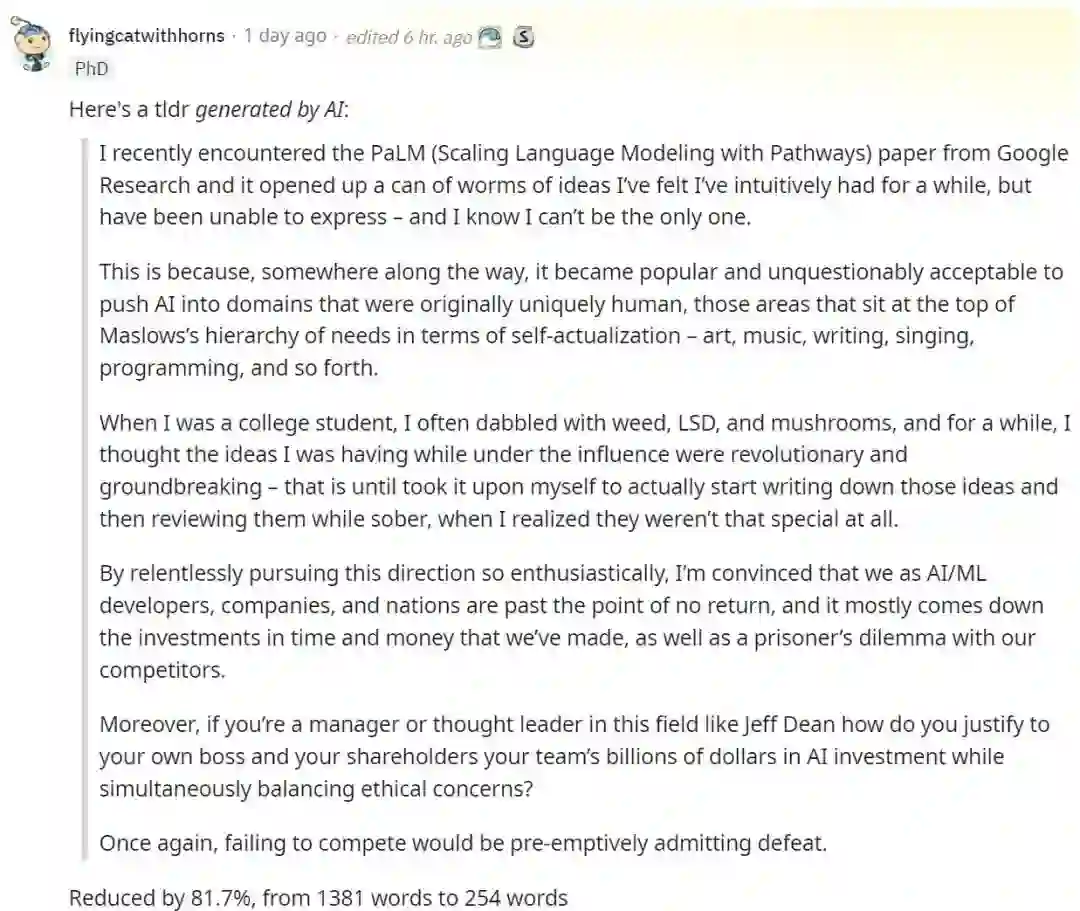

对于人工智能抹杀人类创造能力的担忧或许有其道理。不过现代社会,说的太多就意味着没人愿意看,于是热心网友用 AI 的文本总结功能对这段话进行了摘要。

有趣的是,AI 去掉了原文 81.7% 的篇幅,剩下的两百多个字仍足以完整表达作者的核心观点。

![]()

然而 AI 又脑补出了一些不该有的内容,结果把所有人都给整乐了。

这样的 AI,是会抹杀下一代人类创造力的那种吗

?

在评论区,有人回答了正文开头的问题:「如果图灵、冯诺依曼、麦卡锡还活着,他们会怎么看今天的人工智能发展现状?」

![]()

麦卡锡是一个严格的逻辑学家类型(LISP 甚至不应该在真正的计算机上运行),所以他会感到恐惧,或者至少在美学 / 理论层面上感到失望。麦卡锡很幸运,他经历了自己提出方法的鼎盛时期,并看到了他工作的无数下游应用,即使现在的我们越来越觉得这种范式是人工智能的死胡同。麦卡锡在 2011 年去世,当时说深度学习还为时过早,但在「机器学习」已经出现很久了,也许人们可以看看他写的关于机器学习的文章来判断他的想法。我不知道他是否会像某些人那样声称深度学习会撞墙或实际上未起作用之类的。

图灵和冯诺依曼肯定会非常热情:他们俩都对神经网络、联结主义和新兴方法非常感兴趣,

赞同人工智能需要极其强大的硬件

,这远远超出 1950 年代研究人员的认知,

并认为自我学习的方法是必需的

。图灵可能会对他最初预测在 RAM/FLOPS 上相差几个数量级感到失望,但请注意,在神经科学刚刚起步且计算机实际上什么也没做的时代,这是一个合理的猜测。他非常有先见之明,预测硬件的发展将持续实现成倍增长(早在摩尔定律之前);他会指出,我们仍然远远落后于进行实验和探索的自我学习 / 探索系统的目标,代入大量随机数据代替一定是次优的途径。

冯诺依曼同样不会对逻辑方法未能解决许多最重要的问题(如感官知觉)感到惊讶,他很早就主张需要大量的计算能力(这就是他所说的人们只认为逻辑 / 数学很复杂,因为他们没有意识到现实生活有多么复杂——这就是逻辑 / 数学失败的地方,你将需要大量的计算才能完成)并构建数字计算机来解决现实世界的问题,比如棘手的物理设计。

他还在他最后一部未完成的关于计算机和大脑的著作中指出,由于大脑本质上是图灵完备的,因此它们看起来可以通过输出数学等符号过程来运行这一事实,但并不意味着它们可以通过符号过程或任何算法等价的东西。最后,冯诺依曼是第一个使用「奇点」一词描述人类时代即将结束,被技术取代的人。(是的没错,如果冯 · 诺依曼能活到今天,他很可能被奉为奇点主义的祖师爷。)

参考内容:https://www.reddit.com/r/MachineLearning/comments/wiqjxv/d_the_current_and_future_state_of_aiml_is/